自1950年起,机器学习作为人工智能领域的一个分支,在许多应用工程中引发了历史性的革命。随着大数据技术的飞速发展,以及人们渴望解决的问题更加多样,简单的机器学习方法已无法满足日益复杂的应用场景,深度学习技术自然而然被引入。深度学习是从2006年开始发展起来的一类先进机器学习技术,其在计算机视觉、自然语言处理、机器翻译、医学成像、医疗信息处理、机器人与控制、语音识别、音频识别和生物信息等领域已取得长足发展[1]。

随着医疗卫生的快速发展和长年积累,繁杂而巨量的医疗数据很难通过人工提取并分析出有价值的信息。医疗数据包括患者的基本数据、电子病历、诊疗数据、医学图像数据和医学管理数据等[2]。基于这些医疗数据,深度学习技术已深入到疾病诊断领域的各方面,如放射学、病理学和皮肤学等[3],它可以从医疗数据中提取有效信息并对疾病进行初步诊断。

1 深度学习深度学习是一种使用多层复杂结构或由多重非线性变换构成的多个处理层进行数据处理的方法[1, 4],它通过组合低层次特征形成更抽象的结构化高层表示(属性类别或特征),发现数据的分布式特征表示,并展示强大的从少数样本集中学习数据本质特征的能力。

如今,深度学习技术在疾病诊断领域取得了突破性进展,其目的在于建立模型模拟人脑的神经连接结构,在处理实际问题时,使用多层复杂结构或由多重非线性变换构成的多个处理层进行数据处理[5]。利用深度学习技术得到的网络结构就叫做深度神经网络(deep neural network,DNN),DNN具有多个有效的典型模型[1],包括卷积神经网络(convolutional neural network,CNN)、循环神经网络(recurrent neural network,RNN)、自动编码器(auto-encoder,AE)、深度信念网络(deep belief network,DBN)、生成对抗网络(generative adversarial network,GAN)、深度强化学习(deep reinforcement learning,DRL)等,其中CNN、RNN、AE、DBN等在疾病诊断中已取得突破性进展。

1.1 CNN1962年Hubel和Wiesel[6]通过对猫脑视觉皮质细胞的研究,提出了感受野(receptive field)概念。1988年,Fukushima[7]首次基于感受野概念提出了神经认知机(neocognitron)模型,可以看作CNN的第1个实现网络,但受限于当时训练网络的计算机硬件,神经认知机模型并未广泛应用于各个领域。近年来随着计算机硬件的不断改进,CNN才逐渐成功应用于各领域,特别是图像领域。

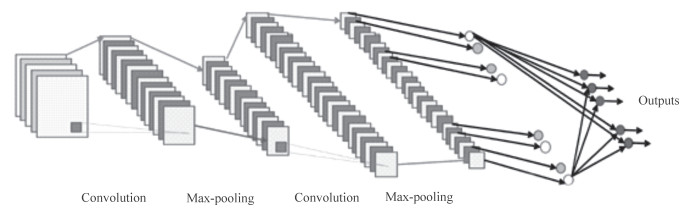

CNN主要包含3种网络层:卷积层、池化层和全连接层。图 1为CNN的简要构架图,可见其中含有2个卷积层、2个最大池化层、1个全连接层[4]。

CNN的关键元素在于多层堆栈、局部连接、权值共享和池化。多层堆栈就是将单层的卷积层进行堆叠,将前1层的输出当作后一层的输入,这样便生成了CNN。CNN中层与层之间的连接不是全连接,而是局部连接,同时加上权值共享和池化操作,降低了模型的复杂程度,也减少了参数的数量。

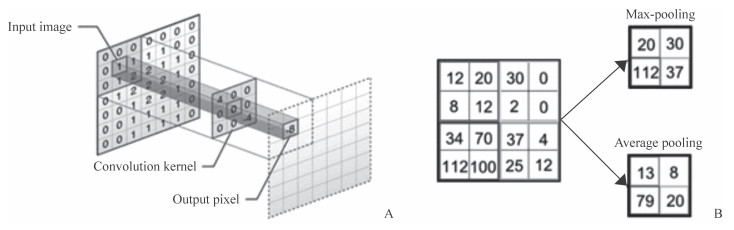

如图 2A所示,当采用全连接和局部连接同时对7×7像素的图像进行处理,且假设输出含有7×7=49个隐层单元时。对于全连接来说,每个隐层单元都连接图像上的每个像素点,这样便有7×7×49=2 401个连接,即2 401个权值参数。而当使用局部连接时,每个输出节点与上层节点同位置附件3×3的窗口连接,那么49个隐层单元就只有49×3×3=441个权值参数,其权值参数还不到原来的20%。权值共享就是设置每个神经元参数相同,用同一个卷积核去卷积图像,当采用3×3的卷积核时,其意义就是使用这个唯一卷积核对应于局部连接中的每一个窗口,这样卷积过程只含有3×3=9个权值个数,可进一步减少权值参数,防止模型过拟合。

|

图 2 卷积神经网络中卷积和池化采样方法[9] Fig 2 Convolution and pooling sampling methods in convolutional neural network[9] A: Convolution; B: Max-pooling and average-pooling |

池化是在特征图上独立操作的,主要包含最大池化和均值池化。当进行最大池化时,利用已定义且小于特征图大小的池化窗口,采用的池化窗口平移步长 > 1(≤池化窗口大小),以此计算池化窗口范围内的最大值,并将其输出到下一阶段;均值池化则是将最大值替换为池化窗口范围内所有像素值的均值[8]。如图 2B所示,特征图大小为4×4,池化窗口为2×2,池化窗口平移步长为2,那么可通过池化操作得到2×2的特征图。通过降低特征图的分辨率获得具有空间不变性的特征,降低了下一层待处理的数据量,从而间接降低了参数数量,防止模型过拟合。

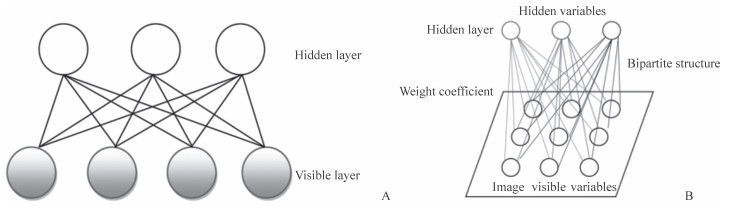

1.2 受限玻尔兹曼机(restricted Boltzmann machine,RBM)RBM是Hinton和Sejnowski在1986年提出的一种根植于统计力学的随机生成式神经网络(generative stochastic neural network)[9]。该网络中的神经元是随机神经元,其输出只有两种状态(未激活和激活),通过概率法来决定状态的取值。该网络具有1个可见层和1个隐层,层内无连接,如图 3A所示。此外,Roux和Bengio[10]从理论上证明,只要隐单元足够多,RBM可以表示任意的离散分布,图 3B描述了RBM应用于图像处理中的降维或特征提取。目前,RBM已被广泛应用于机器学习,如分类、降维、高维时间序列建模、回归、协同过滤和图像特征提取等。

|

图 3 受限玻尔兹曼机基本结构 Fig 3 Basic structure of restricted Boltzmann machine A: Network structure of Boltzmann machine; B: Application of Boltzmann machine in dimensionality reduction or feature extraction in image processing |

1.3 DBN

2006年Hinton等[11]提出了DBN,它可以解释为贝叶斯概率生成模型,通过训练其神经元间的权重,可以使整个神经网络按照最大概率生成训练数据。DBN既可以用于识别特征、分类数据,也可以用来生成数据。

DBN由多层随机隐变量组成,可分为两部分,上面的两层具有无向对称连接,下面的层得到来自上一层自顶向下的有向连接,最底层单元的状态为可见输入数据向量。DBN由若干结构单元堆栈组成,结构单元一般为RBM。其训练过程是使用非监督贪婪逐层法预训练获得权值,首先充分训练第1个RBM,然后固定第1个RBM的权重和偏移量,使用其隐性神经元的状态作为第2个RBM的输入向量,充分训练第2个RBM后,将其堆叠在第1个RBM的上方,重复上述步骤训练至顶层,将标签神经元添加至顶层,对于每一个训练的数据,相应的标签神经元被打开设为1,而其他则被关闭设为0。

1.4 RNNRNN是一种专门用于语音、书写等有关时态数据的人工神经网络,其中神经单元的连接形成一个单向循环[12],即RNN创建了一个网络的内部状态,使之能显示动态的时间行为。与具有前馈网络结构的典型神经网络不同,RNN可以利用网络的时间记忆,在自然语言处理、手势识别、语音识别和生成任务等方面显著提升性能。

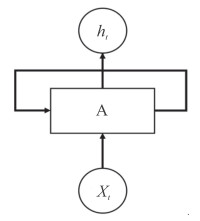

RNN的网络结构如图 4所示,在块A上连接着输入X和输出h,其中有1个循环允许这一时刻的信息传递到网络的下一时刻。目前,RNN和CNN的结合使得深度学习技术在疾病诊断方面更方便快速。

|

图 4 循环神经网络的基本结构 Fig 4 Basic structure of recurrent neural network Block A is connected with input X and output h |

2 深度学习与疾病诊断

近年来,得益于硬件设施、互联网、大数据的快速发展,人工智能技术的应用呈现爆发式增长[13]。深度学习技术在疾病诊断中的应用也达到前所未有的高度和规模。目前,深度学习技术在疾病诊断中的应用主要集中于病变检测(lesion detection)、图像分割和形状建模(segmentation and shape modeling)、疾病预测等[14]。

2.1 肺癌肺癌是发病率和死亡率增长最快、对人群健康和生命威胁最大的恶性肿瘤之一,其早期诊断和治疗至关重要。深度学习技术在肺癌的早期诊断中已取得很大的进展。

基于深度学习技术辅助诊断肺癌主要是对肺部的影像数据进行处理分析,包括医学影像数据预处理、肺实质分割、肺节点检测与分割,以及病变辅助诊断4个步骤。Sun等[15]于2016年利用肺部图像数据库联盟(Lung Image Database Consortium,LIDC)数据库中的数据测试了深度学习算法诊断肺癌的可行性;其中测试使用的数据是根据放射科医师提供的标记进行分割并通过采样、旋转等扩增的,获得了174 414个样本,每个样本都是52×52像素大小,且对应1个标签。他们设计并实现了CNN、DBN和堆叠去噪自编码(stacked denoising autoencoder,SDAE)3种深度学习算法,利用这3种算法对肺癌数据进行区域检测,然后在此基础上利用支持向量机算法对人工提取的28个特征进行逻辑分类,CNN、DBN和SDAE的分类精度分别为0.787 6、0.811 9和0.792 9,均超过了传统计算机辅助诊断系统的性能。Anthimopoulos等[16]致力于从胸部CT扫描二维图像中发现间质性肺部疾病的检测模式。他们使用19个公共数据集训练了1个CNN,然后将32×32像素大小的补丁划分为7类中的1类,相比于之前使用的人工提取方法,该CNN报告的准确性更为出色。Coudray等[17]于2017年利用从癌症基因图谱(The Cancer Genome Atlas,TCGA)中获得的肺细胞组织病理学图像训练了1个CNN,该网络能准确地将肺细胞组织学病理图像分类为腺癌、鳞状细胞癌和正常的肺组织;此模型预测结果的曲线下面积(area under curve,AUC)达到了0.97,略优于人类病理学专家。此外,Coudray等[18]还训练了神经网络来预测肺癌、腺癌中10个常见的突变基因,其预测突变基因模型的准确率为0.733~0.856。为了准确描述肿瘤并提出恰当的治疗方法,他们进一步利用深度学习技术对肺癌组织病理图像进行分类,并预测了频繁突变基因的突变状态,通过TCGA获得超过1 600张肺组织病理学图像,并将图像分为训练集、验证集和测试集,然后根据人工标注将图像分割采样为512×512像素大小的图像并对Inception_v3模型进行训练。经过训练,模型能区分癌症区域和正常区域,且一旦癌症区域确定,模型能自动识别腺癌和鳞状细胞癌,预测肺腺癌中最频繁突变基因的突变状态;最终模型区分肿瘤切片和正常切片的AUC高达0.99,识别腺癌与鳞状细胞癌的AUC达到0.95,预测丝氨酸-苏氨酸蛋白激酶11(serine-threonine kinase 11,STK11)和表皮生长因子受体(epithelial growth factor receptor,EGFR)突变基因的AUC分别为0.82和0.86,表明这两个基因的突变可能具有特定的宏观特征,亦可以通过训练CNN来识别这些特征。

2.2 乳腺癌乳腺癌是世界上死亡率较高的癌症之一,特别是针对女性,其早期诊断可大大增加治疗成功率。因此,有必要对其组织学图像进行分析。在诊断过程中,专家通过全幻灯片图像和显微镜图像评估整体和局部乳腺组织,大量的数据和图像的复杂性使得该任务耗时长,亟需发展自动检测和诊断工具。近期,很多学者应用深度学习算法在乳腺癌的诊断上取得了不错的成果。

X线乳腺密度是乳腺癌发生风险的预测标志之一,放射科医师一般使用4个定性的乳腺影像和报告数据系统(breast imaging and reporting data system,BI-RADS)乳腺密度类别来评估乳腺密度,但准确区分BI-RADS乳腺密度类别十分困难。Mohamed等[19]基于其所在机构收集的乳腺X线图像构建并训练了1个CNN模型,用于准确快速地对乳腺密度进行分类,从而明确乳腺癌的发生风险,最终该模型分类的AUC达到0.988 2。2016年和2017年举办的CAMELYON系列挑战赛致力于评估全幻灯图像中对乳腺癌转移的自动检测和分类的新方法和现有算法。利用举办方提供的数据,Wang等[20]构造并评估了GoogLeNet、AlexNet、VGG16和FaceNet 4个较为主流的深度学习模型检测和分类乳腺癌转移的性能,使用测试图像对训练好的模型进行检测,发现最终模型的AUC均达到了0.995,表明应用深度学习技术可显著提高病理诊断的准确性。在2018年国际图像分析与识别会议(International Conference on Image Analysis and Recognition,ICIAR)举办的BACH(ICIAR 2018 Grand Challenge on Breast Cancer Histology images)挑战赛上,基于大赛官方提供的400张荧光图像(正常组织、良性肿瘤、原位癌和浸润癌图片各100张),Golatkar等[21]将Inception-v3模型放入CNN中对乳腺癌进行了分类测评,以评估深度学习代替人工检测乳腺癌的潜力,在4个等级(正常、良性肿瘤、原发癌、浸润癌)的分类中,深度学习算法的精度达到了0.85,在2个等级(非癌症和癌症)的分类中,其精度达到了0.93,且准确性均较为出色。

2.3 糖尿病视网膜病变糖尿病视网膜病变是一种主要的致盲疾病,影响有20多年糖尿病史的绝大部分患者。研究表明适当的预防和治疗可有效降低糖尿病视网膜病变的发生率[22]。对于年轻患者而言,尽早发现病变并积极治疗十分必要。

Gargeya等[23]采用深度学习方法对从糖尿病患者中获得的7 137张公开的眼底图片进行了训练分析,以检测有无糖尿病视网膜病变,发现该深度学习模型检测的AUC可达0.97,灵敏度和特异度分别为94%和98%;为了测试模型的鲁棒性,该研究团队又在Messidor-2和E-Ophtha公共数据库中进行了识别预测,发现该模型的AUC分别为0.94和0.95,且准确率均较高。翁铭等[24]研究并评价了深度学习方法诊断糖尿病视网膜病变的可行性。他们从2017年1月至7月共招募了186例糖尿病患者(372张图片),对收集的数据进行人工标记,数据包括42张正常图片、330张不正常图片(62张轻度非增生性糖尿病视网膜病变图片、55张中度非增生性糖尿病视网膜病变图片、155张重度非增生性糖尿病视网膜病变图片、58张增生性糖尿病视网膜病变图片),最终深度学习模型诊断的灵敏度和特异度分别为89%和91%,明显优于人类专家。

2.4 阿尔茨海默病(Alzheimer disease,AD)AD是一种起病隐匿的进行性发展的神经系统退行性疾病,常见临床症状为患者在晚年陷入痴呆状态。由于AD的护理费用与日俱增,早期精准诊断十分重要,深度学习方法为AD的诊断研究做出了巨大贡献。

早期AD诊断是基于人工提取的脑图像特征进行分类。这些特征要求必须精确获取大脑的主要AD相关变异结构,如脑体积、海马状、心室大小和皮质厚度等;其获取方式主要为医学成像工具,如结构性磁共振成像(structural magnetic resonance imaging,sMRI)、功能性磁共振成像(functional magnetic resonance imaging,fMRI)和正电子发射断层成像(positron emission tomography,PET)。Hosseini-Asl等[25]提出了1种三维卷积神经网络,通过三维计算机辅助工程(3D computer-aided engineering,3D-CAE)学习并自动提取识别AD特征,获取由AD引发的变化,并进一步将3D-CAE预训练的CNN用于另一个数据集。通过最大池化法对每一层的特征图进行下采样,减小特征图的大小,提高模型训练效率。将构建好的模型应用于AD神经影像学(Alzheimer disease neuroimaging initiative,ADNI)数据集,该模型在AD、轻度认知功能障碍和健康对照组两两分类以及三分类评估中均可取得优异的性能,其准确率达到了94.8%~100.0%,实现了较高的诊断准确率,验证了人工智能技术在AD诊断中的可行性,促进了人工智能技术在医疗领域的发展。

此后,Sarraf和Tofighi[26]使用CNN中有名的LeNet-5框架结构通过AD的fMRI和sMRI数据进行了训练,分别获得了98.84%和96.85%的诊断准确率,这是首次将fMRI数据用于训练基于深度学习的网络模型。

2.5 其他疾病除上述疾病外,学者们也开始研究使用各种深度学习方法进行其他类型疾病的诊断,如Esteva等[27]构建了能自主检测和分类皮肤癌的深度学习模型;Han等[28]使用12种皮肤病的临床图像数据集对深度学习算法进行了评估,该算法模型对基底细胞癌、鳞状细胞癌、上皮细胞癌和黑素瘤的诊断效果较为出色;Camps等[29]于2017年提出使用腰部佩戴式测量单元和深度学习算法预测帕金森病;Tsehay等[30]提出使用基于深度学习的CNN架构识别前列腺癌。随着人工智能技术的发展和医师的积极参与,基于深度学习技术的疾病诊断技术必将飞速发展。

3 总结与展望深度学习在疾病诊断领域中已取得较好的成果,相比于传统机器学习,深度学习最大的进步就是采用自动提取特征的方法代替人工提取特征,不但能提高效率,而且自动提取更容易获得结构化的高抽象映射,使分类更准确。然而,深度学习也存在以下局限:(1)目前疾病诊断使用的深度学习构架或模型方法具有相似性,大多采用了CNN、RNN或其他常用深度学习算法,或是利用几种算法集成的方式来进行训练并诊断疾病;(2)深度学习技术在疾病诊断中的应用还停留在理论阶段,想要应用于临床还有很长的路要走,开发出能适应市场绝大多数影像设备的深度学习算法是人工智能医疗走进临床的前提;(3)深度学习技术是一种数据驱动技术,限制于对数据量的要求,该方法主要集中在发病率比较高的病症研究中,在一些罕见病症中研究较少。目前深度学习技术正处于高速发展期,在疾病诊断领域中,硬件技术的进步和医学成像技术的改进都会推动深度学习技术的不断突破,使其能更好地服务社会。

综上所述,随着科学技术的不断突破,人工智能技术有望辅助或替代人类诊断疾病,但其是作为一种协作手段减少医师大量重复和单调的任务负担和干扰,而不是取代医师。对于深度学习技术在临床上的应用,最重要的是制定合适的工作流程。随着人工智能技术的创新,在疾病诊断领域推进人工智能技术需要大量、完整的带标注的数据库,这对于训练和评估深度学习网络至关重要,同时也需要医师的积极参与。此外,为解决病症数据量少的问题,对抗生成网络和强化学习也将会在医学图像领域发挥关键作用。

| [1] |

LECUN Y, BENGIO Y, HINTON G. Deep learning[J]. Nature, 2015, 521: 436-444. DOI:10.1038/nature14539 |

| [2] |

彭传薇, 刘琛玺, 李小华. 浅谈医疗数据质量重要性及其影响[J]. 解放军医院管理杂志, 2005, 12: 467-468. DOI:10.3969/j.issn.1008-9985.2005.05.038 |

| [3] |

MILLER D D, BROWN E W. Artificial intelligence in medical practice:the question to the answer?[J]. Am J Med, 2017, 131: 129-133. |

| [4] |

ALOM M Z, TAHA T M, YAKOPCIC C, WESTBERG S, HASAN M, VAN ESESN B C, et al. The history began from AlexNet: a comprehensive survey on deep learning approaches[Z/OL]. arXiv: 1803. 01164, 2018. https://arxiv.org/ftp/arxiv/papers/1803/1803.01164.pdf.

|

| [5] |

FUKUSHIMA K, MIYAKE S. Neocognitron:a new algorithm for pattern recognition tolerant of deformations and shifts in position[J]. Pattern Recogn, 1982, 15: 455-469. DOI:10.1016/0031-3203(82)90024-3 |

| [6] |

HUBEL D H, WIESEL T N. Receptive fields, binocular interaction and functional architecture in the cat's visual cortex[J]. J Physiol, 1962, 160: 106-154. DOI:10.1113/jphysiol.1962.sp006837 |

| [7] |

FUKUSHIMA K. Neocognitron:a hierarchical neural network capable of visual pattern recognition[J]. Neural Net, 1988, 1: 119-130. |

| [8] |

GU J, WANG Z, KUEN J, MA L, SHAHROUDY A, SHUAI B, et al. Recent advances in convolutional neural networks[J/OL]. Comput Sci, 2016. doi: 10.1016/j.patcog.2017.10.013.

|

| [9] |

LEE J G, JUN S, CHO Y W, LEE H, KIM G B, SEO J B, et al. Deep learning in medical imaging:general overview[J]. Korean J Radiol, 2017, 18: 570-584. DOI:10.3348/kjr.2017.18.4.570 |

| [10] |

LE ROUX N, BENGIO Y. Representational power of restricted boltzmann machines and deep belief networks[J]. Neural Comput, 2008, 20: 1631-1649. DOI:10.1162/neco.2008.04-07-510 |

| [11] |

HINTON G E, OSINDERO S, TEH Y W. A fast learning algorithm for deep belief nets[J]. Neural Comput, 2006, 18: 1527-1554. DOI:10.1162/neco.2006.18.7.1527 |

| [12] |

CHO K, VAN MERRIENBOER B, GULCEHRE C, BAHDANAU D, BOUGARES F, SCHWENK H, et al. Learning phrase representations using RNN encoder-decoder for statistical machine translation[J/OL]. Comp Sci, 2014. doi: 10.3115/v1/D14-1179.

|

| [13] |

RUSSELL S. Artificial intelligence:the future is superintelligent[J]. Nature, 2017, 548: 520-521. DOI:10.1038/548520a |

| [14] |

MAMOSHINA P, VIEIRA A, PUTIN E, ZHAVORONKOV A. Applications of deep learning in biomedicine[J]. Mol Pharm, 2016, 13: 1445-1454. DOI:10.1021/acs.molpharmaceut.5b00982 |

| [15] |

SUN W, ZHENG B, QIAN W. Computer aided lung cancer diagnosis with deep learning algorithms[C/OL]. Medical Imaging 2016: Computer-Aided Diagnosis, 2016, 9785: 97850Z. doi: 10.1117/12.2216307.

|

| [16] |

ANTHIMOPOULOS M, CHRISTODOULIDIS S, EBNER L, CHRISTE A, MOUGIAKAKOU S. Lung pattern classification for interstitial lung diseases using a deep convolutional neural network[J]. IEEE Trans Med Imaging, 2016, 35: 1207-1216. DOI:10.1109/TMI.2016.2535865 |

| [17] |

COUDRAY N, MOREIRA A L, SAKELLAROPOULOS T, FENYÖ D, RAZAVIAN N, TSIRIGOS A. classification and mutation prediction from non-small cell lung cancer histopathology images using deep learning[J/OL]. bioRxiv, 2017. doi: 10.1101/197574.

|

| [18] |

COUDRAY N, MOREIRA A L, SAKELLAROPOULOS T, FENYÖ D, RAZAVIAN N, TSIRIGOS A. Determining EGFR and STK11 mutational status in lung adenocarcinoma histopathology images using deep learning[C/OL]//American Association for Cancer Research Annual Meeting 2018. 2018 Apr 14-18; Chicago, IL. Philadelphia (PA): AACR, 2018, 78(13 Suppl): Abstract nr 5309. doi: 10.1158/1538-7445.

|

| [19] |

MOHAMED A A, BERG W A, PENG H, LUO Y, JANKOWITZ R C, WU S. A deep learning method for classifying mammographic breast density categories[J]. Med Phys, 2017, 45: 314-321. |

| [20] |

WANG D, KHOSLA A, GARGEYA R, IRSHAD H, BECK A H. Deep learning for identifying metastatic breast cancer[Z/OL]. arXiv: 1606. 05718, 2016. https://arxiv.org/pdf/1606.05718.pdf.

|

| [21] |

GOLATKAR A, ANAND D, SETHI A. Classification of breast cancer histology using deep learning[C/OL]. arXiv: 1802. 08080, 2018. doi: 10.1007/978-3-319-93000-8_95.

|

| [22] |

DEVI M A, RAVI S, VAISHNAVI J, PUNITHA S. Classification of cervical cancer using artificial neural networks[J]. Procedia Comp Sci, 2016, 89: 465-472. DOI:10.1016/j.procs.2016.06.105 |

| [23] |

GARGEYA R, LENG T. Automated identification of diabetic retinopathy using deep learning[J]. Ophthalmology, 2017, 124: 962-969. DOI:10.1016/j.ophtha.2017.02.008 |

| [24] |

翁铭, 郑博, 吴茂念, 朱绍军, 孙元强, 刘云芳, 等. 基于深度学习的DR筛查智能诊断系统的初步研究[J]. 国际眼科杂志, 2018, 18: 568-571. DOI:10.3980/j.issn.1672-5123.2018.3.40 |

| [25] |

HOSSEINI ASL E, GHAZAL M, MAHMOUD A, ASLANTAS A, SHALABY A M, CASANOVA M F, et al. Alzheimer's disease diagnostics by a 3D deeply supervised adaptable convolutional network[J]. Front Biosci (Landmark Ed), 2016, 23: 584-596. |

| [26] |

SARRAF S, TOFIGHI G. DeepAD: Alzheimer's disease classification via deep convolutional neural networks using MRI and fMRI[J/OL]. bioRxiv, 2016. doi: 10.1101/070441.

|

| [27] |

ESTEVA A, KUPREL B, NOVOA R A, KO J, SWETTER S M, BLAU H M, et al. Corrigendum:dermatologist-level classification of skin cancer with deep neural networks[J]. Nature, 2017, 542: 115-118. DOI:10.1038/nature21056 |

| [28] |

HAN S S, KIM M S, LIM W, PARK G H, PARK I, CHANG S E. Classification of the clinical images for benign and malignant cutaneous tumors using a deep learning algorithm[J]. J Invest Dermatol, 2018, 138: 1529-1538. DOI:10.1016/j.jid.2018.01.028 |

| [29] |

CAMPS J, SAMÀ A, MARTÍN M, RODRÍGUEZ-MARTÍN D, PÉREZ-LÓPEZ C, AROSTEGUI J M M, et al. Deep learning for freezing of gait detection in Parkinson's disease patients in their homes using a waist-worn inertial measurement unit[J/OL]. Knowledge-Based Systems, 2018. doi: 10.1016/j.knosys.2017.10.017.

|

| [30] |

TSEHAY Y K, LAY N S, ROTH H R, WANG X, JIN T K, TURKBEY B I, et al. Convolutional neural network based deep-learning architecture for prostate cancer detection on multiparametric magnetic resonance images[C/OL]. Medical Imaging 2017: Computer-Aided Diagnosis, 2017. doi: 10.1117/12.2254423.

|

2018, Vol. 39

2018, Vol. 39