2. 江苏理工学院 计算机工程学院, 江苏 常州 213001

运动船舶尺寸等参数的视频检测中,与船体同步运动的水面拖纹干扰会严重影响检测精度.为此,在描述显著性检测机理的基础上,提出了抑制船尾拖纹的船舶显著性视频检测方法:根据颜色对比度直方图得到内河场景的显著图;将原图超像素分割成若干子区域,以区域空间位置关系改进直方图对比度显著性检测结果得到区域显著图;通过该区域显著图初始化GrabCut算法,迭代分割过程中加入腐蚀膨胀操作来逼近目标边缘,从而提取运动船舶.实况视频测试结果表明,该方法能有效地抑制船尾拖纹,准确地检测出内河运动船舶,准确性达到94.6%.

2. College of Computer Engineering, Jiangsu University of Technology, Jiangsu Changzhou 213001, China

In the video detection of parameters such as ship size, the synchronous movement of the stern ripples seriously affects the accuracy. A novel algorithm of ships saliency detection for inhibiting the stern ripples was proposed based on video sequence. Firstly, the algorithm utilized a histogram-based contrast (HC) method to define HC saliency map for inland waterway by using color statistics of the input image. Then, it performed super-pixel segmentation on original image to get several sub-regions and used regional spatial relationship to improve HC saliency test results, which was named as regional saliency map. Finally, by the initialization of GrabCut algorithm with the regional saliency map, the iterative process was added by erosion and dilation operations to get close to the target edge, so that the moving ship was extracted. Experimental results showed that the proposed approach could effectively restrain the stern ripple, accurately detect the ship in inland waterway, and its accuracy was up to 94.6%.

船舶自动检测成为智能视频监控系统中一个重要研究课题[1].但是,运动船舶所产生的船尾拖纹与运动船舶有着相同的运动规律,导致船尾拖纹常常会被误检测为运动船舶,给船舶自动检测精度带来很大误差.

目前,多数研究人员采用混合高斯背景减除算法[2](GMBSD, gaussian mixture background subtraction division)对内河航道中的背景进行建模,但是依然难以解决船尾拖纹这一起伏背景的干扰.Bao等[3]提出的船舶检测器算法(CFD, cabin feature detector)通过训练船舶特征创建检测器,能够检测出不同于训练样本的目标船舶,但是该检测器完全依赖于训练集大小,不具有适应性.

针对以上算法的不足,提出一种抑制船尾拖纹的船舶显著性视频检测方法,可以有效地抑制船尾拖纹对运动船舶检测的干扰,提高船舶尺寸检测精度.

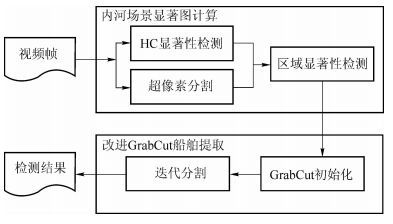

1 抑制船尾拖纹的检测方法框架图 1为抑制船尾拖纹的船舶显著性视频检测方法框架,主要包含2个模块.

|

图 1 抑制船尾拖纹的检测方法框架 |

1) 内河场景显著图计算模块:将内河船舶监控视频看作图像序列,用直方图对比度方法[4](HC, histogram-based contrast)得到初步的船舶显著图;将超像素分割算法与区域空间分布特征结合,得到内河场景区域显著图,为船舶分割的准确性提供保证.

2) 改进的GrabCut船舶提取模块:根据区域显著性检测结果,初始化GrabCut图像分割算法,避免了人工交互带来的误差;迭代运行以更新混合高斯模型的参数,使得分割效果更好.

2 内河场景显著图的计算 2.1 HC显著性检测生物视觉研究关于视觉显著性的观察认为,视觉系统对视觉信号的对比度是很敏感的.所以,采用HC算法对图像进行初步的显著性分析,该算法依据输入图像的颜色统计信息提出基于颜色直方图对比度的像素级显著图计算方法,对颜色级数进行量化和平滑处理,加快运算速度.图像I中每个像素的显著性值是用它本身的颜色与其他像素颜色的对比度来定义的

| $S({{I}_{k}})=\sum\limits_{\forall {{I}_{i}}\in I}{{}}D({{I}_{k}},{{I}_{i}})$ | (1) |

其中:D (Ik, Ii)是在Lab颜色空间下像素Ik和像素Ii欧式距离度量,S (Ik)是像素Ik的显著性值.

从式(1) 可以看出,图像中相同颜色的像素具有同样的显著性值,所以对式(1) 进行重排,使得具有相同颜色值cl的所有像素聚到一起,则每个颜色的显著性值就可以重新定义为

| $S({{I}_{k}})=S({{c}_{l}})=\sum\limits_{j=1}^{n}{{}}{{f}_{j}}D({{c}_{l}},{{c}_{j}})$ | (2) |

其中:cl是像素Ik的颜色值,n是整幅图像中所有的颜色数目,fj是颜色值为cj的像素在图像I中所占的概率.仅使用HC方法可以获得船舶的各个细节特征,但同时包括船尾拖纹等部分背景信息也得到了高亮,这对后续的船舶分割提取会产生很大干扰.

2.2 区域显著性检测为了克服2.1节HC显著性检测依然存在船尾拖纹等噪声影响和不必要的细节干扰,对其进行改进,提出一种区域级平均显著性值计算与空间分布特征结合起来的区域显著性检测方法.

首先利用超像素分割[5](SLIC, simple linear iterative clustering)将输入的内河视频帧分割成若干个超像素块区域标记为rj(j=1, 2, …, J), 那么每个超像素块内的平均显著性值S (rj)可表示为

| $\bar{S}({{r}_{j}})=\frac{1}{N({{r}_{j}})}\sum\limits_{k\in {{r}_{j}}}{{}}S({{I}_{k}})$ | (3) |

其中:N (rj)为超像素块rj里所含有的像素总数,S (Ik)为超像素块rj内像素Ik的显著性值.

进一步地,用每个超像素块和其他超像素块的空间关系权值来为此超像素块定义新的显著性值.用空间分布特征来增加超像素块的空间影响效果,较近的超像素块增大影响,较远的超像素块减小影响,则对任意的超像素块rj定义显著性值S (rj)为

| $S({{r}_{j}})={{w}_{s}}({{r}_{j}})\sum\limits_{{{r}_{j}}\ne {{r}_{i}}}{{}}{{e}^{\frac{{{D}_{s}}\left( {{r}_{j}},{{r}_{i}} \right)}{-{{\sigma }^{2}}_{s}}}}\bar{S}({{r}_{j}})$ | (4) |

其中:Ds(rj, ri)是超像素块rj和ri的空间距离,该空间距离定义为两个区域重心的欧氏距离;ws(rj)是超像素块rj的权值类似于中心偏移量,定义为

| ${{w}_{s}}({{r}_{j}})={{e}^{9d_{k}^{2}}}$ | (5) |

其中:dk为超像素块rj中所有像素与视频帧中心的平均距离,超像素块rj邻近视频帧的中心,ws(rj)的值较大;rj为边界区域,离视频帧中心较远,ws(rj)的值就较小.σs2决定空间关系权值的强度.笔者所提的区域显著性检测方法同时考虑了内河视频帧的颜色特征和区域空间关系,较好地体现了内河的船舶属性.

3 改进的GrabCut船舶提取 3.1 GrabCut初始化传统的GrabCut算法[6]是一种交互式的图像分割方法,它可以得到全局最优解,能有效地分割前景与背景.然而,GrabCut的初始化需要人工标出兴趣域矩形框,当用户定义了不准确的兴趣域时,分割结果的精确度也不能保证.

为了解决这个问题,提出一种改进的GrabCut船舶提取方法,对2.2节的区域显著性检测结果,用固定阈值T二值化后的显著图来自动提取前景和背景之间的框架.视频帧内所有像素的显著性值大于T,则该最大连接区域被认为是初始候选区域,也就是前景船舶所在的可能区域.该候选区域标记为三元图中的未知区域,而其他区域就定义为背景.

3.2 迭代分割在RGB色彩空间,用K维的混合高斯建立彩色图像数据模型.为了方便处理,创建吉布斯能量函数:

| $E\left( \alpha ,k,\theta ,z \right)=U\left( \alpha ,k,\theta ,z \right)+V\left( \alpha ,z \right)$ | (6) |

其中:α表示不透明度,α=0为背景,1为前景;θ为图像前景和背景的灰度直方图.式(6) 主要受变量k影响.引入彩色数据模型后,混合高斯的参数模型为

| $\begin{align} & \quad \quad \theta =\{w\left( \alpha ,k \right),\mu \left( \alpha ,k \right), \\ & \sum \left( \alpha ,k \right),\alpha =1,2;k=1,2,3\cdot \cdot \cdot ,K\} \\ \end{align}$ | (7) |

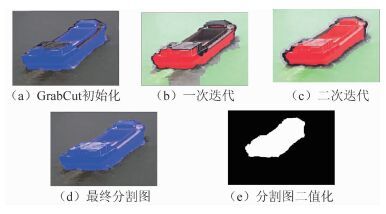

其中:w (α, k)为每个高斯分量的混合权值;μ(α, k)为每个高斯模型的均值;∑(α, k)为3×3的协方差矩阵.该参数模型迭代运行,在每次迭代后,对当前的分割结果进行形态学操作得到一个新的三元图,用作下一次迭代的初始状态, 直到迭代过程收敛.膨胀后落在外面的区域设置为背景,腐蚀后包含在里面的区域设置为前景,其余为三元图中的未知区域.如图 2所示,在图 2(a)和2(d)的分割图中,蓝色代表前景船舶,灰色代表背景.在图 2(b)和2(c)的三元图中,红色代表前景,绿色代表背景,原图颜色代表未知区域.

|

图 2 改进的GrabCut分割提取船舶区域 |

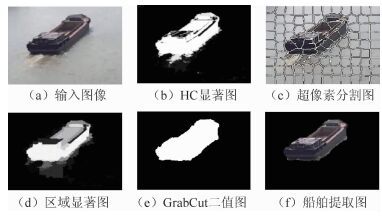

实验所采用的内河视频集取自江苏省地方海事局的监控视频,其中,视频帧大小是400×300,25帧/s.在硬件四核酷睿i7 CPU,4G内存,软件环境为Visual Studio 2013的计算机上进行实验.图 3所示为本实验各步骤效果图,可见,HC显著图 3(b)中运动船舶的船尾拖纹噪声明显地被高亮,误检测为船体,而笔者所提的区域显著性检测方法,能有效地弱化船尾拖纹的显著性,突出船舶目标.如超像素分割图 3(c)和区域显著图 3(d)中船尾的灰色区域.接着,用固定阈值二值化区域显著图作为GrabCut算法的初始状态,迭代分割改善每一步分割效果得到图 3(e).最后,把图 3(a)与图 3(e)进行与运算,提取前景船舶目标, 如图 3(f)所示.

|

图 3 文中方法各步骤效果图 |

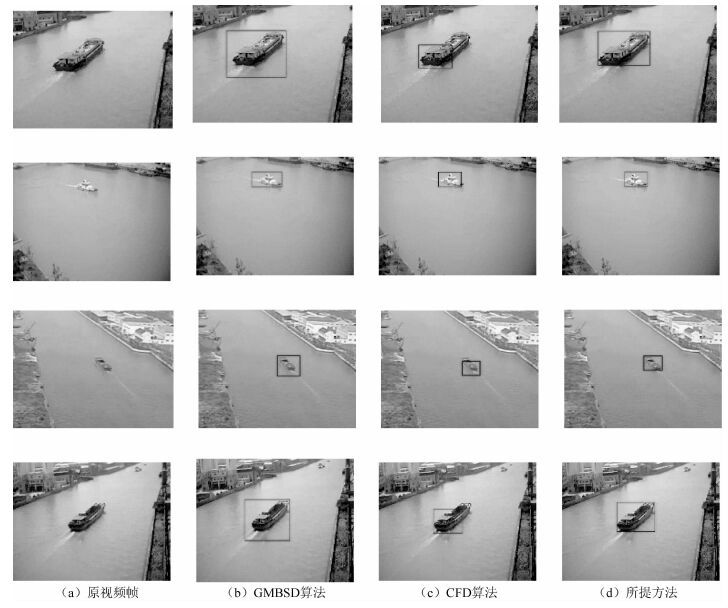

为了验证所提方法的实际应用效果,分别选取另外2种常用算法进行对比试验,它们分别是GMBSD算法和CFD算法.图 4直观地给出了3种算法在内河视频集上的船舶检测结果.测试表明,GMBSD算法误将背景中船尾起伏不定的水浪拖纹当成前景运动船舶的一部分,使得检测出来的船舶尺寸偏大.CFD算法产生了过分割现象,导致船舶的部分前景被误分割到背景中,只能检测出船舱部分,特别地,对于体积很小的船舶会产生漏检现象.而所提方法综合考虑了颜色信息和空间信息,减少了对船舶细节的描述,增强了对船舶高层特征的应用,有效地消除船尾拖纹和过分割的影响,具备较好的鲁棒性.

|

图 4 内河船舶检测效果 |

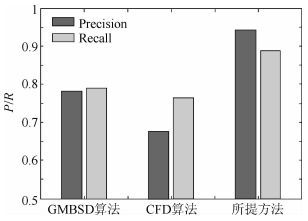

为了进一步地量化算法的性能,采用准确率(Precision)和召回率(Recall)作为量化指标,定义为

| $P=\frac{C}{N}\times 100\%$ | (8) |

| $R=\frac{C}{M}\times 100\%$ | (9) |

其中:M为实际运动船舶总数,N为算法检测到的运动船舶数量,C为算法正确检测的运动船舶数量.

选取超像素块个数N、σs2和T参数不同的取值状态对所提方法的性能进行分析,如表 1所示.经多次测试,在N=200,σ2=0.4,T=85的条件下,船舶检测的准确率和召回率最高.

|

|

表 1 不同参数组合下内河船舶检测性能比较 |

以P/R为纵轴,绘制出3种算法在内河视频序列中的P-R直方图,如图 6所示.可见,所提方法的P和R明显高于其他算法,具有较高的准确率和召回率.

|

图 6 不同算法性能比较 |

表 2所示为3种算法的平均执行时间.通过比较可知,所提方法经过3次迭代分割耗时大于其他两种算法,但也达到了0.453帧/s,满足工程处理要求.

|

|

表 2 各算法执行时间对比 |

为了解决内河复杂环境下船尾拖纹导致运动船舶检测不准确的问题,提出了一种抑制船尾拖纹的船舶显著性视频检测方法.该方法充分利用内河水域显著性低的特点,用区域显著性检测来消除船尾拖纹对运动船舶检测的影响,同时,改进传统GrabCut算法,用区域显著图初始化GrabCut算法,使得分割结果更加精准.测试表明,所提方法能够在不同的内河场景下准确地检测出运动船舶,准确性达到94.6%.

| [1] | Teng Fei, Liu Qing. Multi-scale ship tracking via random projections[J]. Signal, Image and Video Processing, 2014, 8(6): 1069–1076. doi: 10.1007/s11760-014-0629-4 |

| [2] | Lv Fuqiang, Wang Hui, Liu Hong. Traffic flow background detection algorithm based on improved gaussian mixture model[J]. Journal of Shanghai Jiaotong University, 2012, 46(12): 1920–1925. |

| [3] | Bao Xinfeng, Zinger S, Wijnhoven R, et al. Ship detection in port surveillance based on context and motion saliency analysis[C]//Proc SPIE 8663, Video Surveillance and Transportation Imaging Applications. 2013: doi:10.1117/12.2000452. |

| [4] | Cheng Mingming, Mitra N J, Huang Xiaolei, et al. Global contrast based salient region detection[C]//IEEE Transactions on Pattern Analysis and Machine Intelligence (IEEE TPAMI), 2015: 569-582. |

| [5] | Achanta R, Shaji A, Smith K, et al. SLIC superpixels compared to state-of-the-art superpixel methods[J]. IEEE Transactions on, Pattern Analysis and Machine Intelligence, 2012, 34(11): 2274–2282. doi: 10.1109/TPAMI.2012.120 |

| [6] | Rother C, Kolmogorov V, Blake A. "Grabcut"—Interactive foreground extraction using iterated graph cuts[J]. ACM Transactions on Graphics, 2004, 23(3): 309–314. doi: 10.1145/1015706 |