针对鲁棒语音识别中的声效模式检测问题,提出了一种分级检测方法.首先使用整体谱特征训练高斯混合模型来判定语音信号是否耳语.对于非耳语的语音信号,通过声学界标点检测来获取信号中的元音段,然后通过元音模板匹配来确定语音信号具体的声效模式.在863-test测试集上进行的声效检测实验结果显示,除耳语识别精度略有下降外,其他4种声效模式的识别精度均有大幅度的提高.实验结果表明了将语音信号整体特征与局部元音特征相结合在声效检测中的有效性.

A two-stage detection method was proposed for the identification of vocal effort modes in robust speech recognition. Firstly, whisper identification of speech signal is performed by using Gaussian mixture model(GMMs) which are trained by global spectrum features. Secondly, vowels are acquired based on landmark detection for the speech signal which does not belong to the whisper mode, and the vocal effort mode of the speech signal is determined by vowel template matching. Experiments conducted on 863-test show that, accompanied by a slight decline for whisper mode, the significant improvement of recognition accuracy for the remaining four vocal effort modes can be achieved.

声效(VE,vocal effort)的检测主要是在发现蕴含声音效果量级的显著性信息的声学参数的基础上进行的.目前声效检测所用特征主要为描述整体声学特性变化趋势的整体特征,如用耳语检测常用的低频带高能量语音段和低能量语音段的能量均值比[1]、基于熵的谱特征[2]、波形能量和波形周期相关特征[3],以及全部声效模式检测用的频谱倾斜、声强级、语句时长和帧能量分布等特征[4].但整体特征对于发音方式相近的声效模式辨识度较低,并不能提供有效的区分性信息.如果利用整体谱特征来检测所有声效模式,效果并不理想[5].

为了进一步提高声效模式特别是轻声、正常、大声、高喊这4种声效模式的检测精度,笔者提出了一种将整体特征与元音声效特征相结合的分级检测方法.该方法同时利用语句整体声学特性和元音声学特性蕴含的显著性信息,克服各自的缺陷,从而对全部声效模式达到良好的辨识能力.

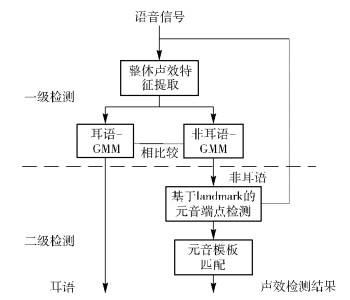

1 系统模型所提方案的示意图如图 1所示,包含2级识别过程.

|

图 1 声效分级识别的算法示意图 |

第1级识别的目的是判断当前语音信号是否为耳语音,所用特征为整体谱特征,具体为Yang等[6]提出的声强级、帧能量均值、频谱倾斜等谱参数.通过建立2个高斯混合模型(GMM,Gaussian mixture model)来实现耳语的识别,1个GMM对应耳语模式,另一个则对应其他声效模式.

通过第1级的识别,当前语音信号如果被判定为耳语音,则该结果为最终的识别结果;如果为非耳语音,则需要2次识别,从而确定该语音信号从属于剩下4种声效模式中的哪一种.

在2级识别中,笔者所提方案使用基于声学界标点的元音端点检测算法获取语音信号中的元音段,然后采取模板匹配的方法来确定语音信号的声效模式.

2 基于元音模板匹配的声效检测 2.1 问题描述蕴含语音信息整体特性的整体谱特征对发音方式相近的声效模式之间辨识度较低,因此可考虑语音信号内的局部特征.一个可行的方法是从语音信号中获取蕴含声效模式显著性信息的局部语音段,将这些语音段作为标识各个声效模式的模板.

对于选出的语音段模板有2个要求:一是必须在语音中频繁出现,只有这样不同的语音信号才都能利用该模板进行声效检测;二是在不同声效模式下语音段的声学特征有较为明显的变化,也就是能提供声效模式的区分性信息.

从音素的角度,语音段可分为元音段、辅音段和静音段,其中静音段基本不会蕴含声效模式相关信息,只需要从元音段和辅音段中找到符合要求的声效模板.为此,这里分析了元音和辅音在不同声效模式下的语谱变化.为了描述语谱的变化程度,定义了一个基于欧氏距离的谱距离计算公式为

| ${D_c} = \sqrt {\sum\limits_{i = 1}^N {{{\left( {c_p^{{\text{VE}}\left( 1 \right)}\left( i \right) - c_p^{{\text{VE}}\left( 2 \right)}\left( i \right)} \right)}^2}} } $ | (1) |

式(1)计算同一音素p分别在2种声效模式VE(1)、VE(2)下发音时,产生的2个语音信号的谱距离Dc. cpVE(j)(i)为音素p在声效模式VE(j)下对应的语音信号的谱特征序列求均值后形成的向量,该向量共包含N个参数,cpVE(j)(i)为该向量的第i个参数.对于某一个音素p,先利用式(1)计算其在5种声效模式下任意2种声效模式的谱距离,然后把谱距离相加后求均值,而该均值描述了p在不同声效模式下的语谱变化程度.

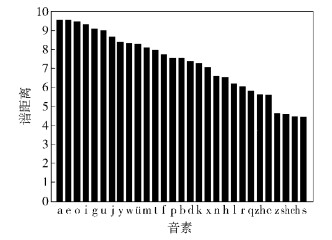

图 2显示了所有音素在5种声效模式下的谱距离均值(按降序排序),这里所用的谱特征为梅尔频率倒谱系数及其1阶差分和2阶差分.与绝大部分辅音相比,元音在不同声效模式下其语谱变化更为明显,也意味着元音段蕴含了更多的声效区分性信息.个别辅音如g、j等,其语谱变化虽然也比较明显,但与元音相比其在语句中出现的频率较少,不能保证在所有待检测的语句中都出现.因此,笔者所提方案选择元音作为声效模板用于声效检测.

|

图 2 音素在5种声效模式下的语谱距离均值对比 |

使用元音作为模板首先要检测出语音信号中的元音.元音被检测出后会用于声效判定,因此要求必须有较低的误识率,而对检出率要求不高.为此,提出了基于声学界标点的元音段检测方法.此外,由于耳语发音时声带几乎不震动,元音的语谱表现与辅音很相似,耳语中的元音很难被检测出来.因此,在检测全部声效模式时使用整体谱特征和元音特征相结合的分级识别方法.

2.2 基于Landmark的元音端点检测从感知学的角度,人们在接收语音信号时,语音中具有特殊生理意义的时间点首先被定位,这些时间点人们称之为界标点[7].

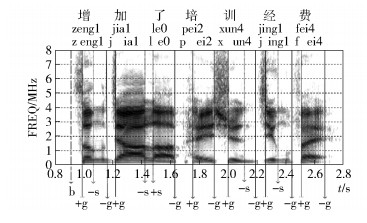

元音端点检测分为以下3个阶段:声门界标点检测、响音界标点检测和元音检测.声门界标点分为2种:描述声带开始振动时间点的+g界标点;描述声带停止振动时间点的-g界标点.响音界标点也分为2种:描述浊辅音发音结束时间点的+s界标点;描述语音信号中元音到鼻音或元音到浊辅音的转换时间点的-s界标点,如图 3所示.

|

图 3 声门界标点和响音界标点 |

声门界标点的检测参考文献[6],通过利用语音信号各个频带的能量变化来实现.

2.2.2 响音界标点检测1. 对于每一对相邻的(+g, -g)界标点之间的语音段,将所述语音段中0.8~2.0 kHz频带的1阶变化率ds大于阈值ts(6 dB)的时间点作为候选+s界标点(图 2中的1 e0之间的+s界标点),将0.8~2.0 kHz频带1阶变化率小于-ts的时间点作为候选-s界标点(图 2中的eng1中的-s界标点).

2. 如果出现2个间距小于20 ms的相邻候选+s界标点,只保留1阶变化率绝对值大的候选+s界标点,如果出现2个间距小于20 ms的相邻候选-s界标点,只保留1阶变化率绝对值大的候选-s界标点,保留下来的候选+s界标点和候选-s界标点即为响音界标点.

2.2.3 元音检测1. 对于每一对相邻的+g界标点和-g界标点,查看这2个界标点之间是否出现了+s界标点或-s界标点.

1) 如果没有出现+s界标点和-s界标点,将所述的+g界标点和-g界标点之间的语音段作为候选元音段(图 2中的ei2);

2) 如果出现了1个-s界标点,则将+g界标点和-s界标点之间的语音段作为候选元音段(图 2中的eng2中的元音e);

3) 如果顺序出现了1个-s界标点和1个+s界标点,则+g界标点和-s界标点之间的语音段(图 2中的ia1)以及+s界标点和-g界标点之间的语音段都作为候选元音段(图 2中的e0).

2. 计算候选元音段在0~0.8 kHz频带的能量均值E1和2.0~4.0 kHz频带的能量均值E2,若E1大于tE1 (40 dB)且E2大于tE2 (30 dB),则判定该候选元音段为元音.

笔者所提元音检测方法能检测出语音信号中的单元音和复元音,同时还可通过适当修改上述阈值来调整误识率和检出率.

2.3 元音模板匹配方法检测出语音信号中的元音段后,利用模板匹配的方式来判定该语音信号所属的声效模式.

由于无法确定检测出的元音段具体对应哪种元音,所以对于每一种声效模式(耳语除外),都建立1个标准元音模板库. 1个标准元音模板库包含了6个单元音模板和13个复元音模板,而元音模板是指元音在对应声效模式下的标准发音单元.

对于语音信号S中的1个元音段v,计算该元音v与每一种声效模式VE的谱距离为

| ${D_{\left( {v,{\text{VE}}} \right)}} = \mathop {\min }\limits_p \sqrt {\sum\limits_{i = 1}^N {{{\left( {{c_v}\left( i \right) - c_p^{{\text{VE}}}\left( i \right)} \right)}^2}} } $ | (2) |

其中:cv为该元音段的谱特征序列求均值后形成的向量,p为声效模式VE的标准元音模板库中某个元音模板,cpVE为p的谱特征序列求均值后形成的向量,cv(i)和cpVE(i)分别为2个向量的第i个参数.所用的谱特征为梅尔频率倒谱系数及其1阶差分和2阶差分,共36维,即N的取值为36.

然后获得该语音信号S与每一种声效模式总的谱距离为

| ${D_{\left( {S,{\text{VE}}} \right)}} = \sum\limits_v {{D_{\left( {v,{\text{VE}}} \right)}}} $ | (3) |

与S谱距离最小的声效模式被判定为该语音信号的声效模式为

| $\widetilde {VE} = \arg \mathop {\min }\limits_{{\text{VE}}} D\left( {S,{\text{VE}}} \right)$ | (4) |

其中VE∈(soft, normal, loud, shout).

3 实验仿真及结果分析 3.1 实验语料及模型实验语料库是在国家863项目汉语广播语音库的测试集上扩展得到,共1 200句话,来自6个男性说话人.每种声效模式(耳语、轻声、正常、大声、呼喊)各包含240句话,约17 min.所有语料均为安静实验室环境录制,信噪比小于50 dB,采样率为16 kHz,16 bit量化.整个语料库均分为6份,每种声效模式的240句话也均分为6份,实验过程采用6-折交叉验证,每次留1份为测试集,其余为训练集.

第1级声效检测所用的2个GMM,同样拥有16个高斯分量.第2级检测所用元音模板库中的任一元音模板,其谱特征序列的均值向量求取过程为:从其对应声效模式的训练集中通过手工切分的方式获取5个候选元音模板;分别计算5个候选元音模板的谱特征序列均值向量;对候选元音模板的5个均值向量再求均值,从而该元音模板的谱特征序列均值向量.

3.2 结果与分析为了更好地与笔者所提方案进行对比,实验参考Zhang等[5]的方法,利用整体特征来识别测试集.每一种声效模式分别训练1个拥有16个分量的GMM,所用特征具体为声强级、帧能量均值、元音频谱倾斜均值3种参数.识别结果如表 1所示.

|

|

表 1 基于整体特征的声效检测结果 |

从表 1可以看出,耳语模式的检测精度较高,达到了96.2%.声效检测错误主要出现在相邻的声效模式,也就相邻的声效模式容易混淆.这是因为耳语发音时声带基本不会震动,与其他声效模式的发音方式有较大的不同,体现在语谱上有着明显的变化,此时声强级等整体特征能提供较为充分的区分性信息,识别效果比较理想.而对于相邻声效模式(如正常和大声),它们的发音方式比较相近,反映在语谱上只有细微的变化,这时所用的整体特征已经不能充分捕捉语谱的变化情况.

接下来用笔者所提的分级检测方法来识别测试集的声效模式.为了增加笔者所提方案的可信度,元音的检测除了笔者的声学界标点方法,还采用了屈丹等[8]提出的改进美标度频谱分析法.识别结果分别如表 2和表 3所示.与表 1结果相比,由于第1级的检测同样使用整体特征,所以耳语识别精度相近,而其余4种声效模式的识别精度均有较大幅度的提高,全部语句的声效识别精度从69.6%上升到79.3%和78.4%.表明对于发音方式相近的声效模式,语音信号中的元音段比整体谱特征具有更好的辨识能力.此外,正常模式的语音其发音方式与轻声和大声并未有显著性的差异,反映在语谱上也未有明显的变化,其与轻声和大声都容易混淆.因此,相比表 1,尽管表 2和表 3中正常模式的检测精度有着较大幅度的提高(从50.5%提高到67.2%和65.7%),但与其他声效模式相比还是有较大差距.

|

|

表 2 基于声学界标点的声效分级检测结果 |

|

|

表 3 基于美标度频谱分析法的声效分级检测结果 |

分析了语音信号中元音和辅音对声效模式的辨识能力,并提出了基于声学界标点的元音端点检测方法,在此基础上进行声效的分级检测.实验结果表明,相比整体谱特征,元音声效特征在检测轻声、正常、大声、高喊这4种声效模式时能提供更多的区分性信息,笔者所提方案对全部声效模式均有较高的识别精度.

| [1] | Stanley J W, Edward J C, Richard M F. A study on the classification of whispered and normally phonated speech[C]//ICSLP. Denver:ISCA, 2002:649-652. |

| [2] | Zhang Chi, Hansen J H L. Advancements in whisper-island detection within normally phonated audio streams[C]//INTERSPEECH. Brighton:ISCA, 2009:860-863. |

| [3] | Carlin M A, Smolenski B Y, Wenndt S J. Unsupervised detection of whispered speech in the presence of normal phonation[C]//INTERSPEECH. Pittsburgh, PA:ISCA, 2006:685-688. |

| [4] | 晁浩, 宋成, 彭维平. 语音识别中声效模式的分析及检测[J]. 计算机应用研究 , 2015, 32 (8) :2292–2294. Chao Hao, Song Cheng, Peng Weiping. Analysis and detection of vocal effort for speech recognition[J]. Application Research of Computers , 2015, 32 (8) :2292–2294. |

| [5] | Zhang Chi, Hansen J H L. Analysis and classification of speech mode:whispered through shouted[C]//INTERSPEECH. Antwerp:ISCA, 2007:2289-2292. |

| [6] | Yang Zhanlei, Liu Wenju. A novel path extension framework using steady segment detection for mandarin speech recognition[C]//INTERSPEECH. Makuhari:ISCA, 2010:226-229. |

| [7] | Park C Y. Consonant landmark detection for speech recognition[D]. Cambridge:Massachusetts Institute of Technology, 2008. |

| [8] | 屈丹, 王炳锡. 语音信号元音检测的新方法[J]. 声学学报 , 2003, 28 (1) :17–20. Qu Dan, Wang Bingxi. A new method of vowel detection[J]. Acta Acustica , 2003, 28 (1) :17–20. |