2. 辽宁工程技术大学 电子与信息工程学院, 辽宁 葫芦岛 125105

为了提升多媒体处理感知能力, 提出了一种运动图像序列跨尺度插值模型.首先从用户的角度出发, 采用视觉显著性检测技术获取关注区域, 进而确定运动图像的显著区域; 而后在时间尺度改变的情况下, 利用一致敏感哈希技术实现了高质量插值帧的生成; 最后定义能量函数, 使得在分辨率尺度变化时能提升关注区域的清晰度.实验结果表明, 运动图像序列跨尺度插值模型能够获得较好的插值质量.

2. School of Electronic and Information Engineering, Liaoning Technical University, Liaoning Huludao 125105, China

In order to improve the perception ability of multimedia processing, a transcale interpolation model is proposed for the dynamic image sequences. Firstly, the visual attention regions are obtained by utilizing visual saliency detection from the viewpoint of users, so as to determine the outstanding regions of dynamic image sequences. Secondly, coherency sensitive hashing is adopted and high quality interpolation frames are generated when the time scale is changed. Finally, the energy function of the target images is defined, so the quality of visual attention regions could be improved when the resolution scale is changed. Experiments show that the proposed model achieves better interpolation results.

近年来,基于视觉感知理论的图像处理方法逐渐受到人们的关注[1].视觉显著性检测能够自动预测图像中用户感兴趣的区域, 提高多媒体服务的用户体验质量,优先分配图像分析所需的计算资源,从而被广泛应用于多媒体处理中.图像插值是多媒体处理中的核心技术之一,本质是用低分辨率图像的已知像素集合来产生未知像素集合,进而得到高质量的图像序列.然而,传统的插值方法仅仅依赖于运动图像序列本身的特性,缺乏从用户的视角来加强图像插值结果的质量.所以,需要构建基于视觉关注的插值模型以提高多媒体处理的感知能力.笔者提出基于视觉显著性检测的跨尺度插值模型,实现时间尺度和分辨率尺度改变情况下插值结果中关注区域的清晰度提升.提出的模型主要解决2个问题:运动图像序列关注区域的确定和插值过程中关注区域质量的增强.

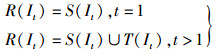

1 跨尺度插值模型提出的运动图像序列跨尺度插值模型(TIM, transcale interpolation model)如图 1所示.采用五元组描述TIM={t, wihi, wchc, F, R}.其中,t表示帧号;wihi表示初始分辨率;wchc表示改变后的分辨率;F表示插值类型,包括时间尺度改变情况下的插值操作和分辨率尺度改变情况下的插值操作;R表示运动图像序列被用户感知的显著区域,即视觉关注区域,包括空间关注区域S和时间关注区域T.对于任意帧It,描述R为

|

(1) |

|

图 1 跨尺度插值模型 |

将每帧的关注区域划分为相同大小图像块,每块定义为视觉关注块B.令视觉关注块的集合和总数分别为Bt={bt}和NR(It).给定

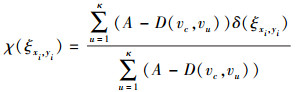

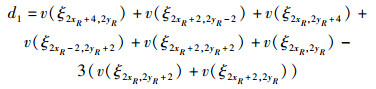

根据式(1),计算视觉关注区域需要获取运动图像的空间关注区域和时间关注区域.空间关注区域根据人类视觉系统对于视觉信号的敏感性[2]进行计算.首先采用最新的直方图颜色对比度方法计算像素的空间显著度值为

|

(2) |

其中

|

其中:ξxi, yi为It中的任意像素, χ(ξxi, yi)为ξxi, yi的空间显著度值,D(ξxi, yi, ξxj, yj)为ξxi, yi和ξxj, yj之间的颜色距离函数,np为It中的像素总数,nc为It中的可区分像素颜色总数,vc为像素ξxi, yi的颜色值,

|

(3) |

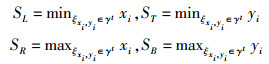

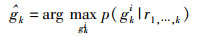

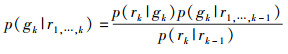

时间关注区域计算依据是注意力的连续性,根据得到的空间关注区域,采用视觉追踪技术[3]计算时间关注区域.利用第1帧到第k帧的空间关注区域集合r1, …, k={S(It)}t=1, …, k作为观察集.在贝叶斯推理框架下,通过估计后验概率函数p(gk|r1, …, k)计算T的目标状态为

|

(4) |

其中:arg是p(gk|r1, …, k)取得最大值时的

|

(5) |

|

(6) |

当时间尺度改变时,采用一致敏感哈希技术进行视觉关注块映射,得到多个映射块,从而计算出准确的插值像素值.计算过程包括视觉关注块转换、映射块获取和未知像素预测.

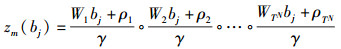

首先,每个视觉关注块使用Walsh-Hadamard技术[4]进行变换,并将映射结果存储在集合H={Wj|1≤j≤TN},其中TN=NR(It)+NR(It+1).为了加速视觉关注块映射,赋予每个转换结果相应的哈希值,如式(7) 所示.

|

(7) |

其中:bj∈Bt∪Bt+1,γ是参数,ρj是一个任意值,且符合0≤ρj < γ自由分布.

然后建立时空映射规则获取每个视觉关注块的映射块.具体来说,对于

映射规则1 如果zm(bt)=zm(bθt+1),则bt bθt+1,其中bt∈Bt,bθt+1∈Bt+1.

映射规则2 如果left(bt) bθt+1,则bt bθt+1,其中bt∈Bt,bθt+1∈Bt+1,left(bt)是bt的左邻块.

映射规则3 如果zm(bt)=zm(bθ*t),并且bθ*t bθ′t+1,则bt bθ′t+1,其中bt∈Bt,bθ*t∈Bt,bθ′t+1∈Bt+1.

映射规则4 如果bt的左上角的坐标值与bθt+1相等,则bt bθt+1,其中bt∈Bt,bθt+1∈Bt+1.

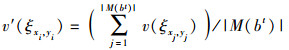

最后,通过对得到的映射块采用平滑操作来计算视觉关注区域中的插值像素值,如式(8) 所示.

|

(8) |

其中:v′(ξxi, yi)表示插值像素的预测值;|M(bt)|表示集合M(bt)中的映射块的数目,ξxj, yj∈bjt+1,并且bjt+1∈M(bt).

2.2 基于分辨率尺度的插值计算基于分辨率尺度的插值计算实现不规则图像放大,包括分区插值构建和视觉关注区域保护.前者为了提高视觉关注区域的分辨率,后者为了保护放大过程中的视觉关注区域,最终得到高质量的高分辨率图像序列.具体来说,运动图像序列的分辨率从wi×hi放大为wc×hc,满足hc>hi和wc>wi.

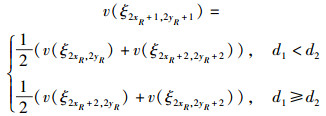

在不同区域中采用不同的插值策略来模拟用户视觉感知效果,得到缩放尺度为r的插值帧,缩放尺度需满足2r-1≤wc/wi≤2r与2r-1≤hc/hi≤2r.对于在视觉关注区域中的像素ξxR, yR,首先根据式(9) 计算像素的初始值v(ξ2xR+1, 2yR+1).

|

(9) |

其中

|

|

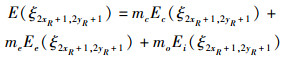

在此基础上,采用基于曲率能量插值放大方法[6]迭代修改初始值,能量判定包括曲率连续能量Ec、曲率加强能量Ee和曲率平滑能量Ei.

|

(10) |

其中mc、me和mo是能量调整系数,并满足mc+me+mo=1.而对于在一般区域中的像素,采用4个相邻像素的平均值进行快速计算.

采用分区插值构建后,得到分辨率为

|

的插值帧,需要使用最邻近插值法来计算丢失的像素,从而获得尺寸为(wi×2r)(hi×2r)的插值帧IDt.

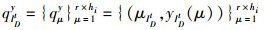

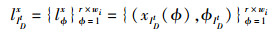

为了能完成区域能量保护,引入水平雕刻线和垂直雕刻线[7]的定义,如式(11) 和式(12) 所示.

水平雕刻线

|

(11) |

满足

垂直雕刻线

|

(12) |

满足

为了保护在视觉关注区域中的像素,重新定义能量函数为

|

(13) |

其中:H(IDt(ξx, y))为像素在IDt中的定向梯度直方图,eHoG()为任意雕刻线能量函数.

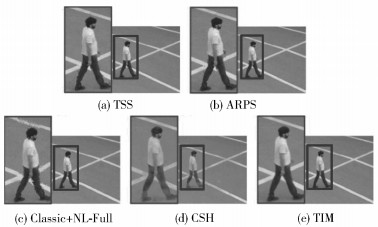

3 实验结果及分析为了验证TIM的性能,分别验证在时间尺度和分辨率尺度改变时的插值效果.实验运行环境为计算机主频3 GHz,内存3 GB,MatlabR2010b. 图 2为分别采用三步搜索(TSS, three step search)、自适应模式搜索(ARPS, adaptive rood pattern search)、光流法Classic+NL-Full、一致敏感哈希法(CSH, coherency sensitive Hashing)和TIM得到的Walk图像序列第64帧插值结果,其中视觉关注区域放大展示在图 2子图左半部分的矩形内.

|

图 2 Walk图像序列第64帧插值结果 |

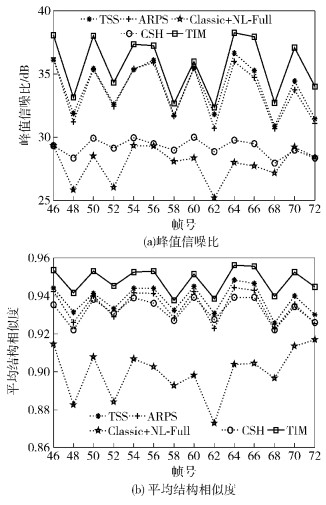

观察图 2可以看出,TSS和ARPS有锯齿现象;Classic+NL-Full有悬浮现象;CSH出现灰色区域;而笔者提出的方法得到了清晰的运动图像. 图 3所示为Walk图像序列插值帧峰值信噪比和平均结构相似度比较结果,可以看出,TIM得到最高的峰值信噪比和平均结构相似度值,说明使用TIM得到的插值帧更加接近标准帧.

|

图 3 Walk图像序列的不同算法客观评价指标值 |

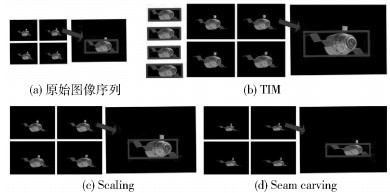

图 4所示为Space图像序列不同算法的插值结果,其中原始尺度像素为320×240,目标尺度像素为560×400.使用一般缩放法(Scaling)和雕刻线法(Seam carving)得到的实验结果如图 4(c)和图 4(d)所示,其中左半部分展示全局效果,右半部分展示具体帧的尺度放大效果. 图 4(b)是TIM的插值结果,并将视觉关注区域展示在最左面的矩形框内.可以看出,在相同尺度缩放条件下,TIM不仅能确保背景不失真,同时更加突出运动目标.

|

图 4 Space图像序列插值结果 |

图 5为Space图像序列插值结果的客观评价指标值,包括平均梯度、信息熵和图像清晰度指标.可以看出,TIM总是得到最高的客观评价指标值.综上,提出的模型在视觉效果和量化指标上都取得了很好的效果.但是,由于视觉关注区域是基于颜色对比度计算的,所以提出的模型适合于具有比较强的颜色对比度的运动图像序列.

|

图 5 Space图像序列的不同算法客观评价指标值 |

提出了基于视觉显著性检测的运动图像跨尺度插值模型.首先探测用户感知的关注区域,然后通过在不同时间尺度、分辨率尺度上的插值计算,获取高质量的插值帧,加强运动图像关注区域的清晰度,从而提高多媒体处理的感知能力.实验结果表明了提出插值模型的有效性.

| [1] |

刘勇, 魏东红, 毛京丽. 基于优化内积模型的压缩感知快速重构算法[J]. 北京邮电大学学报, 2013, 36(1): 19–22.

Liu Yong, Wei Donghong, Mao Jingli. A fast compressed sensing reconstruction algorithm based on inner product optimization[J].Journal of Beijing University of Posts and Telecommunications, 2013, 36(1): 19–22. |

| [2] | Cheng Mingming, Zhang Guoxin, Mitra N G, et al. Global contrast based salient region detection[C]//CVPR 2011. Washington: IEEE Computer Society, 2011: 409-416. |

| [3] | Jia Xu, Lu Huchuan, Yang Minghsuan, et al. Visual tracking via adaptive structural local sparse appearance model[C]//CVPR 2012. Providence: IEEE Computer Society, 2012: 1822-1829. |

| [4] | Hamood M T, Boussakta S. Fast Walsh hadamard Fourier transform algorithm[J].IEEE Trans on Signal Processing, 2011, 59(11): 5627–5631. doi: 10.1109/TSP.2011.2162836 |

| [5] | Korman S, Avidan S. Coherency sensitive hashing[C]//ICCV 2011. Barcelona: Institute of Electrical and Electronics Engineers, 2011: 1607-1614. |

| [6] | Giachetti A, Asuni N. Real time artifact free image upscaling[J].IEEE Trans on Image Processing, 2011, 20(10): 2760–2768. doi: 10.1109/TIP.2011.2136352 |

| [7] | Avidan S, Shamir A. Seam carving for content aware image resizing[J].ACM Trans on Graphics, 2007, 26(3): 1–9. doi: 10.1145/1276377 |