颅内肿瘤是一种常见的神经外科疾病,多数由颅内各组织病变引起.其中,脑膜瘤的发病率约占所有颅内肿瘤的12.5%[1];听神经瘤发病率约占颅内肿瘤的7%~12%,占桥小脑角区(Cerebellopontine Angle,CPA)肿瘤的70%~80%[2].

磁共振成像(Magnetic Resonance Imaging,MRI)因具有简单无创的特点,而被广泛用于CPA肿瘤的医学诊断和鉴别[3].医生大多依据听神经瘤会出现不同程度的听道扩大,磁共振图像中T1呈低信号、T2呈混杂信号;而脑膜瘤会出现“脑膜尾征”,磁共振图像中T1呈等信号、T2呈略高信号的特点;再结合临床经验来鉴别两类肿瘤[4].在脑部肿瘤的定位领域中,室间孔旁经常会出现脑脊液流动伪影,对不明显病灶的高信号可靠性分析造成影响.若仅靠医生的经验判断,则人工干扰成分较大,甚至容易发生误诊.马云涛等[5]通过对29例听神经瘤和7例脑膜瘤的磁共振影像特征进行分析,得出脑膜瘤影像学表现与听神经无关,脑膜瘤患者内听道正常,且脑膜瘤多发于颞骨岩部后方进内听道口,依此可与听神经瘤区分,但两者仍易发生误诊.张敏等[6]收集并探讨了80例CPA肿瘤患者的病情,发现MRI是鉴别诊断CPA肿瘤的最佳方式:脑膜瘤出现的磁共振影像特征包括幕上脑室积水、内听道扩张、弥散加权成像(Diffusion Weighted Imaging,DWI)呈高信号、周围蛛网膜下腔扩张;听神经瘤出现的磁共振影像特征包括囊变、内听道扩张等,可根据上述特征来区分两者,但准确率仍待提高.

目前,应用深度学习神经网络算法实现对两种肿瘤的定位鉴别的研究还尚少.徐楠楠等[7]发现支持向量机分类器(Support Vector Machine,SVM)能够有效提取脑部纹理特征,并提出了一种基于SVM和非下采样轮廓波变换(Nonsubsampled Contourlet,NSCT)的算法,可有效识别脑部肿瘤磁共振图像,为医生的鉴别诊断提供了良好的依据.Lavanyadevi等[8]首先用主成分分析法(Principal Component Analysis,PCA)完成磁共振图像的预处理,然后应用灰度共生矩阵(Gray-Level Co-occurrence Matrix,GLCM)提取脑部纹理特征信息,最后通过概率神经网络(Probabilistic Neural Network,PNN)实现对脑肿瘤的分类鉴别,结果表明虽然此方法能够有效鉴别脑部肿瘤,但是图像特征提取忽略了肿瘤边界信息,所以鉴别准确率仍然有待提高.Li等[9]提出了一种用于医学图像领域的自适应框架,称其为聚集卷积神经网络(Clustering Convolutional Neural Networks,CLU-CNNs),结合全卷积网络(Fully Convolutional Networks,FCN)对医学图像病灶区域进行识别检测,结果表明检测速率虽高达9.09帧/s,但是准确率仍然有提升空间.Yang等[10]应用协同训练的卷积神经网络对多参数前列腺磁共振影像进行癌变区域的检测,结果表明对于T2W检测率为86.7%,表观弥散系数(Apparent Diffusion Coefficient,ADC)检测率为91.7%.Feldman等[11]应用掩膜区域卷积神经网络(Mask Region Convolutional Neural Network,Mask RCNN),对目标进行分类、回归以及分割任务,实现了对于前列腺癌的定位检测,结果表明此方法对前列腺癌的整体检测率为81%,相比医生提高14%.

更快速的区域卷积神经网络(Faster Region Convolutional Neural Network,Faster-RCNN)是一种可以对目标进行分类及回归的检测网络,而Mask RCNN是Faster-RCNN的扩展,添加了一个额外的掩膜(Mask)分支对目标进行并行预测,可实现对目标的分类、回归和分割,因具有高速、简单直观、高准确率(高分类准确率、高实例分割准确率、高定位检测准确率)等优点,而被广泛应用于多个领域.欧攀等[12]利用实验证明,经过大量数据训练的Mask RCNN网络模型可以识别多类特征差异很大的目标物体,且可以达到较高的准确率,在目标检测领域有广阔的应用前景.张博等[13]提出了基于Mask RCNN的检测与识别方法,成功应用于触摸屏玻璃疵病的检测中,其准确率高达96.7%.但此技术在医学领域的应用还尚少.

本文首先对共1 806张(脑膜瘤606张,听神经瘤1 200张)磁共振图像进行预处理,包括数据集的图像处理、运用图像标注工具—labelme对数据集进行勾画、制作数据集标签等;然后利用改进的特征金字塔网络(Feature Pyramid Networks,FPN)算法进行网络训练,其可将网络底层到高层的特征融合起来,从而充分提取各个阶段的特征值;再将Mask RCNN主干网络分别设置为残差神经网络(Residual Neural Network,ResNet)——ResNet101、ResNet50,以及视觉几何群网络(Visual Geometry Group Network,VGG)——VGG16,并进行分类定位效果的对比;最后通过精确率(Precision)、召回率(Recall)、特异性(Specificity),以及均值平均精度(Mean Average Precision,mAP)衡量模型的有效性.综合评价上述模型对于脑膜瘤与听神经瘤的分类及定位效果,为临床医生的诊断提供更为可靠的依据.

1 实验部分 1.1 实验数据的来源研究对象为经过病例金标准验证后,并在上海市华山医院申请头部MRI扫描CPA脑膜瘤和听神经瘤患者.所有患者均签订了知情同意书,由于T1WI-SE(T1-Weighted Spin-Echo)序列能够更好地呈现病灶区域的特征,使其更易与周围邻近组织区分开,所以本文选用T1WI-SE增强扫描图像作为影像数据.图像采集设备为GE Signa HDxt 1.5T MRI扫描仪,扫描层厚为2 mm,重复时间(Repetition Time,TR)为580 ms,层间隔为2 mm,采集矩阵(Acquisition Matric)为256*256,回波时间(Echo Time,TE)为8 ms.经过数据筛选后,保留79例脑膜瘤患者图像共606张、196例听神经瘤患者图像共1 200张,训练集、验证集与测试集的比例为6:2:2.采用精确率、召回率、特异性以及mAP四个指标对模型性能进行评估.实验编译环境为Python 3.6,操作系统为ubuntu 16.04 LTS,硬件环境为Intel(R)Core(TM)i5-6500 CPU,内存为8.0 G.

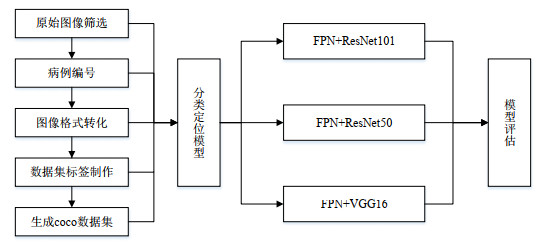

1.2 实验流程首先对原始数据集进行筛选,剔除不包含肿瘤的影像数据并对其进行病例编号;然后将DICOM图片转化为JPG格式;运用图像标准工具——labelme对病灶区域进行勾画,记录下坐标数据,生成json文件,再将json文件转化为coco数据集输入分类定位网络中;最后,实验对比了FPN+ResNet101、FPN+ResNet50、FPN+VGG16模型的分类定位效果,并使用精确率、召回率、特异性以及mAP对模型进行评估,实验流程如图 1所示.

|

图 1 本文实验流程 Fig. 1 Experimental process in this research |

第一步:对比度受限的自适应直方图均衡化(Contrast Limited Adaptive Histogram Equalization,CLAHE)算法预处理

经过CLAHE算法预处理的图片,其局部细节更加清晰、肿瘤病灶区域信息更加明显、灰度范围得到扩展、图像更加平滑且噪声减少,能够提高神经网络模型训练的准确率[14].这是因为CLAHE算法对噪声敏感程度最小,噪声在此算法中增强幅度较小,因而能增强图像对比度[15].因此本文采用了CLAHE算法对原始数据集进行处理,处理前后的磁共振图像及其灰度直方图的对比如图 2和图 3所示.

|

图 2 原始图像与预处理后图像的对比. (a)原始图像;(b) CLAHE算法预处理图像 Fig. 2 Comparison of the original image and pre-processed image. (a) Original image; (b) Image after CLAHE algorithm pre-processing |

|

图 3 原始图像与预处理图像灰度直方图的对比. (a)原始图像的灰度直方图;(b) CLAHE算法预处理后图像的灰度直方图 Fig. 3 Comparison of gray histograms of original image and pre-processed image. (a) Original image; (b) Image after CLAHE algorithm pre-processing |

第二步:制作包含肿瘤位置信息的json文件

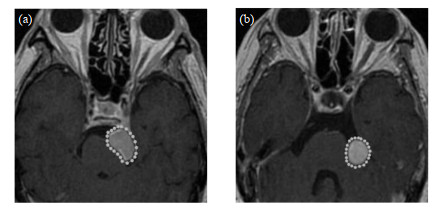

运用labelme对预处理后的数据集进行勾画,然后记脑膜瘤标签为meningioma, 听神经瘤标签为acoustic neuroma.勾画完成后,对于生成的json文件再进行格式转化,生成coco数据集.勾画结果如图 4所示.

|

图 4 数据集勾画结果. (a)脑膜瘤;(b)听神经瘤 Fig. 4 Data set sketch results. (a) Meningioma; (b) Acoustic neuroma |

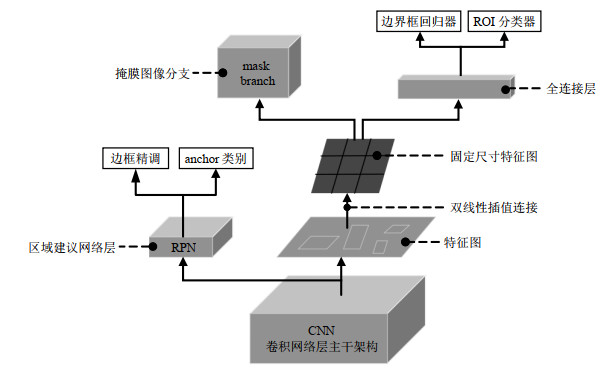

Mask RCNN模型首先提取输入图片的特征图,同时经过区域建议网络(Region Proposal Network,RPN)产生两个输出,分别是anchor类别(判断为前景或背景)以及边框精调结果(使边界框能更好地拟合目标);然后经过感兴趣区域特征聚集(Region of Interest Align,ROI Align)层,即感兴趣区域池化(ROI Pooling)的改进,从源头上解决了ROI Pooling的局限性,取消了量化操作,保留了像素值的浮点数坐标,并应用双线性插值解决了在实例分割中掩膜无法对齐的问题,进一步改善了掩膜质量.其实现步骤如下所示:第一步,遍历每个候选区域,并且保证像素边界的浮点值,不对其进行量化处理.第二步,将候选区域划分子区域,其边界也不做量化处理.第三步,每个子区域中包含4个采样点(每个采样点的位置为将子区域平均分配为4个小矩形后的中心点),用双线性内插值的方法计算出这4个点的值,然后进行最大池化操作[16];最后经过掩膜分支,以及ROI分类器与边界框回归器,产生3个输出,分别是目标的具体类别、更加精确的边框精调结果,以及掩膜图像.Mask RCNN的网络结构具体如图 5所示[17].

|

图 5 Mask RCNN的网络结构图 Fig. 5 The network structure diagram of Mask RCNN |

FPN算法不仅解决了如何处理大范围尺度变化物体的问题,而且能够使Faster-RCNN中RPN网络的召回率提高8%,coco数据集的检测性能提升2.3%[18].FPN算法包含两部分:第一部分简述为自底向上的过程,与普通的CNN网络没有区别;第二部分为自顶向下的过程,而此过程中最重要的部分即是侧向连接,通过上采样的方式不仅能够很好地利用高层的语义特征(益于分类),而且能结合底层的高分辨率细节特征(益于定位),使得高级特征与低级特征相互融合,提高了检测的准确率.FPN算法的原理如图 6所示.

|

图 6 FPN算法的结构图 Fig. 6 Structure diagram of FPN algorithm |

任之俊等[19]提出了一种改进的FPN算法,并在coco数据集上得以验证,改进后的mAP在目标预测区域与实际区域之间的重叠度,即交并比(Intersection Over Union,IOU)阈值为0.75时的提高更加显著,检测准确率提高3.9%.为了进一步提高检测准确率,本文基于FPN算法建立了脑膜瘤与听神经瘤分类定位模型,根据文献[20]得到了改进FPN的思路,添加了一个自下而上的反向侧面连接,进一步对模型进行了完善,总体框架如图 7所示.首先输入经过预处理的磁共振图像(训练集中输入脑膜瘤361张,听神经瘤723张);然后将添加反向侧面连接的FPN算法应用至主干网络ResNet101中,然后由RPN层评估目标候选框的百分数,保留最高值并输出;最后利用双线性插值进一步精调候目标选框、输出目标掩膜图像和目标类别.

|

图 7 本文提出的脑膜瘤与听神经瘤分类定位模型框架 Fig. 7 Classification and localization model framework of meningioma and acoustic neuroma proposed in this research |

此外,图 7检测网络框架中损失函数采用的为多任务损失函数,如(1)式所示:

| $ L\left( {\left\{ {{p_i}} \right\}, \left\{ {{t_i}} \right\}, \left\{ {{m_i}} \right\}} \right) = {L_{{\rm{cls}}}} + {L_{{\rm{box}}}} + {L_{{\rm{mask}}}} = \frac{1}{{{N_{{\rm{cls}}}}}}\sum\limits_i {{L_{{\rm{cls}}}}({p_i}, p_i^*) + } \lambda \frac{1}{{{N_{{\rm{box}}}}}}\sum\limits_i {p_i^*{L_{{\rm{box}}}}({t_i}, t_i^*)} + \frac{1}{{{N_{{\rm{mask}}}}}}\sum\limits_i {{L_{{\rm{mask}}}}({m_i})} $ | (1) |

Lcls代表分类损失,Lbox代表回归损失,Lmask代表掩膜损失,Ncls代表分类种类个数,Nbox代表目标框个数,Nmask 代表掩膜个数,i为小批量中anchor的一个索引,λ系数取值为1,ti 向量代表的是目标框预测的偏移量,ti*向量代表的是目标框相对于真实标签(Ground Truth,GT)的实际偏移量.pi代表的是目标预测的概率值.pi*代表若目标框内物体为正例,则值为1;目标框内物体为负例,则值为0.mi 代表的是物体被预测为目标的置信度.

分类损失计算如(2)式所示:

| $ {L_{{\rm{cls}}}}({p_i}, p_i^*) = - {\log _2}[{p_i}p_i^* + (1 - p_i^*)(1 - {p_i})] $ | (2) |

回归损失计算如(3)式所示:

| $ {L_{{\rm{box}}}}({t_i}, t_i^*) = R({t_i} - t_i^*) $ | (3) |

R是关于鲁棒的损失函数smoothL1 的计算,如(4)式所示:

| $ smoot{h_{{L_1}}}(x) = \left\{ \begin{array}{l} 0.5{x^2}, {\rm{ if\;\; }}|x| < 1\\ |x| - 0.5, {\rm{ otherwise}} \end{array} \right. $ | (4) |

网络中的掩膜分支对于每个ROI的输出为Km2(K个分辨率为m*m的二值掩膜,其中K为分类种类数目),然后对其每个像素点均利用sigmoid函数,将平均二值交叉损失熵定义为整体损失值,掩膜损失计算如(5)式所示:

| $ {L_{{\rm{mask}}}} = - [{m_i} \times {\log _2}(m_i^*) + (1 - {m_i}){\log _2}(1 - m_i^*)] $ | (5) |

mi*表示在第i个掩膜层中每个像素经过sigmoid函数后产生的输出.

2 实验结果 2.1 勾画范围扩大前与扩大后的对比结果数据集经过预处理后,在进行coco数据集制作中,我们发现目标的勾画范围对于最终输出的掩膜质量有所影响.如图 8所示,若扩大数据集的勾画范围,则测试肿瘤的定位效果更佳、肿瘤边界更清晰、病灶区域包裹更完善、目标拟合更完善.而勾画范围扩大前的数据集测试结果显示肿瘤定位区域未包裹完善、边界信息欠缺、目标框以及掩膜均未更佳地拟合目标物.

|

图 8 调整勾画范围前后的结果对比 Fig. 8 Comparison of the results before and after adjusting the outline range |

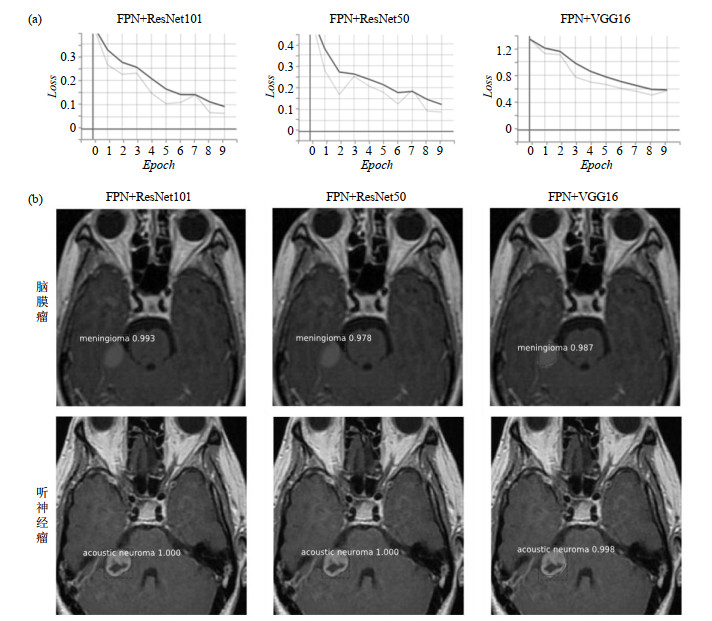

在三种不同的主干网络模型验证集的损失曲线[图 9(a)]中,训练设定为10轮,每一轮训练经过100次迭代中.ResNet101作为主干网络最为稳定,收敛效果最好;ResNet50作为主干网络,其损失曲线下降不平缓,收敛不稳定;VGG16作为主干网络,其损失曲线下降缓慢且收敛值相对于其他两种主干网络较大,收敛不佳.并且从模型对于脑膜瘤以及听神经瘤的预测结果[图 9(b)]中,也可以看出FPN+ResNet101输出的目标掩膜图像质量最佳,肿瘤边界信息清晰,定位准确,而其他两种主干网络模型输出的目标框以及掩膜均未更好地拟合目标物,包含的信息不完善.这证明应用添加了反向侧面连接的FPN算法结合ResNet101建立的脑膜瘤与听神经瘤分类定位模型能够实现对两类肿瘤的有效判别以及准确定位,从而可以为临床医生的诊断提供可靠的依据.

|

图 9 各主干网络的(a)验证集模型损失曲线和(b)输出的目标掩膜图像 Fig. 9 The (a) loss curves and (b) target masks output of different backbone networks |

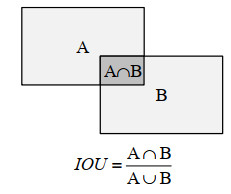

物体检测过程中会产生多个目标框,Mask RCNN中采取非极大值抑制(Non-Maximum Suppression,NMS)的方法清除多余的目标框[21].经实验效果论证,本文中将IOU设为0.5,即当0.5 < IOU < 1时,视为检测正确,保留目标框;反之为检测错误.其计算原理如图 10所示,其中A与B分别表示检测过程中产生的目标框以及原标记框.

|

图 10 IOU计算原理图 Fig. 10 IOU calculation schematic |

为了验整本文研究提出的模型有效性,将未经训练的121张脑膜瘤以及240张听神经瘤图像输入模型中进行测试(设定脑膜瘤为正样本,听神经瘤为负样本),并用精确率(Precision)、召回率(Recall)、特异性(Specificity)以及mAP对其进行评价.精确率、召回率、特异性以及mAP的计算如(6)~(9)所示:

| $ {\rm{Precision}} = \frac{{TP}}{{TP + FP}} $ | (6) |

| $ {\rm{Recall}} = \frac{{TP}}{{TP + FN}} $ | (7) |

| $ {\rm{Specificity}} = \frac{{TN}}{{TN + FP}} $ | (8) |

| $ AP = \frac{{\sum {{\rm{Precision}}} }}{{N({\rm{TotalImages)}}{}_{}}}, mAP = \frac{{\sum {AP} }}{{N({\rm{classes}})}} $ | (9) |

其中,TP代表样本为正,检测结果也为正;FP代表样本为负,检测结果为正;TN代表样本为负,检测结果也为负;FN代表样本为正,检测结果为负.AP代表一个类别的平均精度,即为测试集中所有图像对于此类别的精度之和与包含此类目标的所有图像数量的比值.mAP代表所有类别的平均精度求和与类别数量的比值.表 1为三类模型的评价指标比较.

| 表 1 三类模型评价指标对比 Table 1 Comparison of evaluation indicators of the three types of models |

由表 1数据综合得知本文提出的基于添加了反向侧面连接的FPN算法与ResNet101作为主干网络的Mask RCNN模型对脑膜瘤与听神经瘤的分类定位效果最好,性能最稳定,能有效辅助临床诊断.

3 结论与展望临床上脑膜瘤与听神经瘤的鉴别一直以来都是依靠医生人工阅片结合经验判断,但是人工干扰成分大,容易发生误诊,且定位病灶区域时可能与脑脊液运动伪影混淆.基于此,本文应用深度学习方法结合改进的FPN算法构建了一个能自动区分两类肿瘤且精确定位的Mask RCNN模型,效果显著,能较好地辅助临床医生进行诊断.

实验首先对比了数据集的勾画范围对模型的定位效果产生的影响,结果表明勾画范围扩大后能包含病灶区域中更广泛的图像像素特征信息,使定位边界清晰,掩膜质量更佳.然后对比了三类主干网络结合添加了反向侧面连接的改进FPN算法所建立的Mask RCNN分类定位模型的效果,结果表明ResNet101作为主干网络,分类定位模型的损失曲线更为稳定,收敛更佳,可达全局较优解;而且改进FPN+ResNet101分类定位模型效果最好:精确率为0.918 2、召回率为0.856 9、特异性为0.876 2、mAP为0.90.但该模型对听神经瘤的识别定位效果稍高于脑膜瘤,考虑可能是样本数据量的原因(听神经瘤图像总量约为脑膜瘤的两倍).后续研究中,若能够不断扩大样本量,完善实验的不足,则可以一定程度提高检测模型的精确率[22],使其能更好的应用至临床领域.

利益冲突 无

| [1] | NIU L, ZHOU X M, DUAN C F, et al. Differentiation researches on the meningioma subtypes by radiomics from contrast enhanced MRI, a preliminary study[J]. World Neurosurg, 2019, 126: e646-e652. DOI: 10.1016/j.wneu.2019.02.109. |

| [2] |

YE D S, XU S H, HUANG Y C, et al. MRI diagnostic value of cerebellopontine angle tumors[J].

Chinese and Foreign Medical Research, 2017, 15(1): 50-51.

叶德湫, 许淑惠, 黄永础, 等. 桥小脑角区肿瘤的MRI诊断价值[J]. 中外医学研究, 2017, 15(1): 50-51. |

| [3] |

MA Y, GUO H, WANG Q S, et al. Correlations between morphological characteristics and expression levels of specific molecular biomarkers in glioblastoma[J].

Chinese J Magn Reson, 2018, 35(1): 22-30.

马芸, 郭虹, 王秋实, 等. 基于影像的形态学特征与胶质母细胞瘤特征分子表达的相关性研究[J]. 波谱学杂志, 2018, 35(1): 22-30. |

| [4] |

ZHANG Q. CT and MRI imaging analysis of occupying lesions in the cerebellar horn region[J].

Journal of Medical Imaging, 2019, 29(6): 913-916.

张芹. 桥小脑角区占位性病变CT和MRI影像学分析[J]. 医学影像学杂志, 2019, 29(6): 913-916. |

| [5] |

MA Y T, CHEN X Y, TIAN G S, et al. MRI characteristics of space-occupying lesions in the cerebellopontine angle region[J].

Chinese Clinical Research, 2017, 30(6): 838-840.

马云涛, 陈秀艳, 田贵森, 等. 桥小脑角区占位性病变核磁共振影像学特征[J]. 中国临床研究, 2017, 30(6): 838-840. |

| [6] |

ZHANG M, ZHANG H Q. The application of MRI in the diagnosis of cerebellopontine angle tumor patients and its clinical value analysis[J].

China Medical Innovation, 2018, 15(34): 25-29.

张敏, 张海青. MRI在桥小脑角区肿瘤患者病情诊断中的应用及其临床价值分析[J]. 中国医学创新, 2018, 15(34): 25-29. |

| [7] |

XU N N, GE Y R, WANG J Y. Medical image recognition of brain MRI based on NSCT and SVM[J].

Modern Electronic Technology, 2014, 37(12): 63-66+69.

徐楠楠, 葛玉荣, 王佳奕. 基于NSCT和SVM的脑MRI医学图像识别[J]. 现代电子技术, 2014, 37(12): 63-66+69. |

| [8] | LAVANYADEVI R, MACHAKOWSALYA M, NIVETHITHA J, et al. Brain tumor classification and segmentation in MRI images using PNN[C]. IEEE International Conference on Electrical. IEEE, 2017. |

| [9] | LI Z N, DONG M H, WEN S P, et al. CLU-CNNs: Object detection for medical images[J]. Neurocomputing, 2019, 350: 53-59. DOI: 10.1016/j.neucom.2019.04.028. |

| [10] | YANG X, LIU C Y, WANG Z W, et al. Co-trained convolutional neural networks for automated detection of prostate cancer in multi-parametric MRI[J]. Med Image Anal, 2017, 42: 212-227. DOI: 10.1016/j.media.2017.08.006. |

| [11] | FELDMAN A M, DAI Z, CARVER E, et al. Utilizing a deep learning-based object detection and instance segmentation algorithm for the delineation of prostate and prostate cancer segmentation[J]. Int J Radiat Oncol, 2019, 105(1): S197-S198. |

| [12] |

OU P, LU K, ZHANG Z, et al. Object recognition and spatial localization based on Mask RCNN[J].

Computer Measurement & Control, 2019, 27(6): 172-176.

欧攀, 路奎, 张正, 等. 基于Mask RCNN的目标识别与空间定位[J]. 计算机测量与控制, 2019, 27(6): 172-176. |

| [13] |

ZHANG B, ZHOU J, WANG F, et al. Detection and recognition of touch screen glass defects based on Mask R-CNN[J].

Software Guide, 2019, 18(2): 64-67, 71.

张博, 周军, 王芳, 等. 基于Mask R-CNN的触摸屏玻璃疵病检测与识别[J]. 软件导刊, 2019, 18(2): 64-67, 71. |

| [14] |

WANG F, LU J D, SHEN G R, et al. Image segmentation of green apple based on CLAHE and open-close operation[J].

Computer Measurement and Control, 2017, 25(2): 141-145.

王帆, 吕继东, 申根荣, 等. 基于CLAHE和开闭运算的绿色苹果图像分割[J]. 计算机测量与控制, 2017, 25(2): 141-145. |

| [15] |

LI L, LI W J, WU Y Z. Underwater image enhancement algorithm based on red dark channel prior theory and CLAHE algorithm[J].

China Ship Research, 2019, 14(S1): 175-182.

李炼, 李维嘉, 吴耀中. 基于红色暗通道先验理论与CLAHE算法的水下图像增强算法[J]. 中国舰船研究, 2019, 14(S1): 175-182. |

| [16] | BAI T, PANG Y, WANG J C, et al. An optimized faster R-CNN method based on DRNet and ROI align for building detection in remote sensing images[J]. Remote Sens, 2020, 12(5): 762. DOI: 10.3390/rs12050762. |

| [17] | HE K M, GKIOXARI G, DOLLÁR P, et al. Mask R-CNN[C]. Proceedings of the IEEE international conference on computer vision. 2017: 2961-2969. |

| [18] | MALHOTR K R, DAVOUDI A, SIEGEL S, et al. Autonomous detection of disruptions in the intensive care unit using deep mask R-CNN[C]. IEEE/CVF Conference on Computer Vision & Pattern Recognition Workshops. IEEE Computer Society, 2018. |

| [19] |

REN Z J, YUN S Z, LI D W, et al. Mask R-CNN target detection method based on improved feature pyramid[J].

Laser & Optoelectronics Progress, 2019, 56(4): 174-179.

任之俊, 蔺素珍, 李大威, 等. 基于改进特征金字塔的Mask R-CNN目标检测方法[J]. 激光与光电子学进展, 2019, 56(4): 174-179. |

| [20] | CHANG S, ZHANG F, HUANG S, et al. Siamese feature pyramid network for visual tracking[C]. 2019 IEEE/CIC International Conference on Communications Workshops in China (ICCC Workshops). IEEE, 2019. |

| [21] | 黄泽桑. 基于深度学习的目标检测技术研究[D]. 北京: 北京邮电大学, 2019. |

| [22] |

WANG H Z, ZHAO D, YANG L Q, et al. An approach for training data enrichment and batch labeling in AI+MRI aided diagnosis[J].

Chinese J Magn Reson, 2018, 35(4): 50-59.

汪红志, 赵地, 杨丽琴, 等. 基于AI+MRI的影像诊断的样本增广与批量标注方法[J]. 波谱学杂志, 2018, 35(4): 50-59. |

2021, Vol. 38

2021, Vol. 38