2. 上海交通大学医学院附属上海儿童医学中心 影像诊断中心, 上海 200127

2. Diagnostic Imaging Center, Shanghai Children's Medical Center, Shanghai Jiao Tong University School of Medicine, Shanghai 200127, China

量化右心室(Right Ventricle,RV)的医学图像、评估其功能对肺动脉高压、法洛四联症等心脏疾病的诊疗及预后具有十分重要的意义[1-3].RV功能评估常常借助心动超声(Echocardiography)、计算机断层扫描(Computed Tomography,CT)、心脏磁共振(Cardiac Magnetic Resonance,CMR)以及正电子发射断层摄影(Positron Emission Tomography,PET)等医学成像技术.与其他技术相比,CMR成像技术具有无电离辐射、任意平面成像、软组织对比度高等优势,而且CMR短轴电影成像可动态记录心脏的运动周期,时空分辨率高,在临床心室功能评估中具有良好的可重复性和准确性[4, 5].

RV分割是评估RV功能的前提.由于RV心肌薄且毗邻脂肪、内部结构复杂,比如小梁肌、乳头肌等会将其分离,因此RV分割一直是分割领域的难点.传统的依据图像像素驱动和基于模型的自动RV分割技术,分割较慢且精度不够[6].多图谱和深度学习是近几年RV分割中应用较多且分割效果较好的新技术[7, 8].多图谱分割技术主要是依据专家手动分割的图谱图像,经配准和融合得到分割结果[9].深度学习通过构建多隐层的模型和海量训练数据,自动提取分类需要的低层次或者高层次特征,从而最终提升分类或预测的准确性,得到精度更高的RV分割结果[10].

本文首先介绍了CMR短轴电影图像、可用数据集及RV分割难点;然后介绍了传统的和最新的RV分割方法以及RV分割评估指标;最后对RV分割方法进行了总结与展望.

1 CMR图像 1.1 CMR短轴电影图像CMR图像一般根据美国心脏病协会(American Heart Association,AHA,http://www.heart.org/)推荐的标准心脏断层层面进行采集,主要包括标准水平长轴位、垂直长轴位和短轴位图像.其中,短轴电影图像定义为从二尖瓣水平向心尖方向、垂直标准四腔心室间隔的一系列2D图像,可以清楚地显示圆形的左心室(Left Ventricle,LV)和新月形的LV,是检测心脏功能的标准图像.CMR短轴电影图像的典型扫描参数是:层面厚度为6~8 mm,层间距为2~4 mm,8~16层以覆盖整个心室,矩阵大小为256×256,视野(Field Of View,FOV)是280×300 mm2,采集一个完整的心动周期的图像,一般包括20~28个时相,时间分辨率≤45 ms.

1.2 数据集国际医学影像计算与计算机辅助干预会议(International Conference on Medical Image Computing and Computer Assisted Intervention,MICCAI,http://www.miccai.org/)在2012年和2017年分别举办了RV分割挑战(Right Ventricle Segmentation Challenge,RVSC)和自动心脏诊断挑战(Automated Cardiac Diagnosis Challenge,ACDC).

其中,RVSC数据集主要包括(1)16名患者原始DICOM(http://www.litislab.eu/rvsc/)图像作为训练集,舒张末期(End Diastole,ED)和收缩末期(End Systole,ES)两个时相的训练集的心外膜和心内膜轮廓由有经验的放射技师分割作为分割标准,其中小梁肌和乳头肌被包括在心室血池内;(2)32名患者原始DICOM图像作为测试集,没有提供手动分割的轮廓.上述RVSC数据采集使用1.5 T MRI扫描仪,8通道相控阵专用心脏线圈和回顾性同步平衡稳态自由进动序列(Retrospectively synchronized balanced steady-state free precession sequences).扫描参数如下:脉冲重复间隔时间(TR)=50 ms,回波时间(TE)=1.7 ms,翻转角为55°,矩阵大小为256×216(或216×256),FOV是360×420 mm2,层厚为7 mm,采集8~12层连续的电影短轴切片以覆盖整个心室,20个时相的完整心动周期.患者在扫描过程中需要重复屏息,每次持续10~15 s.

ACDC数据集主要包括:(1)100名患者原始Nifti(https://www.creatis.insa-lyon.fr/Challenge/acdc/)图像作为训练集,临床专家以ED和ES时相相应的手工参考分析作为分割标准,其中小梁肌和乳头肌被包括在心室血池内;(2)另外50名患者的原始Nifti图像作为测试集,仅提供患者基本信息:身高、体重,以及ED和ES时相.ACDC数据采集使用1.5 T和3.0 T MRI扫描仪,回顾性或前瞻性平衡稳态自由进动序列.扫描参数如下:层厚为5~8 mm,层间距为5 mm,层厚与层间距加起来一般为5~10 mm,矩阵大小为256×256,FOV是300×330 mm2,一个完整心动周期包括28~40个时相.

1.3 RV分割的难点RV的解剖结构及其CMR短轴图像特点使得RV分割复杂、困难[11],主要包括以下几个方面:(1)RV结构复杂,通过肺动脉连接右心房,不易定义RV底部;(2)RV心肌薄且毗邻脂肪,部分容积效应容易引起RV边界模糊甚至缺失;(3)RV内具有随心动周期变化的乳头肌和小梁肌,很多情况下与心肌相连,甚至会将RV分成两部分.

2 传统的RV分割方法手动分割是早期RV分割采用的方法,结果准确,但耗时且主观性强,一般只分割一个病人的ED和ES两个时相的数据,大约需要15 min[6].手动分割结果现在主要作为金标准,用于评价自动分割方法的精确性.

传统的自动RV分割多是依据图像像素驱动和基于模型的方法,但对RV顶部和底部的分割效果差、分割速度过慢等缺点都限制了其在临床的应用.基于图像像素的分割方法,计算简单,但分割精确度相对较低.例如文献[12]提出基于阈值和形态学操作分割LV和RV,首先在LV腔内任意选择标记点,对图像应用幂次变换和阈值处理,得到包含LV、RV的感兴趣区域,然后对变换后的图像进行阈值处理及边缘检测,并通过凸包方法排除乳头肌,获得精确的RV心内膜轮廓.文献[13]基于时空连续性和心肌信息提出全自动分割心脏图像的方法,从LV中部分别向顶部和底部扩展,采用迭代下降阈值的区域生长方法分割LV,但分割RV时容易产生溢出.Rosado-Toro等[14]利用动态规划对四腔室图像实现RV的半自动分割,需要用户识别ED和ES时相并选取相应的标记点以辅助分割.Goshtasby等[15]提出用强度阈值确定心内膜表面的大致位置和大小,局部最大梯度幅值点用于曲线或表面拟合过程以确定心室腔的边界或表面.此算法中即使初始分割出现较大偏差时,依然可以获得较为精确的RV轮廓.文献[16]提出对图像首先进行二值化处理,然后由CMR图像序列生成重复运动图,并从中选择LV和RV.该方法基于心脏运动来补偿缺乏先验知识,其明显的优势是不依赖于训练集,但该方法不包括任何约束,因此在一些复杂的情况下可能会导致RV分割失败.文献[17]中半自动RV分割算法基于细胞自动机框架,使用并行计算技术实现,每个体素根据其信号强度相似性及与种子的距离被标记为前景或背景.该方法以粗略的RV心内膜轮廓作为种子切片,经优化后向顶部和基底切片扩散,完成RV半自动分割,其分割结果与手动分割结果高度相关,且变动性更低.文献[18]提出在ED阶段的四或五个2D切片中手动分割出RV心内膜轮廓,并将轮廓分别扩张、侵蚀形成背景和前景标记,然后沿着时间维度向前和向后传播.分水岭算法将4D体积预分割成许多小区域,并通过图割策略合并,以实现心脏图像的4D半自动分割.该方法具有较强的鲁棒性,建立背景和前景标记的过程十分稳健,结果几乎不受手动描绘的影响.

基于模型的分割方法计算相对复杂,模型构造比较困难,但分割结果较精确.文献[19]提出了一种基于统计形状模型的分割方法,首先通过主成分分析建立形状模型并总结于一张图中;然后用户输入图像中室间隔连接处的两个解剖标志,使得分割图像被精确地配准到形状模型中;最后利用图割算法分割RV.基于统计模型的RV分割方法具有很高的计算效率,可以准确获得心内膜;其主要缺点是大量的用户交互和统计模型的构造.Hautvast等[4]在离散主动轮廓模型的基础上,根据垂直剖面使用等高线环境,基于剖面匹配的能量分布来保持恒定剖面,所需的结构变化还允许在局部坐标系中执行图像处理和变形.通过在图像序列中随时间传播初始的手动分割来减少用户交互时间.文献[20]提出了一种结合主动形状模型和鲁棒点匹配技术(Robust Active Shape Models,RASM)的分割算法.RASM首先使用Canny边缘检测器提取特征点;然后搜索特征点与ASM模型点之间的对应关系完成鲁棒点匹配,同时沿着ASM的变化模式进行变形.RASM优势在于不受丢失特征点和噪声的影响.文献[21]提出采用无边缘主动轮廓模型(Active Contours Without Edges,ACWE)对LV和RV同时进行分割.ACWE引入允许自动拓扑变化的水平集框架,即将演变后的轮廓自动分裂成几个不同的区域,其中LV和RV被确定为两个最大的连通区域.该方法避免了主动轮廓模型中分割中严重依赖心室边界的问题.然而,在隔膜对比度变差和心脏异常情况下,ACWE算法往往会分割失败.文献[22]提出把ACWE算法与拓扑保持算法相结合,即使在严重的异常解剖结构中,也可以获得好的结果.Huang等[23]将基于时间的动态约束引入模型分割,以解决4D时空心脏图像中心脏定位和分割的挑战性问题.主动外观模型(Active Appearance Model,AAM)结合主动形状模型(Active Shape Model,ASM)的混合模型对心脏图像的分割也有独特优势.Mitchell等[24]提出了多级混合外观模型,认为AAM在全局外观上是最优化的,但是不能提供精确的边界位置,而ASM有很强的找到局部结构的能力.首先通过Hough变换确定LV中心点,将AAM匹配到目标图像直到收敛;然后是混合ASM/AAM收敛至精确位置;最后通过AAM对目标图像匹配、收敛,避免了局部最小值的出现.文献[25]中也使用混合模型,并将经过运动校正的短轴和长轴磁共振数据重建的两幅图像融合,在短轴切片上手动选取控制点追踪融合图像,以使得到的轮廓正确地描述心室边界.

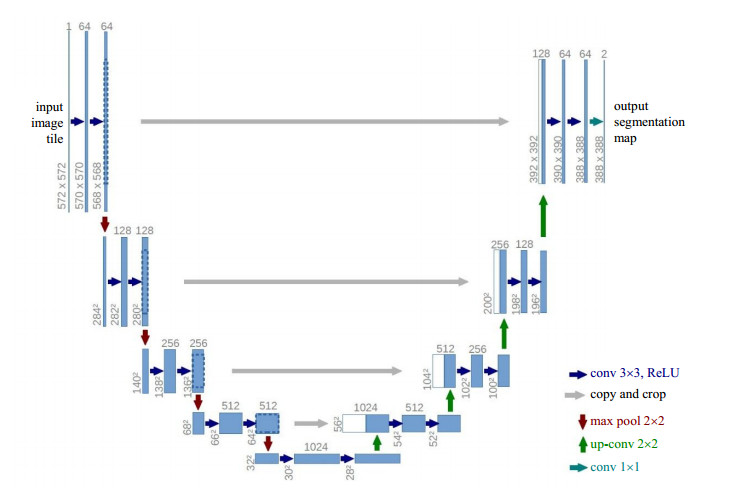

3 RV分割的新进展 3.1 多图谱分割与传统分割方法不同的是,多图谱分割是把图像分割转换为图像配准和融合,其分割精度受到图谱、配准及融合算法的影响.国内外研究中,多图谱分割多用于脑部图像分割,在RV分割中研究相对较少[26].图 1是RV多图谱分割流程图,首先依据目标图像选择用于分割的图谱集;然后用目标图像分别和图谱集图像配准,得到的变换参数应用于相应的标记图像;最后,将配准得到的粗分割结果融合为最终的分割结果.

|

图 1 RV多图谱分割流程图 Fig. 1 Flow chart of multi-atlas segmentation for RV |

图谱集包括图谱图像和标记图像,其中标记图像是由专家手动分割图谱图像得到的二值图像.传统图谱的选择是基于灰度信息或者依据主观判断,选择结构清晰、易于分割的图像.

近年来,研究发现具有相似性质(如灰度、特征等)的图谱可以提高配准的精度[26].聚类是图谱选择的主要方法.张耀楠等[27]在RV精准分割中,提出了利用仿射传播聚类算法选择图谱.传统方法一旦确定图谱的选择,在后续分割的过程就不再改动,而基于仿射传播聚类方法可以依据相似性测度因子的大小选择图谱.首先,所有的图谱图像被看作一系列数据点,通过数据点之间的吸引度和归属度传递聚类;然后,得到的聚类中心图像和目标图像经刚性配准,仿射配准和B样条配准及STAPLE(Simultaneous Truth and Performance Level Estimation)融合策略融合;最后,将变换后的标记图像与融合结果以归一化互信息(Normalized Mutual Information,NMI)为依据进行排序,用NMI最大的聚类中心进行配准分割.经多次排序分割,直到得到较精确的分割结果.与传统分割方法相比,仿射传播聚类算法避免了所有图谱图像与目标图像配准的过程,显著减少了分割时间,提高了分割精度.该方法的缺点是图谱图像聚类过程时间过长、心尖图像的分割效果不佳.

图谱的数量选择也是研究的重点.单张谱图对复杂的脑部和心脏图像的分割结果影响大、通用性差,多图谱在图谱数量的选择要平衡分割精度和速度之间的关系,研究表明图谱数量在15~20幅范围内,可以在保证分割精度的同时提高分割速度[28].

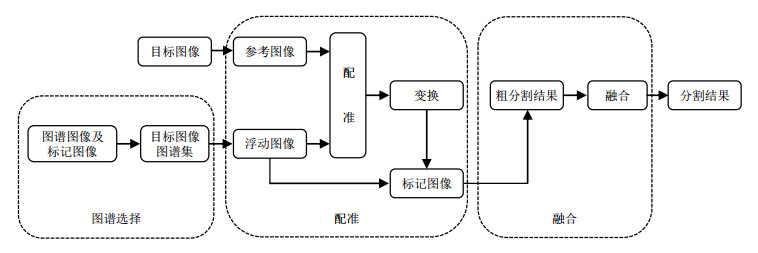

3.1.2 配准配准是将图谱分别配准到目标图像上获得相应的变换参数,并将参数应用于标记图像得到RV的粗分割结果.配准其实就是一个空间变换的过程,根据空间变换,配准可以分为刚性配准和非刚性配准,如图 2所示.

|

图 2 配准方法分类 Fig. 2 Classification of registration methods |

刚性配准包括刚体变换、仿射变换和投影变换,一般用于心脏图像粗配准.余军等[29]提出一种改进的CMR图像的多步配准方法,对CMR序列两两配准,经平移变换、刚体变换、仿射变换,得到多幅图像配准后的图像序列.相比于传统的仿射变换配准效果更好,然而心脏运动复杂,配准误差依然较大.

非刚性配准包括样条函数配准、物理模型配准,适用于心脏等形变较大、变化复杂的组织,B样条变换和流体变换是RV配准中常用的方法.

Punithakumar等[30]基于B样条变换提出一种移动网格框架的半自动分割算法,基于用户提供的CMR短轴电影序列中单帧图像的RV分割,通过点对点的对应分析检测每个心脏阶段的心内膜和心外膜.该方法还可以在完整的心动周期内进行全面的RV体积分析,并自动检测ED、ES.

B样条变换的网格大小决定形变程度和计算复杂度,其中精细网格可以模拟局部的非刚性形变,配准精度高,同时计算量也显著增加.B样条局部区域细化可以降低计算复杂度,提高局部配准精度,已被用来对脑图像和心脏图像的配准变换,显著提高了运算速度.文献[31]提出使用全局和局部变换组成的变换模型自动分割心肌和心室:全局变换通过缩放、平移、旋转和剪切形状的仿射变换来描述;基于B样条的自由形变(Free-Form Deformations,FFD)模型来表示局部变形,FFD的基本思想是通过操纵控制点的基础网格来使对象变形.该方法处理CMR电影图像效果良好,适用于测量区域运动和变形,以及对心脏特定区域进行标记和跟踪;其局限性在于ED末期的分割仍然容易出现错误,并且错误在传播的过程中甚至会增加.文献[32]结合压缩感知原理,提出稀疏自由形变模型(Sparse Free-Form Deformation Model,SFFD),该模型可以在不牺牲鲁棒性的前提下捕获运动不连续等精细局部细节.与传统的FFD方法相比,心脏图像的配准准确率显著提高.RVSC中提出了三种基于FFD的RV多图谱分割方法.文献[7]和[33]经初始化配准后,都使用FFD模型变换、连续优化策略和NMI的相似性度量进行RV分割.文献[34]提出的改进FFD的配准算法中,主要是通过像素属性来减少配准的模糊性,并且给具有更高能力的像素赋予高的权重来调整配准,减少其他组织的影响.由于此分割框架并不是针对心脏配准设计的方法,当直接应用于原始的CMR数据时,准确分割RV会更加困难.

流体变换在配准过程中可提供较大的形变自由度,对变动性大的组织有一定的优势,并已被应用于心脏的配准.Zhuang等[35]提出的RV分割新框架,首先将心脏解剖约束引入初始化阶段用于区域配准;然后使用距离加权插值变换成一个位移场以提供起始估计,并将图像配准后图谱中的标记应用于CMR图像,实现RV的精确分割.具有大自由度的流体配准可以灵活地调整图谱中的标记,精确配准CMR图像中的细节,以实现高精度分割;使用来自图谱的解剖信息作为先验,提高了配准的鲁棒性并减少了运行时间.此外,Zhuang等[36]提出将多序列CMR图像的互补信息结合,用于心脏图像的配准和分割.该方法提出将分割在虚拟公共空间中进行,所有的图谱图像和未对齐的目标图像都同时配准到虚拟公共空间中,然后利用期望最大化(Expectation Maximization,EM)算法分割图像.结果表明,该方法与传统方法相比,结果更具鲁棒性,并显示出良好的疤痕量化和心肌分割的潜力.

除了以空间变换分类外,配准还可以依据图像的结构特征和灰度信息分类.基于特征的配准在很大程度上受到提取特征的影响,而基于灰度信息的相似性测度对图像的灰度变化敏感,计算量大.两种方法结合使用,可提高配准精度和速度,在RV的配准中有很大的发展空间.

3.1.3 融合融合是将图谱与目标图像配准得到的粗分割结果融合,从而得到RV的最终分割结果.为了使得分割的结果更准确,需要选择合适的融合策略,使得最终的分割结果更具代表性.融合算法中应用较广泛的有多数投票法(Majority Voting,MV)、加权投票法(Weighted Voting,WV)、概率图谱(Probabilistic Atlas,PA)、STAPLE(Simultaneous Truth and Performance Level Estimation)和COLLATE(Consensus Level,Labeler Accuracy and Truth Estimation)等.其中,MV并未使用图像的先验信息.WV给每个分类器赋予一定的权重,权重可以通过专家或者一些先验知识获得.PA通过图谱与待分割图像配准,得到形变后的标记图像,再通过一定的算法,由形变后的标记图像计算出每个像素属于目标的概率值.STAPLE是基于EM算法实现图像的融合.COLLATE算法则是在STAPLE算法的基础上加入了像素一致性[37].

多图谱分割方法在标记融合过程中仅利用图块内的强度信息,而忽略梯度等有用信息.文献[9]提出将强度、梯度和上下文信息组合成增强特征向量,并将其结合到多图谱分割中,通过加权投票法进行融合.对83名受试者的CMR短轴数据集进行实验的结果表明,使用增强特征向量可以显着提高多图谱分割的准确性,而且使用增强特征向量可以改善基于图块的非局部分割的性能.

文献[38]提出了一种基于图块的标记融合的统计模型,即非局部STAPLE.该模型将STAPLE框架与非局部透视法合并,并且用局部评估表现替换了STAPLE中的全局评估表现,很大程度上减小了对配准的精度要求,并证明了在甲状腺和全脑分割中的融合准确性.几乎同时,文献[34]提出了在贝叶斯框架中制定基于图块的标记融合模型,该融合模型使用局部加权,其中图谱体素标记的权重取决于与目标体素的强度相似性.不仅在融合过程中考虑了基于图块的相似性,而且利用标记信息提高了配准的准确性.实验结果表明,使用该方法对CMR图像的LV和RV分割的结果能够为临床诊断提供准确的信息.文献[7]通过使用基于STAPLE算法的多标记融合策略,其中基于局部归一化互相关的排序,用于选择标记融合的10%的最佳图谱集;并与基于共识的感兴趣区域选择和迭代马尔可夫随机场相结合实现RV分割.而文献[35]使用全局加权,其中同一个图谱的所有体素具有相同的权重,由图谱与目标图像之间的相似性决定.该方法的局限性包括高计算成本、配准结果及图谱集质量对最终结果的影响.

文献[39]提出了一种基于图谱的4D CMR图像自动分割算法,主要将STAPLE算法和概率图谱结合使用.该算法基于EM算法的4D扩展,使用4D概率心脏图谱来估计初始模型参数,并将先验信息整合到分类过程,4D马尔可夫随机场结合空间和时间上下文信息,其中概率性心脏图谱由14位健康志愿者的3D心脏图像序列的手动分割构建而成.分类后,通过全局连通性滤波器提取每个结构的最大连通分量,从而显著改善分割结果.文章使用留一法测试,结果显示该方法可成功分割LV、RV和心肌.

王丽嘉等[40]提出将COLLATE融合用于RV自动分割.首先利用霍夫圆变换确定感兴趣区域,B样条配准得到粗分割结果,然后利用COLLATE对粗分割结果进行融合得到RV分割结果.其中,对于出现错误的数据采用基于形状约束的区域生长算法修正.10例临床CMR短轴电影图像被用于算法验证.与深度学习算法比较,COLLATE融合算法结果在射血分数(Ejection Fractions,EF)计算方面具有与手动分割更好的一致性和相关性.

图谱选择、配准和融合的改善是提高RV分割效能的有效手段,多图谱分割在不断提高分割性能的同时,将成为RV分割的主要方法.

3.2 深度学习算法分割深度学习算法作为RV分割的有效手段之一,高分割精度及快速处理是其主要优势.传统分割方法与深度学习算法的结合可以克服其网络复杂度,是之后RV分割的有效方法之一.

3.2.1 深度学习算法的发展历程20世纪四、五十年代,随着人们对人脑神经系统的研究不断深入,人工神经网络开启了数据处理的新篇章.随后,人们提出了感知机模型,但是研究发现,感知机的简单结构对于非线性的问题无法进行处理,人工神经网络的发展一度停滞不前.1986年,Rumelhart等[41]提出了反向传播算法(Back Propagation,BP),算法中的多隐层结构可以处理更加复杂的问题,但训练数据及模型的构建难度也随之增加.BP算法存在收敛速度慢、易陷入局部最小等缺陷,使得人工神经网络的发展进入了瓶颈期.20世纪90年代,人工神经网络发展缓慢,各种浅层机器学习模型被提出,但始终都未取得突破性进展.直到2006年,Hinton等[42]通过训练一个含有中心层的多层神经网络来重构高维输入向量,将高维数据转换为低维编码,从而促进了高维数据的分类、可视化、通信和存储.同时,还提出深度置信网络(Deep Belief Network,DBN)用以解决深度网络训练中特征提取等问题[43].至此,深度学习算法才正式被提出.当前,深度学习算法广泛应用于图像识别和分割、自然语言处理、姿态估计等领域.

3.2.2 用于RV分割的深度学习模型近年来,传统的RV分割方法已不能满足临床需求,深度学习算法作为目前图像处理领域最热门的方法,已被成功用于RV分割,以及临床心脏疾病的评估.

深度学习算法在图像处理中的应用,包括图像分类、定位、检测、语义分割和实例分割.其中图像的语义分割是计算机视觉中非常重要的任务,它是通过为图像中的每个像素分类以达到图像分割的目的[44].RV分割需要通过算法准确描绘心室边界并与其他部分区分,完成这项任务通常使用的是语义分割,例如完全卷积神经网络(Fully Convolutional Network,FCN)、U型网络(U-shaped network,U-Net)等.

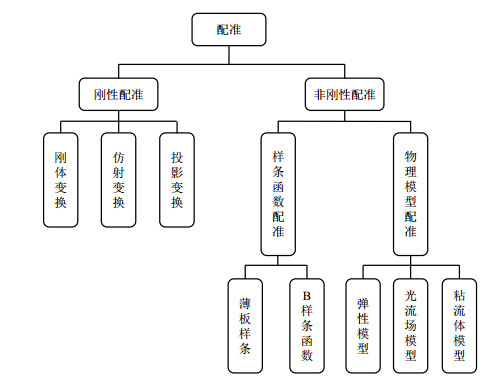

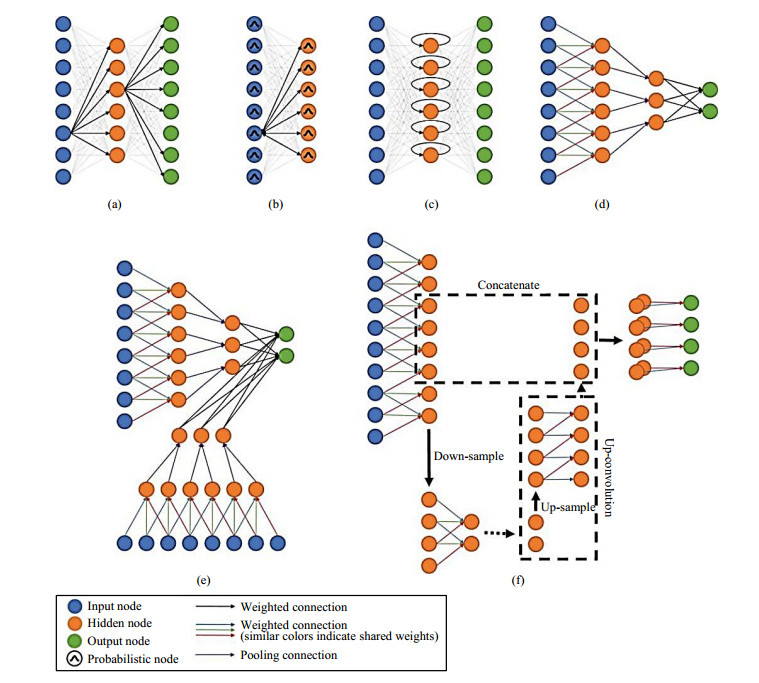

目前,常用于RV分割的深度学习算法包括:(1)FCN,主要是将卷积神经网络(Convolutional Neural Network,CNN)的全连接层换成反卷积操作[8];(2)深度反卷积网络(Deep Deconvolution Network,DDN),主要是对输出结果进行逐步的反卷积插值恢复到原始图像的大小;(3)深度残差网络(Deep Residual Network,DRN),间隔的把早期输入与卷积输出融合,以构建一个更深的网络,保证网络的复杂性和收敛性,提高拟合能力并降低训练难度.DRN可以有效解决深度增加、损失反而提高的现象.U-Net是建立在FCN基础之上完善的卷积神经架构,由捕获上下文信息路径和实现精确定位的对称扩展路径组成,可以从极少数的图像实现端到端的训练[45].图 3为部分算法的1D节点图.

|

图 3 医学图像中常用架构的1D节点图[10].(a)自动编码器;(b)受限玻尔兹曼机;(c)递归神经网络;(d)卷积神经网络;(e)多流卷积神经网络;(f) U-Net(具有单个下采样阶段) Fig. 3 One-dimensional node graph as of a common architecture in medical images[10]. (a) Automatic encoder; (b) Restricted Boltzmann machine; (c) Recurrent neural network; (d) Convolutional neural network; (e) Multi-stream convolutional neural network; (f) U-Net (having a single down-sampling phase) |

RV分割中表现最佳的深度学习算法的是FCN和U-Net,实现了全自动RV分割,并获得比传统分割方法更精确的结果.文献[46]中FCN架构通过在单个学习阶段对像素进行端对端的有效训练,实现像素分类并快速独立分割每个图像,该架构可并行部署在中央处理器(Central Processing Unit,CPU)、图形处理器(Graphics Processing Unit,GPU)或两者结合的集群上,可在大规模范围内实现RV的准确分割.文献[47]提出的循环完全卷积网络(Recurrent Fully-Convolutional Network,RFCN)利用相邻图像的空间依赖性,并从一个心脏时相的所有图像中学习,并获取心脏整体解剖结构的图像特征.RFCN将解剖检测和分割合并,经过端到端的训练,从而显著减少了计算时间,并有可能用于实时处理.文献[48]利用残差卷积神经网络模型依据低分辨率的2D图像,重新构造高分辨率的3D图像,以获得更精确的图像分析.文献[49]提出了一种回归卷积神经网络(Regression Convolutional Neural Network,RegressionCNN),将整体回归模型与卷积神经网络相结合,直接同时确定RV的边界点坐标.该方法将CNN卷积层提取的特征图转换为1D向量,连接整体回归模型,这种联系可以充分利用优化算法不断优化卷积层,在训练过程中直接学习整体回归模型.RegressionCNN对145例CMR图像的分割结果表明,该方法的分割结果与手动分割高度一致.Du等[50]提出将回归模型与深度置信网络结合的分割LV和RV.首先,从图像中提取DAISY特征,并采用基于点的表示方法来描述边界.然后,以DAISY特征为输入、边界点为标记,对基于深度置信网络的回归模型进行训练.该方法能够以较低的假设和计算成本,获得高水平的图像信息,并且精确分割LV和RV.

2017年,MICCAI举办的ACDC主要是实现LV、RV和心肌的分割,以及病理分类(正常情况、心肌梗死、扩张性心肌病、肥厚性心肌病、异常右心室).ACDC中共有10组参赛,其中Tziritas等使用水平集结合图割方法实现心脏的分割,最后用B样条拟合平滑轮廓边界.其余九组均使用了深度学习模型进行心脏分割,其中8组分割模型都是基于U-Net架构或其修改版本[51].

U-net网络结构形状似“U”型,如图 4所示,包含左侧的收缩路径和右侧的扩张路径.收缩路径用于捕捉内容,提取图像的高级特征,扩张路径用于精准定位.其中,收缩路径中每一步包含两次3×3的卷积、修正线性单元(Rectified Linear Unit,RELU)和一个步幅为2的最大池化层.在扩张路径中的每一步都包含2×2的上采样、两次3×3的卷积和RELU.除此之外还有一个与相应收缩路径的连接,该路径允许U-net网络通过叠加的方法将高级特征和浅层特征融合,其目的是通过浅层特征确定位置、边缘等细节信息,提高检测精度.

在ACDC中,四组使用了U-Net架构,Baumgartner等[52]用各种参数测试了U-Net和FCN架构,2D和3D卷积层的影响以及训练Dice损失函数(用来估计网络模型的预测值与真实值不一致程度的一种函数)与交叉熵损失函数.他们最终选择了最好的具有交叉熵损失函数的2D U-Net架构.Isensee等[53]实现了2D和3D U-Net架构的集合,其中在上采样层加入了残差连接.该架构获得了RV分割的最好结果,ED的Dice系数为0.946,豪斯多夫距离为10.1 mm;ES的Dice系数为0.899.Patravali等[54]测试了不同Dice和交叉熵损失函数训练的2D和3D U-Net,并选择表现最佳的具有Dice损失函数的2D U-Net.Yang等[55]实现了一个3D U-Net,其中使用残差连接代替通常的连接运算符,并训练了多级Dice损失函数.另外四组使用了U-Net的修改版本.Jang等[56]实现了M-Net架构,其与U-Net的主要区别在于解码层的特征图与前一层的特征图连接在一起,并且使用加权的交叉熵损失函数训练相应的网络.该架构在ES的豪斯多夫距离指标(11.8 mm)获得了最好结果.Khened等[57]使用了密集U-Net架构,该架构首先确定LV的近似半径和中心,然后再使用具有密集块的U-Net进行心脏分割,其中该网络的第一层也对应于初始层,使用Dice和交叉熵损失函数结合训练该网络.Rohe等[58]结合多图谱分割方法,在配准阶段使用编码器-解码器网络(SVF-Net).Zotti等[59]实现了网格U-Net架构,该体系结构可以自动配准先前形状作为附加特征.Wolterink等[60]使用CNN分割心脏图像,其中卷积核膨胀以确保每个像素的标记预测使用足够的图像局部信息.该网络的输出被分成两个,分别用于ED和ES,即同时完成两个时相的分割任务.

表 1总结了2017年,ACDC挑战中RV分割结果,其中D表示Dice系数(Dice Index),H表示豪斯多夫距离(Hausdorff Distance,以mm为单位).

| 表 1 2017年,ACDC挑战中RV分割 Table 1 RV segmentation results in the ACDC Challenge in 2017 |

此外,深度学习算法可以与其他分割方法的结合,在保持RV分割精度的同时减少网络计算的复杂度.文献[58]提出将SVF-Net和多图谱方法结合用于心室分割,首先利用SVF-Net将目标图像与训练数据集中所有图像快速配准,然后使用像素置信度度量将配准标记字段与软融合方法合并.该方法的配准速度允许目标图像与大量的图谱进行分别配准,同时保持计算的易处理性.文献[61]将基于图块的CNN整合到半自动活动轮廓中以分割心脏结构.同时,使用深度置信网络初始化和指导水平集模型已成功分割出LV[62].

4 评估指标分割结果的评估是图像分割的重要步骤,一般以专家手动分割的结果作为金标准,采用合适的评估指标对分割结果进行分析.评估包括主观和客观指标,其中,主观评估为仅用人眼观察对分割结果的一种判断标准,主观评估过程会对评估结果造成影响,可重复性差.因此,分割结果的评估多采用客观指标.这里主要从几何和临床角度介绍在RV分割中多采用的评估指标.

1)几何度量:为了测量RV分割的准确性,使用Dice系数和3D豪斯多夫距离.

Dice系数D被定义为:

| $ D=2\left(\left|V_{\text {user }} \cap V_{\text {ref }}\right|\right) /\left(\left|V_{\text {user }}\right|+\left|V_{\text {ref }}\right|\right) $ | (1) |

D表示实验分割体积

豪斯多夫距离H被定义为:

| $H(A, B) = \max [h(A, B), h(B, A)]$ | (2) |

其中,

| $h(A, B) = \mathop {\max }\limits_{a \in A} \left\{ {\mathop {\min }\limits_{b \in B} [d(a, b)]} \right\}$ | (3) |

| $h(B, A) = \mathop {\max }\limits_{b \in B} \left\{ {\mathop {\min }\limits_{a \in A} [d(b, a)]} \right\}$ | (4) |

d(a, b)和d(b, a)为欧几里得距离.

3D豪斯多夫距离测量实验分割结果的表面

2)临床表现:根据临床参数计算得到的三个指标:相关性、偏差和标准差值.参与计算的测量数据包括ED体积、ES体积和EF.

需要说明的是,几何和临床指标是互补的,因为一个指标的良好分数并不代表其他指标的得分也很高,也不代表该方法分割结果的准确.例如,低EF误差并不总是意味着ED和ES时相心室的分割准确,因为EF依赖于ED和ES体积之间的差异.因此,在ED和ES上以相同的顺序系统地高估或低估心室大小的方法可能具有低EF偏差、低平均误差和高EF相关性,同时具有低Dice系数和高豪斯多夫距离.综合多种评估指标可以防止对分割结果的片面评估,保证评估结果的客观性和公正性.

5 总结与展望RV手动分割结果较为准确,但耗时长,易受主观影响.因而不能大规模处理数据.传统的半自动RV分割方法需要少量手动分割辅助,而且分割精度不足、分割速度较慢,限制了其在临床上的应用.因而快速而准确的全自动RV分割依然是发展的主要目标.RV分割的最新方法包括多图谱和深度学习这两种方法.多图谱分割依靠专家手动分割的图谱图像,减少图像自身信息对分割图像的影响.图谱的选择及数量可以减少分割的计算量,提高分割速度;多种配准算法的联合使用可以提高配准精度;融合算法的改进使结果更具鲁棒性.多图谱分割的发展方向主要是提高图谱选择的相似性及配准、融合算法的准确性;还可以将形状或解剖学先验作为心脏图像配准的初始化或约束,以提高配准的精度.基于深度学习算法的RV分割方法与多图谱方法相比,分割结果更加准确,并且可以同时分割LV、RV和心肌,提高了图像数据的运算效率.相比于LV和心肌,RV分割精度仍明显较低,这主要由RV的复杂结构造成.基于深度学习算法的分割方法是如今对RV分割最有效的方法,并且对于神经网络难以训练及容易出现过拟合问题等问题,已经提出池化操作、分解卷积、残差结构等来缓解.大量数据的快速训练,及特征分类的优化是深度学习进一步的发展方向.

多图谱和深度学习两种方法在RV分割中的应用进一步提高了RV分割的精确度和分割速度,但仍各自存在不足,需要进一步完善.尤其是近年来随着深度学习方法飞速发展,在图像分割领域取得了显著的成就,已经成为图像分割的热门方法.在今后RV分割的研究中,多图谱分割及深度学习将成为主要方法.

| [1] | BREWIS M J, BELLOFIORE A, VANDERPOOL R R, et al. Imaging right ventricular function to predict outcome in pulmonary arterial hypertension[J]. Int J Cardiol, 2016, 218: 206-211. DOI: 10.1016/j.ijcard.2016.05.015. |

| [2] | KUTTY S, SHANG Q, JOSEPH N, et al. Abnormal right atrial performance in repaired tetralogy of Fallot: A CMR feature tracking analysis[J]. Int J Cardiol, 2017, 248: 136-142. DOI: 10.1016/j.ijcard.2017.06.121. |

| [3] | VOELKEL N F, QUAIFE R A, LEINWAND L A, et al. Right ventricular function and failure: report of a national heart, lung, and blood institute working group on cellular and molecular mechanisms of right heart failure[J]. Circulation, 2006, 114(17): 1883-1891. DOI: 10.1161/CIRCULATIONAHA.106.632208. |

| [4] | HAUTVAST G, LOBREGT S, BREEUWER M, et al. Automatic contour propagation in cine cardiac magnetic resonance images[J]. IEEE Trans Med Imaging, 2006, 25(11): 1472-1482. DOI: 10.1109/TMI.2006.882124. |

| [5] |

HUANG X Q, ZHAO L L, CHEN L Y, et al. Accelerated cardiac CINE imaging with CAIPIRINHA and partial parallel acquisition[J].

Chinese J Magn Reson, 2017, 34(3): 283-293.

黄小倩, 赵乐乐, 陈利勇, 等. 基于同时多层激发和并行成像的心脏磁共振电影成像[J]. 波谱学杂志, 2017, 34(3): 283-293. |

| [6] | PETITJEAN C, ZULUAGA M A, BAI W, et al. Right ventricle segmentation from cardiac MRI: A collation study[J]. Med Image Anal, 2015, 19(1): 187-202. DOI: 10.1016/j.media.2014.10.004. |

| [7] | ZULUAGA M, CARDOSO M, MODAT M, et al. Multi-atlas propagation whole heart segmentation from MRI and CTA using a local normalised correlation coefficient criterion[C]. Lodon: FIMH 2013: Functional Imaging and Modeling of the Heart, 2013, 7945: 172-180. |

| [8] | LONG J, SHELHAMER E, DARRELL T. Fully convolutional networks for semantic segmentation[C]. Boston: 2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2015: 3431-3440. |

| [9] | BAI W J, SHI W Z, LEDIG C, et al. Multi-atlas segmentation with augmented features for cardiac MR images[J]. Med Image Anal, 2015, 19(1): 98-109. |

| [10] | LITJENS G, KOOI T, BEJNORDI B E, et al. A survey on deep learning in medical image analysis[J]. Med Image Anal, 2017, 42: 60-88. DOI: 10.1016/j.media.2017.07.005. |

| [11] | PETITJEAN C, DACHER J N. A review of segmentation methods in short axis cardiac MR images[J]. Med Image Anal, 2011, 15(2): 169-184. DOI: 10.1016/j.media.2010.12.004. |

| [12] | KATOUZIAN A, PRAKASH A, KONOFAGOU E. A New automated technique for left- and right-ventricular segmentation in magnetic resonance imaging[J]. Conf Proc IEEE Eng Med Biol Soc, 2006, 1: 3074-3077. |

| [13] | WANG L J, PEI M C, CODELLA N C, et al. Left ventricle: fully automated segmentation based on spatiotemporal continuity and myocardium information in cine cardiac magnetic resonance imaging (LV-FAST)[J]. BioMed Res Int, 2015, 2015: 367583. |

| [14] | ROSADO-TORO J A, ABIDOV A, ALTBACH M I, et al. Segmentation of the right ventricle in four chamber cine cardiac MR images using polar dynamic programming[J]. Comput Med Imaging Graph, 2017, 62: 15-25. DOI: 10.1016/j.compmedimag.2017.08.002. |

| [15] | GOSHTASBY A, TURNER D A. Segmentation of cardiac cine MR images for extraction of right and left ventricular chambers[J]. IEEE Trans Med Imaging, 1995, 14(1): 56-64. |

| [16] | WANG C W, PENG C W, CHEN H C. A simple and fully automatic right ventricle segmentation method for 4-dimensional cardiac MR images[C]// Nice: Proceedings of 3D Cardiovascular Imaging: A MICCAI Segmentation Challenge, 2012. |

| [17] | YILMAZ P, WALLECAN K, KRISTANTO W, et al. Evaluation of a semi-automatic right ventricle segmentation method on short-axis MR images[J]. J Digit Imaging, 2018, 31(5): 670-679. DOI: 10.1007/s10278-018-0061-3. |

| [18] | MAIER O M O, JIMENEZ D, SANTOS A, et al. Segmentation of RV in 4D cardiac MR volumes using region-merging graph cuts[C]// Krakow: 2012 Computing in Cardiology, 2012: 697-700. |

| [19] | GROSGEORGE D, PETITJEAN C, DACHER J N, et al. Graph cut segmentationwith a statistical shape model in cardiac MRI[J]. Comput Vis Image Und, 2013, 117(9): 1027-1035. DOI: 10.1016/j.cviu.2013.01.014. |

| [20] | ABI-NAHED J, JOLLY M P, YANG G Z. Robust active shape models: A robust, generic and simple automatic segmentation tool[C]// Copenhagen: Medical Image Computing and Computer Assisted Intervention, 2006: 1-8. |

| [21] | GROSGEORGE D, PETITJEAN C, CAUDRON J, et al. Automatic cardiac ventricle segmentation in MR images: a validation study[J]. Int J Comput Assist Radiol Surg, 2011, 6(5): 573-581. DOI: 10.1007/s11548-010-0532-6. |

| [22] | ARRIETA C, URIBE S, SING-LONG C, et al. Simultaneous left and right ventricle segmentation using topology preserving level sets[J]. Biomed Signal Processing, 2017, 33: 88-95. DOI: 10.1016/j.bspc.2016.11.002. |

| [23] | HUANG J S, HUANG X L, METAXAS D, et al. Dynamic texture based heart localization and segmentation in 4-D cardiac images[C]// Arlington: 2007 4th IEEE International Symposium on Biomedical Imaging: From Nano to Macro, 2007: 852-855. |

| [24] | MITCHELL S C, LELIEVELDT B P, VAN DER GEEST R J, et al. Multistage hybrid active appearance model matching: Segmentation of left and right ventricles in cardiac MR images[J]. IEEE Trans Med Imaging, 2001, 20(5): 415-423. DOI: 10.1109/42.925294. |

| [25] | ZHANG H H, WAHLE A, JOHNSON R K, et al. 4-D Cardiac MR image analysis: Left and right ventricular morphology and function[J]. IEEE Trans Med Imaging, 2010, 29(2): 350-364. |

| [26] | ROHLFING T, BRANDT R, MENZEL R, et al. Evaluation of atlas selection strategies for atlas based image segmentation with application to confocal microscopy images of bee brains[J]. NeuroImage, 2004, 21(4): 1428-1442. DOI: 10.1016/j.neuroimage.2003.11.010. |

| [27] |

ZHANG Y N, CHEN C S, KANG Y. Accurate segmentation of right ventricles based on multi-atlas with affinity propagation clustering selection[J].

Journal of Northeastern University (Natural Science), 2014, 35(6): 795-799.

张耀楠, 陈传慎, 康雁. 基于仿射传播聚类选择的多Atlas右心室精准分割[J]. 东北大学学报(自然科学版), 2014, 35(6): 795-799. DOI: 10.3969/j.issn.1005-3026.2014.06.008. |

| [28] | AWATE S P, ZHU P H, WHITAKER R T. How many templates does it take for a good segmentation?: Error analysis in multiatlas segmentation as a function of database size[J]. Med Image Comput Compu Assist Interv, 2012, 7509: 103-114. |

| [29] |

YU J, CHEN X, ZHOU Y P. Improved multi-step registration method for cardiac nuclear magnetic resonance image[J].

Software Guide, 2016, 15(5): 207-209.

余军, 陈雪, 周勇攀. 一种改进的心脏核磁共振图像多步配准方法[J]. 软件导刊, 2016, 15(5): 207-209. |

| [30] | PUNITHAKUMAR K, NOGA M, BEN AYED I, et al. Right ventricular segmentation in cardiac MRI with moving mesh correspondences[J]. Comput Med Imaging Graph, 2015, 43: 15-25. DOI: 10.1016/j.compmedimag.2015.01.004. |

| [31] | LORENZO-VALD S M, SANCHEZ-ORTIZ G I, MOHIADDIN R, et al. Atlas-based segmentation and tracking of 3D cardiac MR images using non-rigid registration[C]//Tokyo: Medical Image Computing and Computer Assisted Intervention. 2002: 642-650. |

| [32] | SHI W Z, ZHUANG X H, PIZARRO L, et al. Registration using sparse free-form deformations[J]. Med Image Comput Comput Assist Interv, 2012, 15(pt2): 659-666. |

| [33] | BAI W J, SHI W Z, O'REGAN D P, et al. A probabilistic patch-based label fusion model for multi-atlas segmentation with registration refinement: Application to cardiac MR images[J]. IEEE Trans Med Imaging, 2013, 32(7): 1302-1315. DOI: 10.1109/TMI.2013.2256922. |

| [34] | OU Y M, SOTIRAS A, PARAGIOS N, et al. DRAMMS: deformable registration via attribute matching and mutual-saliency weighting[J]. Med Image Anal, 2011, 15(4): 622-639. DOI: 10.1016/j.media.2010.07.002. |

| [35] | ZHUANG X, HAWKES D J, CRUM W R, et al. Robust registration between cardiac MRI images and atlas for segmentation propagation[C]//USA: SPIE Medical Imaging Symposium. 2008: 1-11 |

| [36] | ZHUANG X H. Multivariate mixture model for myocardial segmentation combining multi-source images[J]. IEEE T Pattern Anal, 2018: 1. |

| [37] | ASMAN A J, LANDMAN B A. Robust statistical label fusion through consensus level, labeler accuracy, and truth estimation (COLLATE)[J]. IEEE Trans Med Imaging, 2011, 30(10): 1779-1794. DOI: 10.1109/TMI.2011.2147795. |

| [38] | ASMAN A J, LANDMAN B A. Non-local statistical label fusion for multi-atlas segmentation[J]. Med Image Anal, 2013, 17(2): 194-208. |

| [39] | LORENZO-VALD S M, SANCHEZ-ORTIZ G I, MOHIADDIN R, et al. Segmentation of 4D cardiac MR images using a probabilistic atlas and the EM algorithm[J]. Med Image Anal, 2004, 8(3): 255-265. |

| [40] |

WANG L J, SU X Y, LI Y, et al. Segmentation of right ventricle in cardiac cine MRI using COLLATE fusion based multi-atlas[J].

Chinese J Magn Reson, 2018, 35(4): 407-416.

王丽嘉, 苏新宇, 李亚, 等. 基于COLLATE融合多图谱的心脏电影MRI右心室分割[J]. 波谱学杂志, 2018, 35(4): 407-416. |

| [41] | RUMELHART D E, HINTON G E, WILLIAMS R J. Learning representations by back-propagating errors[J]. Nature, 1986, 323: 533-536. DOI: 10.1038/323533a0. |

| [42] | HINTON G E, SALAKHUTDINOV R R. Reducing the dimensionality of data with neural networks[J]. Science, 2006, 313(5786): 504-507. DOI: 10.1126/science.1127647. |

| [43] | HINTON G E, OSINDERO S, TEH Y W. A fast learning algorithm for deep belief nets[J]. Neural Comput, 2006, 18(7): 1527-1554. DOI: 10.1162/neco.2006.18.7.1527. |

| [44] | GARCIA-GARCIA A, ORTS-ESCOLANO S, OPREA S, et al. A reviewon deep learning techniques applied to semanticsegmentation[J]. Computer Vision and Pattern Recognition, 2017: arXiv: 1704.06857. |

| [45] | RONNEBERGER O, FISCHER P, BROX T. U-Net: Convolutional networks for biomedical image segmentation[J]. Computer Vision and Pattern Recognition, 2015: arXiv:1505.04597. |

| [46] | TRAN P V. A Fully Convolutional neural network for cardiac segmentation in short-axis MRI[J]. Computer Vision and Pattern Recognition, 2016: arXiv:1604.00494. |

| [47] | POUDEL R P K, LAMATA P, MONTANA G. Recurrent fully convolutional neural networks for multi-slice MRI cardiac segmentation[J]. MICCAI Workshop RAMBO, 2016: arXiv:1608.03974. |

| [48] | OKTAY O, BAI W, LEE M, et al. Multi-input cardiac image super-resolution using convolutional neural networks[C]//MICCAI Workshop RAMBO, 2016. 246-254. |

| [49] | CHEN J, ZHANG H V, ZHANG W W, et al. Correlated regression feature learning for automated right ventricle segmentation[J]. IEEE J Trans Eng Health Med, 2018, 6: 1800610. |

| [50] | DU X Q, ZHANG W W, ZHANG H Y, et al. Deep regression segmentation for cardiac bi-ventricle MR images[J]. IEEE Access, 2018, 6: 3828-3838. DOI: 10.1109/ACCESS.2017.2789179. |

| [51] | BERNARD O, LALANDE A, ZOTTI C, et al. Deep learning techniques for automatic MRI cardiac multi-structures segmentation and diagnosis: Is the problem solved?[J]. IEEE T Med Imaging, 2018, 37(11): 2514-2525. DOI: 10.1109/TMI.2018.2837502. |

| [52] | BAUMGARTNER C F, KOCH L M, POLLEFEYS M, et al. An Exploration of 2D and 3D deep learning techniques for cardiac MR image segmentation[C]//Quebec: ACDC and MMWHS Challenges, 2017, 10663: 111-119. |

| [53] | ISENSEE F, JAEGER P, FULL P, et al. Automatic cardiac disease assessment on cine-MRI via time-series segmentation and domain specific features"[C]//Quebec: ACDC and MMWHS Challenges, 2017, 10663: 120-129. |

| [54] | PATRAVALI J, JAIN S, CHILAMKURTHY S. 2D-3D Fully convolutional neural networks for cardiac MR segmentation[C]//Quebec: ACDC and MMWHS Challenges, 2017, 10663: 130-139. |

| [55] | YANG X, BIAN C, YU L, et al. Class-balanced deep neural network for automatic ventricular structure segmentation[C]//Quebec: ACDC and MMWHS Challenges, 2017, 10663: 152-160. |

| [56] | JANG J, HA S, KIM S, et al. Automatic segmentation of LV and RV in cardiac MRI[C]//Quebec: ACDC and MMWHS Challenges, 2017, 10663: 161-169. |

| [57] | KHENED M, ALEX V, KRISHNAMURTHI G. Densely connected fully convolutional network for short-axis cardiac cine mr image segmentation and heart diagnosis using random forest [C]//Quebec: ACDC and MMWHS Challenges, 2017, 10663: 140-151. |

| [58] | ROHE M M, SERMESANT M, PENNEC X. Automatic multi-atlas segmentation of myocardium with SVF-Net[C]//Quebec: ACDC and MMWHS Challenges, 2017, 10663: 170-177. |

| [59] | ZOTTI C, LUO Z, HUMBERT O, et al. Gridnet with automatic shape prior registration for automatic mri cardiac segmentation[C]//Quebec: ACDC and MMWHS Challenges, 2017, 10663: 73-81. |

| [60] | WOLTERINK J M, LEINER T, VIERGEVER M A, et al. Automatic segmentation and disease classification using cardiac cine MR images[C]//Quebec: ACDC and MMWHS Challenges, 2017, 10663: 101-110. |

| [61] | RUPPRECHT C, HUAROC E, BAUST M, et al. Deep active contours[J]. Computer Vision and Pattern Recognition, 2016: arXiv: 1607.05074. |

| [62] | NGO T A, LU Z, CARNEIRO G. Combining deep learning and level set for the automated segmentation of the left ventricle of the heart from cardiac cine magnetic resonance[J]. Med Image Anal, 2017, 35: 159-171. DOI: 10.1016/j.media.2016.05.009. |

2019, Vol. 36

2019, Vol. 36