桥小脑角区脑膜瘤(Meningioma)与听神经瘤(Auditory Neuroma,AN)是两种常见的脑部肿瘤[1].脑膜瘤发病率约占所有颅内肿瘤的12.5%,其中5%~8%发生在桥小脑角(Cerebellopontine Angle,CPA)中[2].听神经瘤是指起源于听神经鞘的肿瘤[3],其发病率占颅内肿瘤的7%~12%,占CPA肿瘤的70%~80%[4].组织学上,脑膜瘤可分为三类:脑膜瘤、成纤维细胞和恶性肿瘤[5],其中成纤维细胞亚类型脑膜瘤难以与组织学上的听神经瘤区分开来,所以在确定治疗防治时,桥小脑角区脑膜瘤和听神经瘤的分类就显得尤为重要[6].

医学上有多种检测脑部肿瘤的方法,其中磁共振成像(Magnetic Resonance Imaging,MRI)作为一种公认的无创诊断技术[7],因具有高分辨率等特质,已被广泛应用于脑部疾病的诊断当中[8].目前桥小脑角区脑膜瘤和听神经瘤在诊断上主要还依赖于医生的临床经验和阅片能力[9, 10],通过观察听神经瘤磁共振图像呈现的“荸荠”征、内听道扩大,以及脑膜瘤的“脑膜尾征”、假包膜征作为要点[3],并结合患者临床表现进行诊断,自动识别两者的算法研究尚少.平小夏等[11]通过观察多序列磁共振图像病变区域大小、结构轮廓以及邻近结构改变等特点对桥小脑角区多种脑部肿瘤进行诊断,并借助脑膜瘤的“脑膜尾征”特征性表现对脑膜瘤进行特异性识别,但其仅通过两位医师共同完成了83例病例诊断,人工干预成分较大、效率较低;张敏等[12]通过对比电子计算机断层扫描(Computed Tomography,CT)与MRI特征性表现对两种肿瘤进行判别,但脑膜瘤与听神经瘤的DWI、T1WI与T2WI等信号具有一定的相似性,只能做简单的定性分析,且针对误诊没有提出合理的解决方案.近些年来,深度学习方法在不同领域中都得到了一些应用[13],在处理医学影像方面也表现出优异的性能,并且发展非常迅速.卷积神经网络(Convolutional Neural Network,CNN)是深度学习方法中常见的深度学习模型.Payan等[14]在2015年通过分析Gupta等[15]的研究工作,选取使用稀疏自动编码(Sparse Autoencoder,SAE)网络针对阿尔茨海默症进行病症分类,将数据预处理后经网络训练得到的特征图传递给全连接网络,其分类准确率最终达到了0.895 0;Mumtaz等[16]在2018年使用基于3D全卷积神经网络(Fully Convolutional Neural Networks,FCNNs)及3D水平集分割算法的新方法,对结肠癌和直肠癌进行分类分割,其分割准确率达到了0.937 8,相比之前的0.862 3提高了0.075 5;梁翠霞等[17]在2018年针对乳腺肿瘤的多种分类模型进行了讨论比较,并提出了新的结合深度学习特征的方法.

由于之前的诊断方法存在人工干预成分高、原始图像对比度低、病症细节不明显等问题,本文提出了利用3D CNN分类模型自动识别桥小脑角区脑膜瘤与听神经瘤的算法.首先将脑部磁共振图像进行预处理,通过运用限制对比度自适应直方图均衡化(Contrast Limited Adaptive Histogram Equalization,CLAHE)算法增强图像,使图像细节更加清晰;然后把2D CNN扩展到多模态3D CNN后,即可获取图像在三个方向的纹理信息,不仅解决了2D CNN原始输入需要大邻域的缺点,也能更好的提取各模态之间的差异信息.本文将深度学习用于桥小脑角区脑膜瘤与听神经瘤的判别诊断,并通过图像预处理与学习率等网络参数优化等手段,提高了深度学习网络对于桥小脑角区脑膜瘤与听神经瘤的判别性能.

1 实验方法 1.1 实验数据采集及流程研究对象为2015年1月~2016年12月间,因桥小脑角区脑膜瘤或听神经瘤申请于上海市华山医院进行脑部MRI扫描的患者.其中,听神经瘤患者为218例,脑膜瘤患者为89例,应用GE 1.5T Signa HDxt MRI系统采集了多种序列的磁共振图像.由于T1W-SE序列图像呈现的组织病变特征较好,横断面易于观察脑部肿瘤组织,并且临床也使用该序列图像对脑肿瘤进行诊断,所以实验主要选用的数据源是T1W-SE序列横断面方位增强扫描图像,重复时间(Repetition Time,TR)= 580 ms,回波时间(Echo Time,TE)= 8 ms,采集矩阵(Acquisition Matrix)= 256*256,层厚= 2 mm,层间隔= 2 mm.其中每个病人原始图像均为1组病变层面图像,经数据翻转增强后,数据集样本量由307个扩增至614个.实验是在基于i9-9900k处理器以及RTX2080环境下运行,其中训练集和测试集的比例为约为7:3,每步实验均在迭代不少于1 000次后对结果进行评估.评价标准采取准确率(Accuracy)、损失率(Loss)、精确率(Precision)和召回率(Recall)来对模型进行性能评估.对于二分类情况,分类结果由真阳性(True Positives,TP)、真阴性(True Negatives,TN)、假阳性(False Positives,FP)与假阴性(False Negatives,FN)样本组成.(1)~(3)式分别为准确率、精确率、召回率的计算公式.其中,以听神经瘤为正类,脑膜瘤为负类.

| $Accuracy = \frac{{TP + TN}}{{TP + TN + FP + FN}}$ | (1) |

| $Precision = \frac{{TP}}{{TP + FP}}$ | (2) |

| $Recall = \frac{{TP}}{{TP + FN}}$ | (3) |

损失率是由整个网络在训练过程中损失函数计算所得.

实验流程如图 1所示.一组多扫描层原始二维图像经图像拼接融合后生成一份三维图像,得到的三维图像作为数据集,首先进行数据扩增以及CLAHE预处理,增强图像细节与对比度,再运用3D CNN模型对图像进行分类.通过分别对比分析不同学习率、原始图像与预处理图像,以及不同网络模型的分类效果,评估该分类模型的整体性能.

|

图 1 本文实验的基本流程 Fig. 1 Experimental procedure in this research |

磁共振图像中脑组织的图像增强在医学分析中起着不可或缺的作用.图像增强的主要目的是增加图像的对比度,以便清晰辨别病灶区域以及纹理特征.最为常见的图像增强方法是自适应直方图均衡化(Adaptive Histogram Equalization,AHE)[18],它计算了图像多个灰度直方图,并使用折边来重新分配图像的灰度值.AHE方法的主要缺点是仅仅考虑了局部区域的像素,且在图像相对均匀的区域中存在过度放大噪声的趋势.

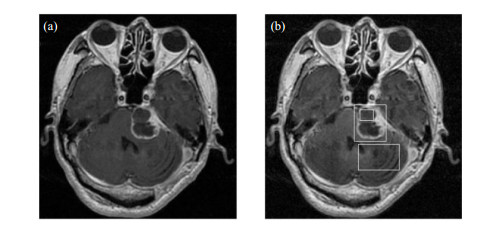

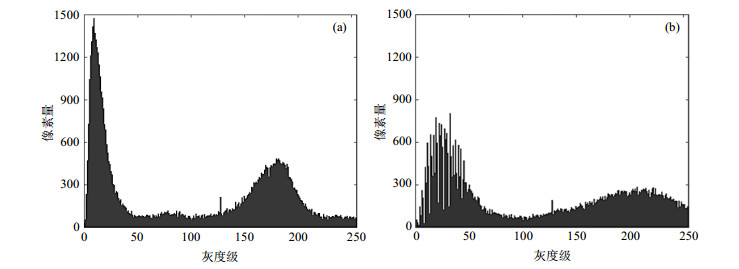

为了克服图像中不同区域的灰度分布相差甚远的缺点,增强图像的某些局部区域的细节,本文使用了CLAHE技术[19]对图像进行预处理.它与对比度限制中的普通AHE方法不同,通过限制局部直方图的高度来限制局部对比度的增强幅度,从而有效抑制噪声的放大及局部对比度的过增强,同时它也可以应用于全局直方图均衡.经过CLAHE预处理后的磁共振图像的灰度范围得到扩展,图像中的组织细节更加清晰,输入网络后能够有效增加网络的分类准确率[20],图 2为原始图像与经CLAHE处理后的图像,图 3为相应的灰度直方图.

|

图 2 (a) 原始图像;(b) CLAHE预处理图像 Fig. 2 (a) Original image; (b) CLAHE pre-processed image |

|

图 3 (a) 原始图像的灰度直方图;(b) CLAHE预处理图像的灰度直方图 Fig. 3 (a) Gray histogram of original image; (b) Gray histogram of CLAHE pre-processed image |

CNN是深度学习中最常用框架之一[21],作为一种自动特征学习的算法,它可以从训练集中直接进行特征学习,避免了人为因素的影响.目前,深度CNN已经在医学图像分类中显示出较为优良的性能.作为一种多层、可完全训练的模型,CNN可以基于原始图像捕获从低级到高级层次的特征,其结构中通常包括卷积层、池化层、全连接层[22].

卷积层是CNN的核心组成部分,主要作用是特征提取.它连接了输入图像的一个小区域,并将计算卷积核与对应的输入小区域之间的点乘得到的结果作为输出.其中输出特征图的尺寸由三个超参数进行控制,深度(Depth)、步长(Stride)和零值填充(Zero-Padding),输出特征图的尺寸计算如(4)式所示:

| $W = \frac{{W' - F + 2P}}{S} + 1$ | (4) |

其中W与

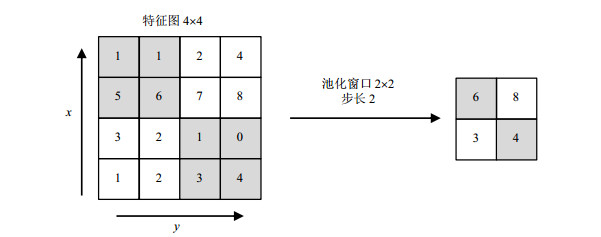

池化层通常会插入在连续的卷积层中,因为卷积操作后可能包含一些无用信息,会增加运算量,加入池化层能够逐渐减小表达空间的尺寸,以此降低网络中参数数量和计算开销;同时池化层也能起到控制过拟合的作用.池化操作通常包括最大池化、平均池化以及L2-Norm池化,最大池化层因简单高效而被广泛使用,图 4为最大池化操作示例[23].

全连接层通常出现在CNN中的最后几层,整合卷积层或池化层中具有类别区分性的局部信息,起到将学习到的特征映射到样本标记空间的作用.

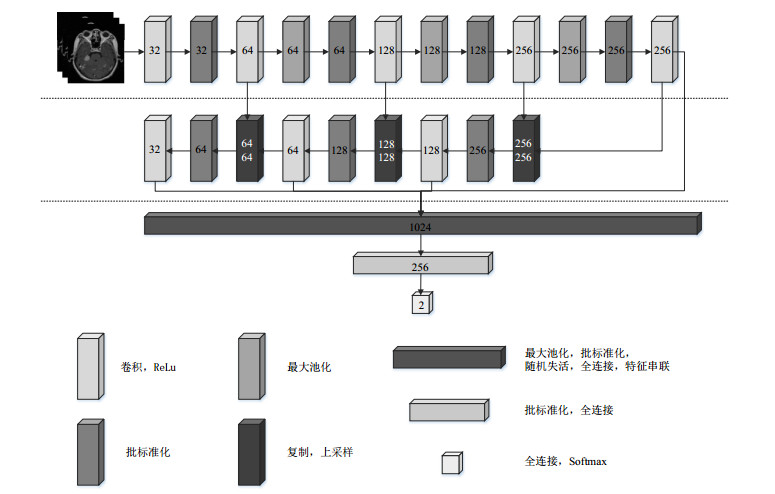

1.3.2 本文使用的桥小脑角区脑膜瘤与听神经瘤分类模型本文使用的桥小脑角区脑膜瘤与听神经瘤分类模型的3D CNN结构如图 5所示.其中包括8层卷积层、3层最大池化层和3层全连接层.为优化网络结构,本实验同时还在卷积层和池化层之间加入批标准化(Batch Normalization,BN)层[24].

|

图 5 本文使用的桥小脑角区脑膜瘤与听神经瘤分类模型的3D CNN结构 Fig. 5 3D CNN structure diagram used in this research for classifying meningioma and auditory neuroma in the cerebellopontine angle |

随着神经网络层数的不断增加,训练会越来越难,梯度消失问题会导致网络层间的梯度无法有效传递,通过使用BN算法,网络训练过程中各层的梯度变化会趋于稳定,过拟合现象得以减轻,且容许使用较高的学习率来提高训练速度,可经过较少的迭代次数得到较高的精确度,加快神经网络的收敛速度.BN在前向传播时主要有三个任务:计算每批训练数据的统计量;对数据标准化;对标准化后的数据进行缩放位移,将其映射到更大的表征空间上.其算法过程如表 1所示.

| 表 1 BN算法 Table 1 Batch normalization algorithm |

在图 5的上部网络中,将预处理后图像输入卷积核大小为(5,5,5)、步长为(2,2,2)的卷积层中进行卷积操作,图像尺寸变为原来的一半,再输出至BN层;把经过BN层后得到的特征图像输入至卷积核大小为(3,3,3)、步长为(1,1,1)的下一个卷积层中进行卷积操作,再经过窗口尺寸为(2,2,2)、步长为(2,2,2)的最大池化层将图像大小减半,输出至相连的BN层进行规范化操作.图像经过上部网络的第一层卷积和3次下采样操作后,特征图大小变为输入图像的1/16,其尺寸为11×11×3.

在图 5的中部网络中,首先将前一层得到的特征图进行2倍化上采样操作,再与对应上部网络中卷积层得到的图像进行数据拼接,输出至BN层进行规范化操作,最后分别使用128个、64个、32个尺寸为(3,3,3)的卷积核进行卷积操作.

在图 5的下部网络中,为3层全连接层.第一层全连接层是由上部网络的最后一个卷积层以及中部网络所有的卷积层得到的特征图像经过最大池化、Dropout[25]和BN操作以及数据拼接组成;第二层全连接层再次加入BN操作;第三层全连接层通过使用Softmax激活函数对特征图进行分类[26]. Softmax激活函数所有的输出单元之和为1,其中每个输出对应的[0, 1]区间的数值就是该输出分到每个标签的概率,最后取概率最大的输出作为最终的预测结果.Softmax函数的公式如(5)式所示.

| $ {y_j} = \frac{{{{\rm{e}}^{{Z_j}}}}}{{\sum\nolimits_{t = 1}^k {{{\rm{e}}^{{Z_t}}}} }} $ | (5) |

其中Z为分类器前输出单元的输出,j表示Z中的第j个元素,k为总的类别个数.

2 实验结果 2.1 原始图像不同学习率分类效果对比不同大小的学习率会对训练过程和结果产生不同的影响,为得到较好的训练结果,应确定最优初始学习率.本文分别选取恒定为0.005、0.001、0.000 5、0.000 1的初始学习率值进行实验,实验数据对象为未经预处理的原始图像,实验结果如表 2所示.

| 表 2 使用不同学习率时,测试集的分类性能的比较 Table 2 Classification performance comparison of test set with different learning rates |

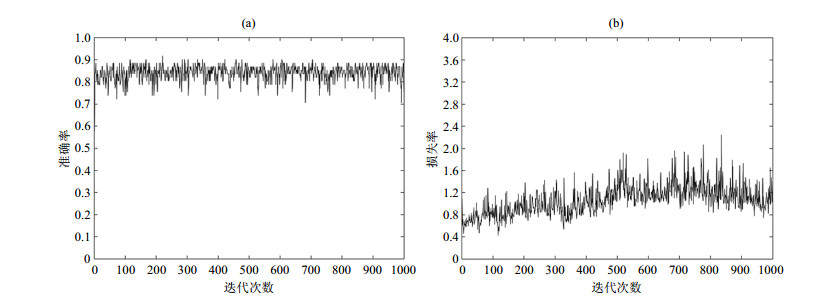

当初始学习率为0.000 5时,得到的分类准确率最高,为0.819 7;损失率最低,为1.475 1.测试集准确率与损失率曲线变化如图 6所示,观察恒定损失率曲线可以看出,在300次之后,损失率不断上升,出现过拟合现象,在800次后,损失率出现下降趋势,波动幅度减小.

|

图 6 初始学习率为0.000 5时,测试集的(a)准确率和(b)损失率曲线 Fig. 6 (a) Accuracy and (b) loss curves of test set with an initial learning rate of 0.000 5 |

在初始学习率为0.000 5的情况下,将原始图像与经CLAHE算法预处理图像训练结果进行对比.另外,在加大训练轮次至2 000次的同时,为进一步提升准确率,在训练次数分别达到400、800、1 200与1 600时,将学习率降低至初始学习率的1/2、1/5、1/10与1/20倍,并且重新调整训练参数以避免过拟合现象发生,实验结果如表 3所示.

| 表 3 原始图像、预处理图像、预处理图像+渐变学习率图像的分类性能对比 Table 3 Comparison of classification performance among original image, pre-processed image, and image after pre-processing and learning rate optimization |

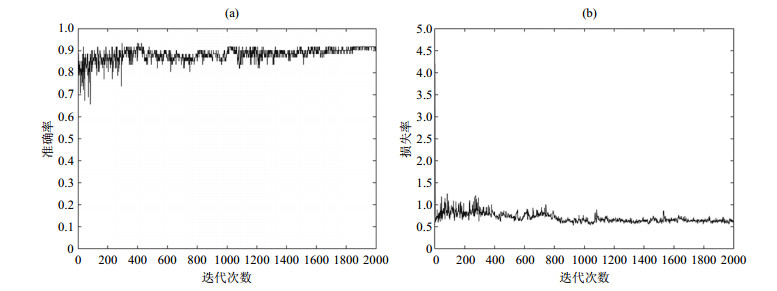

由表 3可知,原始图像经过预处理和学习率优化后,桥小脑角区脑膜瘤与听神经瘤分类模型所达到的分类效果最好:准确率最高,为0.918 0;损失率最低,为0.550 1;精确率和召回率分别为0.926 8和0.883 7.测试集准确率与损失率曲线变化如图 7所示.

|

图 7 经预处理和学习率优化后,测试集的(a)准确率和(b)损失率曲线 Fig. 7 (a) Accuracy and (b) loss curves of the test set after image pre-processing and learning rate optimization |

在进行学习率优化的情况下,比较了不同网络模型对于预处理图像的分类效果,本文从最简单的分类模型LeNet开始,随着模型的结构不断演变发展,以复杂程度不断增大的顺序选取了目前较为常见的LeNet[27]、AlexNet[28]、VGG[29]、GoogleNet[30]四种分类模型与本文3D CNN分类模型进行对比,测试集结果对比如表 4所示.

| 表 4 不同网络模型的分类性能比较 Table 4 Comparison of classification performance with different network models |

由表 4可以看出,本文3D CNN分类模型相对于其他四种网络模型,准确率更高、损失率最低,相对于复杂网络,时间运行成本更低.为更加全面的评价所有对比模型,根据测试结果计算出的受试者操作特性(Receiver Operating Characteristic,ROC)曲线和曲线下面积(Area Under Curve,AUC)值做定量分析[31],并绘制在同一坐标系下,如图 8所示.可以看出本实验使用的3D CNN模型其ROC曲线最接近左上角,AUC最大,为0.913 4.

|

图 8 使用不同网络模型进行分类时,测试集的ROC曲线 Fig. 8 ROC curves of test set using different network models |

在桥小脑角区脑膜瘤与听神经瘤的临床诊断中,传统方式主要是以观察脑部磁共振图像为主,本文选取使用的T1W-SE图像能够较为清晰的辨别出脑部肿瘤区域与病症.利用深度学习方法对脑膜瘤与听神经瘤进行分类,由于脑部磁共振图像的特点和原始样本量的原因,若仅仅对原始数据集进行简单的分类训练将无法取得理想的效果,故针对原始图像主要采用CLAHE算法方法进行预处理.

在利用深度学习方法对脑部肿瘤分类时,选取不同的初始学习率会对分类过程产生不同的影响:当学习率较大时,虽然网络学习速度快,但是损失值易过大,且准确率震荡幅度较大;当学习率较小时,网络收敛速度慢且易出现过拟合现象.通常学习率选取范围为0.01~0.000 1.本文优化初始学习率后,使用学习率渐缓机制,在保证较快速度收敛的同时,减少了过拟合现象的发生,达到了较为优良的分类效果.

在对比分类模型对于原始图像与预处理图像分类效果的实验中,本文选取了0.000 5作为分类模型的初始学习率,其针对预处理后图像的分类效果明显,使脑膜瘤与听神经瘤分类准确率从0.819 7提升至0.918 0,性能优良,损失率基本稳定在0.9以下.但在选取其他初始准确率(0.000 1~0.005)的情况下做同样的对比实验发现,预处理图像分类效果仅有较小幅度提升,分类准确率只从0.819 7提升至0.868 2.同时在调整了CLAHE算法的参数后,分类模型的性能指标也出现了微弱变化.可以看出在运用CLAHE算法对原始图像进行预处理时,参数的选取具有一定的针对性.对于原始图像的处理不仅只是增强了磁共振图像的细节,同时也运用翻转等操作增加了数据集样本量,所有图像在输入进网络时都对图像进行了裁剪,以减少周围无关区域的干扰,在保证模型高性能指标的同时降低模型整体的训练时间.

在对比不同模型的分类性能实验中,模型的复杂程度对于分类过程也产生了比较明显的影响.较小的网络(如LeNet网络)训练一次全数据的时间虽短为10.61 s,但在相同学习率设置的情况下于150次左右即发生过拟合现象,且分类效果较差;复杂网络虽有较优学习率,但参数调试阶段以及训练过程耗时过长.而在对比模型分类效果时,因为ROC曲线下AUC越大,该模型分类效果越好.由表 4及图 8所示的ROC曲线可以看出,本文使用的3D CNN模型AUC面积最大,为0.913 4,其分类效果最好.

在观察模型整体训练结果时,发现分类模型对于脑膜瘤判别的准确率比听神经瘤判别的准确率要低10%~15%,其原因可能是多样的:通过对比数据集中脑膜瘤与听神经瘤磁共振图像,发现相比听神经瘤,脑膜瘤在肿瘤大小及图像纹理特征等方面都更加多样化,且病例数量少于听神经瘤,使得两者的分类准确率出现差异.

4 结论本文基于磁共振图像,建立3D CNN分类模型,实现了对桥小脑角区脑膜瘤与听神经瘤的有效判别,准确率高达0.918 0.相比以往人工判别方法[3, 11, 12],在保证诊断准确率的同时,实现了全自动判别,减少了人为因素干预,大大提高了诊断效率和可靠性.本文选择了T1W-SE图像对脑膜瘤与听神经瘤进行分类,在将来的工作中,可以结合多种序列图像分类结果,通过加权算法提升整体肿瘤分类判别准确率;并且若继续扩大数据集规模、完善病例数量比例,可以进一步提升分类模型的性能指标[32].

| [1] |

CHANG D S, XU C, CUI C P. MRI diagnosis of cerebellopontine angle tumors[J].

Chinese J PMI, 2014, 15(3): 190-193.

常东胜, 徐成, 崔翠萍. 桥小脑角区肿瘤的磁共振成像诊断[J]. 实用医学影像杂志, 2014, 15(3): 190-193. |

| [2] | NIU L, ZHOU X M, DUAN C F, et al. Differentiation researches on the meningioma subtypes by radiomics from contrast enhanced MRI, A preliminary study[J]. World Neurosurgery, 2019, 126: 646-652. |

| [3] |

LIU Z Y, SUN Z G, ZHANG X F. MRI diagnosis and differential diagnosis of meningioma, auditory neuroma and trigeminal nerve tumors in cerebellopontine angle area[J].

Chinese J Misdiagn, 2010, 10(30): 7390.

刘智勇, 孙志刚, 张秀芳. 桥小脑角区脑膜瘤、听神经瘤和三叉神经瘤的MRI诊断与鉴别诊断[J]. 中国误诊学杂志, 2010, 10(30): 7390. |

| [4] |

YE D Q, XU S H, HUANG Y C, et al. MRI diagnosis value of cerebellopontine angle tumor[J].

Chinese and Foreign Medical Research, 2017, 15(1): 50-51.

叶德湫, 许淑惠, 黄永础, 等. 桥小脑角区肿瘤的MRI诊断价值[J]. 中外医学研究, 2017, 15(1): 50-51. |

| [5] |

SHEN J H, ZHANG T, FANG L J, et al. Conventional MRI, DWI characteristics and immunocytochemistry of fibrous meningioma[J].

Chinese J Medical Image, 2016, 26(12): 2164-2167.

沈金花, 张涛, 方龙江, 等. 纤维型脑膜瘤的常规MRI、DWI及免疫组化分析[J]. 医学影像学杂志, 2016, 26(12): 2164-2167. |

| [6] | MENZE B H, JAKAB A, BAUER S, et al. The multimodal brain tumor image segmentation benchmark (BRATS)[J]. IEEE Trans Med Imaging, 2015, 34(10): 1993-2024. |

| [7] |

MA Y, GUO H, WANG Q S, et al. Correlations between morphological characteristics and expression levels of specific molecular biomarkers in glioblastoma[J].

Chinese J Magn Reson, 2018, 35(1): 22-30.

马芸, 郭虹, 王秋实, 等. 基于影像的形态学特征与胶质母细胞瘤特征分子表达的相关性研究[J]. 波谱学杂志, 2018, 35(1): 22-30. |

| [8] | 黄唯.脑肿瘤MRI图像分类与肝病理图像分级方法研究[D].广州: 南方医科大学, 2016. |

| [9] |

TANG X M. CT differential diagnosis of meningioma involving the internal auditory canal and acoustic neuroma[J].

Guide of China Medicine, 2014, 12(27): 218-219.

唐宪明. 桥小脑角区脑膜瘤累及内听道与听神经瘤的CT鉴别诊断[J]. 中国医药指南, 2014, 12(27): 218-219. |

| [10] |

CHEN L, ZHANG C, TONG M L, et al. Analysis of the differential diagnosis of meningioma and auditory neuroma in the cerebellar horn area by MRI[J].

Contemporary Medicine Forum, 2016, 14(22): 134-136.

陈玲, 张超, 童梦玲, 等. 用MRI检查对桥小脑角区脑膜瘤和听神经瘤进行鉴别诊断的效果分析[J]. 当代医药论丛, 2016, 14(22): 134-136. |

| [11] |

PING X X, MENG Q, TIAN X, et al. MRI findings of lesions in the cerebellopontine angle[J].

Chinese J Medical Image, 2014, 24(1): 12-15, 20.

平小夏, 孟倩, 田霞, 等. 桥小脑角区病变的MRI表现[J]. 医学影像学杂志, 2014, 24(1): 12-15, 20. |

| [12] |

ZHANG M, ZHANG H Q. Application of MRI in diagnosis of cerebellopontine angle tumor and its clinical value[J].

Medical Innovation of China, 2018, 15(34): 25-29.

张敏, 张海青. MRI在桥小脑角区肿瘤患者病情诊断中的应用及其临床价值分析[J]. 中国医学创新, 2018, 15(34): 25-29. |

| [13] | SONG I, KIM H J, JEON P B. Deep learning for real-time robust facial expression recognition on a smartphone[C]. Las Vegas: 2014 IEEE International Conference on Consumer Electronics (ICCE), 2014. |

| [14] | PAYAN A, MONTANA G. Predicting Alzheimer's disease:a neuroimaging study with 3D convolutional neural networks[J]. Computer Science, 2015. |

| [15] | GUPTA A, MAIDA A S, AYHAN M S. Natural image bases to represent neuroimaging data[C]. Atlanta: Proceedings of the 30th international conference on machine learning, 2013: 987-994. |

| [16] | SOOMRO M H, DE COLA G, CONFORTO S, et al. Automatic segmentation of colorectal cancer in 3D MRI by combining deep learning and 3D level-set algorithm-a preliminary study[C]. Tunis: 2018 IEEE 4th Middle East Conference on Biomedical Engineering (MECBME), 2018. |

| [17] |

LIANG C X, LI M Q, BIAN Z Y, et al. Establishment of a deep feature-based classification model for distinguishing benign and malignant[J].

J Southern Medical University, 2019, 39(1): 88-92.

梁翠霞, 李明强, 边兆英, 等. 基于深度学习特征的乳腺肿瘤分类模型评估[J]. 南方医科大学学报, 2019, 39(1): 88-92. |

| [18] | LING Z G, LIANG Y, WANG Y N, et al. Adaptive extended piecewise histogram equalisation for dark image enhancement[J]. IET Image Processing, 2015, 9(11): 1012-1019. |

| [19] | KHAN R, TALHA M, KHATTAK A S, et al. Realization of balanced contrast limited adaptive histogram equalization (B-CLAHE) for adaptive dynamic range compression of real time medical images[C]. Islamabad: Proceedings of 201310th International Bhurban Conference on Applied Sciences & Technology (IBCAST), 2013. |

| [20] | MAGUDEESWARAN V, FENSHIA SINGH J. Contrast limited fuzzy adaptive histogram equalization for enhancement of brain images[J]. Int J Imag Syst Tech, 2017, 27(1): 98-103. |

| [21] | PENG S L, JIANG H Y, WANG H X, et al. Modulation classification using convolutional neural network based deep learning model[C]. Newark: 201726th Wireless and Optical Communication Conference (WOCC), 2017. |

| [22] | CHUMERIN N. Convolutional neural network[M]//KIM P. MATLAB deep learning. Apress, Berkeley, CA. 2017: 121-147. |

| [23] | CS231n. Convolutional Neural Networks for Visual Recognition[OL]. 2019. http://cs231n.github.io/. |

| [24] | IOFFE S, SZEGEDY C. Batch normalization: accelerating deep network training by reducing internal covariate shift[C]. Lille: ICML'15 Proceedings of the 32nd International Conference on International Conference on Machine Learning, 2015, 37: 448-456. |

| [25] | KRIZHEVSKY A, SUTSKEVER I, HINTON G E, et al. ImageNet classification with deep convolutional neural networks[C]. Lake Tahoe: NIPS'12 Proceedings of the 25th International Conference on Neural Information Processing Systems, 2012, 1: 1097-1105. |

| [26] | GOLD S, RANGARAJAN A. Softmax to softassign:neural network algorithms for combinatorial optimization[J]. Journal of Artificial Neural Network, 1995, 2(4): 381-399. |

| [27] | EL-SAWY, EL-BAKRY H, LOEY M. CNN for handwritten arabic digits recognition based on LeNet-5[C]. International Conference on Advanced Intelligent Systems and Informatics AISI 2016: Proceedings of the International Conference on Advanced Intelligent Systems and Informatics, 2016: 566-575. |

| [28] | ALOM M Z, TAHA T M, YAKOPCIC C, et al. The history began from AlexNet: A comprehensive survey on deep learning approaches[J]. 2018: arXiv: 1803.01164 |

| [29] | SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[J]. Computer Science, 2014: arXiv: 1409.1556. |

| [30] | BALLESTER P, ARAUJO R M. On the performance of GoogLeNet and AlexNet applied to sketches[C]. Phoenix: AAAI'16 Proceedings of the Thirtieth AAAI Conference on Artificial Intelligence, 2016: 1124-1128. |

| [31] |

QIN F, YANG B, CHENG Z K. Research on measure criteria in evaluating classification performance[J].

Computer Technology and Development, 2006, 16(10): 85-88.

秦锋, 杨波, 程泽凯. 分类器性能评价标准研究[J]. 计算机技术与发展, 2006, 16(10): 85-88. |

| [32] |

WANG H Z, ZHAO D, YANG L Q, et al. An approach for training data enrichment and batch labeling in AI+MRI aided diagnosis[J].

Chinese J Magn Reson, 2018, 35(4): 50-59.

汪红志, 赵地, 杨丽琴, 等. 基于AI+MRI的影像诊断的样本增广与批量标注方法[J]. 波谱学杂志, 2018, 35(4): 50-59. |

2020, Vol. 37

2020, Vol. 37