② 中国石油大学(北京)地球物理学院,北京 102249

② College of Geopgysics, China University of Petroleum (Beijing), Beijing 102249, China

地震资料不可避免地受到不同类型噪声的影响,严重影响有效信号的识别,因此压制随机噪声是地震资料处理的重要步骤之一[1]。地震资料噪声压制方法主要分为三类:第一类是空间域滤波方法,如中值滤波[2]和均值滤波[3];第二类是变换域滤波方法,包括小波变换[4-6]、Curvelet变换[7-8]、FX域反褶积[9]等,其主要思想是对地震数据进行变换,然后在变换域设置阈值分离信号与噪声,最后通过反变换将地震数据转换到原始空间域,以此实现噪声的去除;第三类是基于矩阵降秩的稀疏表示去噪方法,如奇异值分解(SVD)[10-11],是对地震数据进行稀疏表示,将较大的系数视为有效信号,较小的系数视为噪声,通过抑制较小的系数可以有效去除噪声,提高地震资料的信噪比。

上述方法虽然在随机噪声压制上均能取得一定的效果,但难以保证在去噪的同时不损伤有效信号,且效率低。为此,需要将其他领域的新方法引入地震资料的噪声压制。

近年来,深度学习方法在图像去噪领域得到了快速发展,其中卷积神经网络(CNN)[12]是目前最流行并被广泛使用的算法之一。Jain等[13]使用CNN抑制图像噪声,该方法采用逐层训练的方式,收敛较快,去噪效果优于小波变换。Burger等[14]将多层感知器(MLP)应用于图像噪声压制,对特定噪声水平的图像去噪效果较好。王琪琪等[15]将MLP用于去除地震数据中的随机噪声,相比曲波方法能更充分地保护细节信息。Xie等[16]首次运用编解码技术和堆叠式自动编码器(SSDA)去除高斯噪声,达到了学习稀疏特征的目的,具有较高的训练精度。Zhang等[17]提出了去噪卷积神经网络(DnCNN),对于一般图像具有较好的去噪效果。韩卫雪等[18]和Wang等[19]将DnCNN应用于地震数据的随机噪声压制,去噪后的同相轴清晰连贯,克服了传统去噪方法导致的伪影问题;Dong等[20]引入高阶统计量优化DnCNN的参数,使之适用于压制沙漠地震资料中的低频噪声。针对ReLU函数导致有效信息丢失的问题,Yang等[21]在迭代过程中使用ELU激活函数增强网络的鲁棒性,有效抑制了地震数据中各种强度的随机噪声。Zheng等[22]应用基于DnCNN的去噪方法衰减一维微地震数据的随机噪声;李海山等[23]借鉴深度残差网络原理设计了一种深层网络,有效压制了叠前地震记录中的随机噪声;Yang等[24]提出自适应CNN,更加有效地衰减随机噪声并重建地震波形。

但是地震资料中包含地质结构和岩性信息,而以上网络均采用单一的卷积核尺寸,不能充分有效地利用地震信号邻域信息,仅能够提取数据中有限的局部特征信息,容易造成边缘部分纹理细节的损失。针对这一问题,本文提出一种双通道卷积神经网络压制地震资料中的随机噪声。该网络通过两个不同结构的子网络提取更丰富的特征,同时通过引入空洞卷积(Dilated Convolution,DConv)的方式,增大感受野,从而捕捉到更丰富的地震信号邻域信息,在去噪的同时不损伤有效信号。

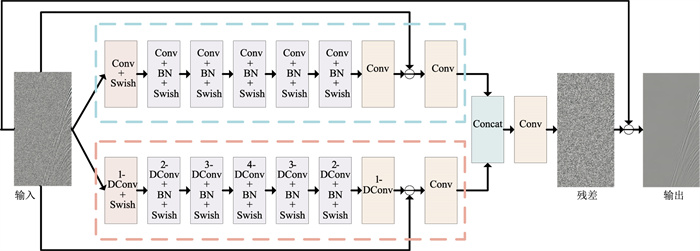

1 基本原理 1.1 网络结构一般来说,不同的网络结构可以提取到不同的特征[25],若能将不同网络提取的不同特征应用于噪声压制,能够提升最终去噪效果。Tian[26]等采用双通道策略在图像去噪方面取得了不错的效果。因此,本文设计了一种包含两个不同子网络的双通道卷积神经网络(SDC-CNN),如图 1所示。

|

图 1 双通道卷积神经网络结构 |

SDC-CNN中的两个子网络均包含卷积(Conv)、批量归一化(BN)和Swish激活函数单元。其中,BN单元可以有效解决内部协变量偏移问题,有效防止网络深而导致的梯度消失或梯度爆炸。Swish激活函数单元用于向神经网络中加入非线性因素,提高模型的表达能力。上通道子网络的深度为8层,第1层由Conv和Swish单元组成。第2~第6层在Conv与Swish单元间加入了BN单元。第7层和第8层只包含Conv单元。该子网络每一层的卷积核尺寸都是3×3。下通道子网络的深度也为8层,与上通道子网络不同的是,该子网络引入了DConv。由于简单叠加相同扩张率的DConv会带来棋盘效应,本文将不同扩张率的DConv组合使用,从而学习到更多的邻域信息。该子网络每一层的卷积核尺寸也都为3×3,第1层由1-DConv(扩张率为1的DConv)和Swish单元组成。第2~第6层分别由扩张率为2、3、4、3、2的DConv(相当于尺寸分别为5×5、7×7、9×9、7×7、5×5的卷积核)、BN和Swish单元组成。第7层和第8层与上通道子网络一样,只包含卷积单元,且扩张率为1,相当于尺寸为3×3的标准卷积。

此外,在本文所提出的SDC-CNN网络中,使用残差学习的思想学习原始含噪地震数据与经过网络处理后的“干净”数据之间的残差,将两个子网络的输出进行特征融合(Concatenate),即图 1中的Concat层,然后将原始输入减去融合后的残差,从而得到压制噪声后的地震数据。这种残差学习策略可以解决网络深度增加导致的训练精度下降问题,并能加快网络的收敛。

1.2 空洞卷积使用标准卷积时,第l层感受野尺寸的计算公式为

| $ R_{l}=\left(R_{l-1}-1\right) S_{l}+k_{l} $ | (1) |

式中:Rl为第l层的感受野尺寸;Sl为第l层卷积核的移动步长;kl表示第l层的卷积核尺寸。与标准卷积有所区别,DConv多了一个超参数——“扩张率(Dilation Rate)”,该参数表示卷积核处理数据时各值的间距。DConv扩大感受野的本质是它在原始卷积核中使用了零填充操作,而这些零元素并不参与卷积运算。因此,引入DConv后第l层等效的普通卷积核尺寸Kl与原始卷积核尺寸kl之间的关系为

| $ K_{l}=\left(k_{l}-1\right)(d-1)+k_{l} $ | (2) |

式中d表示第l层的卷积核的扩张率。则引入DConv后的第l层感受野尺寸Rld可表示为

| $ R_{l}^{\mathrm{d}}=\left(R_{l-1}^{\mathrm{d}}-1\right) S_{l}^{\mathrm{d}}+K_{l} $ | (3) |

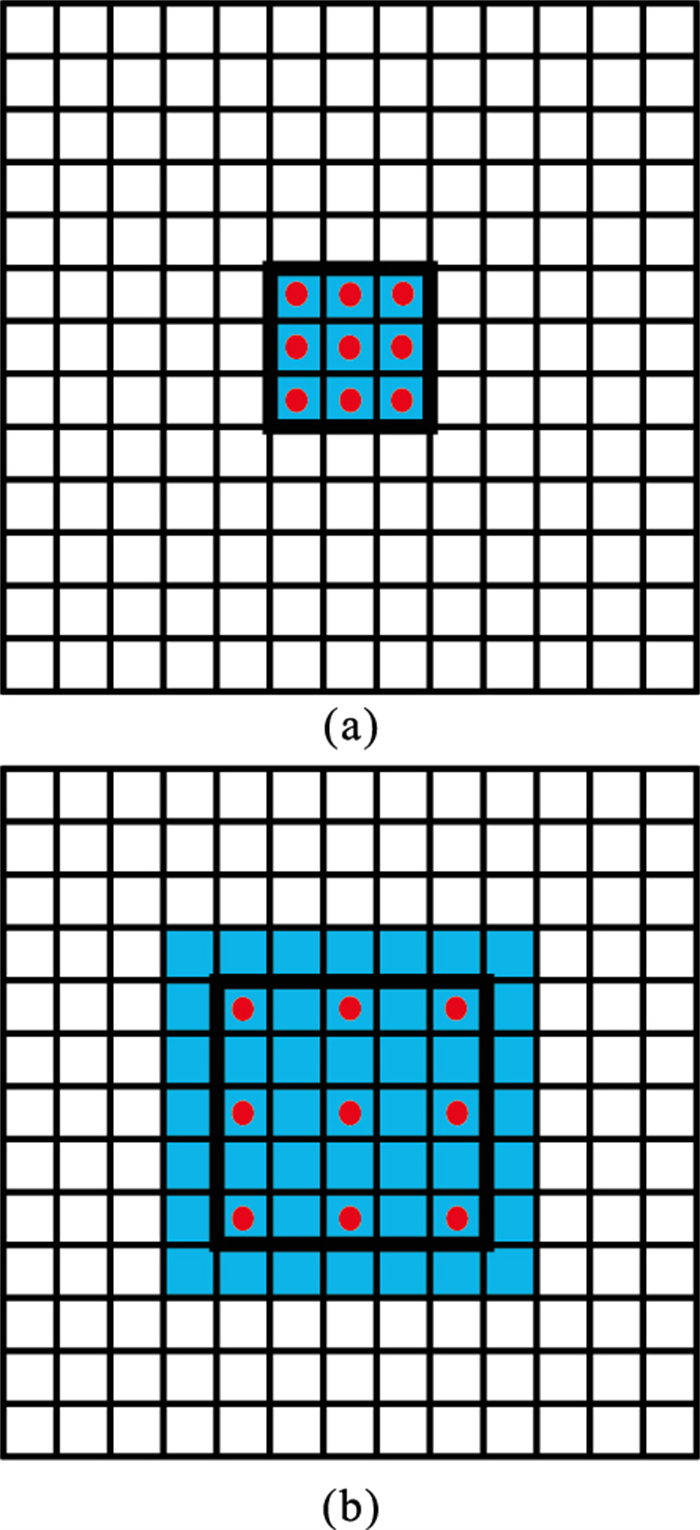

式中:Sld为第l层中DConv核的移动步长。以3×3的卷积核为例,根据式(1)~式(3)表达的扩张率与感受野之间的关系(步长均为1)如图 2所示。

|

图 2 卷积核尺寸与感受野的关系示意图 (a)扩张率d=1的标准卷积;(b)扩张率d=2的DConv |

图 2a和图 2b分别是扩张率为1的标准卷积和扩张率为2的DConv感受野的关系示意图,其中图 2b的红色部分为DConv参与计算的像素。根据式(2),当d=1时,原始卷积核的尺寸为3×3(图 2a黑色矩形框),相当于标准卷积。当d=2时,等效的普通卷积核尺寸为5×5(图 2b黑色矩形框),根据式(3)可得到对应的感受野尺寸为7×7(图 2b蓝色区域)。由式(1)可知,在第三层才能得到7×7的感受野。因此,DConv可以在不增加参数的情况下扩大感受野,捕获上下文的多尺度信息。而且地震资料中道与道之间的有效信号具有相似性,若能够充分利用邻域信息,神经网络则可以更精确地区分地震资料中的有效信号与噪声,有利于保护有效信号。

1.3 残差学习在一定程度上,网络的表达能力与其深度成正比,而随着网络深度的增加,网络训练的效率会降低,带来梯度弥散、梯度爆炸等与网络优化相关的问题。为此,He等[27]提出了残差网络。

含有随机噪声的地震数据可表示为

| $ \boldsymbol{d}=\boldsymbol{s}+\boldsymbol{n} $ | (4) |

式中:s表示理想地震信号;n表示随机噪声。通过残差学习策略训练残差映射r(d)≈n预测噪声,然后用输入的含噪地震数据减去预测噪声估计理想地震数据

| $ L(\boldsymbol{\theta})=\frac{1}{N} \sum\limits_{i=1}^{N}\left\|\boldsymbol{r}\left(\boldsymbol{d}_{i} ; \boldsymbol{\theta}\right)-\left(\boldsymbol{d}_{i}-\boldsymbol{s}_{i}\right)\right\|_{2}^{2} $ | (5) |

式中:N为含噪地震图像块的数量;θ为网络模型参数集;r(·)表示网络预测的残差;d-s为期望的残差。在本文的双通道卷积神经网络中,将两个子网络的输出进行特征融合,然后将原始输入减去融合后的残差,从而得到压制噪声后的地震数据。

1.4 Swish激活函数Swish[28]是一种新的激活函数,定义为

| $ g(z)=z \sigma(\beta z) $ | (6) |

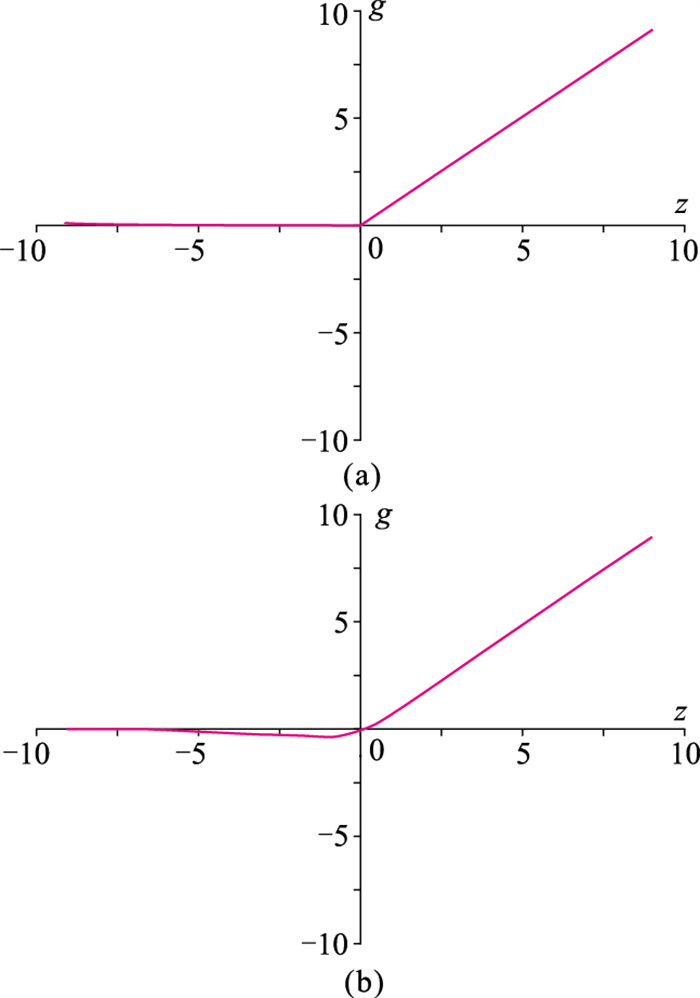

式中:σ(z)=(1+e-z)-1为Sigmoid函数,其中z为Swish激活函数的输入;β是一个可训练的参数。ReLU激活函数具有稀疏性的特点,能够解决反向传播过程中可能出现的梯度消失问题,被多次使用在深度学习中。但是,ReLU函数的输出值和梯度值在z < 0的区域内恒等于0(图 3a),可能导致权重无法更新,即出现神经元“死亡”现象。而Swish激活函数在负半轴的输出值无限逼近零但不会等于零(图 3b),并且Swish激活函数具有平滑和非单调的特点,可以有效克服网络训练时产生的神经元“死亡”现象,提高网络的性能。

|

图 3 RelU激活函数(a)和Swish激活函数(b)的对比 |

分别对加入不同强度高斯随机噪声的地震数据进行训练,保存训练好的网络模型,并对含有不同噪声强度的地震数据进行测试。采用自适应矩估计(Adam)优化模型参数,初始学习率设置为0.001,迭代30次。

将本文提出的SDC-CNN应用于模拟地震数据和实际地震资料,并与FX域反褶积、Curvelet变换、U-Net方法、DnCNN方法以及本文网络模型中的下通道子网络进行对比。使用信噪比(SNR)、峰值信噪比(PSNR)以及均方根误差(RMSE)三个指标评估不同方法去噪效果。SNR和PSNR的表达式为

| $ {\rm{SNR }} = 10\lg \frac{{{{\left\| \mathit{\boldsymbol{s}} \right\|}_2}}}{{{{\left\| {\mathit{\boldsymbol{s}} - \mathit{\boldsymbol{\hat s}}} \right\|}_2}}} $ | (7) |

| $ \mathrm{PSNR} =10 \lg \frac{\mathrm{MAX}^{2}(\boldsymbol{s})}{\mathrm{MSE}} $ | (8) |

式中:MAX2(s)表示无噪图像最大值的平方;MSE为原始数据与处理后的数据的均方误差

| $ \operatorname{MSE}=\frac{1}{I J} \sum\limits_{i=0}^{I-1} \sum\limits_{j=0}^{J-1}[s(i, j)-\hat{s}(i, j)]^{2} $ | (9) |

式中I、J分别为地震数据的道数和样点数。则均方根误差为

| $ \mathrm{RMSE}=\sqrt{\mathrm{MSE}} $ | (10) |

应用Ricker子波通过Matlab平台模拟四个反射界面的CMP道集,每个道集200道,时间采样间隔为4ms。四个界面的初始零炮检距双程旅行时分别为0.10、0.40、0.65、0.90s,对应的均方根速度分别为950、1000、1100、1200m/s。各界面零炮检距双程旅行时的最大浮动量为0.1s,均方根速度的最大浮动量为100m/s,Ricker子波峰值频率在20~35Hz变化,共合成500个道集,其中400个道集作为训练集,其余100个道集作为测试集。为提取更丰富的细节特征,将训练集中的地震数据进行随机翻转、任意角度旋转等操作,按照尺寸为40×40、移动步长为10的方式进行裁剪,最终得到71.04万个40×40的数据块。

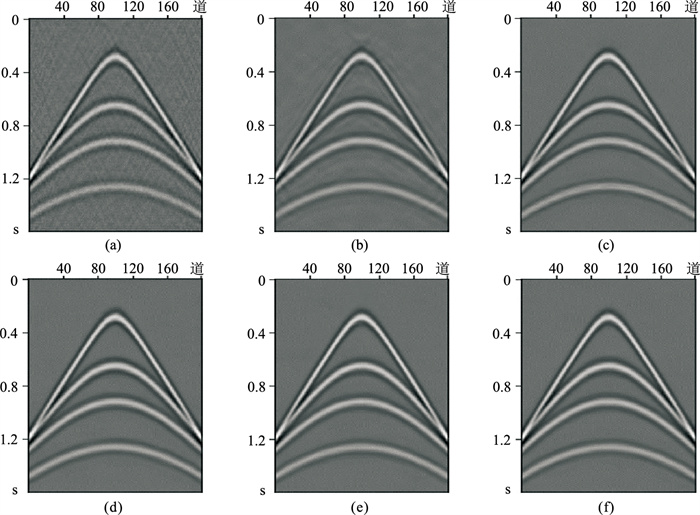

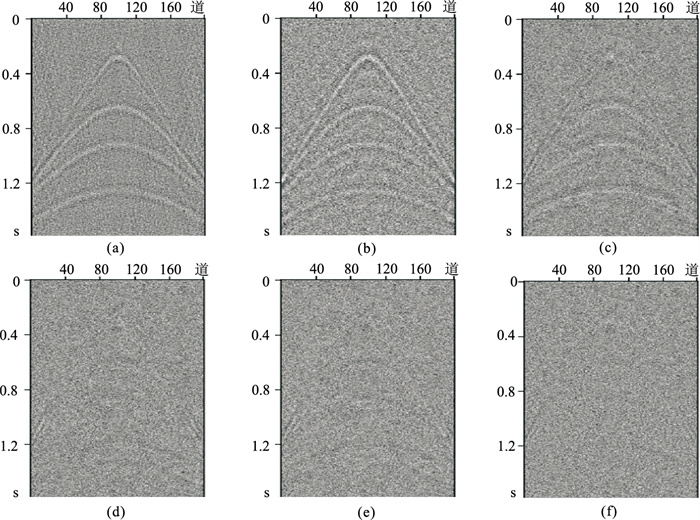

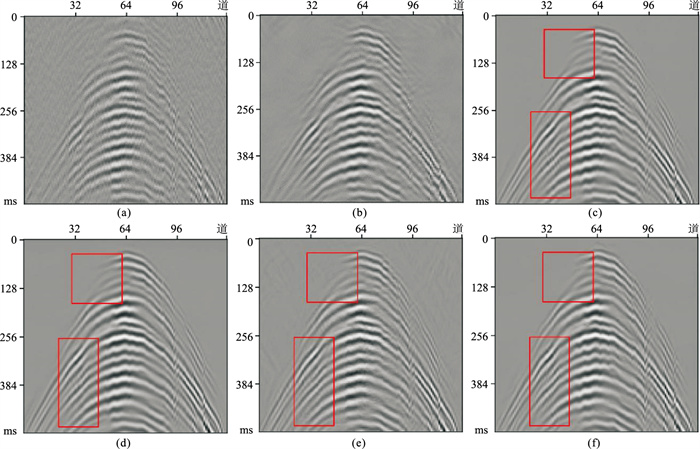

对于图 4a所示的合成CMP道集,加入强度为15的高斯随机噪声后如图 4b所示。图 5为图 4b数据不同方法的噪声压制结果,图 6为对应的残差剖面。FX域反褶积在压制随机噪声的同时,衰减了同相轴的能量(图 5a、图 6a);Curvelet变换的去噪结果的同相轴附近出现较多伪影,其残差含部分有效信号(图 5b、图 6b);与传统算法相比,U-Net卷积神经网络滤波效果较好,但同相轴的能量有较大损失(图 5c、图 6c)。DnCNN方法(图 5d)、本文的下通道子网络(图 5e)以及本文方法(图 5f)对噪声的压制更彻底,由残差剖面可以看出,本文方法比DnCNN方法保留了更多的有效信息(图 6d、图 6f)。由表 1可以看出,本文方法噪声压制结果的PSNR、SNR和RMSE均优于其他方法。

|

图 4 合成原始数据(a)及其加噪结果(b) |

|

图 5 合成数据不同算法去噪结果 (a)FX域反褶积;(b)Curvelet变换;(c)U-Net方法;(d)DnCNN方法;(e)本文下通道子网络;(f)本文方法 |

|

图 6 合成数据不同算法去噪结果与原始数据的残差对比 (a)FX域反褶积;(b)Curvelet变换;(c)U-Net方法;(d)DnCNN方法;(e)本文下通道子网络;(f)本文方法 |

|

|

表 1 不同算法对加入噪声强度为15的CMP道集噪声压制结果统计 |

对于噪声强度分别为15、25、35、45和55的CMP道集,上述六种算法压制结果的信噪比统计如表 2所示。可以看出,无论噪声强度大小,本文方法的信噪比最高、压制效果最好。

|

|

表 2 不同算法对加入不同噪声强度的CMP道集噪声压制后信噪比 |

为进一步验证本文算法的适用性,将以上去噪算法应用到SEG官网公开的实际地震资料。将该数据进行裁剪得到1001个切片数据,每个切片数据有120道,时间采样间隔为4ms,样点数为240。将其中801个切片数据以相同方式进行翻转、旋转等操作,再裁剪得到38.1276万个40×40的数据块作为训练集,将剩下的200个切片数据作为测试集。

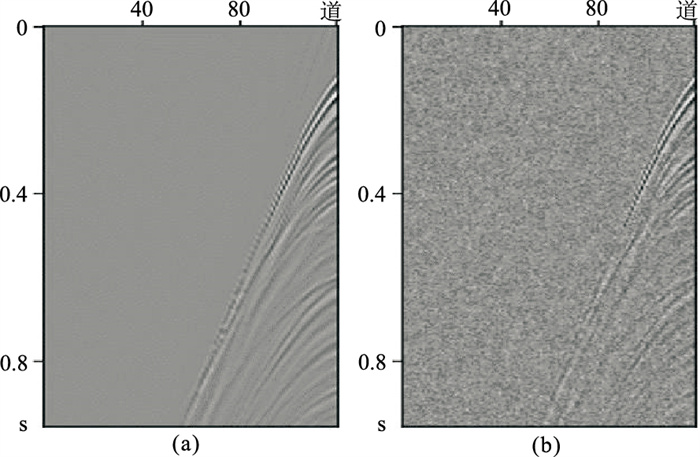

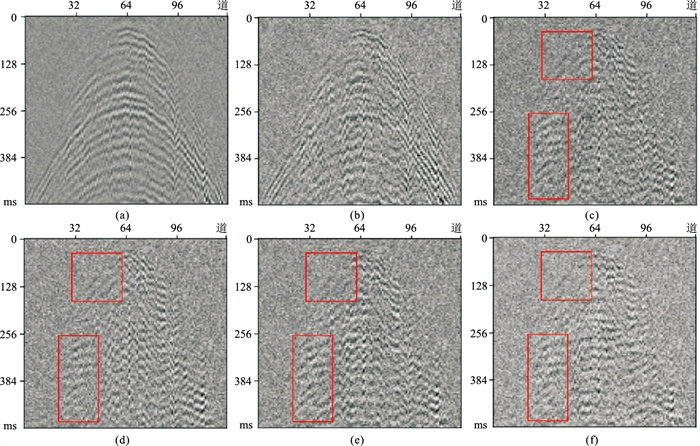

图 7a为不含噪声的原始道集,图 7b为加入强度为15的高斯随机噪声后的结果,可见弱信号几乎被噪声淹没。图 8为上述六种方法对图 7b数据的噪声压制结果,图 9为对应的残差剖面。由图可见:FX域反褶积(图 8a)和Curvelet变换方法(图 8b)去噪结果中出现明显的伪影,去除噪声不充分,且丢失了较多的有效信息(图 9a、图 9b);U-Net卷积神经网络对随机噪声的压制更彻底(图 8c),但在一定程度上损伤了有效信号(图 9c);DnCNN方法更具优势(图 8d),但在残差剖面仍可以看见部分有效信息(图 9d);而本文方法的去噪结果更加接近原始地震资料,且残差剖面中几乎不包含有效信号,从图 8f和图 9f中的红色矩形框区域可以看出本文方法对弱信号恢复得较好;本文的下通道子网络也取得不错的去噪效果,但是在部分微弱信号区域(图 8e和图 9e红色矩形框区域),从去噪结果和去噪残差可见丢失了一些有效信息,说明双通道卷积神经网络(本文方法)可以学习到更充分的有效信息。

|

图 7 预处理后实际地震数据(a)及其加噪结果(b) |

|

图 8 预处理后实际地震数据不同算法去噪结果对比 (a)FX域反褶积;(b)Curvelet变换;(c)U-Net方法;(d)DnCNN方法;(e)本文下通道子网络;(f)本文方法 |

|

图 9 预处理后实际地震数据不同算法去噪结果与原始数据的残差对比 (a)FX域反褶积;(b)Curvelet变换;(c)U-Net方法;(d)DnCNN方法;(e)本文下通道子网络;(f)本文方法 |

表 3列出了不同算法对加入强度为15的噪声的实际地震资料去噪结果的指标对比,可见本文方法去噪结果的PSNR、SNR和RMSE三个指标均优于其他算法。与传统算法和DnCNN方法相比,本文方法在压制地震资料随机噪声和保护微弱有效信号方面均展现出更好的效果。

|

|

表 3 不同算法对加入强度为15噪声的实际地震资料去噪结果统计 |

对加入强度分别为15、25、35、45和55的高斯随机噪声后的实际地震资料,不同算法噪声压制后的SNR统计如表 4所示,可见:无论噪声强度大小,本文方法噪声压制结果的SNR均最高;与仅使用下通道子网络去噪相比,本文双通道网络改善了去噪效果。

|

|

表 4 不同算法对加入不同强度噪声的实际资料噪声压制后信噪比 |

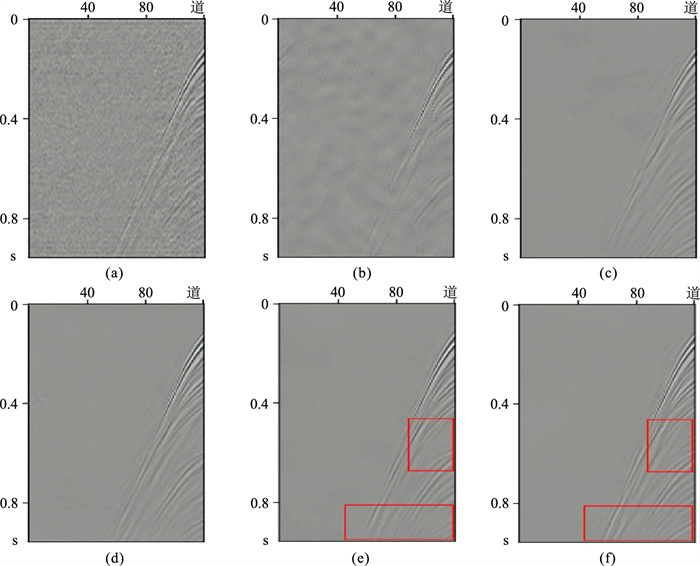

截取的部分实际地震资料(图 10)共128道,每道128个样点,采样间隔为4ms。受到随机噪声的干扰,原始道集同相轴不清晰、不连续,能量较弱的有效信号难以识别。图 11为上述六种方法的去噪结果,图 12为对应的残差剖面。

|

图 10 实际原始叠前地震道集 |

|

图 11 实际原始叠前地震资料不同算法去噪结果对比 (a)FX域反褶积;(b)Curvelet变换;(c)U-Net方法;(d)DnCNN方法;(e)本文下通道子网络;(f)本文方法 |

|

图 12 实际原始叠前地震资料不同算法去噪残差对比 (a)FX域反褶积;(b)Curvelet变换;(c)U-Net方法;(d)DnCNN方法;(e)本文下通道子网络;(f)本文方法 |

从图 11、图 12可以看出:FX域反褶积法去噪结果中仍包含较多噪声,噪声压制不明显,且丢失了较多有效信息(图 11a、图 12b);经Curvelet变换处理后,去除了大部分噪声,但残差剖面含有较多有效信号(图 11b、图 12b);U-Net卷积神经网络对随机噪声的压制相对传统方法更好,但在一定程度上损伤有效信号尤其是红色方框内的弱信号(图 11c、图 12c);经DnCNN方法压制噪声后,随机噪声得到有效去除,有效信号也得到了更充分保留,但从去噪结果和残差剖面可观察到,红色框内的弱有效信号与随机噪声一同被压制(图 11d、图 12d);本文下通道子网络方法和本文方法对随机噪声去除得更彻底,纹理细节部分也得到保护,但在红色标记区域内,本文方法结果的同相轴更连续(图 11e、图 11f),残差道集上有效信息更少,有利于对弱信号的保护(图 12e、图 12f)。

因此,与其他方法相比,本文方法在对地震资料随机噪声的压制和有效细节信息的保护方面更具优势。

3 结束语本文提出了一种双通道卷积神经网络用于地震资料随机噪声压制。该网络采用增加宽度的策略,构造两个不同的子网络学习数据中的互补信息;在下通道子网络中引入空洞卷积,使特征图中包含更多的邻域信息,并结合残差学习的优势,在去除噪声的同时保留了更丰富的细节信息,提高了信、噪有效分离能力。模型CMP数据和实际地震资料处理结果均表明,本文提出的双通道卷积神经网络方法对随机噪声的压制更彻底,保留的细节信息更丰富。

| [1] |

YILMAZ Ö, TANIR I, GREGORY C, et al. Interpretive imaging of seismic data[J]. The Leading Edge, 2001, 20(2): 132-144. |

| [2] |

刘财, 王典, 刘洋, 等. 二维多级中值滤波技术在随机噪声消除中的应用初探[J]. 石油地球物理勘探, 2005, 40(2): 163-167. LIU Cai, WANG Dian, LIU Yang, et al. Preliminary study of using 2D multi-level median filtering technique to eliminate random noises[J]. Oil Geophysical Prospecting, 2005, 40(2): 163-167. |

| [3] |

BONAR D, SACCHI M. Denoising seismic data using the nonlocal means algorithm[J]. Geophysics, 2012, 77(1): A5-A8. |

| [4] |

CAO S Y, CHEN X P. The second-generation wavelet transform and its application in denoising of seismic data[J]. Applied Geophysics, 2005, 2(2): 70-74. |

| [5] |

吴招才, 刘天佑. 地震数据去噪中的小波方法[J]. 地球物理学进展, 2008, 23(2): 493-499. WU Zhaocai, LIU Tianyou. Wavelet transform me-thods in seismic data noise attenuation[J]. Progress in Geophysics, 2008, 23(2): 493-499. |

| [6] |

汪金菊, 袁力, 刘婉如, 等. 地震信号随机噪声压制的双树复小波域双变量方法[J]. 地球物理学报, 2016, 59(8): 3046-3055. WANG Jinju, YUAN Li, LIU Wanru, et al. Dual-tree complex wavelet domain bivariate method for seismic signal random noise attenuation[J]. Chinese Journal of Geophysics, 2016, 59(8): 3046-3055. |

| [7] |

HENNENFENT G, HERRMANN F J. Seismic denoising with nonuniformly sampled curvelets[J]. Computing in Science & Engineering, 2006, 8(3): 16-25. |

| [8] |

孙成禹, 刁俊才, 李文静. 基于曲波噪声估计的三维块匹配地震资料去噪[J]. 石油地球物理勘探, 2019, 54(6): 1188-1194. SUN Chengyu, DIAO Juncai, LI Wenjing. 3D block matching seismic data denoising based on Curvelet noise estimation[J]. Oil Geophysical Prospecting, 2019, 54(6): 1188-1194. |

| [9] |

CANALES L L. Random noise reduction[C]. SEG Technical Program Expanded Abstracts, 1984, 3: 525-527.

|

| [10] |

陆文凯, 李衍达. SVD分解提高地震资料的信噪比和分辨率[J]. 石油地球物理勘探, 1998, 33(增刊1): 145-149. LU Wenkai, LI Yanda. A SVD method to improve SNR and resolution[J]. Oil Geophysical Prospecting, 1998, 33(S1): 145-149. |

| [11] |

XU Y K, CAO S Y, PAN X. Random noise attenuation using a structure-oriented weighted singular va-lue decomposition[J]. Studia Geophysica et Geodaetica, 2019, 63(4): 554-568. DOI:10.1007/s11200-019-0723-8 |

| [12] |

LECUN Y, BOTTOU L, BENGIO Y, et al. Gradient-based learning applied to document recognition[J]. Proceedings of the IEEE, 1998, 86(11): 2278-2324. DOI:10.1109/5.726791 |

| [13] |

JAIN V, SEUNG H S. Natural image denoising with convolutional networks[C]. Proceedings of the 21st International Conference on Neural Information Processing Systems, 2008, 769-776.

|

| [14] |

BURGER H C, SCHULER C J, HARMELING S. Image denoising: can plain neural networks compete with BM3D?[C]. 2012 IEEE Conference on Computer Vision and Pattern Recognition, 2012, 2392-2399.

|

| [15] |

王琪琪, 汤井田, 张良, 等. 利用多层感知机的地震数据去噪[J]. 石油地球物理勘探, 2020, 55(2): 272-281. WANG Qiqi, TANG Jingtian, ZHANG Liang, et al. Seismic data denoising based on multi-layer perceptron[J]. Oil Geophysical Prospecting, 2020, 55(2): 272-281. |

| [16] |

XIE J Y, XU L L, CHEN E H. Image denoising and inpainting with deep neural networks[C]. Procee-dings of the 25th International Conference on Neural Information Processing Systems, 2012, 341-349.

|

| [17] |

ZHANG K, ZUO W M, CHEN Y J, et al. Beyond a Gaussian denoiser: residual learning of deep CNN for image denoising[J]. IEEE Transactions on Image Processing, 2017, 26(7): 3142-3155. DOI:10.1109/TIP.2017.2662206 |

| [18] |

韩卫雪, 周亚同, 池越. 基于深度学习卷积神经网络的地震数据随机噪声去除[J]. 石油物探, 2018, 57(6): 862-869, 877. HAN Weixue, ZHOU Yatong, CHI Yue. Deep lear-ning convolutional neural networks for random noise attenuation in seismic data[J]. Geophysical Prospecting for Petroleum, 2018, 57(6): 862-869, 877. DOI:10.3969/j.issn.1000-1441.2018.06.008 |

| [19] |

WANG F, CHEN S C. Residual learning of deep convolutional neural network for seismic random noise attenuation[J]. IEEE Geoscience and Remote Sensing Letters, 2019, 16(8): 1314-1318. DOI:10.1109/LGRS.2019.2895702 |

| [20] |

DONG X T, LI Y, YANG B J. Desert low-frequency noise suppression by using adaptive DnCNNs based on the determination of high-order statistic[J]. Geophysical Journal International, 2019, 219(2): 1281-1299. |

| [21] |

YANG L Q, CHEN W, LIU W, et al. Random noise attenuation based on residual convolutional neural network in seismic datasets[J]. IEEE Access, 2020, 8: 30271-30286. |

| [22] |

ZHENG J, JIANG T Q, WU Z X, et al. Application of residual learning to microseismic random noise attenuation[J]. Acta Geophysica, 2021, 69(4): 1151-1161. |

| [23] |

李海山, 陈德武, 吴杰, 等. 叠前随机噪声深度残差网络压制方法[J]. 石油地球物理勘探, 2020, 55(3): 493-503. LI Haishan, CHEN Dewu, WU Jie, et al. Pre-stack random noise suppression with deep residual network[J]. Oil Geophysical Prospecting, 2020, 55(3): 493-503. |

| [24] |

YANG L Q, CHEN W, WANG H, et al. Deep lear-ning seismic random noise attenuation via improved residual convolutional neural network[J]. IEEE Transactions on Geoscience and Remote Sensing, 2021, 59(9): 7968-7981. |

| [25] |

ZHANG Y L, TIAN Y P, KONG Y, et al. Residual dense network for image super-resolution[C]. 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2018, 2472-2481.

|

| [26] |

TIAN C W, XU Y, ZUO W M. Image denoising using deep CNN with batch renormalization[J]. Neural Networks, 2020, 121: 461-473. |

| [27] |

HE K M, ZHANG X Y, REN S Q, et al. Deep resi-dual learning for image recognition[C]. 2016 IEEE Conference on Computer Vision and Pattern Recognition(CVPR), 2016, 770-778.

|

| [28] |

RAMACHANDRAN P, ZOPH B, LE Q V. Swish: a self-gated activation function[J]. Neural and Evolutionary Computing, 2017, 7(1): 5-17. |

北京市昌平区府学路18号中国石油大学(北京)信息科学与工程学院,102249。Email:

北京市昌平区府学路18号中国石油大学(北京)信息科学与工程学院,102249。Email: