2. 吉林大学地球探测科学与技术学院, 长春 130026;

3. 山东省物化探勘查院, 济南 250013;

4. 深圳市数字城市工程研究中心, 广东 深圳 518034

2. College of GeoExploration Science and Technology, Jilin University, Changchun 130026, China;

3. Shandong Institute of Geophysical & Geochemical Exploration, Jinan 250013, China;

4. Shenzhen Research Center of Digital City Engineering, Shenzhen 518034, Guangdong, China

0 引言

遥感图像变化检测根据不同时期两幅图像的颜色和纹理差异,定性、定量分析变化区域和变化程度,在城市数字化更新、国土监测、土地利用调查等领域具有广泛应用[1-2]。传统遥感图像变化检测采用差值、比值、几何结构特征分析等[2-4]不同方法对变化区域进行提取,存在图像预处理过程要求严格、某些地物颜色和纹理信息相似导致错分等问题。近年来,随着无人机和摄影测量技术快速发展,高分辨率遥感影像的获取更为方便快捷。同时,计算机性能的提高和深度学习卷积神经网络技术的发展,使利用深度学习进行高分辨率遥感图像处理取得了显著成果。例如:采用半监督方式训练卷积神经网络,使用自适应池化方法并结合纹理获得边界清晰、完整的建筑物[5];使用U-Net语义分割网络并配合小尺寸随机补片有效提升图像分类精度[6],以输入大幅图像作为数据存储,在增加样本数量的同时减少内存损耗;在遥感图像变化检测方面,采用无监督特征学习和有监督微调方式进行差异图像分析,提高变化检测精度[7];基于Caffe构建孪生卷积神经网络,使用图像增强技术增加训练样本数量,获得较高的变化检测提取结果[8];使用带有空洞卷积的DeepLabV3+网络,通过不同膨胀系数,提高边界提取能力和分类效果[9]。

深度学习网络训练时,由于输入图像过大会造成内存不足问题,通常在训练卷积神经网络时需要根据网络输入大小对大幅图像进行裁剪,并选择训练样本进行深度学习。图像裁剪会造成某些整体性特征信息丢失,并且样本数量少容易造成过拟合等问题。

基于前人[6, 9]的研究成果,提出一种利用随机补片和DeepLabV3+网络进行遥感图像变化检测的方法,以两期图像生成的多通道矩阵为数据存储,标签以变化和未变化制作二值图,通过在数据存储中创建小尺寸随机补片为网络输入训练变化检测网络,提高建筑物变化检测精度。

1 原理与方法卷积神经网络作为深度学习算法的重要分支,由输入层、卷积层、池化层和全连接层等部分组成。卷积神经网络在图像分类、目标检测和语义分割等领域具有广泛应用。语义分割是为图像中的每个像素分配一个语义类别,要求神经网络不仅具有判断像素类别的能力,还需要将学习到的深层抽象特征通过上采样方式实现密集分类。通常理解为编码器-解码器结构。编码器训练一个分类网络,解码器将编码器学习到的特征投影到像素空间。常见的语义分割网络有FCN(fully convolutional networks)、DeepLab系列(DeepLab V1、DeepLabV2、DeepLabV3、DeepLabV3+)、SegNet、U-Net、Mask-RCNN (mask-regions with convolutional neural networks features) 等。网络结构、训练样本质量和样本数量直接影响网络训练的精度。网络训练中增加样本数量可以有效防止模型过拟合。针对实际生产过程中训练样本较少、人工标注成本过高等问题,通过旋转、裁剪等图像增强技术[10-11]来增加训练样本数量。本文采用在图像存储中创建随机补片的方式增加训练样本。

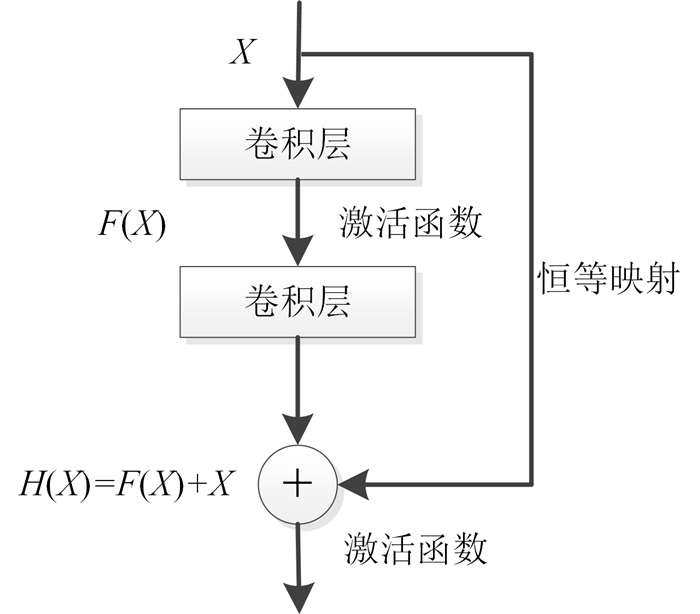

1.1 残差网络深度学习特征信息提取通过卷积操作学习图像中的空间相关性和通道相关性,VGG(visual geometry group)、GoogleNet等网络尝试直接增加网络层数提高网络学习能力,当网络层数超过一定数量时会出现梯度消失或梯度爆炸的情况。针对网络深度引起的梯度问题,可以通过权重初始化和标准化处理来解决,但随着网络层数增加出现精度退化问题。在2015年,何凯明等[12]提出ResNet网络,ResNet网络中使用残差结构,有效解决了网络深度和退化问题。残差结构由多个残差元组成,每个残差元主要包含两种关系,快捷连接和恒等映射。快捷连接使得输入特征值经过卷积操作后产生残差;恒等映射将输入值传递给卷积操作从而保证网络深度,解决精度退化问题,可以通过采取跃层和激活函数的方式实现。残差结构如图 1所示。

|

| X. 输入值;F(X). 残差函数;H(X). 期望函数。 图 1 残差结构 Fig. 1 Residual structure |

|

|

为实现像素级的分类,卷积神经网络将每个像素作为一个补片输入网络,有效解决了图像样本数量少的问题[10],但是图像相邻像素的特征相似度高造成大量的数据冗余,影响像素定位和分类效果。基于FCN思想构建的U-Net网络取消全连接层,有效解决了像素定位和像素分类问题。随着研究的深入,基于像素补片思想提出随机补片方法。随机补片从两个基于图像的数据存储中提取对应位置的小尺寸补片用于网络训练,可有效解决训练样本数量少造成过拟合和直接输入大范围图像造成内存耗尽、GPU占用过高等问题。

1.3 DeepLabV3+变化检测网络DeepLabV3+网络的创新在于使用空间金字塔结构(ASPP),利用膨胀卷积在扩大局部感受野的同时,设置不同的膨胀系数获得多尺度的上下文信息,在语义分割领域具有良好表现。DeepLabV3+网络是在DeepLabV3网络的基础上增加一个解码模块组成的编码-解码结构:编码可选择ResNet、Xception作为特征提取网络,利用不同膨胀系数的空洞卷积增加局部感受野,使用1×1的卷积混合特征,提高了网络特征提取的泛化能力;解码模块利用特征提取网络获得的深层抽象特征进行上采样,通过特征融合,再经过3×3的卷积和上采样之后恢复出与原图像大小一致的预测结果。

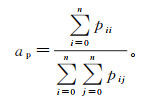

1.4 精度评价指标1) 像素精度。图像中正确分类像素与总像素的比值:

(1)

(1) 式中:ap为像素精度;n为目标类别数;pij为本属于i类但被预测为j类的像素数量;pii为分类正确的像素数量。

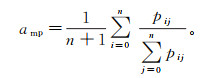

2) 平均像素精度。当图像中存在多个类别时,分别计算每个类别的像素精度再求平均值:

(2)

(2) 式中,amp为平均像素精度。

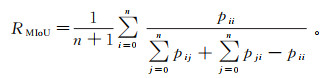

3) 平均交并比[13]。交并比作为卷积神经网络评价的重要指标,是预测值和真实值的交集和并集的比值;而平均交并比是求取每一类的交并比后再取平均值的结果:

(3)

(3) 式中,RMIoU为平均交并比。

4) 边界轮廓匹配分数[14]。是指每个类别预测边界与真实边界的对齐程度,是图像中所有类的平均边界匹配分数。

2 实验与结果分析 2.1 网络训练数据集本文网络训练用到两个数据集,建筑物提取采用INRIA(institut national de recherche en infomatique et automatique)遥感影像数据集[15]。该数据集覆盖范围为810 km2(训练集405 km2和测试集405 km2),空间分辨率为0.3 m,图像涵盖旧金山金融区等人口稠密地区和偏远的高山城镇。变化检测训练使用武汉大学公开的变化检测数据集[16]。该数据集涵盖2011年2月发生6.3级地震的区域,变化前数据是2012年4月航拍图像,包含20.5 km2 12 796座建筑物,变化后图像是2016年拍摄的同一区域,包含16 077座建筑物。

2.2 遥感图像变化检测实现方法高分辨率遥感图像包含RGB 3个通道,利用矩阵运算将同一地区不同时间的两幅RGB格式遥感图像转化为具有6通道的一幅非RGB格式遥感图像,并定义为mat格式。构建二值差异图,将变化区标记为1、未变化区标记为0。基于ResNet50创建的DeepLabV3+语义分割网络只能处理大小为224像素×224像素的3通道遥感图像,而变化检测需要处理6通道非RGB格式遥感图像。使用建筑物数据集训练语义分割网络,修改网络卷积层使其支持6通道图像输入,从图像存储和标签存储中提取多个对应大小为224像素×224像素的随机补片,通过迁移学习完成变化检测网络的训练。最后使用验证数据集进行变化检测和精度分析。

2.3 实验设计为了验证本文提出方法的检测效果,设计3个实验进行变化检测精度验证,包括商业化软件处理和深度学习方法。实验1利用商业化软件ENVI5.3在两期遥感图像中选择建筑物作为感兴趣区,使用马氏距离分类法进行变化检测。马氏距离是一种计算两个样本集之间相似程度的方法,注重特征的关联性,不受尺度的影响。实验2修改U-Net网络输入层,支持6通道,修改卷积参数,使用零填充,使卷积的输入和输出具有相同大小。在变化检测数据集中选择6 000像素× 11 600像素的遥感图像为数据集,利用随机补片方式输入,训练基于改进U-Net的变化检测网络,并在变化检测数据集中选取与训练数据不重合、大小为3 355像素×11 001像素的遥感图像进行精度验证。实验3使用实验2的训练数据,采用随机补片和DeepLabV3+网络训练方法进行变化检测网络训练,并利用实验2的验证数据进行精度验证实验。精度评价参照1.4节提供的评价指标。

2.4 变化检测网络训练硬件配置:NVIDIA RTX2060显卡,16 G内存,Intel I7-9700f处理器。

基于改进U-Net的网络训练:在武汉大学公开的数据集两期数据中选取同一区域、大小为6 000像素×11 600像素的高分辨率图像(图 2),并训练变化检测网络。输入补片大小为256像素×256像素,训练选项使用随机梯度下降法;动量为0.9;采用分段学习法,初始学习率为0.01;损失函数使用交叉熵。迭代12 500次,共计20轮,每轮为625次。

|

| 图 2 2012年(上)和2016年(下)两期数据 Fig. 2 Data for 2012 (top) and 2016 (bottom) |

|

|

基于ResNet50的DeepLabV3+网络训练:在建筑物检测数据集中选取一幅5 000像素×5 000像素的遥感图像为数据集,输入补片大小为224像素×224像素,训练建筑物提取网络,修改网络输入层为6通道,使用U-Net网络训练数据,训练选项使用随机梯度下降法;动量为0.9;采用分段学习法,初始学习率为0.01;损失函数使用交叉熵。迭代20 000次,共计20轮,每轮为1 000次。

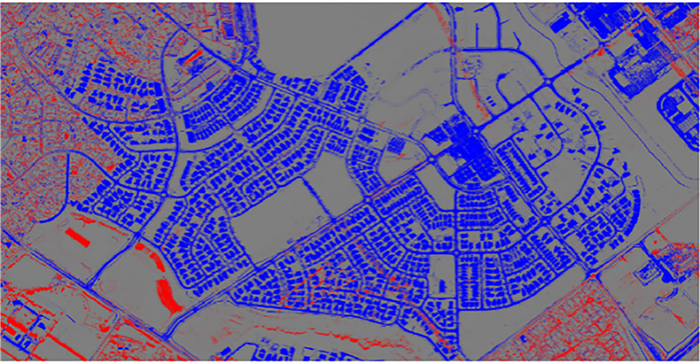

2.5 实验结果分析从实验1变化检测结果(图 3)可以看出,变化后图像由于道路颜色和建筑物屋顶极其相似导致错分严重,错分区域呈现条带状或小碎斑状。因此使用建筑物颜色做监督分类导致结果细节表现不佳。

|

| 蓝色表示建筑物增加部分;红色表示建筑物减少部分。 图 3 实验1变化检测结果 Fig. 3 Change detection results of Experiment 1 |

|

|

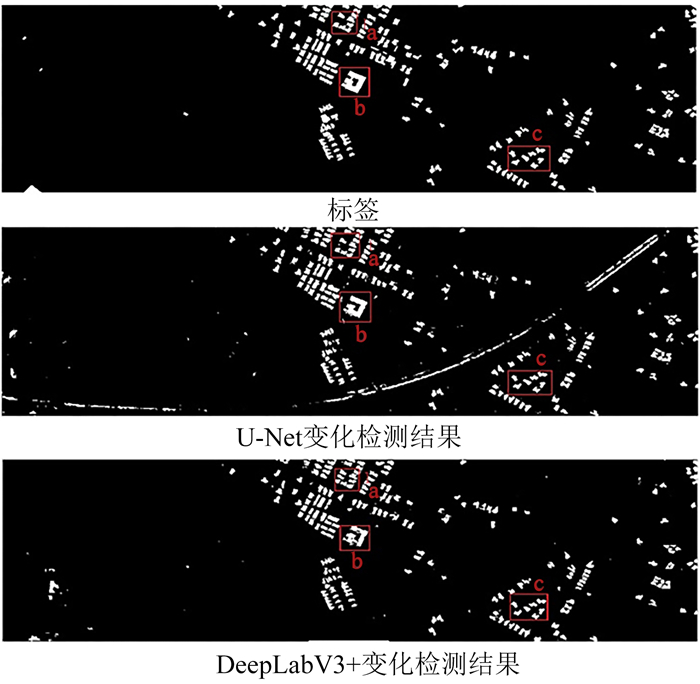

从整体来看,实验2和实验3变化检测提取的建筑物结构完整,边界清晰,面积较小的变化也能很好地识别(图 4);但是实验2中道路被提取出来造成错分,实验3变化检测结果与标签整体差异较小,只是在细节上存在零星斑点。

|

| 图 4 实验2和实验3变化检测结果 Fig. 4 Change detection results of Experiment 2 and Experiment 3 |

|

|

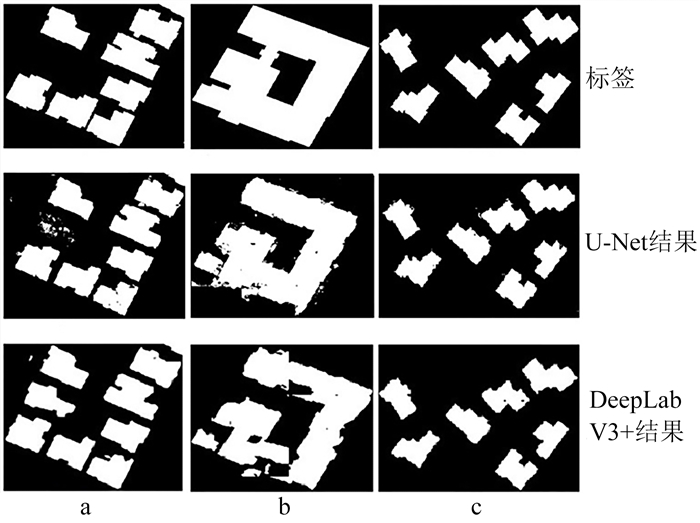

分别在实验2和实验3变化检测结果中选择3处细节(细节选取位置见图 4中a、b、c)观察细节表现(图 5)。可以看出:在实验2和实验3中,较小的地物变化也能较好表达(图 5a、c);但在实验2中大型建筑物存在边界锯齿状现象(图 5b),实验3提取结果存在错误(图 5a),大范围建筑物提取结构不完整,呈现锯齿状(图 5b)。

|

| 图 5 实验2和实验3局部细节 Fig. 5 Local detail of Experiment 2 and Experiment 3 |

|

|

从表 1的精度指标可以发现,使用马氏距离法进行监督(实验1)的精度最低,使用随机补片和U-Net语义分割网络进行建筑物变化检测(实验2)的精度显著提高,采用随机补片和DeepLabV3+语义分割网络进行变化检测(实验3)的精度更优于实验2的检测结果。

| % | |||||||||||||||||||||||||||||

| 序号 | 像素精度 | 平均像素精度 | 平均交并比 | 边界轮廓匹配分数 | |||||||||||||||||||||||||

| 实验1 | 49.87 | 48.87 | 24.43 | 61.47 | |||||||||||||||||||||||||

| 实验2 | 98.39 | 92.31 | 83.14 | 80.24 | |||||||||||||||||||||||||

| 实验3 | 99.17 | 93.24 | 89.90 | 96.51 | |||||||||||||||||||||||||

本文提出一种利用随机补片优化策略,结合DeepLabV3+特点,进行高分辨率遥感影像建筑物变化检测的方法。

1) 在大幅图像创建小尺寸随机补片,可以增加样本数量, 获得更多的深层抽象特征,同时减小内存消耗。

2) 通过实验对比,基于Resnet50的DeepLabV3+变化检测网络相较于改进的U-Net网络有更高的检测精度,马氏距离法只考虑灰度差异, 检测精度最低。基于DeepLabV3+的变化检测方法能够有效提高建筑物变化检测结果的准确率,大幅降低虚警率和漏检率。通过创建随机补片方式提高训练样本数量和质量,进而提高深度学习模型的变化检测性能,为高分辨率遥感影像深度学习变化检测提供了一条提高正确率的新途径。

3) 利用深度学习语义分割算法处理高分辨率遥感图像,不仅能够解决复杂场景下地物变化检测,还可用于建筑物、道路等地物信息提取和城市街景变化检测。但是本文使用的变化检测方法还存在一些不足,包括在处理大型场景时产生锯齿状边界、没有对其他类型数据集做验证,需要在后续研究中改进。

| [1] |

李亮, 舒宁, 王凯, 等. 融合多特征的遥感影像变化检测方法[J]. 测绘学报, 2014, 43(9): 945-953, 959. Li Liang, Shu Ning, Wang Kai, et al. Change Detection Method for Remote Sensing Images Based on Multi-Features Fusion[J]. Acta Geodaetica Cartographica Sinica, 2014, 43(9): 945-953, 959. |

| [2] |

眭海刚, 冯文卿, 李文卓, 等. 多时相遥感影像变化检测方法综述[J]. 武汉大学学报(信息科学版), 2018, 43(12): 1885-1898. Sui Haigang, Feng Wenqing, Li Wenzhuo, et al. Review of Change Detection Methods for Multi-Temporal Remote Sensing Imagery[J]. Geomatics and Information Science of Wuhan University, 2018, 43(12): 1885-1898. |

| [3] |

王明常, 牛雪峰, 杨毅恒, 等. 长白山地区景观格局过程模拟预测研究[J]. 吉林大学学报(地球科学版), 2009, 39(5): 947-952. Wang Mingchang, Niu Xuefeng, Yang Yiheng, et al. Simulation and Predicted Research on Changbai Mountain Landscape Pattern Process[J]. Journal of Jilin University (Earth Science Edition), 2009, 39(5): 947-952. |

| [4] |

王明常, 郭鑫, 王凤艳, 等. 基于FLUS的长春市土地利用动态变化与预测分析[J]. 吉林大学学报(地球科学版), 2019, 39(6): 1795-1804. Wang Mingchang, Guo Xin, Wang Fengyan, et al. Dynamic Change and Predictive Analysis Changchun City Based on FLUS Model[J]. Journal of Jilin University (Earth Science Edition), 2019, 39(6): 1795-1804. |

| [5] |

范荣双, 陈洋, 徐启恒, 等. 基于深度学习的高分辨率遥感影像建筑物提取方法[J]. 测绘学报, 2019, 48(1): 34-41. Fan Rongshuang, Chen Yang, Xu Qiheng, et al. A High-Resolution Remote Sensing Image Building Extraction Method Based on Deep Learning[J]. Acta Geodaetica Cartographica Sinica, 2019, 48(1): 34-41. |

| [6] |

Kemker R, Salvaggio C, Kanan C. Algorithms for Semantic Segmentation of Multispectral Remote Sensing Imagery Using Deep Learning[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2018, 145(11): 60-77. |

| [7] |

Zhao J, Gong M, Liu J, et al. Deep Learning to Classify Difference Image for Image Change Detection[C]//International Joint Conference on Neural Networks. [S. l.]: IEEE, 2014: 411-417.

|

| [8] |

Zhan Y, Fu K, Yan M, et al. Change Detection Based on Deep Siamese Convolutional Network for Optical Aerial Images[J]. IEEE Geoence and Remote Sensing Letters, 2017, 14(10): 1845-1849. DOI:10.1109/LGRS.2017.2738149 |

| [9] |

袁立, 袁吉收, 张德政. 基于DeepLab-V3+的遥感影像分类[J]. 激光与光电子学进展, 2019, 56(15): 236-243. Yuan Li, Yuan Jishou, Zhang Dezheng. Remote Sensing Image Classification Based on DeepLab-V3+[J]. Laser & Optoelectronics Progress, 2019, 56(15): 236-243. |

| [10] |

朱春宇, 王明常, 王凤艳, 等. 基于深度置信网络与数学形态学融合的遥感影像建筑物变化检测[J]. 科学技术与工程, 2020, 20(8): 3157-3163. Zhu Chunyu, Wang Mingchang, Wang Fengyan, et al. Building Change Detection Based on Deep Belief Networks and Mathematical Morphology Fusion[J]. Science Technology and Engineering, 2020, 20(8): 3157-3163. DOI:10.3969/j.issn.1671-1815.2020.08.032 |

| [11] |

Wang Mingchang, Zhang Haiming, Sun Weiwei, et al. A Coarse-to-Fine Deep Learning Based Land Use Change Detection Method for High-Resolution Remote Sensing Images[J]. Remote Sensing, 2020, 12(12): 1933. DOI:10.3390/rs12121933 |

| [12] |

He K, Zhang X, Ren S, et al. Deep Residual Learning for Image Recognition[C]//IEEE Conference on Computer Vision & Pattern Recognition. [S. l.]: IEEE Computer Society, 2016: 770-778.

|

| [13] |

Long J, Shelhamer E, Darrell T. Fully Convolutional Networks for Semantic Segmentation[J]. Transactions on Pattern Analysis & Machine Intelligence, 2014, 39(4): 640-651. |

| [14] |

Yang L, Wang H, Yan K. Building Extraction of Multi-Source Data Based on Deep Learning[C]//2019 IEEE 4th International Conference on Image. Xiamen: Vision and Computing (ICIVC), 2019: 296-300.

|

| [15] |

Emmanuel Maggiori, Yuliya Tarabalka, Guillaume Charpiat, et al. "Can Semantic Labeling Methods Generalize to Any City? The Inria Aerial Image Labeling Benchmark"[C]//IEEE International Geoscience and Remote Sensing Symposium. Fort Worth: IEEE International Symposium on Geoscience and Remote Sensing (IGARSS), 2017: 3226-3229.

|

| [16] |

Ji Shunping, Wei Shiqing, Lu Meng. Fully Convolutional Networks for Multi-Source Building Extraction from an Open Aerial and Satellite Imagery Data Set[J]. IEEE Transactions on Geoscience and Remote Sensing, 2019, 57(1): 574-586. DOI:10.1109/TGRS.2018.2858817 |