2. 中国测绘科学研究院, 北京 100830;

3. 东莞市测绘院, 广东 东莞 523129

2. Chinese Academy of Surveying and Mapping, Beijing 100830, China;

3. Dongguan Institute of Surveying and Mapping, Dongguan 523129, China

随着Quick Bird、ZY-3等高分辨率遥感卫星的出现,高分辨率遥感影像已成为重要的地理空间信息主要的来源之一[1]。遥感影像空间分辨率的显著提高,遥感影像表现出更丰富的地物细节信息,几何结构和纹理特征等也更加明显。同时类内混合像元及大量阴影的存在,使得传统基于像素的遥感影像分类技术不能满足建筑物信息提取需要[2-3]。建筑物是城市基础地理信息的重要组成部分,因此,研究高精度和高效建筑物提取方法非常有必要。

建筑物提取是遥感信息处理与分析重要研究内容,近几年来,许多学者提出许多建筑物提取方法[4]。如文献[5]将支持向量机(support vector machine, SVM)应用高分辨遥感影像建筑物信息,文献[6]提出形态学建筑物指数(morphology building index, MBI)。上述建筑物提取方法,都是基于像素特征的建筑物提取方法,导致提取建筑物边界模糊和不完整、提取精度较低等问题。深度学习是模拟人脑的学习过程,通过对输入影像数据低层特征中自动提取高层次特征。文献[7]提出基于大型深层卷积神经网络(convolutional neural networks, CNNs)的自然图像分类算法,在Image Net数据集上取得了很高的分类精度。针对上述建筑物提取精度问题,有些学者将卷积神经网络算法应用于建筑物提取。文献[8-9]将卷积神经网络算法应用于建筑物提取,精度有着明显提高,但是需要大量样本和存在提取结果边界不完整等问题。

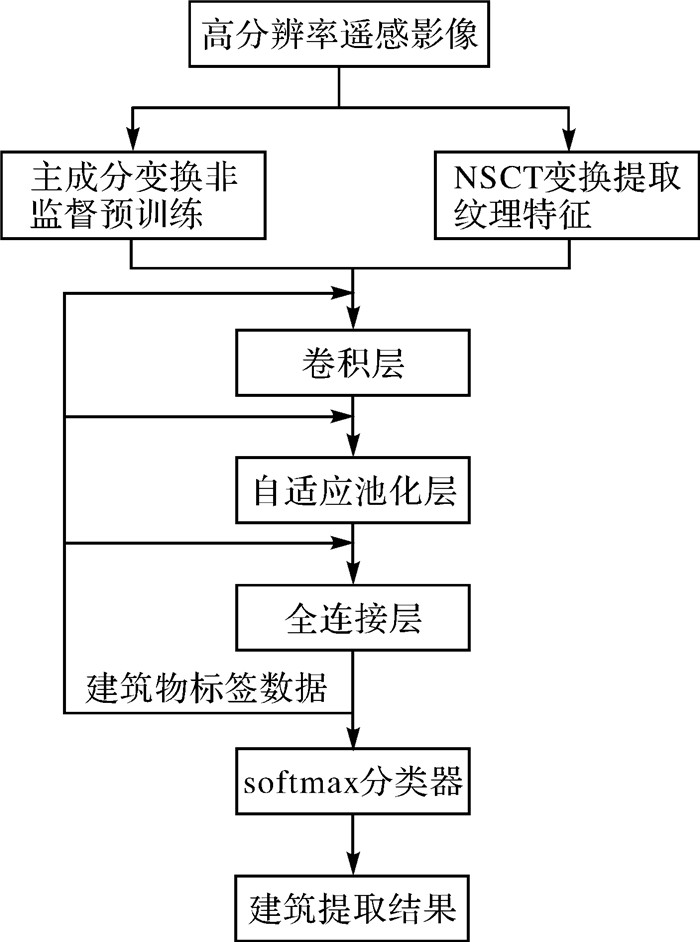

针对上述高分辨率遥感影像建筑物信息提取现存的问题,本文提出基于深度学习的高分辨率遥感影像建筑物提取方法。采用主成分变换(principal component analysis, PCA)非监督预训练初始化网络结构,通过非下采样轮廓波变换(non-subsampled contour let transform, NSCT)来获取影像纹理特征,并将纹理特征输入网络中参与建筑物提取。在主成分分析小化重构误差原则下,获取待分类影像的特征,从而学习得到含有训练样本统计特性的滤波器;为防止陷入过于拟合,神经网络的激活函数采用线性修正函数;为减少在下采样过程中影像特征的缺失,提出自适应池化模型,最后将建筑物特征输入softmax分类器进行提取。

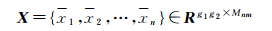

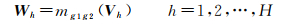

1 方法与原理 1.1 主成分变换非监督预训练原理卷积神经网络训练需要大量样本,实际建立样本库需要大量的时间和人力。本文采用半监督方式训练网络,首先采用主成分分析(principal component analysis, PCA)初始化多级网络结构,再通过建筑物标签数据对整个网络结构进行微调。设输入卷积神经网络的影像有M景,其大小为m×n,卷积滤波器大小为g1×g2,在训练影像的第i景中取出全部大小为g1×g2影像块,将其表示向量形式为Xi={xi, 1, xi, 2, …, xi, nm},将X去均值,得到影像Xi的影像块为Xi={xi, 1, xi, 2, …, xi, nm}。所以训练数据的影像块可以表示[10]

(1)

(1)

采用主成分变换方法最小化重构误差求解特征向量[11]

(2)

(2)

式中,IH为H×H单位矩阵;V为协方差矩阵XXΤ的前H个特征向量;V可以表示输入影像块的主要特征。主成分变换初始化卷积神经网络的滤波器组Wh可以表示为

(3)

(3)

式中,mg1g2(Vh)表示将向量V映射到矩阵Wh;Vh表示影像的第h主要特征。

因为采用主成分变换不需要人工干预获取局部影像的主要特征。因此,可认为主成分变换训练滤波器是一种简单的自动编码器。

1.2 影像纹理特征的提取因为高分辨影像地物复杂,仅仅单靠影像的光谱特征进行建筑物提取,提取结果不理想,所以需要利用高分辨影像潜在的特征来提高地物类别之间的可分离性。在高分辨影像分类过程往往结合纹理特征来获取理想分类结果。影像光谱特征是通过像素点本身周围像素组成区域进行描述,本文针对光谱特征提取方法,是取L×L大小窗口,对每个像素,构建出L×L维光谱特征向量。文献[12]将NSCT用于影像纹理特征的提取,得到的效果比传统纹理提取方法更好,说明NSCT能较好地提取影像纹理特征。本文采用NSCT来提取影像纹理特征,其中NSCT变换主要包括两个过程,一个是非下采样金字塔(NSP)分解,另一个是非下采样方向滤波器组分解((NBDFB)。

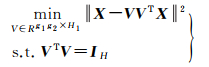

本文采用NSCT变换后的各带通子影像系数构成的特征向量来表示高分辨影像的纹理特征。设经过NSCT变换的原始影像N, 产生的带通子影像分别为N1, N2, …, Nk,某一个子影像Nm(1≤m≤k)的方向分解数为dm,则Nm产生的方向子影像可以表示为Nm1, Nm2, …, Nm2dm,对于原始影像N在(i, j)处的纹理特征可以表示为[13]

(4)

(4)

式中, Nmn(i, j)表示方向子影像Nmn在(i, j)处的系数值;k为NSCT变换级数。

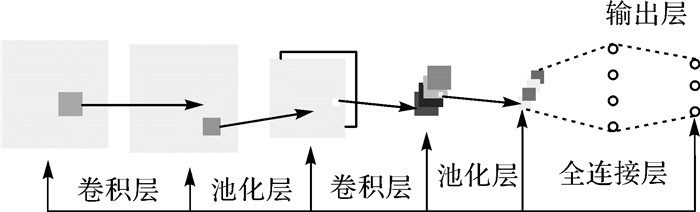

1.3 卷积神经网络卷积神经网络(CNN)来源于神经学家Hubei和Wiesel对猫视觉皮层细胞的研究[14]。与浅层机器学习算法相比较,它具有适用性强、分类并行处理能力、权值共享等优点,使得全局优化训练参数大大减少,目前已经成为了深度学习领域的研究热点之一[15]。根据研究需要,本文将卷积神经网络结构构建为:输入层、2个卷积层、2个池化层、全连接层和输出层组成,其网络结构如图 1所示。

|

| 图 1 卷积神经网络结构图 Fig. 1 Convolution neural network structure |

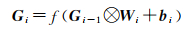

输入影像在卷积层和滤波层进行卷积运算,卷积层和滤波层一般是需要激活函数来连接[16]。本文采用Gi表示卷积神经网络第i层的特征图,其卷积过程可以描述为

(5)

(5)

式中,Wi表示第i层卷积核的权值特征向量;运算符号“⊗”代表第i层影像与第i-1层影像或者特征图进行卷积操作;bi是偏移向量;最终通过线性的激活函数f(·)获取第i层的特征图Gi。

激活函数主要分两种,一种是线性激活函数,另一种是非线性激活函数。常用的非线性激活函数有3种,分别是双曲线函数、Sigmoid和Softplus[17]。常用的线性激活函数主要有ReLU和PReLU。因为ReLU函数与生物神经元受刺激后的激活状态比较接近,在一定程度上该函数具有稀疏性,计算简单等优点,被许多国内外学者作为卷积神经网络的激活函数[18-19]。因此本文采用f(x)=max(x)作为卷积神经网络的激活函数。

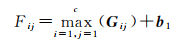

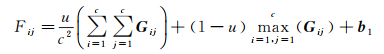

在卷积层之后对应池化层,卷积层和池化层通过激活函数链接[20-21]。常见池化层模型主要有两种:一是最大池化模型,如式(6)所示[22];二是平均池化模型,如式(7)所示[23]。

设由卷积层得到特征图矩阵为Gij,池化区域大小为c×c,b1是偏移量,池化步长为c,则最大池化模型[24]可以表达为

(6)

(6)

式中,

平均池化模型[25]可以表达为

(7)

(7)

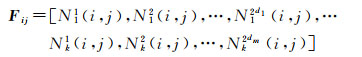

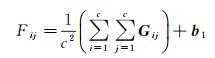

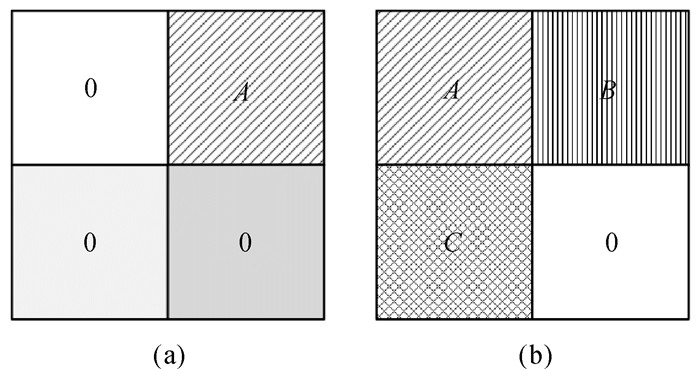

由于高分辨率影像地物复杂,导致传统池化模型不能很好地提取影像特征。在池化层取两种不同池化区域,如图 2所示,空白处表示像元值为0,阴影处由不同像元值组成,A表示最大值区域。如图 2(a)所示整个特征图的特征主要集中在A处,如果采用平均池化模型进行池化,对整个特征图的特征会产生弱化。如图 2(b)所示,特征图的特征主要分布在A、B、C, 在A、B、C三者关系未知情况下,采用最大化池化模型进行池化,对整个特征图的特征会产生一定弱化,最终影响建筑物提取精度。

|

| 图 2 不同池化区域 Fig. 2 Different pooled areas |

为了减少因池化过程中影像特征丢失,本文在最大池化模型和平均模型的基础上,根据插值原理,提出自适应池化模型(adaptive pooling model)。该模型在复杂的池化区域能自适应通过池化因子u来调节池化过程,其表达式为

(8)

(8)

u表示池化因子,其作用是根据不同池化区域来动态优化传统池化模型,其表达式为

(9)

(9)

式中,a是池化区域元素除了最大元素之外所有元素的平均值;bmax为池化区域最大元素。u取值范围(0, 1),该模型兼顾最大池化模型和平均模型特点,能根据不同池化区域特点自适应优化模型,尽可能挖掘特征图的特征,从而提高卷积神经网络在高分辨率影像建筑物提取精度。

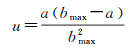

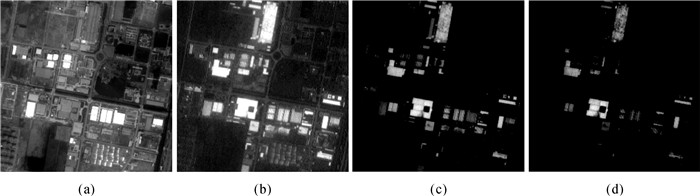

为了验证本文提出自适应池化模型能减少在池化过程特征丢失,将大小为200×200像素影像输入简单网络中, 其网络结构为2层。其中图 3(a)为原始影像;图 3(b)为自适应池化模型获得特征图;图 3(c)为最大化池化模型获得特征图;图 3(d)为平均池化模型获得特征图。

|

| 图 3 原始影像和各种池化模型池化结果的特征 Fig. 3 The original image and difference of pooling model pooling the characteristics mapping |

从图 2可以看出,自适应池化模型获取特征图的特征明显,而最大化池化模型和平均池化模型都会弱化影像特征,其中平均池化结果模型获得的特征图存在严重特征丢失。

基于深度学习的高分辨率遥感影像建筑物提取方法主要步骤为:①采用主成分变换初始化卷积神经网络滤波器权值,并通过非下采样轮廓波变换计算原始影像纹理特征;②对影像光谱-纹理特征进行卷积计算得到影像特征图;③对影像特征图采用自适应池化模型进行下采样;④将特征图合并成为一个列特征向量,并输入全连接层,通过标签数据反向传播算法更新网络滤波器权值;⑤最后将特征列向量输入softmax完成建筑物提取。本文分类方法流程如图 2所示。

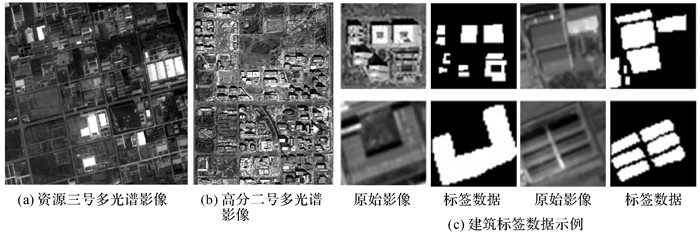

2 试验与分析本文试验采用Linux下的Tensor Flow机器学习框架,采用python语言编程实现,硬件环境为CPU Intel(R)Xeon(R)E5-2630,GPU Nvidia Tesla M40 12 GB内存。为验证本文提出方法有效性,设置两组试验,第1组试验数据选取天津市主城区的资源三号多光谱影像,其大小为2000×2000像素,如图 5(a)所示;第2组试验数据选取成都市主城区的高分二号多光谱影像,其大小为1710×2000像素,如图 5(b)所示。在综合考虑两个试验区域建筑物种类和分布,在5景资源三号多光谱影像和4景高分二影像中选取685个有标签建筑物数据,部分建筑物标签数据如图 5(c)所示,标签数据主要作用是对预训练卷积神经网络进行微调。在网络训练方面,本文试验采用半监督训练方法。鉴于样本量不大,为获取全局最优训练结果,本文采用批量梯度下降法训练算法,本研究初始学习率为0.000 6,最低学习率不超过0.000 001。

|

| 图 4 本文建筑物提取方法流程 Fig. 4 Proposed building extraction framework |

|

| 图 5 原始影像与建筑物标签数据 Fig. 5 Original image and building tag data |

2.1 试验1

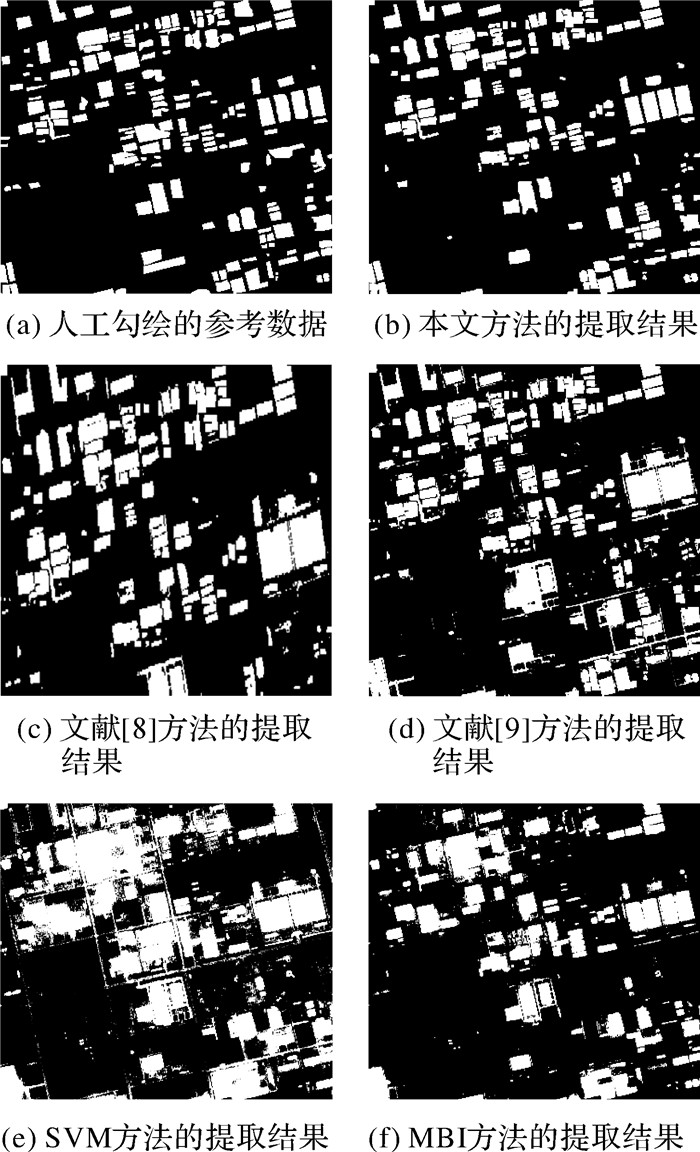

为验证本文方法的有效性,并与SVM、MBI、文献[8]和文献[9]的提取结果进行比较。本试验采用网络结构模型如图 1所示,共有6层,分别是2个卷积层、2个采样层、1个全连接层和1个输出层。第1层的卷积滤波器设置为1800个,第2层卷积滤波器设置为1000个,其滤波器大小均设置5×5;将采样间隔设置为1,并采用自适应池化模型进行下采样。卷积神经网络激活函数采用f(x)=max(x)。本次试验NSCT变换尺度为4,每一个方向数分别为5、5、5、4。最后将获取建筑物特征输入softmax分类中,其提取结果如图 6(b)所示。文献[8]建筑物的提取结果如图 6(c)所示,文献[9]建筑物的提取结果如图 6(d)所示,SVM方法的提取结果如图 6(e)所示,MBI方法的提取结果如图 6(f)所示。

|

| 图 6 不同方法建筑物提取结果 Fig. 6 Different methods of building extraction results |

从图 6(b)可以得出,本文建筑物提取方法获取结果,建筑物边界清晰和边界完整,面积较小建筑物也能很好识别。从图 6(c)、5(d)可以得出文献[8-9]方法建筑物提取结果,建筑物边界较为模糊。从图 6(e)、6(f)可以看出,SVM和MBI方法建筑物提取结果,建筑物边界模糊和不完整,并且存在“椒盐”现象,特别是SVM方法的提取结果,存在严重的道路误提。通过目视评价方法,本文建筑物提取方法的结果优于SVM、MBI、文献[8]的方法和文献[9]的方法。

为了定量评价本文建筑物提取方法,采用人工目视解译方式勾取的建筑物区域作为参考,其勾绘准则:建筑物边界模糊区域勾绘精度在4个像素之内,建筑物边界清晰区域勾绘精度在1像素之内,其参考数据如图 6(a)所示。利用混淆矩阵计算遥感影像建筑物提取结果的总体精度(OA)和Kappa系数,并统计提取所需时间T,其评价指标如表 1所示。

由表 1可知,本文建筑物提取方法与其他4种方法相比较,本文方法的精度是最高的,其建筑物提取精度为93.86%,与文献[8]算法相比较总体精度高出8.59%;与文献[9]算法相比较总体精度高出9.35%;与MBI算法相比较总体精度高出13.74%;与SVM算法相比较总体精度高出18.45%。本文建筑物提取方法Kappa系数在90%以上。在提取效率,MBI耗时最短,本文提取方法与文献[8]、文献[9]算法耗时相当。通过定量评价,验证本文将深度学习算法应用于遥感影像建筑物提取中,能有效提高建筑物提取精度。

通过上述目视评价和定量评价方式,本文建筑物提取方法结果较好,主要是由于卷积神经网络模型能有复杂的多层非线性变换而具有更强的表达与建模能力,对高分辨率影像中复杂建筑物特征有很好表达,并且将建筑物纹理特征参与提取,从而能获取较好提取结果。

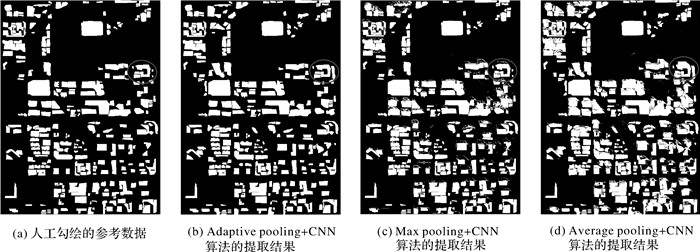

2.2 试验2为验证本文提出自适应池化卷积神经网络模型有效性,与传统不同池化模型卷积神经网络算法提取结果进行比较。本次试验采用网络结构模型如图 1所示,并且提取纹理参数设置与试验1相同。Adaptive pooling+CNN算法提取结果如图 7(b)所示;Max pooling+CNN算法提取结果如图 7(c)所示;Average pooling+CNN算法提取结果如图 7(d)所示。

|

| 图 7 不同池化模型卷积神经网络算法的提取结果 Fig. 7 Extraction building results using different pooling models |

从图 7(b)可以看出,Adaptive pooling+CNN算法提取结果,建筑物提取边界清晰。从图 7(c)、7(d)可以看出,Max pooling+CNN算法和Average pooling+CNN算法提取结果,建筑物边界较为模糊。通过目视评价方法,本文提出Adaptive pooling+CNN方法提取结果优于传统池化模型卷积神经网络算法。

为定量评价Adaptive pooling+CNN算法的有效性,通过人工勾绘参考数据,勾绘准则与试验一相同,其勾绘结果如图 7(a)所示。分别统计3种方法总体精度(OA)、Kappa系数和提取所需时间T,其评价指标如表 2所示。

| 参数 | adaptive pooling+CNN | max pooling+CNN | average pooling+CNN |

| OA/(%) | 95.27 | 86.17 | 85.67 |

| Kappa/(%) | 91.34 | 81.39 | 80.64 |

| 提取所需时间T/s | 37 | 34 | 36 |

由表 2可以看出,本文提出的Adaptive pooling+CNN算法与其他两种算法相比较,本文方法的精度最高,总体精度为95.27%,较Max pooling+CNN方法、Average pooling+CNN方法分别高出了9.1%和9.6%。本文提出Adaptive pooling+CNN方法的Kappa系数在90%以上。在提取效率方面而言,3种方法时间复杂度相差不大,均在40 s以下。通过定量和目视评价方法,验证了本文算法能有效提高建筑物提取精度。

3 结论针对建筑物在高分辨率影像难提取的问题,本文提出基于深度学习高分辨率遥感影像建筑物提取方法。在网络结构构建方面,提出自适应池化模型卷积神经网络框架。在网络框架训练方面,采用主成分分析非监督初始化滤波器,在较少标签数据的情况下,完成卷积神经网络初始化。本文提取方法与其他典型4种方法相比较,本文方法的提取精度最高。

通过本文研究可以发现,卷积神经网络在高分辨遥感影像地物信息智能识别领域有着较大潜力。本文提取方法还存在不足的地方,如激活函数不能全部将神经元激活、网络结构单一。下一步工作是寻求最佳激活函数,期待进一步提高建筑物提取精度。

| [1] | CHERIYADAT A M. Unsupervised feature learning for aerial scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2014, 52(1): 439–451. DOI:10.1109/TGRS.2013.2241444 |

| [2] | MAGGIORI E, TARABALKA Y, CHARPIAT G, et al. Convolutional neural networks for large-scale remote-sensing image classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(2): 645–657. DOI:10.1109/TGRS.2016.2612821 |

| [3] | LUO Bin, ZHANG Liangpei. Robust autodual morphological profiles for the classification of high-resolution satellite images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2014, 52(2): 1451–1462. DOI:10.1109/TGRS.2013.2251468 |

| [4] | HAN Junwei, ZHANG Dingwen, CHENG Gong, et al. Object detection in optical remote sensing images based on weakly supervised learning and high-level feature learning[J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 53(6): 3325–3337. DOI:10.1109/TGRS.2014.2374218 |

| [5] | HUANG Xin, ZHANG Liangpei. An SVM ensemble approach combining spectral, structural, and semantic features for the classification of high-resolution remotely sensed imagery[J]. IEEE Transactions on Geoscience and Remote Sensing, 2013, 51(1): 257–272. DOI:10.1109/TGRS.2012.2202912 |

| [6] |

林祥国, 张继贤.

面向对象的形态学建筑物指数及其高分辨率遥感影像建筑物提取应用[J]. 测绘学报, 2017, 46(6): 724–733.

LIN Xiangguo, ZHANG Jixian. Object-based morphological building index for building extraction from high resolution remote sensing imagery[J]. Acta Geodaetica et Cartographica Sinica, 2017, 46(6): 724–733. DOI:10.11947/j.AGCS.2017.20170068 |

| [7] | CIRESAN D C, MEIER U, MASCI J, et al. Flexible, high performance convolutional neural networks for image classification[C]//Proceedings of the 21st International Joint Conference on Artificial Intelligence. Barcelona: AIAA Press, 2011. https://www.researchgate.net/publication/220812758_Flexible_High_Performance_Convolutional_Neural_Networks_for_Image_Classification |

| [8] | YUAN Jiangye. Automatic building extraction in aerial scenes using convolutional networks[J/OL]. (2016-02-21)[2017-05-23].https://arxiv.org/abs/1602.06564. |

| [9] | VAKALOPOULOU M, KARANTZALOS K, KOMODAKIS N, et al. Building detection in very high resolution multispectral data with deep learning features[C]//Proceedings of 2015 IEEE International Geoscience and Remote Sensing Symposium (IGARSS). Milan: IEEE, 2015: 1873-1876. https://www.researchgate.net/publication/308828699_Building_detection_in_very_high_resolution_multispectral_data_with_deep_learning_features |

| [10] | DENG Weihong, HU Jiani, LU Jiwen, et al. Transform-invariant PCA:a unified approach to fully automatic facealignment, representation, and recognition[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2014, 36(6): 1275–1284. DOI:10.1109/TPAMI.2013.194 |

| [11] |

陈洋, 范荣双, 王竞雪, 等.

基于深度学习的资源三号卫星遥感影像云检测方法[J]. 光学学报, 2018, 38(1): 0128005.

CHEN Yang, FAN Rongshuang, WANG Jingxue, et al. Cloud detection of ZY-3 satellite remote sensing images based on deep learning[J]. Acta Optica Sinica, 2018, 38(1): 0128005. |

| [12] |

黄听.高分辨率遥感影像多尺度纹理、形状特征提取与面向对象分类研究[D].武汉: 武汉大学, 2009: 71-76. HUANG Xin. Multiscale texture and shape feature extraction and object-oriented classification for very high resolution remotely sensed imagery[D]. Wuhan: Wuhan University, 2009: 71-76. |

| [13] | XIAO Xuefeng, JIN Lianwen, YANG Yafeng, et al. Building fast and compact convolutional neural networks for offline handwritten Chinese character recognition[J]. Pattern Recognition, 2017, 72(5): 72–81. |

| [14] | CHEN Jiangbo, WANG Chengyi, MA Zhong, et al. Remote sensing scene classification based on convolutional neural networks pre-trained using attention-guided sparse filters[J]. Remote Sensing, 2018, 10(2): 290. DOI:10.3390/rs10020290 |

| [15] | SIRINUKUNWATTANA K, AHMED RAZA S E, TSANG Y W, et al. Locality sensitive deep learning for detection and classification of nuclei in routine colon cancer histology images[J]. IEEE Transactions on Medical Imaging, 2016, 35(5): 1196–1206. DOI:10.1109/TMI.2016.2525803 |

| [16] | NGO T A, LU Zhi, CARNEIRO G. Combining deep learning and level set for the automated segmentation of the left ventricle of the heart from cardiac cine magnetic resonance[J]. Medical Image Analysis, 2017, 35(2): 159–171. |

| [17] | ZOU Qin, NI Lihao, ZHANG Tong, et al. Deep learning based feature selection for remote sensing scene classification[J]. IEEE Geoscience and Remote Sensing Letters, 2015, 12(11): 2321–2325. DOI:10.1109/LGRS.2015.2475299 |

| [18] | ZHAO Wenzhi, GUO Zhou, YUE Jun, et al. On combining multiscale deep learning features for the classification of hyperspectral remote sensing imagery[J]. International Journal of Remote Sensing, 2015, 36(13): 3368–3379. |

| [19] |

陈洋, 范荣双, 王竟雪, 等.

结合最小噪声分离变换和卷积神经网络的高分辨影像分类方法[J]. 激光与光电子学进展, 2017, 54(10): 102801.

CHEN Yang, FAN Rongshuang, WANG Jingxue, et al. High resolution image classification method combining with minimum noise fraction rotation and convolution neural network[J]. Laser & Optoelectronics Progress, 2017, 54(10): 102801. |

| [20] | NOGUEIRA K, PENATTI O A B, DOS SANTOS J A D. Towards better exploiting convolutional neural networks for remote sensing scene classification[J]. Pattern Recognition, 2017, 61(7): 539–556. |

| [21] | LI Zhe, REN Ao, LI Ji, et al. Structural design optimization for deep convolutional neural networks using stochastic computing[C]//Proceedings of 2017 Conference on Design, Automation & Test in Europe. Lausanne, Switzerland: IEEE, 2017: 250-253. https://www.researchgate.net/publication/316949629_Structural_design_optimization_for_deep_convolutional_neural_networks_using_stochastic_computing |

| [22] | CHEN Yang, FAN Rongshuang, YANG Xiucheng, et al. Extraction of urban water bodies from high-resolution remote-sensing imagery using deep learning[J]. Water, 2018, 10(5): 585. DOI:10.3390/w10050585 |

| [23] | DONG Chao, LOY C C, HE Kaiming, et al. Image super-resolution using deep convolutional networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2016, 38(2): 295–307. DOI:10.1109/TPAMI.2015.2439281 |

| [24] | CHEN Yang, FAN Rongshuang, BILAL M, et al. Multilevel cloud detection for high-resolution remote sensing imagery using multiple convolutional neural networks[J]. ISPRS International Journal of Geo-information, 2018, 7(5): 181. DOI:10.3390/ijgi7050181 |

| [25] | MA Xiaorui, WANG Hongyu, GENG Jie. Spectral-spatial classification of hyperspectral image based on deep auto-encoder[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2016, 9(9): 4073–4085. DOI:10.1109/JSTARS.2016.2517204 |