摄影测量已有170多年的历史。它经历了四个主要的发展阶段,即地面和气球摄影测量、模拟摄影测量、解析摄影测量和数字摄影测量。这四个主要阶段与摄影术、飞机、计算机和电子器件(数码相机和数码扫描仪)的技术发明有直接关系[1]。

Daguerre和Niepce早在1839年就发明了摄影术,之后便开始了早期的地面和气球摄影测量。Pulfrich于1901年发明了航空立体摄影测量,Orel于1908年研发了第一台光学机械立体测绘仪,随后便开始了模拟摄影测量。在解析摄影测量方面,第一个研究成果出现于20世纪50年代,该成果利用平差理论和计算机程序来解决一些摄影测量问题。然而直到20世纪60年代后期,第一个可操作的解析摄影测量计算机程序才得以实现。至于数字摄影测量(用数字影像代替硬拷贝照片),有关系统试验的最初报道在20世纪80年代已经出现, 然后经过90年代的进一步改进、完善和巩固, 在2000年开始了摄影测量的全数字化时代[2]。

“遥感”一词最初出现于1960年,它反映了从使用飞机到使用卫星进行地球影像采集的过渡,也反映了从几何信息处理到光谱信息处理的转化。第一张卫星照片是一张由美国摄影侦察卫星于1960年拍摄的黑白照片[3]。12年后,美国于1972年发射了第一颗民用地球观测卫星Landsat-1,该卫星提供了60 m分辨率的4波段多光谱影像。1999年第一颗高分辨率商业卫星IKONOS成功发射,该卫星同时拍摄4 m分辨率的4波段多光谱影像以及1 m分辨率的1波段全色影像。至今多光谱影像的分辨率已经增加到1.24 m,全色影像的分辨率已增加到0.31 m;同时光谱波段也已从4个波段增加到16个波段。

由于航空和卫星影像的空间分辨率及光谱分辨率的提高,影像采集复杂性的增加(例如,最低点和非最低点(nadir and off-nadir),中心投影和线性投影等的变化)及精度要求的提高,使用“静态的”图像处理技术来处理变化的遥感影像面临越来越多挑战。传感器的几何差异,空间分辨率或光谱分辨率的不同,视角的差别及地形起伏的不同,都会影响到图像处理的结果。因此,为了有效地处理现代航摄和卫星遥感影像,所开发的算法及软件需要具有一定的“智能”,能够识别影像的变化并能给予适当的补偿处理。另一方面由于数字传感器和数字影像的飞速增长,巧妙利用数码相机和数字影像来开发创新性应用的可能性大大增加。它既能增加信息量又能改善用户体验。

可以说现在正处于智能摄影测量和智能遥感的阶段。当下的算法需要有一定的“智能”以便有效地处理各种遥感影像,达到良好稳定的结果。我们的方法也需要有创意以便充分地利用现有的相机和影像进行创新性的应用。

本文将介绍一些由加拿大高级地球空间信息图像处理实验室(CRC-AGIP实验室)以及加拿大的新不伦瑞克大学(UNB)大地测量与地球空间信息工程系(GGE)开发的智能摄影测量和遥感影像处理技术。这些技术可以从某些角度展示出克服影像差异问题的一些方法,以实现稳定高精度的处理结果;也可以给出一些实例以展示如何创新性地使用相机和影像来实现创新性应用,从而增强信息容量和改善用户体验。

1 CRC-AGIP实验室和GGE的例子 1.1 UNB-PanSharp超过70%的光学地球观测卫星和许多现代航空数字相机能够同时拍摄低分辨率多光谱(MS)影像和高分辨率全色(Pan)影像[4]。在不同的传感器MS波段的数量和Pan影像的光谱带宽经常有变化,另外季节性差异和地域性差异也会导致影像信息的差异。如果使用“静态的”Pan锐化方法,这些差异经常导致不同的Pan锐化结果。因此开发出“智能的”Pan锐化算法以便能识别影像的差异非常重要,无论传感器、季节和地区的差异如何,它都可以全自动地产生稳定的高质量的Pan锐化结果。

为了在融合过程中确定影像的差异,笔者开发了UNB-PanSharp算法。该算法利用最小二乘法来找到MS和Pan波段之间的最佳拟合信息,然后利用此信息来调节影像处理参数,以达到Pan锐化的最佳效果[5]。UNB PanSharp是一个面向影像的Pan锐化方法,因为它在融合过程中,对每组Pan和MS影像都根据其影像信息进行分别处理。无论传感器、季节和区域差异如何,它都能持续稳定地获得良好的融合效果。

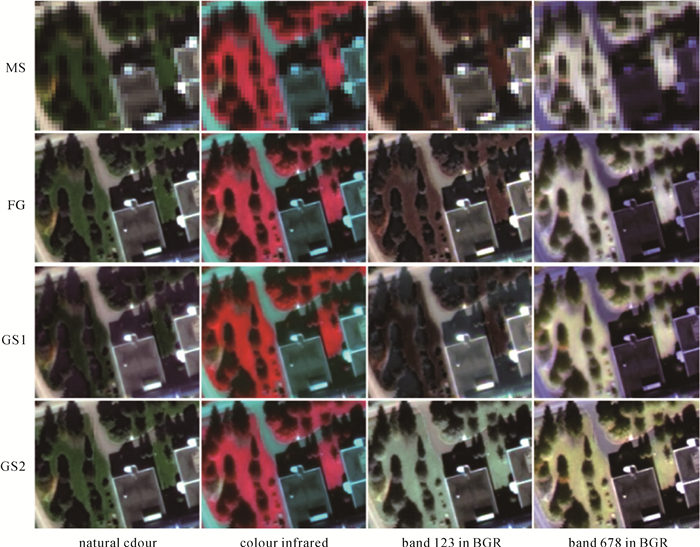

然而,其他流行的Pan锐化算法,基本上是“静态的”方法。它们要么使用一组适合于某个特定传感器的融合参数集(Gram Schmidt及其类似方法),要么使用一组均匀分布于特定MS波段之间的融合参数集(HPF、IHS、PCA、Brovey和小波)来融合所有的遥感影像。因此它们有时能获得良好的融合效果,有时则不能[6]。图 1和图 2显示了UNB-PanSharp融合结果、Gram Schmidt融合结果以及它们之间的质量差异。Gram Schmidt是最好的一种“静态”Pan锐化方法。

|

| 图 1 原始WorldView-2 Pan影像用作Pan锐化的输入(子集) Fig. 1 Subset of original WorldView-2 Pan image used as an input for pan-sharpening |

|

| 图 2 WorldView-2 MS不同波段的彩色影像 Fig. 2 Subset of original WorldView-2 MS color image 注:UNB PanSharp、ENVI Gram Schmidt(GS1)和ESRI Gram Schmidt(GS2)的Pan锐化结果,以及它们之间的质量差别。 |

实验室研究结果证明,UNB PanSharp可以准确地保存MS影像的颜色和Pan影像的空间信息,获得保真的、无损失的融合结果。同时,Pan锐化后的彩色影像的信噪比(SNR)优于用高分辨率MS传感器直接采集的高分辨率彩色影像[7]。这也说明了为什么现代高分辨率卫星,不直接用高分辨率MS传感器,而采用高分辨率Pan和低分辨率MS传感器来采集高分辨率彩色影像。

由于其卓越的融合质量和一步完成的全自动处理,UNB-PanSharp被PCI Geomatics,DigitalGlobe,NASA等全球领先的工业、政府和学术机构所使用。伊士曼柯达是DigitalGlobe的高分辨率卫星相机的制造商,它拥有一个影像融合专利,对本公司卫星相机的影像进行全面锐化。然而DigitalGlobe选择了UNB-PanSharp,对其卫星影像进行全面锐化,而不使用伊士曼柯达的融合技术。由于其国际性影响,UNB PanSharp于2006年被国际大学技术经理人协会选为国际大学杰出技术之一,并且录入“从研究到实现的技术转让100例”。其他被选入该100例的技术来自麻省理工学院、耶鲁大学、斯坦福大学、哥伦比亚大学和布朗大学等著名大学。

1.2 卫星影像在线制图和街景技术“一张图片胜过千言万语”,使用卫星影像进行制图和导航可以明显地增加可感知的信息,卫星图像远远超出传统的线图,它也可以显著地改善用户体验,为了有效地利用影像进行制图和导航,加拿大新不伦瑞克大学大地测量与地球空间信息工程系于2000年启动了卫星影像在线制图和街景技术的研究和开发。

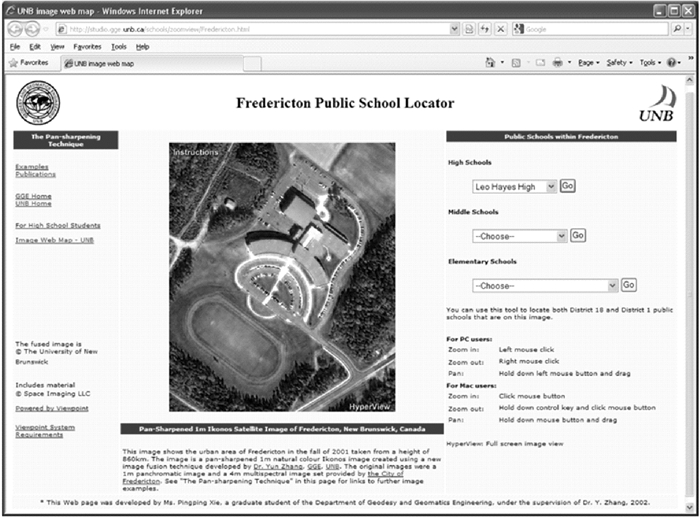

卫星影像在线制图。笔者的研究小组于2001年初展开了卫星影像在线制图的深入研发。2002年为加拿大弗雷德里克顿市社区和学校开发了一个在线卫星影像制图系统(图 3)。使用该系统,用户可以选择一个目的地,然后从当前位置“飞”到目的地(图 3中的Leo Hayes高中)。用户也可以显示全屏视图,以便放大、缩小和平移全屏影像。从2002年到2006年,在谷歌采用高分辨率卫星影像在线制图之前,这个系统已被广泛地使用于弗雷德里克顿当地社区,早在谷歌开始引入卫星影像在线制图的3年之前,我们的卫星影像在线制图系统就已经出版。

|

| 图 3 2002年发布的GGE卫星影像在线制图系统的功能之一 Fig. 3 One function of the online satellite image mapping system developed in GGE which was released in 2002 |

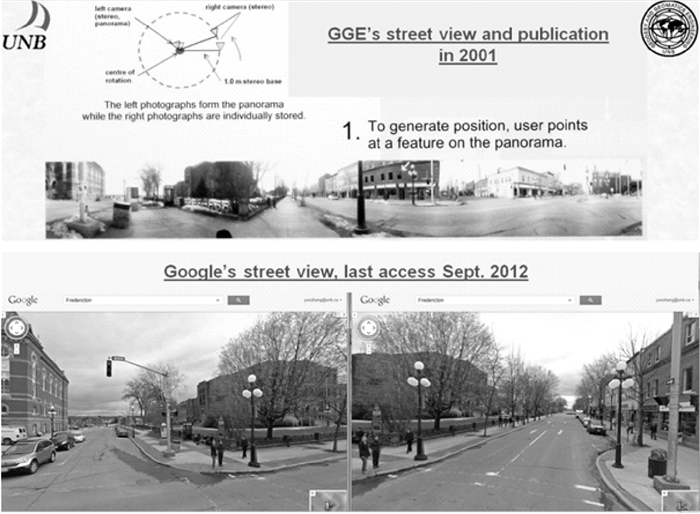

街景技术。在Y.C.Lee教授的倡导和领导下,GGE的一个研究小组开发了一个街景技术并于2001年发表了该技术[8]。该研究旨在于为城市地理信息系统创建一个街道全景以便用户利用照片进行更直观的城市导航,该技术也可以给用户提供一个虚拟的城市旅游景观。图 4和图 5显示了其基本原理、街景影像和用于拍摄街道全景图的摄像机。

|

| 图 4 街景技术和街景影像 Fig. 4 Street view technologies and images 注:图为加拿大弗雷德里克顿市政厅交叉口地区,上图为2001年的GGE街景技术;下图为Google地图今天的街景。 |

GGE的街景技术是为传统地理信息系统(GIS)开发的,因为在2000年在线制图技术和系统还处于起步阶段,未得到广泛使用。通过街景图像,地理信息系统的用户可以很直观地看到相关的内容,以帮助更好地理解系统中的信息。这有助于用户进行定位并了解所在地区的环境。6年之后,斯坦福大学于2007年推出了街景技术(图 5右下),这一技术被Google收购并用于谷歌地图[10]。

从图 4和图 5可以看出,谷歌的街景全景图与GGE的街景全景图非常相似,Google的街景相机也与GGE的街景相机非常相似。唯一的区别是GGE使用一个数码相机,通过旋转相机来拍摄多张照片,然后镶嵌成全景图像;而斯坦福和Google使用一组相机,一次同时拍摄多张照片,然后镶嵌成全景图像。

此外GGE的街景技术使用了第二台相机来拍摄立体像对(图 4和图 5)。第二张照片是用于创建3D深度,以测量从相机到图像中目标物的距离;也就是说用户可以通过点击鼠标来获得距离。近年来Google和其他公司正在使用类似的概念,来拍摄全景立体像对,为虚拟现实(VR)技术提供3D内容。

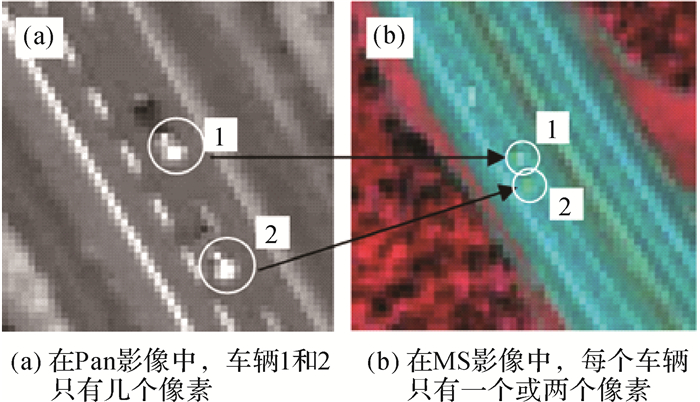

1.3 单套卫星影像移动车辆检测约90%的高分辨率(1 m或更高)光学卫星,同时拍摄低分辨率的MS影像(图 6(a))和高分辨率的Pan影像(图 6(b))。由于Pan和MS传感器共用一个望远镜镜头,Pan和MS传感器的光轴不可平行。Pan和MS传感器之间有一个非常小的视角差,导致Pan和MS影像之间有很小的时间差异。因此所有移动物体都被拍摄在影像的两个稍微不同的位置(见图 6(c)(d))。

|

| 图 6 移动物体在MS和Pan影像中的位置差异 Fig. 6 Position difference of moving objects in MS and Pan images 注:黄圈为移动物体,红圈为静态物体。 |

这个位置偏移导致影像融合中的配准问题(图 6(d))。但是笔者的研究小组利用它进行运动目标检测和移动信息提取。然而由于时间的延迟很小、像素的尺寸接近移动车辆的尺寸、加上地形的高程差异引入的影像偏移,进行准确地移动信息检测,具有非常高的挑战性。

笔者的研究团队于2006年成功地开发了一套新的算法和计算机软件。它能准确地探测运动物体并计算出移动速度。该算法包含一个改良的传感器模型,一个新的汽车探测方法和一个新的速度计方法[11]。传感器的视角,地形的高程差以及Pan和MS影像之间的分辨率差异,都被考虑到速度计算的程序中。

试验结果表明,用QuickBird Pan(0.7 m)和MS(2.8 m)影像进行速度探测,其精度可以达到±20 km/h,尽管影像的分辨率有限(图 7)。用GeoEye-1影像(Pan 0.5 m,MS 2 m,飞行高度680 km)进行速度探测,其精度可达到±10 km/h。该研究成果发表于2008年美国摄影测量工程与遥感杂志(PE&RS)[12]。并于2009年被ASPRS评选为应用论文John I.Davidson学会主席奖第一名。

|

| 图 7 在QuickBird Pan和MS影像中确定车辆位置的挑战 Fig. 7 Challenge in determining vehicle's position in QuickBird Pan and MS images |

1.4 有监督影像分割

影像分割是影像分类中的一个关键过程。基于对象的影像分类是高分辨率遥感影像分类的主流方法。然而,诸如eCognition之类的最新影像分割技术仍然严重依赖于操作者的经验来达到适当分割结果。操作者需要通过反复试验才能找到一组合适的分割参数。然而反复试验是一个非常耗时的过程,操作人员的经验也很大程度地影响分割的准确性。

为了克服这个问题,CRC-AGIP实验室在2005年开发了一个突破性的、基于模糊分析的有监督分割(FbSS)算法[13]。该算法随后被开发成一个有监督的分割软件包[14]。此算法利用模糊逻辑的方法,通过计算机训练和模糊逻辑分析(图 8)来找到一组最佳的分割参数。该软件包可以集成到eCognition中以快速地实现优化的分割结果(图 9),无需操作员的反复试验。

|

| 图 8 基于模糊分析的有监督分割过程 Fig. 8 Process of the fuzzy-based supervised segmentation |

|

| 图 9 基于模糊分析的有监督分割、在eCognition环境中的街道分割示例 Fig. 9 Example of street segmentation obtained using the parameters identified by the Fuzzy-based supervised segmentation software in the eCognition environment |

该软件具有易于使用、快速准确的性能,它不需要用户具有操作经验。通过简单的培训,普通操作者就能生产覆盖整个影像的令人信服的分割结果。

1.5 平滑区域影像匹配在数字摄影测量中,影像匹配是必不可少一步。三维重建、变化检测、计算机视觉和模式识别都需要影像匹配。准确的影像匹配取决于能否找到密集、准确和均匀分布的特征匹配点。尽管已有大量的影像匹配算法,如何在大面积光滑区域中找到密集而准确的匹配点仍然是最先进算法的难点。因此,平滑区域的影像匹配仍然是一个非常具有挑战性的问题。

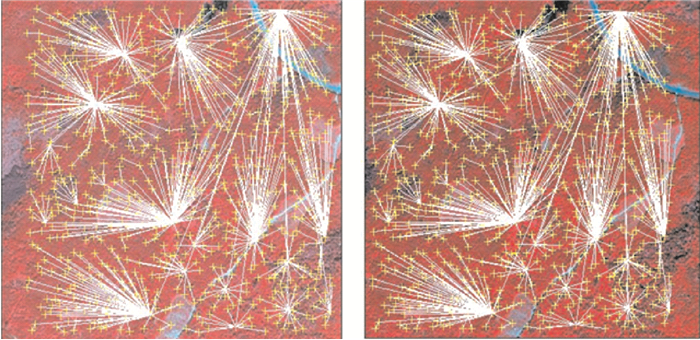

为了解决这个影像匹配问题,CRC-AGIP实验室在2008年开发了一种新的算法:基于控制网络的匹配算法。该算法首先找到像对中最突出的几个匹配点,即“超级点”。然后利用这些“超级点”在两幅影像中建立一个匹配控制网络。在该网络的基础上不断地搜索并扩展新的匹配点,直到覆盖整个影像像对,包括影像的平滑区域(图 10)。

|

| 图 10 基于控制网络的匹配算法 Fig. 10 Feature points matched by the control network based matching technique 在森林区域中的特征点匹配,影像像对:QuickBird MS(2.8 m) |

对各种遥感影像进行的试验表明,该算法可以在影像中的任何区域成功地找到匹配点,包括平滑区域;但是不包括发生了变化的区域(如水域等)。因为控制网络可以指导匹配点的搜索,该算法比传统的匹配方法快,显著地提高了匹配搜索的效率。

1.6 使用不同视角的影像进行变化检测变化检测是遥感中最重要的应用之一。变化检测的准确性在很大程度上取决于影像配准的精度。然而,用于变化检测的影像是从不同的视角拍摄的,特别是高分辨率影像准确配准的难度非常大。在地表高程物体存在的地区(如城市地区),这一困难更加突出。另外如果影像是由不同类型的相机拍摄的,即线性投影卫星相机和中心投影机载相机,用它们进行变化检测的挑战性更大。因此,绝大多数发表的文章仅使用最低点(nadir)影像进行变化检测或者选择平坦区域进行变化检测。

然而,95%以上的高分辨率卫星影像具有5°到30°的偏最低点(off-nadir)拍摄角度。对于中心投影航空照片,只有一个影像点具有最低点视角,而其他影像区域都具有不同的视角。因此,95%以上的高分辨率遥感影像不能被有效地用于变化检测。

为了克服这一问题,CRC-AGIP实验室开发了一个分块匹配(Patch-Wise CoRegistration,PWCR)算法。PWCR算法首先使用分割技术将一幅影像(称为基础影像)分割为片段/块(patches)(图 11(a)),然后根据从影像像对(或从数字表面模型)导出的3D信息,以及根据两幅影像的有理多项式系数(RPC),将每个单独的分割块从基础影像投影到目标影像(图 11(b)(c))。通过这种方式,每个地物块(patch)可以从基础影像投影到目标影像以消除高程差带来的匹准误差。因此,基础影像中的每个分割块可以被准确地投影到其在目标影像中的位置,实现准确的分块配准。然后,使用变化检测算法来比较相应的分割块内的光谱信息,以找到变化的分割块。由于配准精度的显着提高(在有地表高程物存在的地区,配准精度比传统的配准方法提高80%),城市地区的变化检测结果达到了90%以上的精确度[15](图 12)。

|

| 图 11 分块匹配(PWCR)的结果 Fig. 11 Results of patch-wise co-registration (PWCR) |

|

| 图 12 基于PWCR的变化检测 Fig. 12 PWCR based change detection |

由于其潜在的广泛影响,该变化检测技术引起了加拿大主要媒体和研究基金委员会的关注。加拿大国际广播电台,加拿大国家级新闻报刊《环球邮报》,加拿大自然科学与工程研究基金委员会(NSERC)和加拿大创新基金委员会(CFI)都报道了该研究成果。

2 结论当前正处于一个大数据时代,星载、机载和地面像机等各种遥感像机,正在被广泛地应用于世界各地,以不同的方式采集不同的影像并用于不同的应用场合。传统的摄影测量与遥感技术在解决遥感影像的基础问题中仍然起着重要的作用。但是,由于影像的几何和光谱复杂性的显著增加以及影像的多样化,传统技术已经远不能满足今天需求。因此开发具有一定“智能性”的新算法和新技术是必不可缺的,以便能识别和处理影像的差异,达到稳定的高质量结果。此外,创造性地或“巧妙地”利用现有数码相机和影像来开发创新性应用,也是一个必然的趋势。

| [1] | SCHENK T. Introduction to Photogrammetry[G]. Neil Ave, Columbus, OH: The Ohio State University, 2005. |

| [2] | GRUEN A. Digital Photogrammetric Imaging-Past, Present and Future[R]. Federal: The Swiss Federal Institutes of Technology (ETH), 2009. |

| [3] | BAUMANN P R. History of Remote Sensing, Satellite Imagery, Part Ⅱ[G]. New York, NY: State University of New York, 2009. |

| [4] | ZHANG Yun. Ten years of Technology Advancement in Remote Sensing and The Research in the CRC-AGIP Lab in GGE[J]. Geomatica, 2010, 64(2): 173–189. |

| [5] | ZHANG Y. Highlight Article:Understanding Image Fusion[J]. Photogrammetric Engineering and Remote Sensing, 2004, 70(6): 657–661. |

| [6] | ZHANG Yun, MISHRA R. From UNB PanSharp to Fuze Go-the Success Behind the Pansharpening Algorithm[J]. International Journal of Image and Data Fusion, 2014, 5(1): 39–53. DOI:10.1080/19479832.2013.848475 |

| [7] | ZHANG Yun, ROSHAN A, JABARI S, et al. Understanding the Quality of Pansharpening:A Lab Study[J]. Photogrammetric Engineering & Remote Sensing, 2016, 82(10): 747–755. |

| [8] | RAWLINSON S, LEE Y C, ZHANG Y. Development of a Software Prototype for the Geo-referencing and Visualization of Non-metric TERRESTRIAL Photography in a GIS Environment[C]//Proceedings of the 23rh to 27th ASPRS 2001 Annual Conference. St. Louis, Missouri: ASPRS, 2001. |

| [9] | LEVITZ S. Putting the North on the Map: Google Recruits Northerners for Help with Maps[M]. [S. l. ]: The Canadian Press, 2012. |

| [10] | GANNES L. Ten Years of Google Maps, From Slashdot to Ground Truth[EB/OL]. [2015-02-08]. https://www.recode.net/2015/2/8/11558788/ten-years-of-google-maps-from-slashdot-to-ground-truth. |

| [11] | XIONG Zhen, ZHANG Yun. A Novel Interest Point Matching Algorithm for High Resolution Satellite Images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2009, 47(12): 4189–4200. DOI:10.1109/TGRS.2009.2023794 |

| [12] | XIONG Zhen, ZHANG Yun. An Initial Study on Vehicle Information Extraction from Single Pass of Satellite QuickBird Imagery[J]. Photogrammetric Engineering and Remote Sensing, 2008, 74(11): 1401–1412. DOI:10.14358/PERS.74.11.1401 |

| [13] | ZHANG Yun, MAXWELL T. A Fuzzy Logic Approach to Optimization of Segmentation of Object-Oriented Classification[C]//Proceedings of SPIE 50th Annual Meeting-Optics & Photonics 2005. San Diego, California, USA: SPIE, 2005. |

| [14] | TONG Hengjian, MAXWELL T, ZHANG Yun, et al. A Supervised and Fuzzy-based Approach to Determine Optimal Multi-resolution Image Segmentation Parameters[J]. Photogrammetric Engineering & Remote Sensing, 2012, 78(10): 1029–1044. |

| [15] | JABARI S, ZHANG Yun. RPC-Based Coregistration of VHR Imagery for Urban Change Detection[J]. Photogrammetric Engineering & Remote Sensing, 2016, 82(7): 521–534. |