遥感影像变化检测是遥感图像应用中的一个重要研究内容,尤其在军事、建筑用地监测、土地利用变化和灾害评估等方面[1-2]。随着影像空间分辨率的提高,同类地物内部光谱差异逐渐增大,基于像元光谱统计的自动变化检测技术已经不能满足当前遥感图像变化信息提取的要求,成为制约高分辨率遥感图像广泛应用的主要瓶颈[3]。面向对象技术的出现,为高分辨率遥感影像分析提供了新的思路,变化检测的基本单元也由像素逐渐过渡到对象[2]。由于对象级变化检测算法比像素级变化检测算法更具优势,因此近年来得到了广泛关注和发展[3-7]。

在像素级水平上利用多时相遥感影像进行地表覆盖变化检测,其中文献[8-9]结合模糊c均值聚类(FCM)和马尔科夫随机场(Markov random field, MRF)模型,提出了一种非监督的变化检测算法,相较于只利用单一方法,确实能够提高检测精度。文献[10-12]通过考虑影像上区域之间的邻接限制关系,分别利用水平集(level set)模型及条件随机场(conditional random field,CRF)模型来进行变化/未变化区域的提取。文献[6]则提出了一种尺度驱动的面向对象变化检测模型,对分割结果存在的尺度不确定性进行分析,减弱了分割不确定性对变化检测结果的影响。文献[7]利用自适应权重的变化向量分析(change vector analysis,CVA)方法,通过提取变化强度信息和变化方向信息,来达到面向对象土地利用图斑变化检测的目的,但是对象特征和阈值的选取对最终结果的影响较大。针对单一尺度上进行变化信息提取,较容易出现漏检现象,有学者提出了基于多尺度分割与融合的变化检测方法,与单尺度相比,能够显著改善检测精度[5, 28]。此外,文献[13-14]分别利用基于视觉词袋模型(bag of visual word,BOVW)和隐狄利克雷分配模型(latent Dirichlet allocation, LDA),进行基于场景分析的变化检测,与常规遥感变化检测方法相比,这些新模型能有效地减少错漏判,提高检测的总体正确率,为遥感影像变化检测提供了新的思路。但是,这些新模型更适用于基于场景的变化检测,而场景的类别往往需要人的先验知识来构建。文献[15-17]分别将深度学习(deep learning)算法和智能学习算法用于遥感影像的变化检测过程中,并与传统的变化检测方法进行对比,也进一步表明这些新算法的优越性。虽然已经有很多学者从基于像素和基于对象的角度,针对不同的应用目的,提出了大量的变化检测方法和理论模型,但是却较少有人将基于像素和基于对象的变化检测过程结合起来进行分析。其中,文献[18-20]分别尝试将两种图像分析方法进行有效集成,并应用在土地利用分类、建筑区提取和SAR洪水变化检测应用研究上,并取得了不错的试验效果。从这些研究中可以看出,集成两种图像分析方法的优势,可以进一步获取更好的图像分析结果。

一般而言,面向对象的图像分析与基于像素的图像分析是相互补充的关系。集成两种图像分析方法的目的是为了获得更好的图像分析结果。两种方法的集成也可以分为两种情况:一种情况是两种方法并行执行,之后再进行综合,从而获得好的图像分析结果;另一种情况是两种方法串行,这样使得一种方法获得结果作为另一种方法执行的前提,最终获得更好的图像分析结果。本文采取第2种串行策略,提出了一种联合像素级和对象级分析的遥感影像变化检测新方法。

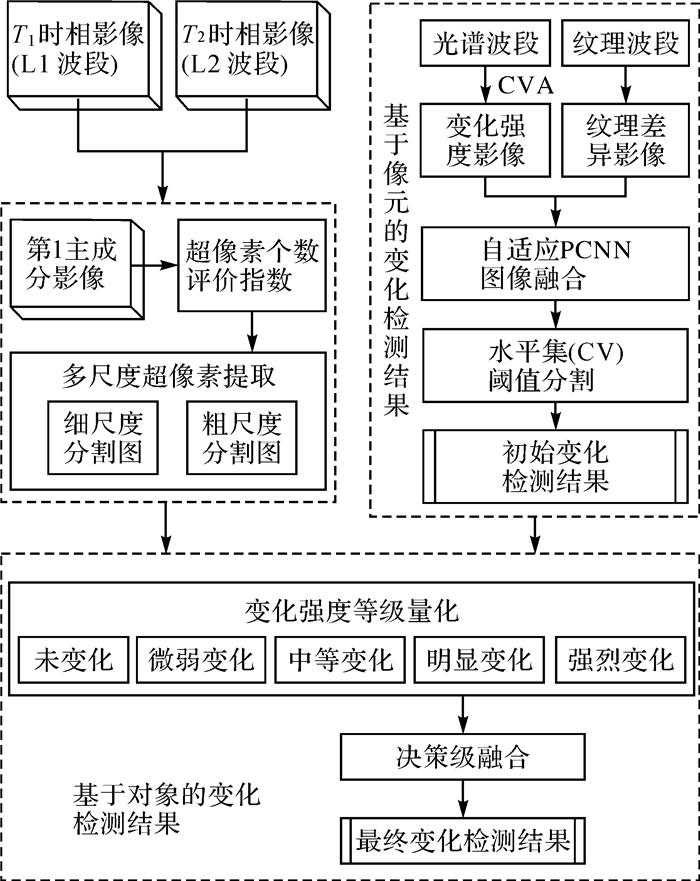

1 研究方法本文所提出的变化检测算法,其整体流程如图 1所示,主要包括以下步骤:① 对两时相影像进行光谱特征和纹理特征差异分析,并对两种特征的差异影像进行自适应PCNN图像融合,对融合后的影像利用Chan-Vese方法进行阈值分割,获取初始的像素级检测结果;② 将两时相影像进行叠合,对叠加影像进行主成分分析,利用基于熵率的超像素分割方法对第一主成分影像进行粗、细尺度上的分割;③ 在像素级变化检测结果基础之上,利用多尺度区域标记矩阵对检测结果进行变化强度等级量化和决策级融合,作为变化检测的后处理部分,以获取最终的对象级检测结果。

|

| 图 1 变化检测算法整体流程 Fig. 1 The flowchart of change detection algorithm |

1.1 光谱差异与纹理差异分析 1.1.1 光谱差异图计算

假设p1和p2分别是T1时相和T2时相相同位置的两个像元,由它们在各个波段的像元值构成它们的特征向量,分别表示为p1(p11, p12, …, p1n)和p2(p21, p22, …, p2n),其中n为波段数,那么变化向量就可以表示为pc(p21-p11, p22-p12, …, p2n-p1n)。通过计算每个像元的变化强度‖pc‖,就可以获取两个时相影像的变化强度影像N1。如果‖pc‖>δ(δ为变化阈值),则说明p1和p2位置发生变化,否则没有发生变化。

(1)

(1)

灰度共生矩阵(gray-level co-occurrence matrix, GLCM)是通过研究灰度的空间相关特性来描述纹理的方法,作为重要特征被广泛应用于遥感影像分类、变化检测中。该矩阵中的元素值代表灰度级之间联合条件概率密度p(i, j/d, θ),其中,p(i, j/d, θ)表示在给定空间距离d和方向θ时,统计以灰度i为起始点,出现灰度级j的概率[21]。常用于遥感影像纹理信息提取的特征统计量有8种,本文选取了其中的4种:能量(energy)、相关性(correlation)、对比度(contrast)、同质性(homogeneity),用于计算遥感影像的纹理特征图。本文将试验数据集的原始RGB影像转为灰度影像,分别以3×3、5×5、7×7像元窗口提取T1时相和T2时相灰度影像的纹理特征数据,然后对纹理特征图进行差值运算,形成纹理差值影像N2。试验结果证明相关性(correlation)统计量能够较好地反映出T1时相和T2时相影像中纹理信息的差异,并且纹理提取窗口设置为3×3像元时能够获取更多的纹理差异细节信息。因此,本文最终以3×3像元窗口分别获取两期影像的纹理相关性特征数据fcorre,计算公式如下

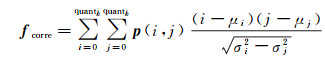

(2)

(2)

式中,quantk为灰度量化等级;p(i, j)为联合条件概率密度;μi为共生矩阵第i行的均值;μj为共生矩阵第j行的均值;σi为共生矩阵第i行的标准差;σj为共生矩阵第j行的标准差。为了使纹理数据和光谱数据具有相同的取值区间,需要对这两种数据进行归一化处理[21],计算公式如下

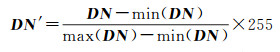

(3)

(3)

归一化处理后的变化强度影像记为N′1;归一化后的纹理差值影像记为N′2。

1.2 自适应PCNN神经网络图像融合算法为了综合利用光谱特征变化信息和纹理特征变化信息,本文采用自适应PCNN神经网络方法对这两种差异信息进行融合[22]。该方法能够很好地克服两种特征差异信息的不足之处,融合后的影像能够有效地抑制背景信息,增强并突出变化的部分,有利于进行下一步的阈值分割操作,能够更加准确地提取影像中的变化信息。

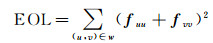

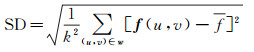

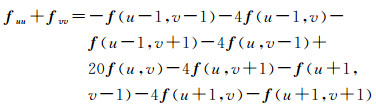

用自适应PCNN图像融合算法来获取新的融合影像。其基本原理是:将变化影像中的像素的EOL和SD值分别作为PCNN神经网络对应神经元的连接强度值,其中,EOL值反映了图像局部的清晰度,SD值反映了图像灰度局部的对比度变化程度[22]。为了得到参与融合影像的每一个特征对应的点火映射图,需要通过PCNN点火来实现,并利用加权函数来构造参与融合影像的新点火映射图。最后通过对各个图像对应的新点火映射图进行比较,融合后的该像素点的像素值取为点火次数的最大者[22]。在每个像素(x, y)处,EOL和SD值分别定义为

(4)

(4)

(5)

(5)

(6)

(6)

式中,f(u, v)是(u, v)处的像素值;w是以(x, y)为中心,大小为k×k的窗口,k为奇数,一般选择3或者5,本文中参数k=3;f是窗口w中所有像素灰度平均值[23]。

本文将N′1作为PCNN1和PCNN2中各个神经元相应的反馈输入,N′2作为PCNN3和PCNN4中各个神经元相应的反馈输入。根据EOL和SD的定义,分别计算N′1和N′2中每个像元的EOL,用来表示网络PCNN1和PCNN3中相应的神经元之间的连接强度值;再分别计算每个像素的SD,用来表示网络PCNN2和PCNN4中相应的神经元之间的连接强度值,并令Lij(0)=Uij(0)=Tij(0)=Yij(0)=0,θij(0)=1。加权函数定义为[23]

(7)

(7)

式中,

(8)

(8)

本文首先将多时相影像进行叠合,对叠加影像进行主成分分析,并对提取的第一主成分影像进行熵率超像素(entropy rate super-pixel segmentation)分割[24]。在分割过程中,具体使用多少个超像素为宜,即平衡性的问题,是提高影像分割质量的关键。

对于面向对象遥感信息提取方法中的多尺度分割来说,每一种地物的最优分割尺度是相对的,通常在一个数值范围内。遥感影像分割的理想结果是分割所得到的对象内部具有良好的同质性,同时相邻对象之间具有良好的异质性[25]。本文采用超像素个数评价指数(evaluation index of super-pixel number)来衡量分割结果的好坏。该指数定义指地类能用一个或几个超像素来表达,超像素大小与地物目标大小接近,超像素多边形不会太破碎,超像素边界比较分明,内部异质性尽量小,不同类别之间的异质性尽量大。而且超像素能够表达某种地物的基本特征,其中内部同质性保证超像素的纯度,而超像素之间的异质性保证超像素的可分性[25]。在试验过程中,本文通过设置不同的超像素个数,获取多层次不同尺寸大小的超像素区域。分割的试验目的是尽可能将同一种类型的地物分割在一起,最终形成一系列紧凑、区域一致性较强的同质区域。利用超像素个数评价指数,来获取粗、细尺度上的分割结果,有效降低人为试错的时间成本,避免人工选取超像素个数的主观性。

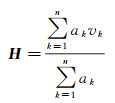

1.3.1 对象内部的同质性本文采用超像素的标准差表示其内部同质性,计算公式如式(9)。其中ak表示超像素k的面积大小,实际以超像素内部像元个数表示;vk表示超像素k的标准差;n为影像分割时超像素的总个数。计算公式相当于加入面积权重,面积比较大的超像素具有较大的权重,这样能够降低小超像素引起的不稳定性。H越大,超像素内部同质性越高。

(9)

(9)

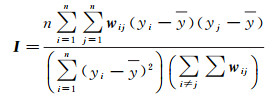

空间自相关性是遥感图像数据特有的属性,并且是空间对象可分性的一个强指示器[25]。本文利用Moran’s I指数来表示超像素之间的异质性,计算公式如下

(10)

(10)

式中,wij表示超像素i和超像素j是否相邻;如果wij=1,则表示相邻,如果wij=0,则表示不相邻;yi表示超像素i的平均灰度值;yj表示超像素j的平均灰度值;y表示影像的平均灰度值。I的值越小,表示超像素之间的相关性越低,超像素之间的分割边界越明确。

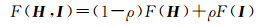

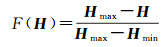

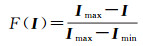

1.3.3 全局分割质量函数本文采用文献[26]提出的公式(11) 来表示超像素个数评价指数。它是利用超像素的同质性指数和异质性指数来构建衡量分割好坏的质量函数,其公式如下

(11)

(11)

式中,F(H)表示同质性评价指数;F(I)表示异质性评价指数;ρ为异质性权重,同质性权重为1-ρ,ρ∈[0,1],本文取ρ=0.5。综合同质性指数和异质性指数对超像素个数进行评价前,需要将它们进行归一化处理,如下式

(12)

(12)

(13)

(13)

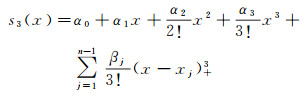

在此基础上通过三次样条函数插值的方法就可以得到一个超像素个数选取的计算模型

(14)

(14)

当函数s3(x)在超像素个数区间[xmin, xmax]取得极大值时,所对应的超像素个数x,即为最优的超像素个数。通常x具有多个值,本文选取了粗尺度和细尺度上的分割结果,来进行后续的变化检测试验。

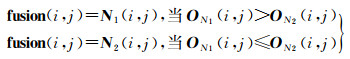

1.4 决策级融合(decision level fusion)由于像素级的变化检测结果较容易出现“椒盐现象”,导致最终的变化检测结果会出现很多孤立的点。针对此现象,本文将带有区域标记的多尺度超像素分割结果应用在像素级的变化检测结果之上,进行决策级融合。

假设每个超像素Si内包含的像素总个数为Numt,其中属于变化像素的个数为Numc,未变化像素的个数为Numu,显然Numc+Numu=Numt。本文根据每个超像素区域内的变化像素比例w(其中w=Numc/Numt),定义了以下变化强度W以便将初始变化差异图量化为-2~2之间,采用下面的分段函数形式

(15)

(15)

式中,-2、-1、0、1、2分别代表未变化、微弱变化、中等变化、明显变化、强烈变化的区域值[27-28]。

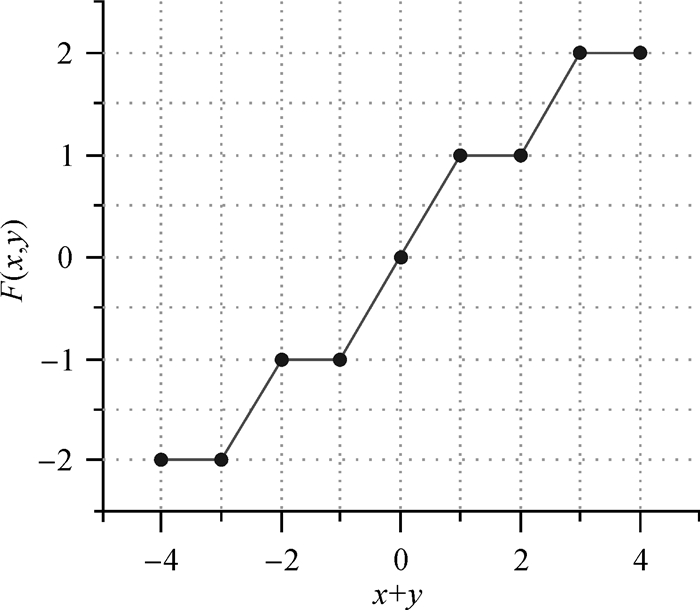

本文采用多尺度超像素分割技术,获取不同大小的超像素区域,使得不同尺寸的地物目标能对应较优的分割尺度,从而保证了信息提取的精度[27]。为了综合粗尺度和细尺度下的变化检测结果,本文通过多值逻辑建立决策融合规则,将两个尺度下的检测结果融合成一幅变化强度图,以便于综合性地检测变化发生的位置以及变化的强度。图 2对应了一个五值的多值逻辑函数F(x, y),具体的决策级融合规则如表 1所示。当两个尺度(x, y)的变化强度大时,那么融合的变化强度也应较大,反之亦然[27-28]。例如:当F(x, y)=2时,此时x+y=3或x+y=4,说明两个尺度(x, y)中至少有一个超像素区域为强烈变化,另一个超像素区域至少为明显变化的区域,决策级融合规则定义合成的强度就应该为强烈变化,这样才能充分体现两个尺度上的变化强度信息。如果将决策级融合后的变化强度影像中的未变化与微弱变化区域视为不变化,其余视为变化的区域,就可以得到最终的二值化检测结果。

|

| 图 2 逻辑函数F(x, y) Fig. 2 Logical function F(x, y) |

| 细尺度 | 粗尺度 | ||||

| 未变化 | 微弱变化 | 中等变化 | 明显变化 | 强烈变化 | |

| 未变化 | 未变化 | 未变化 | 未变化 | 微弱变化 | 中等变化 |

| 微弱变化 | 未变化 | 微弱变化 | 微弱变化 | 中等变化 | 明显变化 |

| 中等变化 | 未变化 | 微弱变化 | 中等变化 | 明显变化 | 明显变化 |

| 明显变化 | 微弱变化 | 中等变化 | 明显变化 | 强烈变化 | 强烈变化 |

| 强烈变化 | 中等变化 | 明显变化 | 明显变化 | 强烈变化 | 强烈变化 |

2 试验结果与分析

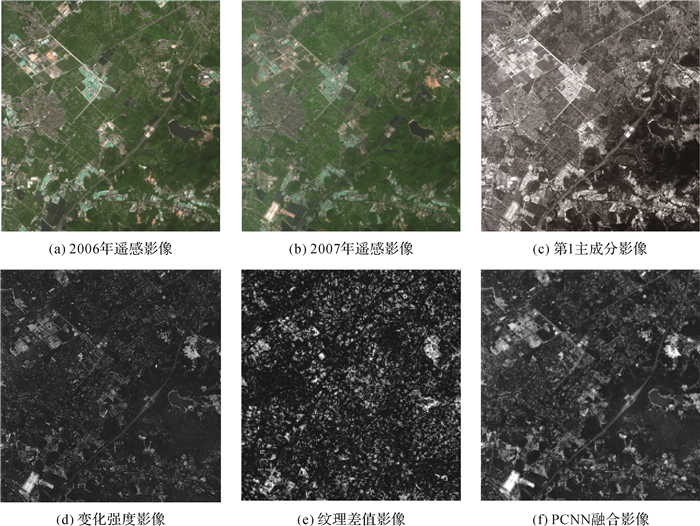

为了综合验证所提方法的可行性和有效性,本文采用的试验数据为2006年和2007年获取的广州市SPOT 5多光谱彩色影像,空间分辨率为2.5 m,主要包含红、绿、蓝3个波段,影像大小为1871×1774像素,测试区主要由水体、聚落群、工厂建筑物、耕地、裸地等地物构成,两期影像分别如图 3(a)和图 3(b)所示(见文后)。

|

| 图 3 试验数据集 Fig. 3 Datasets used in the experiment |

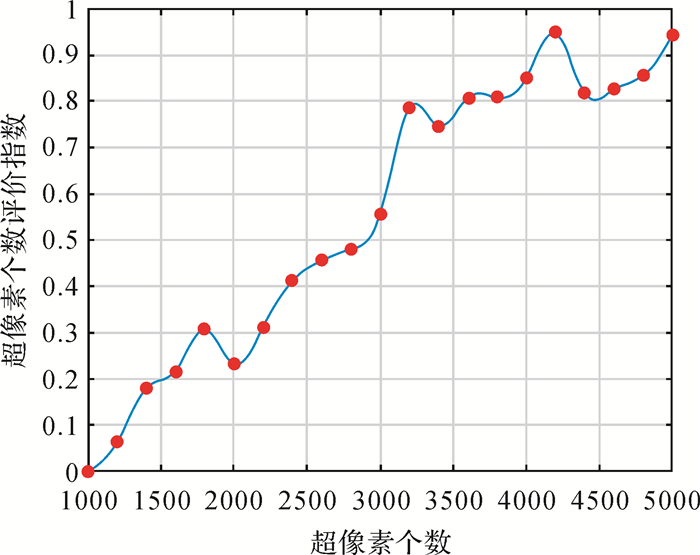

为了综合利用前、后时相影像的光谱信息,本文采用影像叠合的方式形成叠加影像(共6波段),并对叠加影像进行主成分分析,提取的第一主成分影像结果如图 3(c)所示。本文在综合提取光谱变化强度影像和纹理差值影像之后(图 3(d)和图 3(e)所示),对这两种差异影像采用自适应PCNN神经网络融合,形成新的差异融合影像(图 3(f))。从结果中可以看出,新的融合影像在充分利用光谱变化强度信息基础之上,能够将纹理差异信息进行有效融合,降低了由于辐射差异造成的诸多虚假差异。然后,本文在区间[1000,5000]内对第一主成分影像进行熵率超像素分割,步长为200,并计算分割后每个尺度下的总体评价指数值F(H, I),然后对其进行三次样条函数插值,插值结果如图 4所示。从图中可以看出:函数在超像素个数区间[1000,5000]内,具有多个极大值,进一步说明遥感影像的最优分割尺度其实是相对的,通常在一个数值范围内。本文根据三次样条函数插值的结果,选取超像素个数nC=1800,作为粗尺度上的分割结果,选取nC=4200作为细尺度上的分割结果。在这两个尺度上,超像素个数评价指数F(H, I)都为区间上的极大值;在粗尺度上,当分割的超像素总数为1800时,此时F(H, I)值最大,即整体上来说,在这个尺度上,超像素内部多呈现均质,不同超像素之间多呈现异质。同理,当分割的超像素数量逐渐增大时,此时F(H, I)值呈上升的趋势,分割得到的区域数越来越多;当分割的超像素总数为4200时,此时F(H, I)值在邻域区间内最大,即在细尺度上此时得到的分割效果较佳。

|

| 图 4 超像素个数评价指数 Fig. 4 The evaluation index of super-pixel number |

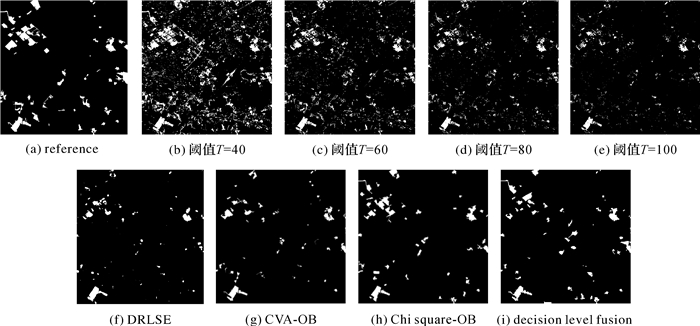

接着,本文将带有区域标号的粗尺度分割图及细尺度分割图与像素级变化检测结果进行联合分析,采用变化强度等级量化和决策级融合,来获取最终的对象级变化检测结果。图 5(a)是根据目视解译结果和实地调绘相结合而制作的标准变化检测影像,黑色区域表示未变化的区域,白色区域表示变化的区域;图 5(b)、5(c)、5(d)、5(e)分别为初始分割阈值T=40、T=60、T=80、T=100下,利用Chan-Vese方法对PCNN差异融合影像进行二值化分割,所获取的变化检测结果;图 5(i)为本文采用决策级融合规则所获取的检测结果。

|

| 图 5 不同方法之间的变化检测结果 Fig. 5 The change detection results by different methods |

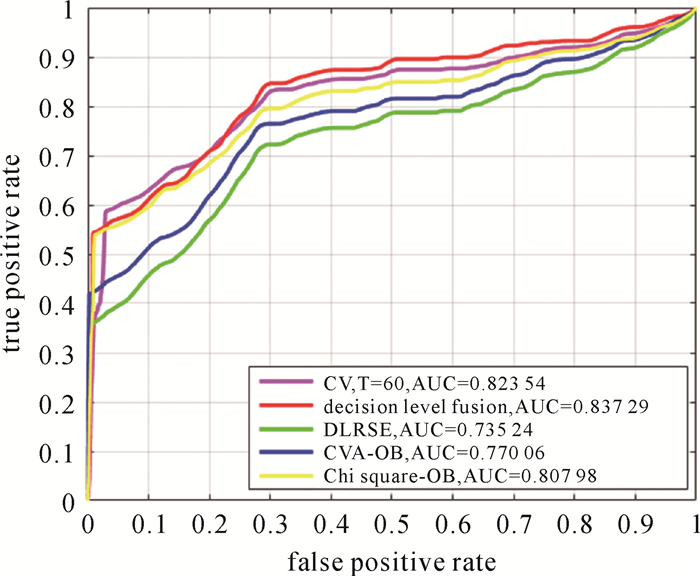

与此同时,将本文方法与文献[29]中所用的距离规则水平集演化(distance regularized level set evolution, DRLSE)模型进行对比(利用DRLSE模型进行变化区域提取时,初始分割阈值为T=75),所得到的结果如图 5(f)所示。此外,本文还与基于对象的变化向量分析[30](object-based change vector analysis, CVA-OB)、基于对象的卡方变换分析[30](object-based chi-square transformation, chisquare-OB)等方法进行了对比分析,并选取了细尺度上的分割结果。当超像素个数为4200时,本文选取每个超像素在不同波段的光谱均值、标准差构成它们的特征向量,利用最大类间方差法(OSTU)来进行自动阈值分割并提取变化区域,所得到的结果如图 5(g)、5(h)所示。为了对所提出的方法性能进行定量评估,本文通过构建混淆矩阵,来计算变化检测结果的精度。试验采用虚检率、漏检率、总体正确率以及ROC曲线下面积(area under curve, AUC)等4个指标来衡量变化检测精度,试验得到的变化检测评定结果如图 6和表 2所示。

|

| 图 6 试验数据的ROC曲线对比 Fig. 6 ROC curve comparison in the study area |

| 变化检测方法 | 正确率 | 虚检率 | 漏检率 | ROC曲线下面积 |

| CV,T=40 | 0.917 4 | 0.603 8 | 0.259 7 | 0.804 5 |

| CV,T=60 | 0.948 0 | 0.439 9 | 0.412 4 | 0.823 5 |

| CV,T=80 | 0.954 3 | 0.323 9 | 0.553 5 | 0.774 7 |

| CV,T=100 | 0.952 9 | 0.252 3 | 0.684 2 | 0.726 0 |

| DRLSE | 0.959 0 | 0.294 1 | 0.523 1 | 0.735 2 |

| CVA-OB | 0.961 2 | 0.313 2 | 0.510 3 | 0.770 1 |

| chisquare-OB | 0.963 9 | 0.226 0 | 0.460 4 | 0.808 0 |

| decision level fusion | 0.965 0 | 0.195 7 | 0.356 4 | 0.837 3 |

从试验结果可以看出:在利用CV水平集方法对差异影像进行分割时,当初始阈值设置为T=60时,此时ROC曲线下面积最大,变化检测的总体精度较高,且好于其他3个初始阈值下的检测结果。因此,本文将此阈值下的分割结果作为初始像素级变化检测结果,用于后续的决策级融合分析。此外,利用DRLSE模型进行演化分割时,变化检测结果精度也较低,虽然其总体正确率和虚检率要优于阈值T=60时利用CV方法所获取的结果,但是其漏检率要明显高于CV方法,而且其迭代演化的时长要明显长于传统的CV方法。而基于对象的变化向量分析(CVA-OB)、基于对象的卡方变换分析(chisquare-OB),其结果从ROC曲线下面积来看,并没有明显优于阈值T=60下的检测结果,而且虚检率和漏检率也较大。这主要是由于其仅在单一尺度上来提取变化信息且过分依赖阈值分割结果的好坏,以及对象的灰度均值信息,而未能有效利用其灰度分布信息,导致最终的检测效果不佳。本文将粗尺度上的变化强度等级量化结果与细尺度上的结果进行联合分析,并采用决策级规则进行融合,作为变化检测的后处理部分。相较于两种基于对象的分析方法,确实能够有效降低变化检测的虚检率和漏检率,提高了总体正确率,其ROC曲线下面积在所有方法中也是最大的,这也进一步证明了本文融合策略的有效性和可行性。

综上所述,在实际的变化检测应用中,可以根据不同的检测目的,将基于像素和基于对象的变化检测过程有机结合起来,这样得到的检测结果不仅较为规整,而且检测对象都对应着实际意义的地理实体,可以有效集成两种方法的优势,以获取最佳的检测精度。

3 结论本文提出了一种联合像素级和对象级分析的遥感影像变化检测算法。该方法克服了基于像素的变化检测方法所造成的椒盐现象,通过引入基于熵率的超像素分割方法,获取多尺度超像素区域,利用带有区域标号的多尺度分割结果与像素级变化检测结果进行联合分析,采用变化强度等级量化和决策级融合,作为变化检测的后处理部分,从而有效降低了变化检测的虚检率和漏检率。但是,本文方法也仍然存在一定的不足之处,从熵率超像素分割算法的角度来讲,其仅考虑了影像的光谱特征进行分割,与优秀的分割算法相比,其对遥感影像的分割质量确实存在一定程度的劣势。因此,在今后的研究中,可以考虑对超像素分割算法进行改进,通过引入梯度和边缘等特征信息,并对分割结果进行区域合并,来进一步提高影像分割的质量。

| [1] | JIA Lu, LI Ming, ZHANG Peng, et al. Remote-sensing Image Change Detection with Fusion of Multiple Wavelet Kernels[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2016, 9(8): 3405–3418. DOI:10.1109/JSTARS.2015.2508043 |

| [2] | HUSSAIN M, CHEN Dongmei, CHENG A, et al. Change Detection from Remotely Sensed Images:From Pixel-based to Object-based Approaches[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2013(80): 91–106. |

| [3] | WANG Chao, XU Mengxi, WANG Xin, et al. Object-oriented Change Detection Approach for High-resolution Remote Sensing Images Based on Multiscale Fusion[J]. Journal of Applied Remote Sensing, 2013, 7(1): 173696. |

| [4] | 王琰, 舒宁, 龚龑. 利用马尔柯夫随机场图模型的变化像斑类别判定方法[J]. 武汉大学学报(信息科学版), 2012, 37(5): 542–545. WANG Yan, SHU Ning, GONG Yan. Determination of New Class Properties of the Changed Image Segments Using MRF Graph Model[J]. Geomatics and Information Science of Wuhan University, 2012, 37(5): 542–545. |

| [5] | 佃袁勇, 方圣辉, 姚崇怀. 一种面向地理对象的遥感影像变化检测方法[J]. 武汉大学学报(信息科学版), 2014, 39(8): 906–912. DIAN Yuanyong, FANG Shenghui, YAO Chonghuai. The Geographic Object-based Method for Change Detection with Remote Sensing Imagery[J]. Geomatics and Information Science of Wuhan University, 2014, 39(8): 906–912. |

| [6] | HAO Ming, SHI Wenzhong, ZHANG Hua, et al. A Scale-driven Change Detection Method Incorporating Uncertainty Analysis for Remote Sensing Images[J]. Remote Sensing, 2016, 8(9): 745. DOI:10.3390/rs8090745 |

| [7] | CHEN Qiang, CHEN Yunhao. Multi-feature Object-based Change Detection Using Self-adaptive Weight Change Vector Analysis[J]. Remote Sensing, 2016, 8(7): 549. DOI:10.3390/rs8070549 |

| [8] | HAO Ming, ZHANG Hua, SHI Wenzhong, et al. Unsupervised Change Detection Using Fuzzy c-means and MRF from Remotely Sensed Images[J]. Remote Sensing Letters, 2013, 4(12): 1185–1194. DOI:10.1080/2150704X.2013.858841 |

| [9] | SHAO Pan, SHI Wenzhong, HE Pengfei, et al. Novel Approach to Unsupervised Change Detection Based on a Robust Semi-supervised FCM Clustering Algorithm[J]. Remote Sensing, 2016, 8(3): 264. DOI:10.3390/rs8030264 |

| [10] | CAO Guo, LIU Yazhou, SHANG Yanfeng. Automatic Change Detection in Remote Sensing Images Using Level Set Method with Neighborhood Constraints[J]. Journal of Applied Remote Sensing, 2014, 8(1): 083678. DOI:10.1117/1.JRS.8.083678 |

| [11] | ZHOU Licun, CAO Guo, LI Yupeng, et al. Change Detection Based on Conditional Random Field with Region Connection Constraints in High-resolution Remote Sensing Images[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2016, 9(8): 3478–3488. DOI:10.1109/JSTARS.2016.2514610 |

| [12] | CAO Guo, ZHOU Licun, LI Yupeng. A New Change-detection Method in High-resolution Remote Sensing Images Based on A Conditional Random Field Model[J]. International Journal of Remote Sensing, 2016, 37(5): 1173–1189. DOI:10.1080/01431161.2016.1148284 |

| [13] | WU Chen, ZHANG Lefei, ZHANG Liangpei. A Scene Change Detection Framework for Multi-temporal Very High Resolution Remote Sensing Images[J]. Signal Processing, 2016(124): 184–197. |

| [14] | 李杨, 江南, 侍昊, 等. LandSat-8影像的LDA模型变化检测[J]. 地球信息科学学报, 2015, 17(3): 353–360. LI Yang, JIANG Nan, SHI Hao, et al. Change Detection and Analysis of LandSat-8 Image Based on LDA Model[J]. Journal of Geo-Information Science, 2015, 17(3): 353–360. |

| [15] | ZHANG Hui, GONG Maoguo, ZHANG Puzhao, et al. Feature-level Change Detection Using Deep Representation and Feature Change Analysis for Multispectral Imagery[J]. IEEE Geoscience and Remote Sensing Letters, 2016, 13(11): 1666–1670. DOI:10.1109/LGRS.2016.2601930 |

| [16] | 戴芹, 刘建波, 刘士彬. 微粒群优化方法的遥感影像变化检测研究[J]. 测绘学报, 2012, 41(6): 857–863, 885. DAI Qin, LIU Jianbo, LIU Shibin. Remote Sensing Image Change Detection Using Particle Swarm Optimization Algorithm[J]. Acta Geodaetica et Cartographica Sinica, 2012, 41(6): 857–863, 885. |

| [17] | ZHANG Puzhao, GONG Maoguo, SU Linzhi, et al. Change Detection Based on Deep Feature Representation and Mapping Transformation for Multi-spatial-resolution Remote Sensing Images[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2016(116): 24–41. |

| [18] | XIAO Pengfeng, ZHANG Xueliang, WANG Dongguang, et al. Change Detection of Built-up Land:A Framework of Combining Pixel-based Detection and Object-based Recognition[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2016(119): 402–414. |

| [19] | LU Jun, LI J, CHEN Gang, et al. Improving Pixel-based Change Detection Accuracy Using an Object-based Approach in Multitemporal SAR Flood Images[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2015, 8(7): 3786–3496. |

| [20] | AGUIRRE-GUTIÉRREZ J, SEIJMONSBERGEN A C, DUIVENVOORDEN J F. Optimizing Land Cover Classification Accuracy for Change Detection, A Combined Pixel-based and Object-based Approach in A Mountainous Area in Mexico[J]. Applied Geography, 2012(34): 29–37. |

| [21] | 王东广, 肖鹏峰, 宋晓群, 等. 结合纹理信息的高分辨率遥感图像变化检测方法[J]. 国土资源遥感, 2012(4): 76–81. WANG Dongguang, XIAO Pengfeng, SONG Xiaoqun, et al. Change Detection Method for High Resolution Remote Sensing Image in Association with Textural and Spectral Information[J]. Remote Sensing for Land & Resources, 2012(4): 76–81. DOI:10.6046/gtzyyg.2012.04.13 |

| [22] | 彭钢, 贾振红, 覃锡忠, 等. 自适应PCNN和改进C-V结合的遥感图像变化检测[J]. 计算机工程与设计, 2015, 36(6): 1581–1585. PENG Gang, JIA Zhenhong, QIN Xizhong, et al. Remote Sensing Image Change Detection Based on Adaptive PCNN and Improved C-V Model[J]. Computer Engineering and Design, 2015, 36(6): 1581–1585. |

| [23] | 李美丽, 李言俊, 王红梅, 等. 基于自适应脉冲耦合神经网络图像融合新算法[J]. 光电子·激光, 2010, 21(5): 779–782. LI Meili, LI Yanjun, WANG Hongmei, et al. A New Image Fusion Algorithm Based on Adaptive PCNN[J]. Journal of Optoelectronics·Laser, 2010, 21(5): 779–782. |

| [24] | LIU Mingyu, TUZEL O, RAMALINGAMS S, et al. Entropy Rate Superpixel Segmentation[C]//Proceedings of 2011 IEEE Conference on Computer Vision and Pattern Recognition. Washington, DC, USA:IEEE Computer Society, 2011:2097-2104. |

| [25] | 殷瑞娟, 施润和, 李镜尧, 等. 一种高分辨率遥感影像的最优分割尺度自动选取方法[J]. 地球信息科学学报, 2013, 15(6): 902–910. YIN Ruijuan, SHI Runhe, LI Jingyao, et al. Automatic Selection of Optimal Segmentation Scale of High-resolution Remote Sensing Images[J]. Journal of Geo-Information Science, 2013, 15(6): 902–910. |

| [26] | ESPINDOLA G M, CAMARA G, REIS I A, et al. Parameter Selection for Region-growing Image Segmentation Algorithms Using Spatial Autocorrelation[J]. International Journal of Remote Sensing, 2006, 27(14): 3035–3040. DOI:10.1080/01431160600617194 |

| [27] | 吴俊政, 严卫东, 倪维平, 等. 基于图像融合与多尺度分割的目标级变化检测[J]. 电光与控制, 2013, 20(12): 51–55. WU Junzheng, YAN Weidong, NI Weiping, et al. Object-level Change Detection Based on Image Fusion and Multi-scale Segmentation[J]. Electronics Optics & Control, 2013, 20(12): 51–55. DOI:10.3969/j.issn.1671-637X.2013.12.012 |

| [28] | 冯文卿, 张永军. 利用多尺度融合进行面向对象的遥感影像变化检测[J]. 测绘学报, 2015, 44(10): 1142–1151. FENG Wenqing, ZHANG Yongjun. Object-oriented Change Detection for Remote Sensing Images Based on Multi-scale Fusion[J]. Acta Geodaetica et Cartographica Sinica, 2015, 44(10): 1142–1151. DOI:10.11947/j.AGCS2.0152.0140260 |

| [29] | LI Chunming, XU Chenyang, GUI Changfeng, et al. Distance Regularized Level Set Evolution and Its Application to Image Segmentation[J]. IEEE Transactions on Image Processing, 2010, 19(12): 3243–3254. DOI:10.1109/TIP.2010.2069690 |

| [30] | SUN Kaimin, CHEN Yan. The Application of Objects Change Vector Analysis in Object-level Change Detection[C]. International Conference on Computational Intelligence and Industrial Application (PACⅡA), 2010, 15(4):383-389. |