随着激光扫描技术的不断发展,点云数据的获取更加便利[1],这使得三维点云场景分析在城市建筑物提取[2-3]、车辆及道路相关信息提取[4-6]以及三维数字城市重建[7]等方面受到更为广泛的关注,也成为摄影测量、遥感等领域的主要研究方向之一。点云分类作为三维点云场景分析中的重要内容之一,通过对点云数据中每个点的类别进行标记,来识别点云中各类地物信息。在实际场景中,点云分类受点云数据的噪声、部分缺失、离散性、密度分布不均匀[8],以及地物形态的多样性[9]等诸多因素的影响,点云分类的准确性还面临着巨大的挑战。

点云分类可分为基于局部特征的分类和空间上下文分类[10]两类。其中基于局部特征的点云分类方法[11],利用从单点邻域提取的局部特征对点云数据进行分类,其分类精度严重依赖邻域的准确选取。而合理的邻域有助于提高特征提取的精度,进而可以显著提升点云分类的精度[10]。目前,由诸多学者提出了多种估算自适应邻域的方法[11-14]来提高点云分类精度。其中,基于矩阵分析来估算点云邻域[12]的方法,可以得到自适应的邻域,但是该方法需要额外的训练数据和仪器参数,这在某些分类任务下难以满足。基于最小熵值的邻域估算方法[11, 14],理论上能够得到每个点的最稳健的邻域,但是,当场景中的点云分布不均匀时,在全局范围内邻域的稳健性难以保证,造成分类的整体精度难以提高。在复杂场景中,不同区域的点云分布差异通常较大,而上述邻域估算方法并没有考虑到这点,这对于分类整体精度的提升还有一定的欠缺。

空间上下文分类方法,在局部特征的基础上,引入空间上下文提升点云分类精度。顾及局部依赖关系的空间上下文点云分类方法,考虑局部近邻点之间的相互关联性,提取依赖关系[15-16],可有效提高分类精度。然而这样一种局部依赖关系,对于复杂的三维点云场景而言,存在一定的局限性。基于分割块实体,考虑非局部范围内的几何形状特征[17]的空间上下文点云分类方法,可在一定程度上提高局部范围内标记结果的一致性。该类方法充分考虑了局部范围内的依赖关系以及几何形态特征,可得到更为平滑与完整的分类结果。然而,由于局部依赖关系的局限性,以及基于分割块实体的形状特征无法描述地物的相对分布情况,对于自然场景中丰富的非局部范围的空间上下文,如车辆在地面上等分布规律,上述方法难以有效利用,无法得到更为完整的分类结果。

针对上述问题,本文提出了一种改进的空间上下文点云分类方法。本文的主要工作在于:①采用顾及曲率的自适应邻域估算方法,能够自适应地得到更为合理的单点邻域;②提取基于超级体素的分布性空间上下文信息,有效描述了地物在垂直方向的分布规律。

1 基于自适应邻域的局部特征提取点云分类时,需要提取点云特征,并基于点云特征对点云数据的每个点赋予类别标签。而特征提取的稳健性主要依赖于邻域的准确选取。

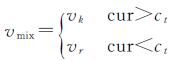

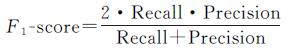

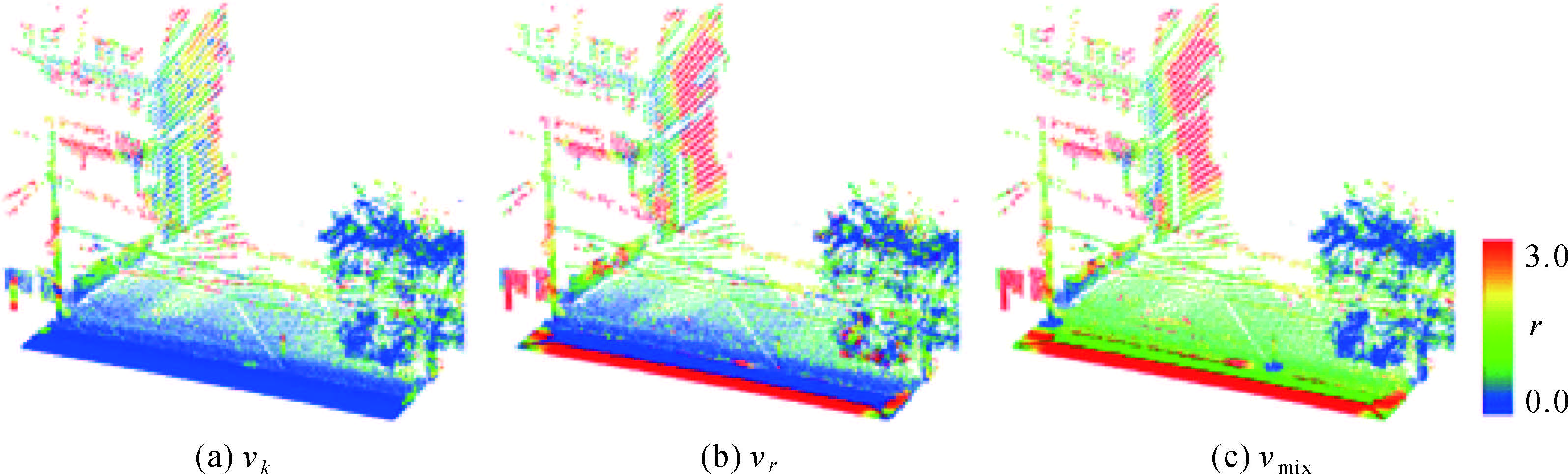

1.1 自适应邻域点的邻域通常是以该点为中心,在一个半径为r的球体内,所包含的其他所有点,或者是点云中与该点距离较近的前k个点。显然,邻域的确定主要依赖于k或r,而k或r的确定往往需要一定的先验知识。在地物复杂的场景中,受点云数据密度不均匀的影响,固定尺度的邻域难以有效地描述地物的局部特征,这就需要根据地物表面的复杂程度,自适应地调整特征估算时的邻域范围。本文针对的是地面移动三维激光扫描仪所获取的点云数据,数据呈线状分布,具有密度不均的特点,线状分布在面状区域表现尤为明显,如图 1所示。从点云数据中可以清楚地看出,点云邻域的大小与点云密度及曲率有关,因此自适应的邻域选取方法可以从这两方面入手。目前应用较为广泛的是基于最小熵值的邻域估算方法,其中以k为参数的最小熵值法[11],得到邻域为vk,以半径r为参数的最小熵值法[14],得到邻域为vr。邻域vk虽然避免了对场景的先验假设,但其受点云密度影响较大,在平坦区域vk会呈线状分布,如图 1所示。邻域vr能够减小点云密度的影响,但需要对场景中的地物类型有一定了解,且受曲率影响较大。本文提出一种顾及曲率的自适应邻域方法,如式 (1) 所示,以曲率为阈值,曲率较大的使用邻域vk,曲率较小的使用邻域vr,得到的邻域为vmix

(1)

(1)

|

| 图 1 点云线状分布示意图 Fig. 1 Sketch map of linear distribution of point cloud |

式中,cur是该点的曲率;ct是曲率阈值。阈值的选取采用k均值聚类方法,以曲率最大值、最小值作为初始聚类中心进行聚类。为确保vmix在规则区域的有效性,本文以曲率较小的聚类集合的中心作为曲率阈值。

1.2 局部特征局部特征 (local feature,LF),用于描述点云邻域内点集的分布情况。本文方法使用的局部特征,基于点云的邻域v统计得到,用于描述点云的局部空间结构,有线性度量Lλ、平面度量Pλ、离散度度量Sλ、归一化高差Dz、垂直度V等。Lλ、Pλ、Sλ的计算如式 (2) 所示,用于描述分类点邻域v的局部几何特征[18-19]

(2)

(2)

式中,λ1、λ2、λ3(λ1≥λ2≥λ3≥0) 为v内邻近点集的协方差矩阵的特征值。

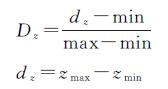

归一化高差Dz,如式 (3) 所示,可以有效描述邻域空间中离散点的垂直分布情况

(3)

(3)

式中,dz为邻域v内高差;zmax与zmin为邻域v内最高点与最低点的z坐标,min与max为点云中高差dz的最小值与最大值。

垂直度V描述该点法线与水平面的关系,依据式 (4) 计算

(4)

(4)

式中,nz为法线向量的第3个分量。

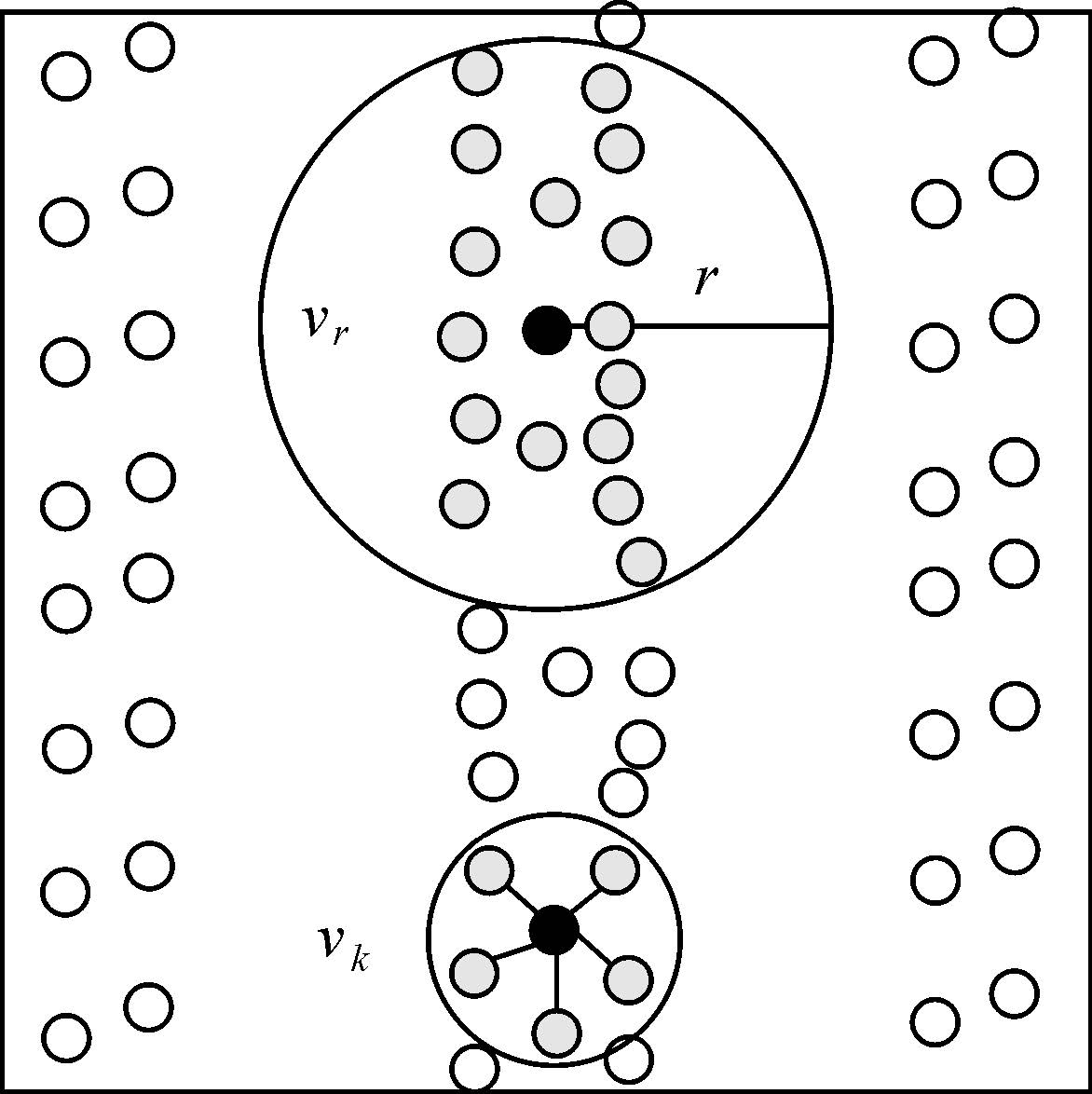

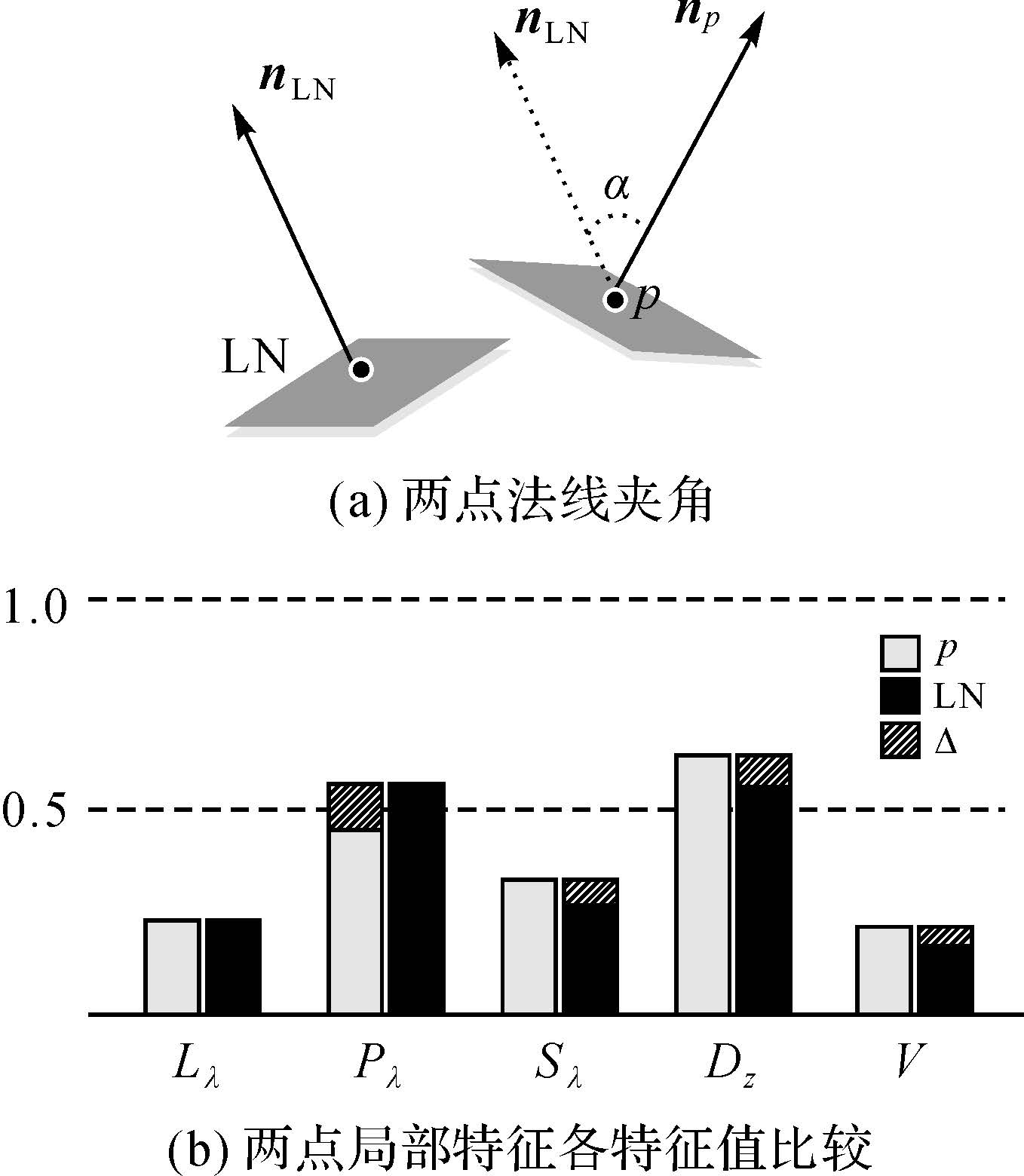

2 空间上下文提取 2.1 依赖性空间上下文依赖性空间上下文 (interaction spatial context,ISC),描述点与点之间的相互关联性。在点云数据中,近邻的点之间,存在着一定的相互依赖关系,相邻的点趋近于同一类地物。这种依赖关系用依赖性空间上下文来描述。本文依赖性空间上下文建立在点p与其局部近邻点 (local neighborhood,LN) 组成的局部近邻结构上,其中LN由距离p点最近的q个点组成。本文通过计算点p与LN点间的法线夹角α和局部特征间的欧氏距离D作为依赖性空间上下文,如图 2所示,依据公式 (5) 计算

(5)

(5)

|

| 图 2 依赖性空间上下文示意图 Fig. 2 Sketch map of ISC |

式中,np与nLN分别为p点、LN点的法向量;Δ项为单点局部特征值的差值。

2.2 分布性空间上下文分布性空间上下文 (distribution spatial context,DSC),用于描述地物在空间上分布的规律。基于单点实体的空间相关性可以描述这样一种分布规律[9],然而点云数据中存在密度不均等问题,基于单点实体描述非局部范围的空间上下文,会增加特征的不确定性。对此本文提取基于超级体素的分布性空间上下文,描述地物在垂直方向上的分布情况,来表达地物在空间上的分布规律。

本文引入文献[20]提出的超级体素分割方法,利用点云空间、法线等信息,在尽量减少信息损失的条件下,将体素化的点云数据分割成块状数据,得到超级体素实体。考虑到在水平方向地物的分布呈现无规则的状态,而在垂直方向具有较好的一致性,本文基于超级体素实体统计地物在垂直方向上的分布情况作为分布性空间。

本文将每个超级体素Segi看作单一实体,利用随机森林 (http://docs.opencv.org/2.4/modules/ml/doc/random_trees.html) 分类方法,对超级体素实体进行软分类,得到Segi的类别概率p(l), l为Segi的类别,统计得到Segi的类别概率分布pSegi,如图 3(a) 中各超级体素饼状图所示。为得到地物在垂直方向上的空间分布,以Segi中心点为中心,取半径为1.5r的球状邻域, r为超级体素直径,组成超级体素团CSegi,如图 3(b) 所示。为便于精确统计,引入文献[9]中空间相关性划分的思路,将超级体素团中超级体素,按中心点高程,划分成3部分Partf

(6)

(6)

|

| 图 3 基于超级体素的分布性空间上下文 Fig. 3 Supervoxel based DSC |

式中,f∈{1, 2, 3}。对每部分超级体素的类别概率分布pSegi,按照式 (6) 统计,得到pPartf,式 (6) 中L为场景中的地物类别。最终将3部分pPartf按一定顺序排列,得到分布性空间上下文ppart,如图 3(c)所示。

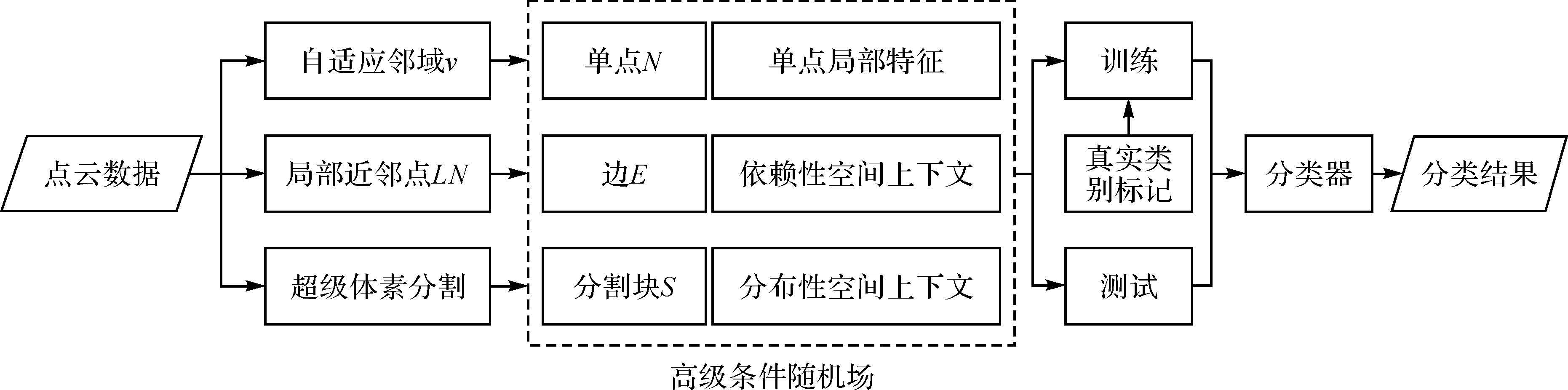

3 空间上下文点云分类本文采用高阶条件随机场模型[21-23],在点云局部特征的基础上,联合依赖性空间上下文及分布性空间上下文信息,对点云数据进行空间上下文分类。

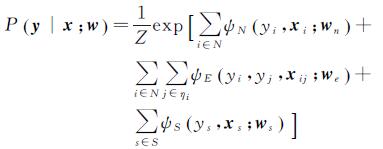

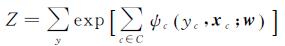

3.1 高阶条件随机场点云分类模型高阶条件随机场点云分类模型,对观测的点云数据X={x1, x2, …, xn}进行分类,得到分类的点云数据Y={y1, y2, …, yn},xi为点i的观测向量, n为点云中点的数目,yi表示点i的类别标记li∈L={l1, l2, …, lm}, m为类别数。模型可由无向图G=(N、E、S) 表示,其中N为对应点云数据中所有点, E为点与近邻点之间的无向连接, S为点云数据的分割块集合。定义P(Y=y) 为P(y),P(X=x) 为P(x),则本文点云分类模型的后验概率可由式 (7) 表示

(7)

(7)

式中,

(8)

(8)

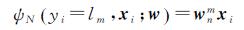

式中,wnm表示点i的类别为lm时的权重向量。

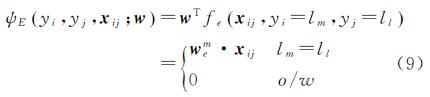

边势函数ψE(yi, yj, xij; we) 定义如式 (9) 所示,用于描述近邻点间的相互作用

(9)

(9)

式中,βs为团s中主流类别lm的点所占比重,ζ为一致性约束参数,考虑分割过程中得到的分割块,其内部并不完全均质,ζ通常设置为大于0.5的正值,即分割块中主流类别点的数目占一半以上。ψS(ys, xs; ws) 用于约束分割块点集的一致性,定义如式 (10) 所示

(10)

(10)

本文采用文献[24]提出的一种最小化结构风险方法,利用训练数据

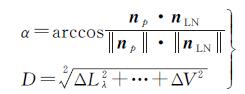

本文点云分类方法步骤如图 4所示。

|

| 图 4 本文点云分类方法流程 Fig. 4 Flow chart of the proposed point cloud classification method |

(1) 给定训练数据

(2) 选取距离点i最近的q个点,得到每个点i的局部近邻点LNi,计算点i与局部近邻点LNi之间的依赖性空间上下文。

(3) 对数据进行超级体素分割,得到分割块,基于分割块计算分布性空间上下文。

(4) 构建高阶条件随机场模型,进行参数估计,得到模型权重参数。

(5) 得到参数后,对给定的测试数据进行分类。

4 试验与分析 4.1 数据本文采用Oakland标准数据作为本文的试验数据。该数据是由移动平台搭载的SICK LMS三维激光扫描仪侧视扫描得到[17],数据包含训练数据和测试数据。训练数据用于模型训练,测试数据用于检验本文方法的性能。数据中每个点都有对应的地物类别信息,共有5类地物:电线 (wire)、柱状物 (pole/trunk)、立面 (facade)、地面 (ground)、植被 (vegetation)。数据是典型的非平衡分布数据,数据分布如表 1所示,植被与地面占90%以上,而电线、柱状物少于1%,这对于分类结果的精度评价是有一定的影响的。

| 类别 | 训练数据 | 测试数据 |

| 植被 | 14 441 | 257 953 |

| 电线 | 2571 | 3469 |

| 柱状物 | 1086 | 7648 |

| 地面 | 14 121 | 930 946 |

| 立面 | 4713 | 109 954 |

| 总和 | 36 932 | 1 309 970 |

4.2 试验

本文试验,首先估算点云自适应邻域v。基于自适应邻域v,计算节点N的局部特征。对每个点选取距离最近的5个点作为局部近邻点,组成E,并提取依赖性空间上下文。对点云数据进行超级体素分割,得到超级体素实体S,超级体素半径为1 m,基于超级体素提取分布性空间上下文,其中超级体素团CSeg的半径为1.5 m。基于N、E、S 3类实体构建高阶条件随机场分类模型,对点云数据进行分类。

试验分别采用vk、vr、vmix 3种邻域进行对比验证,邻域定义参见1.1节。计算点云最优邻域时,为控制计算规模,本文设定邻域vk参数kmin=10、kmax=100,迭代步长Δk=1[10]。邻域vr参数rmin=0.25、rmax=2.0,Δr=0.05,其下限由试验所用数据中扫描线间距的分布情况确定,确保邻域范围内的点来自两条或以上的扫描线[13],其上限为控制计算规模设定的合理经验值。邻域vmix设定曲率阈值ct为0.02,阈值由k均值聚类的方法得到,曲率大于阈值处使用邻域vk,曲率小于阈值处使用邻域vr,其对应的参数设定为:kmin=10、kmax=100、rmin=0.5、rmax=2.0。同时,为验证分布性空间上下文的有效性,本文对3类实体定义了两种特征组合:FLF, ISC, LF、FLF, ISC, DSC。其中实体N的特征为局部特征 (LF),实体E的特征为依赖性空间上下文 (ISC),实体S的特征分为局部特征 (LF) 和分布性空间上下文 (DSC)。

考虑到数据中地物类别的非平衡分布,本文使用4类常用的评价指标,来对分类结果进行评估:

(1) Recall (召回率) 表示真实值中被检测出的点的比例。

(2) Precision (准确率) 表示检测出来的点中正确点的比例。

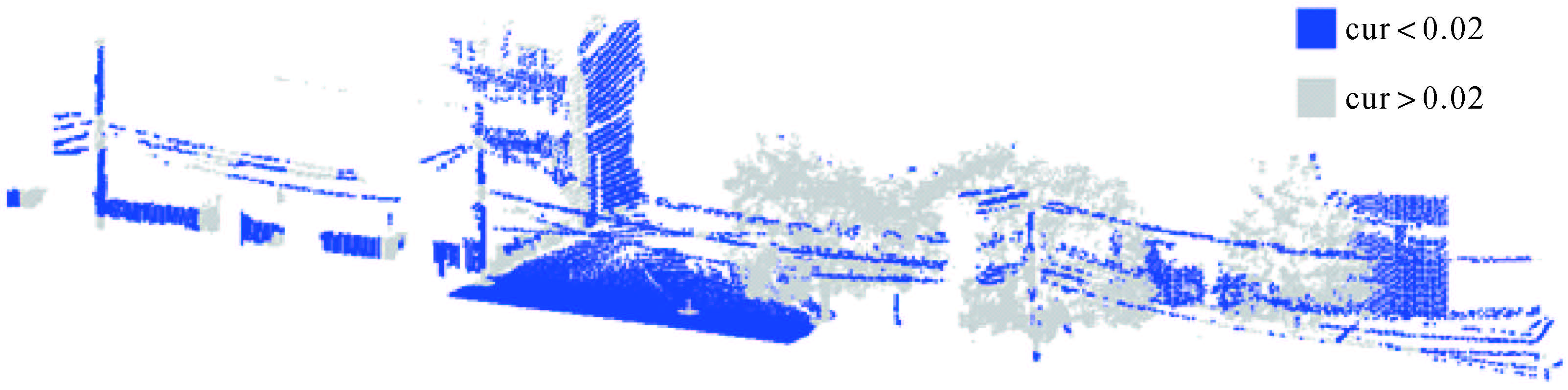

(3) F1-score,如式 (11) 所示

(11)

(11)

为召回率与准确率的调和平均值,当Recall与Precision均有较高的值时,F1-score才会高。

(4) Overall Accuracy (整体准确率) 表示分类结果中分类正确点所占比例。

4.3 结果与分析从图 5中可以看到,点云数据中密度分布十分不均。单一的邻域vk在密度较大的地面区域,半径往往偏小,如图 7(a)所示,使得vk呈线性分布。单一的邻域vr,参数r需要满足场景中不同地物的尺度,因此需要较小的rmin,这使得在密度与曲率都较小的区域,容易造成vr呈线状分布,且在曲率较大的植被区域有较大的邻域,如图 7(b)所示。vmix以曲率为阈值,如图 6所示,cur>0.02的部分使用邻域vk,cur<0.02的部分使用邻域vr,使估算的邻域避免点云密度及曲率变化的影响。从图 7(c)中可以看到,vmix在曲率较小的区域具有较大的半径,在曲率较大或变化剧烈的区域半径较小,有效避免同类型地物由于密度变化导致的邻域半径变化。

|

| 图 5 训练数据密度分布 Fig. 5 Density distribution of training data |

|

| 图 6 训练数据中cur<0.02的部分 Fig. 6 The cur < 0.02 in training data |

|

| 图 7 自适应邻域半径分布 Fig. 7 Radius distribution of adaptive neighborhood |

|

| 图 8 分类结果与真值比较 Fig. 8 The comparison between classification results and true values |

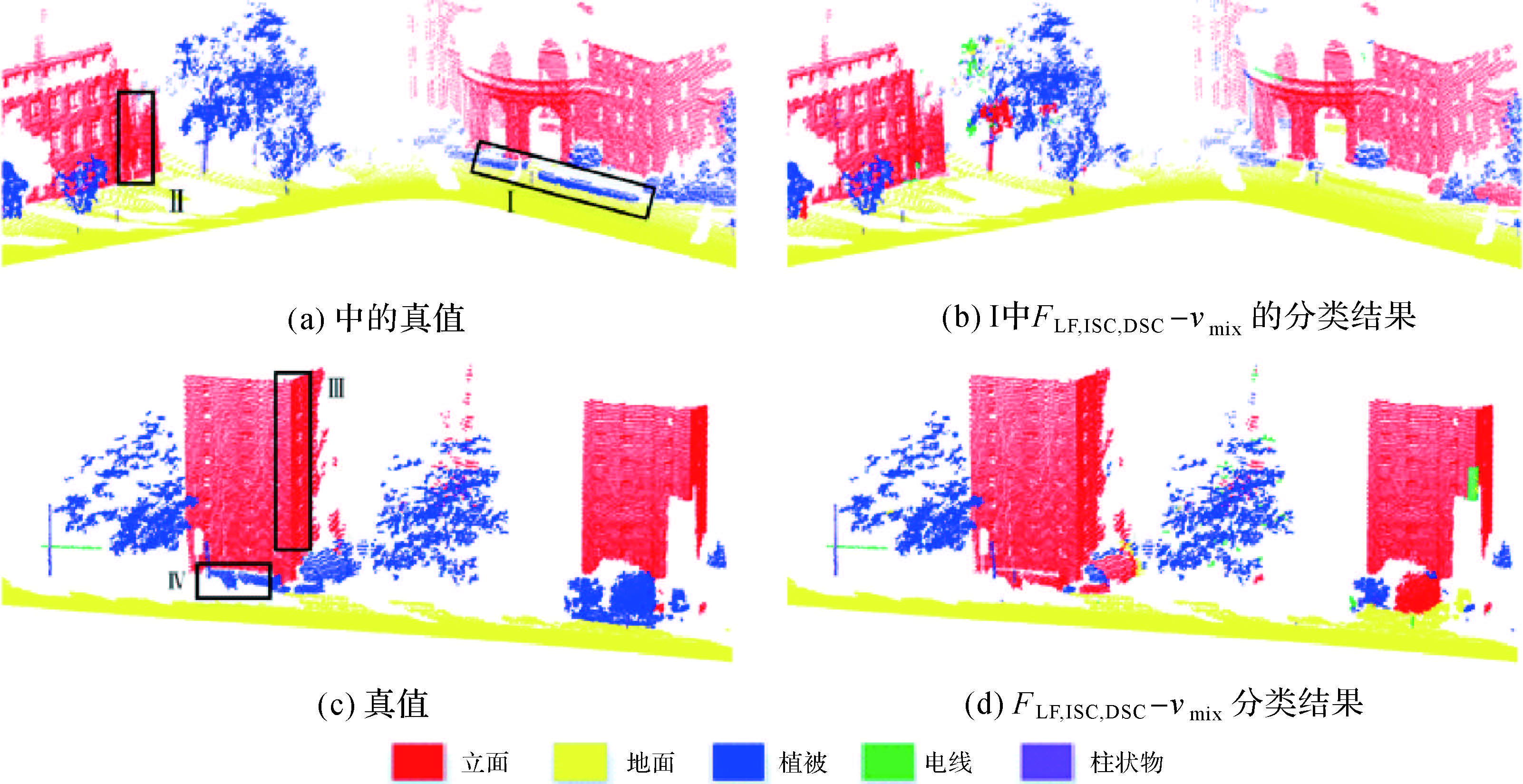

表 2展示了本文方法对测试数据分类的结果,整体准确率达到97.59%,图 8为本文方法分类结果与真值的比较图。从表 2中可以看到,除电线由于分布不稳定造成准确率较低外,各类地物均有较高准确率。误分情况主要集中在植被与立面:①靠近地面的低矮植被,如花草等,被误分为地面 (如图 8区域Ⅰ所示);②部分经人工修剪的植被,竖直方向上表现较为平整,被误分为立面 (如图 8区域Ⅳ所示);③部分立面点分布不稳定,被分成了植被、电线点;④由于电线、柱状物等在场景中属于尺寸较小的地物,容易与较浓密植被相混合,造成电线点、柱状物点被误分为植被。

| 类别 | 植被 | 电线 | 柱状物 | 地面 | 立面 | Precision |

| 植被 | 237 811 | 316 | 1418 | 1616 | 1928 | 0.978 288 |

| 电线 | 3997 | 2777 | 166 | 61 | 2176 | 0.302 604 |

| 柱状物 | 602 | 12 | 4627 | 8 | 348 | 0.826 693 |

| 地面 | 5668 | 345 | 426 | 929 007 | 1318 | 0.991 719 |

| 立面 | 9875 | 19 | 1011 | 254 | 104 184 | 0.903 254 |

| Recall | 0.921 916 | 0.800 519 | 0.604 995 | 0.997 917 | 0.947 524 |

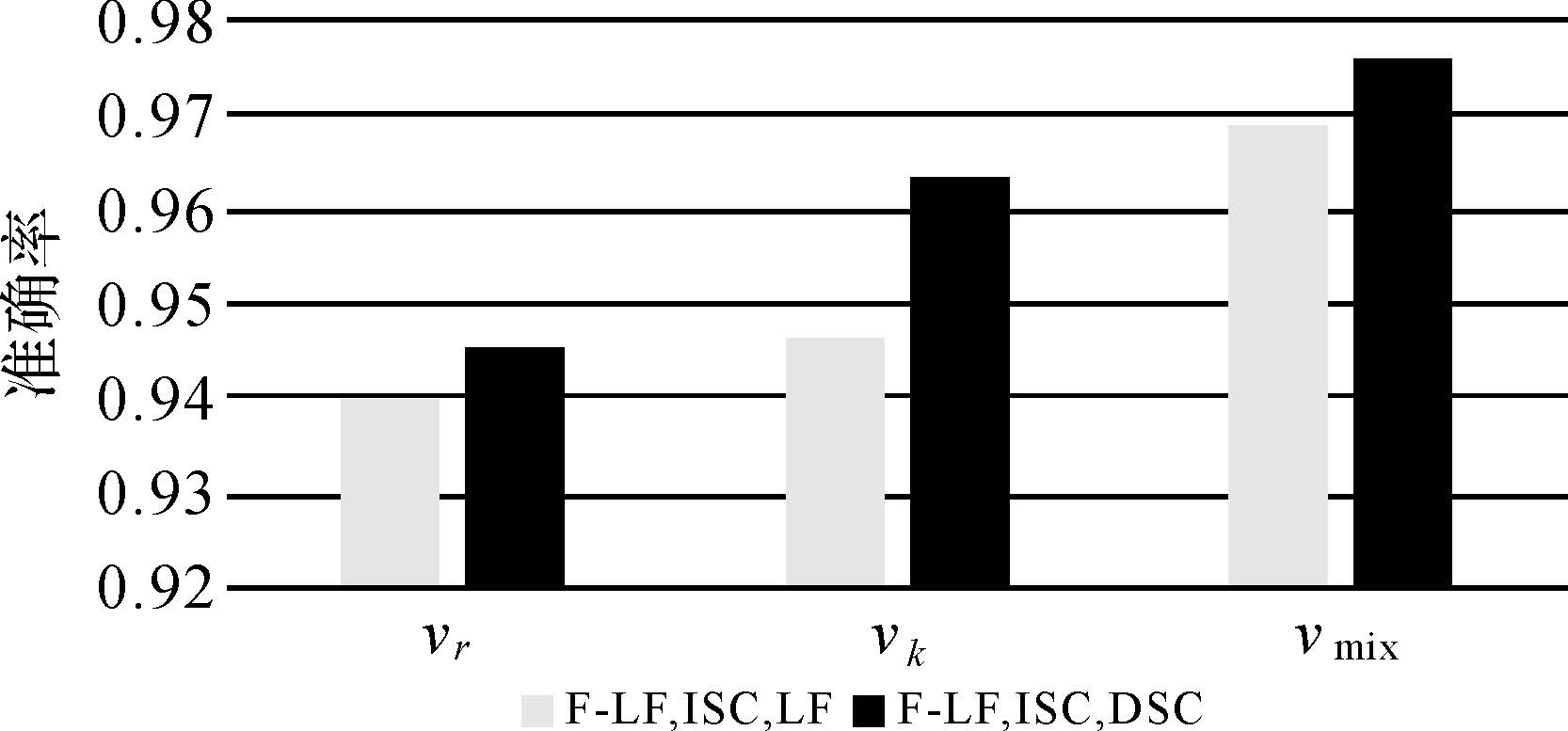

各试验的整体准确率如图 9所示。本文的自适应邻域方法vmix,顾及点云场景中曲率较大和较小两种区域,得到更合适的邻域,从而提高分类精度。如图 9所示,对于不同的特征组合,相较于vk、vr,基于vmix的分类方法的整体准确率都有显著提高。

|

| 图 9 各试验整体准确率 Fig. 9 The overall accuracy of the experiments |

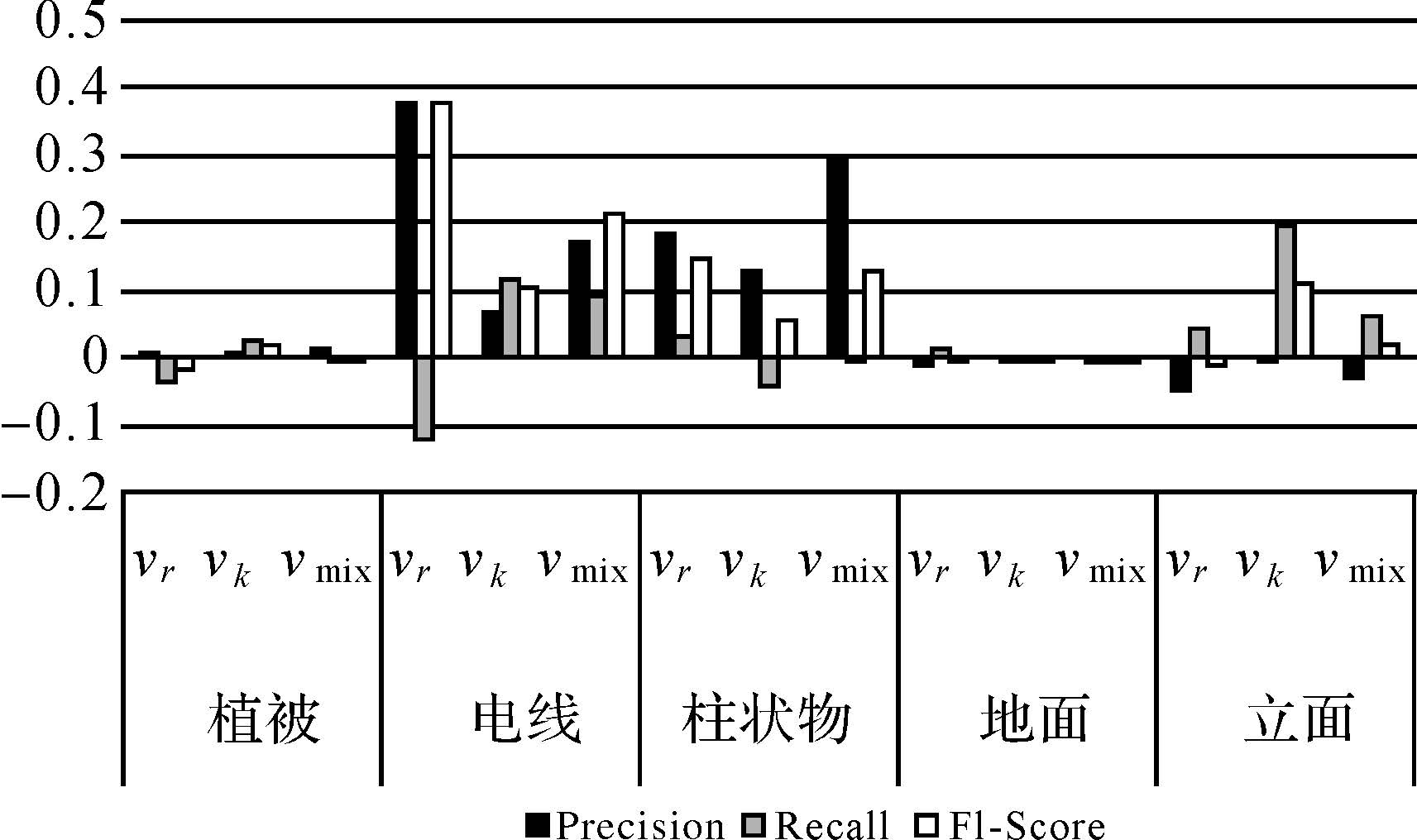

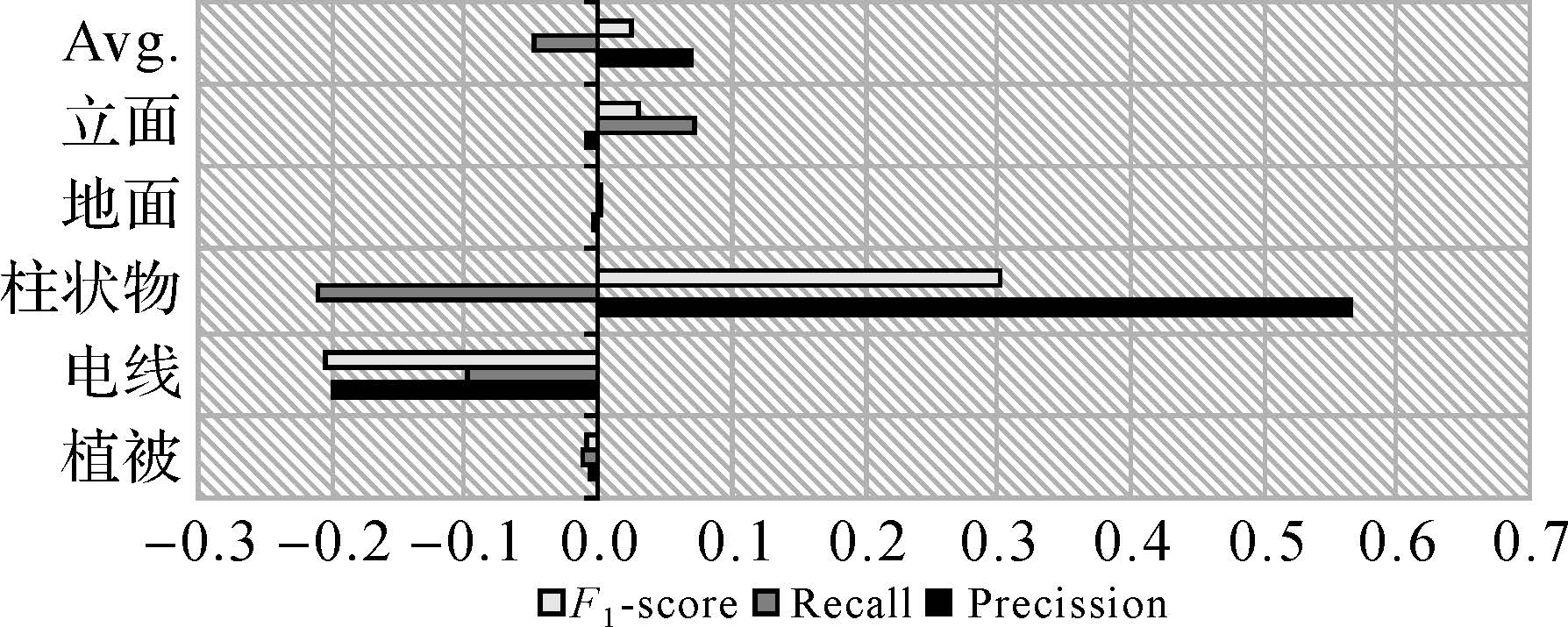

如图 9所示,在同一自适应邻域方法中,分布性空间上下文的使用,可以有效提高点云分类的整体准确率。图 10为两类特征组合分类结果的对比差值。从图 10中可以看到,对于同一自适应邻域,分布性空间上下文能够有效提升电线、柱状物以及立面的部分评价指标。电线及柱状地物,数据不足总体1%,大量的稀疏立面点、地面点,呈水平线状分布,容易被误分为电线点,而建筑物立面相交处,点较为密集,容易误分为柱状物,使得电线及柱状地物的准确率通常较低,而从图 10中可以看到,分布性空间上下文能够有效提高电线、柱状物的准确率、F1-score,得到较为合理的结果。

|

| 图 10 各自适应邻域方法下FLF, ISC, DSC与FLF, ISC, LF分类结果各指标的对比差值 Fig. 10 The difference between the results of FLF, ISC, DSC and FLF, ISC, LF |

从图 10中可以看出,分布性空间上下文能够有效提高建筑物立面的召回率,减少建筑物立面被误分的情况。建筑物立面数据占到总体数据的8%,相较于地面、植被,数据量较少,其分布存在不稳定的情况:①部分立面相交区域,数据较为密集,结构较为复杂;②部分立面中有框窗、阳台等复杂结构。从图 8中区域Ⅱ、Ⅲ的分类结果中可以看到,本文分类方法,能够得到较为完整的立面信息,如图 8(b)和(d)所示,在框窗区域、立面相交区域,均能得到较为完整的分类结果。

为对本文方法进行验证,比较本文方法 (FLF, ISC, DSC-vmix) 与文献[17]方法M3N的准确率、召回率及F1-score。本文方法在M3N的基础上,进行了混合自适应邻域、分布性空间上下文两方面改进。对比结果如图 11所示,立面召回率、F1-score均有提高。柱状物的准确率以及F1-score有较大提高,召回率有一定降低,地面信息分类效果基本维持不变,植被、电线的分类效果有一定降低。本文方法整体准确率为97.59%,各类地物F1-score平均值为80.13%,高于文献[17]的整体精度 (97.16%) 与平均F1-score (77.75%)。

|

| 图 11 方法对比差值结果 Fig. 11 The difference between the results of proposed method and M3N |

5 结论

本文以地面移动三维激光扫描数据为研究对象,提出了一种改进的空间上下文点云分类方法。通过在Oakland点云数据上的试验结果得出下列结论:

(1) 提取顾及曲率的自适应邻域,能够有效减小点云数据密度、曲率变化对邻域大小的影响,在曲率较小区域邻域半径较大,避免点云线性分布的影响,而曲率较大区域邻域半径较小,有效保留细节信息,得到更为合理的单点邻域,可以有效提高点云分类的总体精度。

(2) 基于超级体素提取的分布性空间上下文,能够有效表达非局部范围内地物的分布关系,得到更为完整的立面分类结果,一定程度上避免了立面上由于遮挡缺失、窗户阳台等因素造成的误分,有效提高点云分类总体精度。

(3) 不足之处如下:①自适应邻域的估算方法计算量较大,有待进一步优化;②目前对少部分目标的分类精度较低,其原因可能是训练样本不够,或者是受超级体素软分类的结果影响较大,此部分的内容有待进一步深入研究。

总体而言,本文的空间上下文点云分类方法,能够有效提高点云分类总体精度,满足复杂场景的点云分类的要求。

| [1] | WEINMANN M, JUTZI B, HINZ S, et al. Semantic Point Cloud Interpretation Based on Optimal Neighborhoods, Relevant Features and Efficient Classifiers[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2015, 105: 286–304. DOI:10.1016/j.isprsjprs.2015.01.016 |

| [2] | DEMANTKÉ J, VALLET B, PAPARODITIS N. Streamed Vertical Rectangle Detection in Terrestrial Laser Scans for Facade Database Production[C]//ⅩⅫ Congress of the International Society of Photogrammetry and Remote Sensing. Melbourne, Australia:[s.n.], 2012:99-104. |

| [3] | XU Lijun, KONG Deming, LI Xiaolu. On-the-fly Extraction of Polyhedral Buildings From Airborne LiDAR Data[J]. IEEE Geoscience and Remote Sensing Letters, 2014, 11(11): 1946–1950. DOI:10.1109/LGRS.2014.2314458 |

| [4] | SERNA A, MARCOTEGUI B. Detection, Segmentation and Classification of 3D Urban Objects Using Mathematical Morphology and Supervised Learning[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2014, 93: 243–255. DOI:10.1016/j.isprsjprs.2014.03.015 |

| [5] | YU Yongtao, LI J, GUAN Haiyan, et al. Semiautomated Extraction of Street Light Poles from Mobile LiDAR Point-Clouds[J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 53(3): 1374–1386. DOI:10.1109/TGRS.2014.2338915 |

| [6] | 方莉娜, 杨必胜. 车载激光扫描数据的结构化道路自动提取方法[J]. 测绘学报, 2013, 42(2): 260–267. FANG Lina, YANG Bisheng. Automated Extracting Roads from Mobile Laser Scanning Point Clouds[J]. Acta Geodaetica et Cartographica Sinica, 2013, 42(2): 260–267. |

| [7] | MUSIALSKI P, WONKA P, ALIAGA D G, et al. A Survey of Urban Reconstruction[J]. Computer Graphics Forum, 2013, 32(6): 146–177. DOI:10.1111/cgf.12077 |

| [8] | 董震, 杨必胜. 车载激光扫描数据中多类目标的层次化提取方法[J]. 测绘学报, 2015, 44(9): 980–987. DONG Zhen, YANG Bisheng. Hierarchical Extraction of Multiple Objects from Mobile Laser Scanning Data[J]. Acta Geodaetica et Cartographica Sinica, 2015, 44(9): 980–987. DOI:10.11947/j.AGCS.2015.20140339 |

| [9] | 郭波, 黄先锋, 张帆, 等. 顾及空间上下文关系的JointBoost点云分类及特征降维[J]. 测绘学报, 2013, 42(5): 715–721. GUO Bo, HUANG Xianfeng, ZHANG Fan, et al. Points Cloud Classification Using Joint Boost Combined with Contextual Information for Feature Reduction[J]. Acta Geodaetica et Cartographica Sinica, 2013, 42(5): 715–721. |

| [10] | WEINMANN M, SCHMIDT A, MALLET C, et al. Contextual Classification of Point Cloud Data by Exploiting Individual 3D Neigbourhoods[J]. ISPRS Annals of the Photogrammetry, Remote Sensing and Spatial Information Sciences, 2015, 2(3): 271–278. |

| [11] | WEINMANN M, JUTZI B, MALLET C. Semantic 3D Scene Interpretation:A Framework Combining Optimal Neighborhood Size Selection with Relevant Features[J]. ISPRS Annals of the Photogrammetry, Remote Sensing and Spatial Information Sciences, 2014, 2(3): 181–188. |

| [12] | LALONDE J F, UNNIKRISHNAN R, VANDAPEL N, et al. Scale Selection for Classification of Point-Sampled 3D Surfaces[C]//Proceedings of the Fifth International Conference on 3-D Digital Imaging and Modeling. Ottawa, Ontario:IEEE, 2005:285-292. |

| [13] | DEMANTKÉ J, MALLET C, DAVID N, et al. Dimensionality Based Scale Selection in 3D Lidar Point Clouds[J]. The International Archives of the Photogrammetry, Remote Sensing and Spatial Information Sciences, 2011, 38(12): 97–102. |

| [14] | 杨必胜, 董震, 魏征, 等. 从车载激光扫描数据中提取复杂建筑物立面的方法[J]. 测绘学报, 2013, 42(3): 411–417. YANG Bisheng, DONG Zhen, WEI Zheng, et al. Extracting Complex Building Facades from Mobile Laser Scanning Data[J]. Acta Geodaetica et Cartographica Sinica, 2013, 42(3): 411–417. |

| [15] | ANGUELOV D, TASKARF B, CHATALBASHEV V, et al. Discriminative Learning of Markov Random Fields for Segmentation of 3D Scan Data[C]//Proceedings of 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. San Diego, CA:IEEE, 2005, 2:169-176. |

| [16] | NIEMEYER J, ROTTENSTEINER F, SOERGEL U. Contextual Classification of LiDAR Data and Building Object Detection in Urban Areas[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2014, 87: 152–165. DOI:10.1016/j.isprsjprs.2013.11.001 |

| [17] | MUNOZ D, BAGNELL J A, VANDAPEL N, et al. Contextual Classification with Functional Max-Margin Markov Networks[C]//Proceedings of 2009 IEEE Conference on Computer Vision and Pattern Recognition. Miami, FL:IEEE, 2009:975-982. |

| [18] | LALONDE J F, VANDAPEL N, HUBER D F, et al. Natural Terrain Classification Using Three-dimensional LiDAR Data for Ground Robot Mobility[J]. Journal of Field Robotics, 2006, 23(10): 839–861. DOI:10.1002/(ISSN)1556-4967 |

| [19] | WEINMANN M, JUTZI B, MALLET C. Feature Relevance Assessment for the Semantic Interpretation of 3D Point Cloud Data[J]. ISPRS Annals of the Photogrammetry, Remote Sensing and Spatial Information Sciences, 2013, 1(2): 313–318. |

| [20] | PAPON J, ABRAMOV A, SCHOELER M, et al. Voxel Cloud Connectivity Segmentation-Supervoxels for Point Clouds[C]//Proceedings of the 2013 IEEE Conference on Computer Vision and Pattern Recognition. Portland, OR:IEEE, 2013:2027-2034. |

| [21] | KOHLI P, KUMAR M P, TORR P H S. P3 & Beyond:Solving Energies with Higher Order Cliques[C]//Proceedings of 2007 IEEE Conference on Computer Vision and Pattern Recognition. Minneapolis, MN:IEEE, 2007:1-8. |

| [22] | LAFFERTY J D, MCCALLUM A, PEREIRA F C N. Conditional Random Fields:Probabilistic Models for Segmenting and Labeling Sequence Data[C]//Proceedings of the Eighteenth International Conference on Machine Learning. San Francisco:ACM, 2001:282-289. |

| [23] | KOHLI P, LADICKY L, TORR P H S. Robust Higher Order Potentials for Enforcing Label Consistency[J]. International Journal of Computer Vision, 2009, 82(3): 302–324. DOI:10.1007/s11263-008-0202-0 |

| [24] | TASKAR B, CHATALBASHEV V, KOLLER D. Learning Associative Markov Networks[C]//Proceedings of the Twenty-First International Conference on Machine Learning. New York, NY:ACM, 2004:102. |

| [25] | BOYKOV Y, KOLMOGOROV V. An Experimental Comparison of Min-Cut/Max-Flow Algorithms for Energy Minimization in Vision[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2004, 26(9): 1124–1137. DOI:10.1109/TPAMI.2004.60 |