2. 安徽省智慧城市与地理国情监测重点实验室, 安徽 合肥 230031;

3. 武汉大学遥感信息工程学院, 湖北 武汉 430079

2. Anhui Key Laboratory of Smart City and Geographical Condition Monitoring, Hefei 230031, China;

3. School of Remote Sensing and Information Engineering, Wuhan University, Wuhan 430079, China

近年来,高空间分辨率(高分)对地观测技术得到了快速发展,其分辨率已达到亚米级的水平,因而能够在更精细的尺度上实现对地物的观测[1]。居民地是一种建设用地,它是由建筑物(主要是房屋)聚集覆盖而构成的区域,及时准确地获取居民地信息对于基础地理数据库构建与更新、土地利用规划、城镇扩张及其动态监测等具有重要的意义。

高分影像具有光谱信息相对不足、光谱异质性较大而纹理、结构等空间信息丰富的特点,基于多光谱或高光谱的目标分类与探测技术[2-3]一般不适合高分影像居民地的提取。目前对于高分影像居民地的提取更多地是利用其纹理、结构等空间特征。基于纹理特征的方法把居民地看成是一个纹理对象,通常使用灰度共生矩阵(GLCM)[4]、Gabor变换[5]、空间统计[6]等方法描述居民地纹理。比如,PanTex是一种基于灰度共生矩阵(GLCM)纹理构建的表征居民地存在性的指数,对SPOT-5全色影像具有很强的稳健性[4]。由于不关注居民地内部的几何结构,该类方法对于分辨率低于1m(比如2~5m)时效果较好,但当分辨率较高时(比如亚米级)往往不能获得理想的结果。

随着影像分辨率的提高,居民地内部几何结构及其空间布局更加明显,局部结构特征为居民地的提取提供了新的线索。在较高分辨率的影像上,居民地内部单个建筑物已可识别,建筑物的点、线、面等几何结构特征成为居民地提取的有效判据。相关的研究工作主要包括:基于局部特征点分布和空间投票[7]、利用局部边缘密度和均衡性[8]、利用角点[9-10]以及融合直角点和直角边[11]的高分影像城市区/居民地提取方法。这类方法主要依赖于居民地局部的点、线等几何结构特征及它们的空间分布,对于较高分辨率(比如亚米级)的影像,通常会比基于纹理的方法表现出更优越的性能。但居民地内部的点、线等几何结构特征常与其他地物有混淆,比如道路、农田等也具有明显的角点和边缘特征,这常常会导致居民地的伪检,因此需要更进一步的特征或模型进行验证。

近年来随着认知科学、计算机视觉和人工智能等技术的发展,视觉认知规律和计算模型开始被引入高分影像典型地物的提取。场景中显著的对象或区域更容易引起生物视觉的注意,因此模拟视觉注意机制的显著性模型被提出,用于实现兴趣目标的识别[12-13]和场景理解[14-15]。对于高分影像中的居民地,近几年已有相关的研究,使用的主要是小波变换的方法,比如非下采样轮廓波变换(non subsampled contourlet transform,NSCT)[16-17]、提升小波变换(lifting wavelet transform,LWT)[18]等,通过小波变换来建模人类视觉注意对居民地的纹理响应,然后构建居民地的显著性模型。这类方法由于模拟人类视觉机制,在模型上通常更胜一筹,但目前的方法主要是根据色调或纹理特征来建立居民地的显著性模型,模拟的是人类视觉对地物的感知方法。神经科学和认知科学的研究表明,除了对显著地物的感知,人类的视觉机制还具有将图像中的基本结构组织成完整目标的能力,即知觉组织能力[19-20]。符合知觉组织规律的目标,一般会具有更大的显著性,更容易引起人的视觉注意。

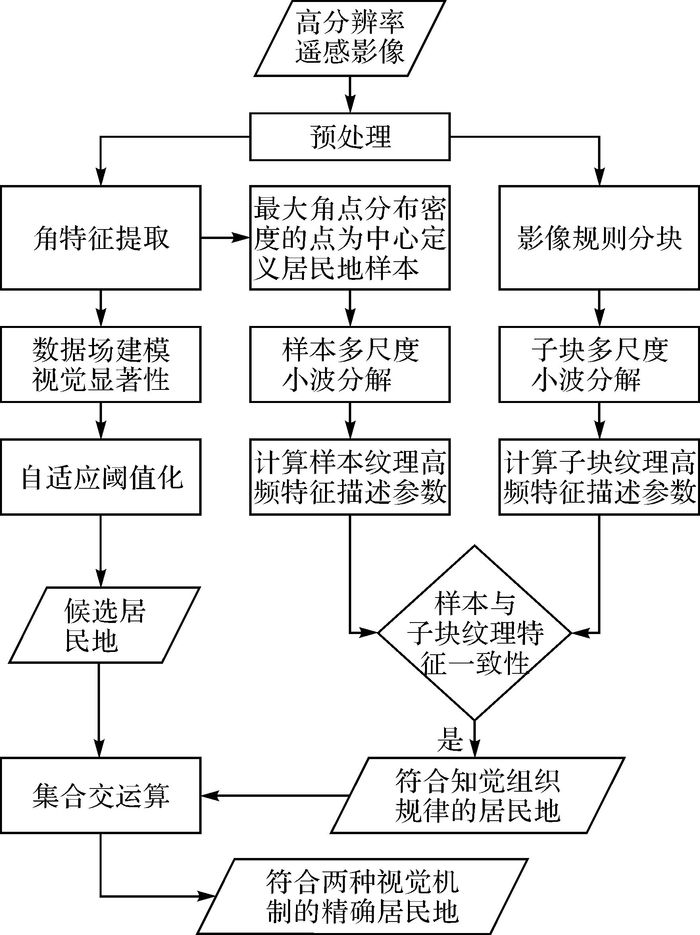

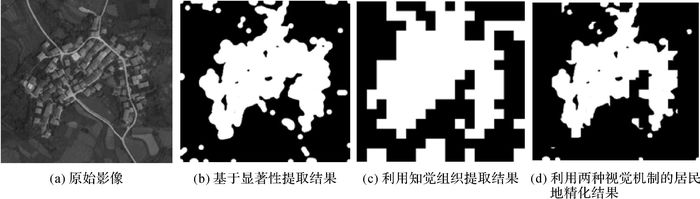

基于以上分析,本文认为在对地物的识别过程中,视觉注意与知觉组织这两种机制都发挥了作用,综合利用纹理和结构特征能够提高高分影像居民地判别能力。鉴于此,本文提出一种利用视觉显著性与知觉组织相结合的居民地提取方法。该方法首先基于局部的角点分布构建居民地的视觉显著性模型,并通过阈值分割获得候选的居民地区域,然后根据局部纹理特征的一致性,利用基于区域的知觉组织和集合交运算实现居民地的精提取,具体流程如图 1所示。

|

| 图 1 技术流程 Fig. 1 The work flow of the proposed method |

1 基于视觉显著性的候选居民地提取 1.1 基于数据场的视觉显著性建模

本文引入认知物理学中的数据场方法来构建居民地的视觉显著性模型。“场”是物理学中的概念,用来描述非接触对象之间的相互作用。把物理学中场的概念引入数域空间,将每个数据对象看成是具有一定质量的质点,其周围存在一个作用场,位于该场中的任何数据对象都将会受到其他数据对象的联合作用,那么这个数域空间就构成了一个数据场[21]。借鉴物理学中“势”的概念,数据场使用势函数来描述数据对象之间的相互作用。势函数一般具有以下特性:空间任一点的势值大小与场源强度参数成正比,并随该点与场源距离的增大而减小。

本文将高分影像中的居民地看成是由内部建筑物(或其局部结构)构成的场,居民地内部由于建筑物显著的局部视觉特征(如点、边线、屋顶面、阴影等)以及这些特征的聚集分布,使得居民地整体上具有更大的显著性,也就具有了更大的势值。相关研究表明,影像中的角点特征具有良好的定位和表征建筑物的能力[22]。设图像中共有n个角点,其构成的集合为P={p1,p2,…,pn},如果选择局部的角点作为质点,则这n个质点可以形成一个数据场。对于质点pi,它在影像任意一点p处的势值φi(p)若用高斯函数来表示,则

(1)

(1)

式中,mi为质点pi的质量,与该点局域的特征有关;σ为表征势函数作用范围的参数,其取值与影像的分辨率以及建筑物自身的特征(如尺寸)相关,本文通过试验发现,对于高分影像,其取值在6到9时较合适。

基于数据场的叠加原理,影像中点p处在n个质点的联合作用下,其势值为

(2)

(2)

考虑到高斯函数满足“3σ”法则,可以认为质点pi产生的势场具有局域性,对于本文选择的势函数,它产生的势值也就主要集中在以该点为中心的半径为

(3)

(3)

式中,N(p,δ)={q|q∈P,||q-p||≤δ}为p的邻域,邻域半径

将势值ϕ(p)作为影像中p点处的显著性度量,可得到居民地视觉显著性的定量模型。目前计算机视觉领域已有许多角点检测算子,总体上可分为两大类:基于图像边缘的方法和基于图像灰度的方法[24],前者依赖于图像的分割和边缘提取,对遥感图像具有较大的计算难度和计算量,而后者通过计算点的梯度和曲率来进行角点检测,可以避免第1类方法的不足。因此本文利用后者,并选择其中代表性的Harris算子[25]进行试验。

1.2 候选居民地提取通过上文构建的数据场模型可以获得影像中任意一点的显著性值(即势值),由于影像中的角点主要存在于居民地内部并且聚集分布,这将会使居民地较非居民地获得更大的视觉显著性值。为此,可以设置一个显著性阈值T0,输出满足条件ϕ(p)>T0的像素区域R0={p|ϕ(p)>T0}作为候选的居民地。目前已有许多自动选择阈值的方法,如Rosin的单峰直方图阈值法[26]、Otsu的最大类间方差法[27]等,本文选择后者,自动获得目标与背景分割的最佳阈值参数,实现候选居民地的提取。居民地提取本质上是一个二分类问题,Otsu最大类间方差法是一种自适应地确定阈值的方法,该方法根据图像的灰度特性,将图像分成目标和背景两部分。它的优势表现在:基于该方法确定的分割阈值,能够使得目标和背景之间的类间方差最大,这也就意味着错分概率最小。

2 基于区域的居民地知觉组织 2.1 视知觉组织人类视觉系统能够快速而又准确地完成物体识别的另一机制是知觉组织,即只需根据场景中感知的局部线索,就可以将其组织成完整的目标。格式塔心理学派提出了一套适合视觉系统进行知觉组织的规律,包括接近性、相似性、闭合性等[19]。知觉组织和视觉显著性并不是割裂的,符合知觉组织规律的目标会具有更大的显著性,更容易完成物体的识别。

模拟人类视觉系统,本文把居民地的识别看成是知觉组织的过程。在遥感领域,知觉组织方法已被用于道路[28]、矩形建筑屋顶[29]的提取,主要是对局部的边缘或线特征进行组织。鉴于居民地的复杂性,不适合使用基于边线特征的知觉组织法,本文提出使用基于区域的方法实现居民地的知觉组织。该方法首先对影像进行规则分块,将每个矩形子块作为局部视觉感知的基本单元,然后获得每个子块具有一致性的视觉特征,并根据特征相似性或一致性将居民地子块组织成完整的目标。

2.2 居民地纹理特征描述除了上文提到的点、线、面等几何结构特征,高分影像中居民地还具有丰富的纹理特征,在视觉上它表现为更高频率的亮度变化,并且这种特性还会因距离远近的不同而产生差异(即具有多尺度特性),为此本文引入多尺度小波变换来建模每个子区域的纹理特征。

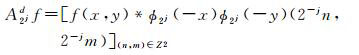

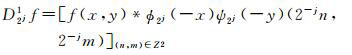

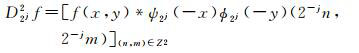

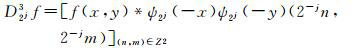

多尺度小波变换能够把信号分解成低频和高频成分,前者对应信号的近似部分(approximation,A),后者对应信号的细节部分(details,D)。对于2D图像f(x,y),在分辨率为2j下的近似(A)和细节(D)部分可由下面的卷积公式来计算[30]

(4)

(4)

(5)

(5)

(6)

(6)

(7)

(7)

式中,j为分解层次;m和n为整数;ϕ(x)为一维尺度函数;ψ(x)为一维小波函数。一般来说,ϕ(x)为平滑函数(smoothing function),用来提供低频信息(低通滤波器);ψ(x)为差异函数(differencing function),用来提供高频信息(高通滤波器)。

鉴于居民地具有更高的频率特性,本文使用小波分解的高频成分来描述居民地的纹理特征。首先对子区域进行小波分解,获得高频和低频成分,然后利用水平、垂直和对角3个方向的高频成分来对居民地的纹理进行描述,并定义如下的特征描述参数

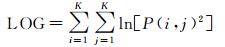

(1) 对数能量(log energy,LOG)

(8)

(8)

(2) 香农指数(Shannon’s index,SHAN)

(9)

(9)

式中,P(i,j)为分解图像中第(i,j)个像元小波系数值。

2.3 纹理一致性的居民地知觉组织在将影像进行规则分块获得的子区域中,属于居民地的子区域应该具有一致的纹理特征,为此本文利用该规则将隶属于居民地的子区域组织成完整的居民地目标。具体过程如下:

(1) 获取居民地样本的小波特征。本文采用自动化的方式来获得居民地样本:首先计算影像中角点分布的密度,然后以具有极大密度的角点为中心,定义大小为s·s的矩形区域作为居民地样本,并根据式(8)-式(9)计算其小波纹理特征参数,分别记为S_F1和S_F2。

(2) 对影像进行规则分块并计算每个子块的小波特征描述参数。将原始影像(包含m·n个像素)进行规则网格分块,划分成M·N个边长为L的影像子块,则M=floor(m/L),N=floor(m/L),这里floor为向下取整函数。当m和n都能是L的整数倍时,获得的每个矩形子块的边长都为L,否则会在影像的边界处得到一边长为L另一边长小于L或者两边长都小于L的矩形子块。对每个影像子块按式(8)-式(9)计算其小波纹理特征参数。对于第i个子块Bi,其LOG和SHAN特征值分别记为Bi_F1和Bi_F2。

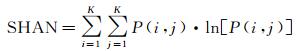

(3) 基于纹理特征一致性对居民地进行知觉组织。根据各影像子块与居民地样本纹理特征的一致性,将满足规则式(10)的子块标记为居民地,否则标记为非居民地(即背景)

(10)

(10)

式中,i=1, 2, …;M×N为影像块的编号;k=1或2,k=1为LOG特征,k=2为SHAN特征;T(≥0)为一致性阈值参数,T越小则影像子块与居民地样本的纹理特征越一致。

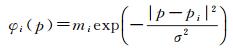

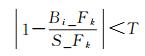

3 居民地精提取高分影像中的居民地不仅具有视觉显著性,还符合知觉组织规律,并且这两者是相互关联的,即符合知觉组织规律的目标会具有更强的视觉显著性。鉴于此,本文进一步提取同时满足这两种视觉机制的居民地,使得居民地的边界范围更加准确。假设基于这两种视觉机制提取的居民地分别为R1和R2,同时符合这种机制的居民地为R,则

(11)

(11)

在前面的视觉显著性模型和知觉组织模型中,笔者分别利用了居民地角点结构特征和纹理特征,此时按式(11)提取的居民地也就同时利用了这两种特征,增加了居民地提取的可靠性。图 2为该过程的一组试验,其中图 2(a)为原始Quickbird影像数据,图 2(b)和图 2(c)为分别利用视觉显著性和知觉组织获得的候选居民地,而图 2(d)为同时满足这两种视觉机制的提取结果。可以看出,通过取交运算,居民地的边界更为准确,周边的噪声区域大大减少。

|

| 图 2 居民地精提取过程 Fig. 2 The refinement process of residential area extraction |

4 试验分析

为验证该方法的有效性,笔者将其应用于高分影像居民地的提取。试验中试验了包括资源三号(ZY-3)和Quickbird两种不同传感器的全色影像,其空间分辨率分辨为2.1m和0.61m。试验结果采用查准率(precision,P)、查全率(recall,R)和F1-score 3个指标进行评估,其定义分别为

(12)

(12)

(13)

(13)

(14)

(14)

式中,TP(true positive)为真正类,表示提取的居民地是真实居民地的像元数目;FP(false positive)为假正类,表示提取的居民地是非居民地的像元数目;FN(false negative)为假负类,表示提取的非居民地是居民地的像元数目。

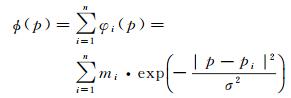

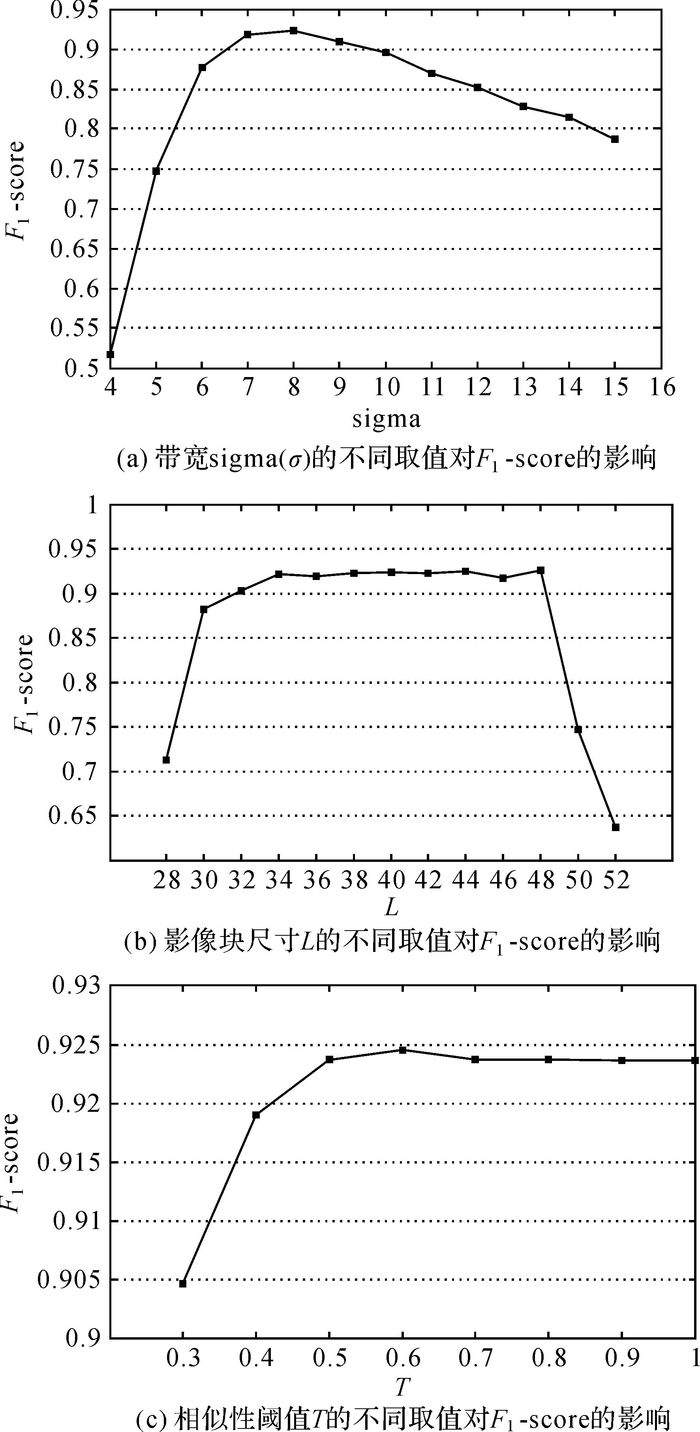

试验中涉及的主要参数包括数据场模型的带宽σ、知觉组织中影像规则分块的尺寸L、相似性阈值T。以图 2(a)中的影像数据为例,图 3展示了这3个参数的不同取值对提取结果的影响,这里采用固定两个参数(L=40,T=0.5;σ=8,T=0.5;σ=8,L=40)来看F1-score随第3个参数的变化情况。通过对多幅影像数据进行多次试验,带宽σ合理取值在7附近,L的合理取值在40附近,T的合理取值在0.4~0.6,对于σ=7,L=40,T=0.5,大部分数据都可以达到较好的结果,其提取的精度已达到或接近最优。

|

| 图 3 参数试验 Fig. 3 Parameter tests |

在基于视觉显著性和知觉组织获得居民地后,在其周围有时还会存在离散分布的噪声区域或者在其内部存在小的空洞,这破坏了居民地的形状完整性,为此笔者增加了另外两个参数以进一步优化居民地的提取,一个是描述噪声区域面积的阈值T1,一个是描述空洞面积大小的阈值T2,即居民地外部面积小于T1的噪声区域被去除,而居民地内部面积小于T2的噪声区域被填充,通过试验,这两个参数设置为T1=L·L=1600,T2=3·T1=4800,可保证提取的大部分居民地获得较完整的拓扑形态。

在知觉组织过程中,本文基于小波变换定义了LOG和SHAN两个纹理特征描述参数,其各自的性能分别进行了试验,在该数据集上使用这两种特征的精度评估结果如表 1所示。表 1中第1列为数据集编号,其中编号1-6为6幅河南登封地区不同场景的ZY-3全色影像,编号7-12为6幅武汉地区不同场景的Quickbird全色影像。由该表中的具体数值可以看出,对于该试验数据,本文的方法能够获得较高的精度,大部分的居民地场景,其F1-score值可以达到85%以上,对于简单的场景,其F1-score值可以达到90%左右。另外,通过比较LOG和SHAN两种小波特征的居民地提取结果,可以看出使用这两种特征获得的精度是不一样的,整体上LOG特征略好于SHAN特征的结果。

| 数据集 编号 | LOG特征 | SHAN特征 | |||||

| P | R | F1 | P | R | F1 | ||

| 1 | 0.9448 | 0.9647 | 0.9546 | 0.9601 | 0.9082 | 0.9334 | |

| 2 | 0.9460 | 0.9291 | 0.9375 | 0.9720 | 0.8536 | 0.9089 | |

| 3 | 0.8696 | 0.9301 | 0.8988 | 0.9138 | 0.8463 | 0.8787 | |

| 3 | 0.9177 | 0.9398 | 0.9287 | 0.9449 | 0.8868 | 0.9149 | |

| 5 | 0.9060 | 0.9767 | 0.9400 | 0.9382 | 0.8930 | 0.9150 | |

| 6 | 0.9279 | 0.9446 | 0.9362 | 0.9459 | 0.8694 | 0.9060 | |

| 7 | 0.9066 | 0.9415 | 0.9237 | 0.9061 | 0.9435 | 0.9244 | |

| 8 | 0.8178 | 0.9235 | 0.8675 | 0.8058 | 0.9238 | 0.8607 | |

| 9 | 0.8800 | 0.9342 | 0.9063 | 0.8783 | 0.9342 | 0.9054 | |

| 10 | 0.9637 | 0.9494 | 0.9565 | 0.9492 | 0.9725 | 0.9607 | |

| 11 | 0.8773 | 0.9427 | 0.9089 | 0.8754 | 0.9478 | 0.9102 | |

| 12 | 0.9018 | 0.9667 | 0.9331 | 0.9196 | 0.9534 | 0.9362 | |

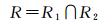

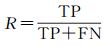

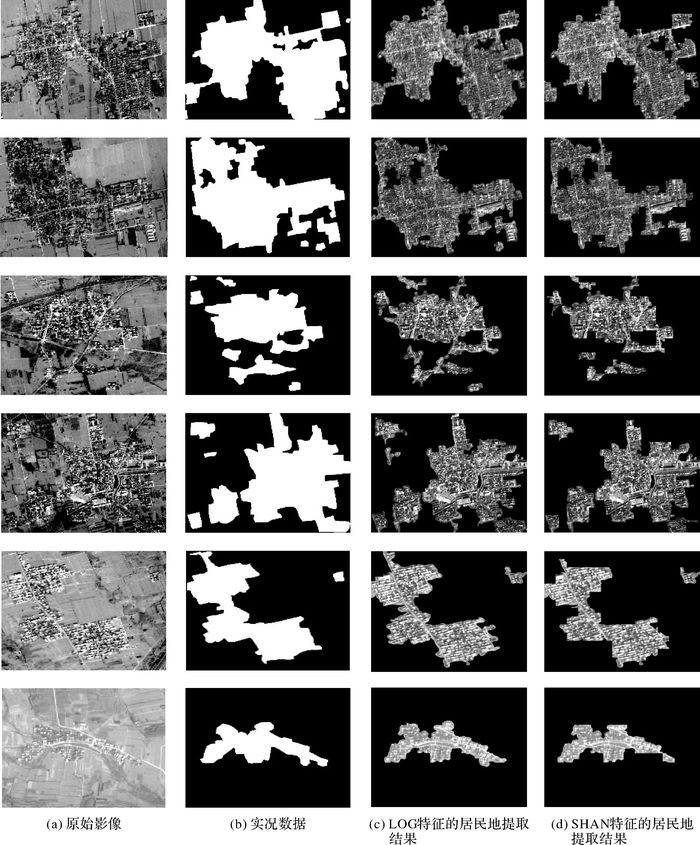

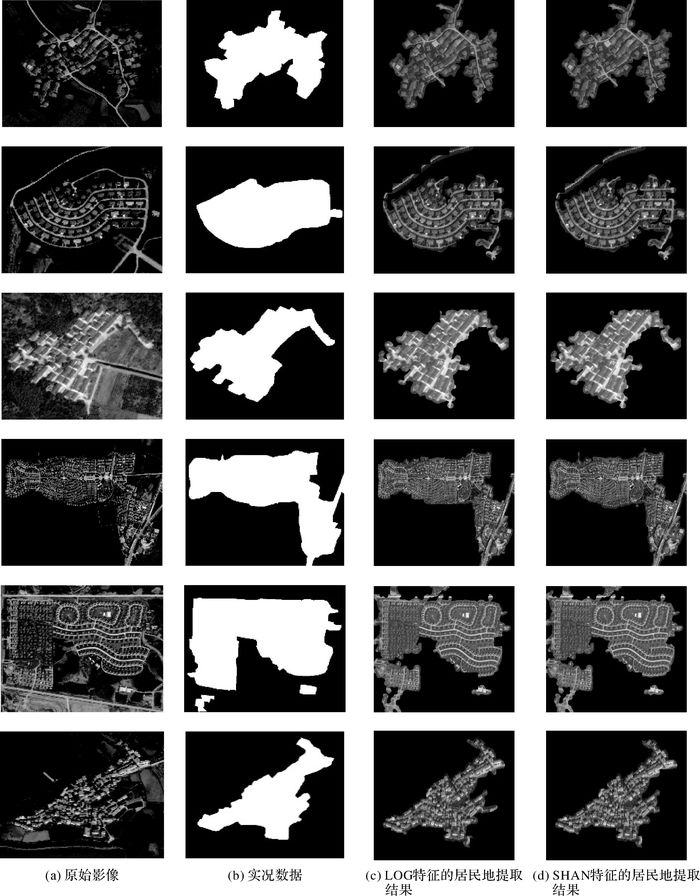

在该数据集上,本文方法提取结果如图 4和图 5所示,其中图 4为ZY-3数据集提取结果,图 5为Quickbird数据集提取结果。在图 4和图 5中,第1列为原始影像数据,第2列为居民地实况数据,第3和第4列为分别使用LOG特征和SHAN特征的居民地提取结果。通过图 4和图 5可以看出,使用本文的方法能够较好地实现高分影像居民地的提取,其提取的结果已非常接近居民地实况数据,并且保持了良好的拓扑形态,这将有利于对其进行矢量化处理,从而便于地理信息系统(GIS)的进一步应用。

|

| 图 4 ZY-3影像数据提取结果 Fig. 4 Residential area extraction results of ZY-3 image data set |

|

| 图 5 Quickbird影像数据提取结果 Fig. 5 Residential area extraction results of Quickbird image data set |

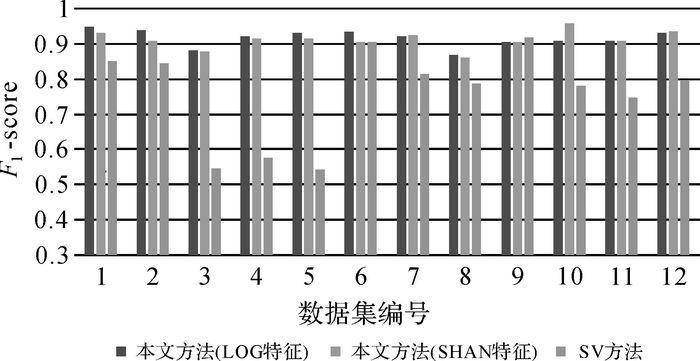

为进一步评估该方法的性能,笔者将其与经典的基于空间投票(spatial voting,SV)的方法[7]和基于视觉注意机制构建的BASI指数法[16-17]进行了比较。图 6为在该数据集上本文方法与SV方法F1-score的柱状图比较,每组的前2列为本文方法分别使用LOG特征和SHAN特征的结果,而第3列为SV方法的结果。总体上看,本文方法获得了更高的精度。另外,本文方法在获得较高精度的同时,对不同传感器的影像数据表现出了更好的稳定性,而SV方法对Quickbird数据(序号7-12)效果较好,但对ZY-3数据(序号1-6)性能相对较差而且波动性较大,这可能是由于SV方法中的Gabor滤波器主要根据地物滤波响应的幅度差异来获得局部特征点,影像中居民地域和非居民地域中常常发生相似的滤波响应特性,这时获得的特征点就比较容易混淆。而本文的方法模拟人类视觉机制,同时利用了居民地的局部角结构特征和高频的纹理特征,因而在提高精度同时也保证了性能的稳定性。

|

| 图 6 本文方法与SV方法的比较 Fig. 6 Comparison between the proposed method and SV |

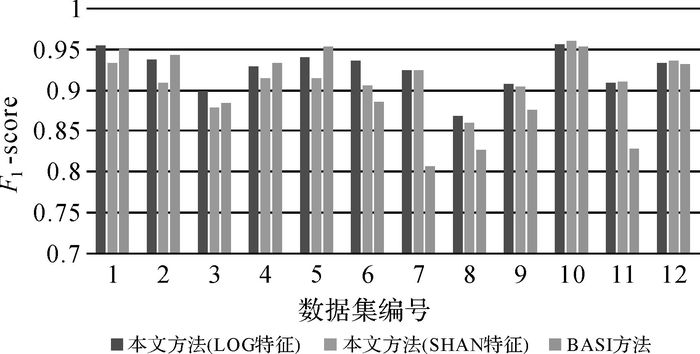

图 7为本文方法与BASI指数法的F1-score值比较结果,从该图可以看出,在ZY-3影像(序号1-6)上,本文方法与BASI性能接近,但在Quickbird影像(序号7-12)上,本文的方法表现出更优越的性能。这是由于BASI指数仅利用纹理特征来描述居民地显著性,在影像分辨率较高时,居民地的几何结构特征以及知觉组织机制在视觉认知中会发挥越来越重要的作用,本文的方法正是利用了这一特性,因而会获得相对更好的结果。

|

| 图 7 本文方法与BASI方法的比较 Fig. 7 Comparison between the proposed method and BASI |

5 结论

本文受人类视觉系统的视觉显著性与知觉组织机理启发,提出了一种高分影像居民地提取方法。该方法认为高分影像中的居民地由于其特殊的纹理和结构特征,使其表现出视觉显著性,而对于这种显著性的认知是建立在知觉组织机制上的,符合知觉组织规律的局部特征才会具有更大的视觉显著性。为此,本文分别提出了基于数据场的视觉显著性模型和基于多尺度小波变换特征的居民地知觉组织方法,并提取了同时满足这两种视觉机制的居民地域。ZY-3和Quickbird两种不同传感器的多种场景高分影像数据集的居民地提取试验表明,本文的方法能够获得较高的精度,并且提取的居民地域能够保持良好的拓扑形态,进一步的比较试验也表明本文方法的优越性。

本文提出的方法虽然具有较多的参数,但这些参数的设置相对容易,本文对两种传感器、不同场景的多幅试验数据设置了统一的试验参数,整体上仍获得了较好的试验效果。考虑到不同数据本身的特点,这些参数若有针对性的进行适当调整,还可以获得更好的试验结果。如何自适应地获得适合于数据自身特点的最佳参数,从而实现居民地的更好提取是未来进一步要研究的问题。

致谢: 特别感谢田英洁博士提供的BASI算法的试验结果,协助本文完成与BASI算法的比较。

| [1] |

秦昆, 陈一祥, 甘顺子, 等.

高分辨率遥感影像空间结构特征建模方法综述[J]. 中国图象图形学报, 2013, 18(9): 1055–1064.

QIN Kun, CHEN Yixiang, GAN Shunzi, et al. Review on Methods of Spatial Structural Feature Modeling of High Resolution Remote Sensing Images[J]. Journal of Image and Graphics, 2013, 18(9): 1055–1064. DOI:10.11834/jig.20130901 |

| [2] | BHATTI S S, TRIPATHI N K. Built-up Area Extraction Using Landsat 8 OLI Imagery[J]. GIScience & Remote Sensing, 2014, 51(4): 445–467. |

| [3] | DU Bo, ZHANG Yuxiang, ZHANG Liangpei, et al. Beyond the Sparsity-based Target Detector:A Hybrid Sparsity and Statistics-based Detector for Hyperspectral Images[J]. IEEE Transactions on Image Processing, 2016, 25(11): 5345–5357. DOI:10.1109/TIP.2016.2601268 |

| [4] | PESARESI M, GERHARDINGER A, KAYITAKIRE F. A Robust Built-up Area Presence Index by Anisotropic Rotation:Invariant Textural Measure[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2008, 1(3): 180–192. DOI:10.1109/JSTARS.2008.2002869 |

| [5] |

陈洪, 陶超, 邹峥嵘, 等.

一种新的高分辨率遥感影像城区提取方法[J]. 武汉大学学报(信息科学版), 2013, 38(9): 1063–1067.

CHEN Hong, TAO Chao, ZOU Zhengrong, et al. Automatic Urban Area Extraction Using a Gabor Filter and High-resolution Remote Sensing Imagery[J]. Geomatics and Information Science of Wuhan University, 2013, 38(9): 1063–1067. |

| [6] |

林晨曦, 周艺, 王世新, 等.

基于变差函数的中高分辨率SAR影像农村建筑区提取[J]. 中国图象图形学报, 2016, 21(5): 674–682.

LIN Chenxi, ZHOU Yi, WANG Shixin, et al. Variogram-based Rural Build-up Area Extraction from Middle and High Resolution SAR Images[J]. Journal of Image and Graphics, 2016, 21(5): 674–682. DOI:10.11834/jig.20160515 |

| [7] | SIRMACEK B, UNSALAN C. Urban Area Detection Using Local Feature Points and Spatial Voting[J]. IEEE Geoscience and Remote Sensing Letters, 2010, 7(1): 146–150. DOI:10.1109/LGRS.2009.2028744 |

| [8] | HU Xiangyun, SHEN Jiajie, SHAN Jie, et al. Local Edge Distributions for Detection of Salient Structure Textures and Objects[J]. IEEE Geoscience and Remote Sensing Letters, 2013, 10(3): 466–470. DOI:10.1109/LGRS.2012.2210188 |

| [9] |

陶超, 邹峥嵘, 丁晓利.

利用角点进行高分辨率遥感影像居民地检测方法[J]. 测绘学报, 2014, 43(2): 164–169, 192.

TAO Chao, ZOU Zhengrong, DING Xiaoli. Residential Area Detection from High-resolution Remote Sensing Imagery Using Corner Distribution[J]. Acta Geodaetica et Cartographica Sinica, 2014, 43(2): 164–169, 192. DOI:10.13485/j.cnki.11-2089.2014.0024 |

| [10] | TAO Chao, TAN Yihua, ZOU Zhengrong, et al. Unsupervised Detection of Built-up Areas from Multiple High-resolution Remote Sensing Images[J]. IEEE Geoscience and Remote Sensing Letters, 2013, 10(6): 1300–1304. DOI:10.1109/LGRS.2013.2237751 |

| [11] |

林祥国, 宁晓刚.

融合直角点和直角边特征的高分辨率遥感影像居民点提取方法[J]. 测绘学报, 2017, 46(1): 83–89.

LIN Xiangguo, NING Xiaogang. Extraction of Human Settlements from High Resolution Remote Sensing Imagery by Fusing Features of Right Angle Corners and Right Angle Sides[J]. Acta Geodaetica et Cartographica Sinica, 2017, 46(1): 83–89. DOI:10.11947/j.AGCS.2017.20160389 |

| [12] |

温奇, 李苓苓, 刘庆杰, 等.

基于视觉显著性和图分割的高分辨率遥感影像中人工目标区域提取[J]. 测绘学报, 2013, 42(6): 831–837.

WEN Qi, LI Lingling, LIU Qingjie, et al. A Man-made Object Area Extraction Method Based on Visual Saliency Detection and Graph-cut Segmentation for High Resolution Remote Sensing Imagery[J]. Acta Geodaetica et Cartographica Sinica, 2013, 42(6): 831–837. |

| [13] |

许妙忠, 丛铭, 万丽娟, 等.

视觉感受与Markov随机场相结合的高分辨率遥感影像分割法[J]. 测绘学报, 2015, 44(2): 198–205, 213.

XU Miaozhong, CONG Ming, WAN Lijuan, et al. A Methodology of Image Segmentation for High Resolution Remote Sensing Image Based on Visual System and Markov Random Field[J]. Acta Geodaetica et Cartographica Sinica, 2015, 44(2): 198–205, 213. DOI:10.11947/j.AGCS.2015.20130453 |

| [14] | ITTI L, KOCH C, NIEBUR E. A Model of Saliency-based Visual Attention for Rapid Scene Analysis[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1998, 20(11): 1254–1259. DOI:10.1109/34.730558 |

| [15] | ZHANG Fan, DU Bo, ZHANG Liangpei. Saliency-guided Unsupervised Feature Learning for Scene Classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 53(4): 2175–2184. DOI:10.1109/TGRS.2014.2357078 |

| [16] |

沈小乐, 邵振峰, 田英洁.

纹理特征与视觉注意相结合的建筑区提取[J]. 测绘学报, 2014, 43(8): 842–847.

SHEN Xiaole, SHAO Zhenfeng, TIAN Yingjie. Built-up Areas Extraction by Textural Feature and Visual Attention Mechanism[J]. Acta Geodaetica et Cartographica Sinica, 2014, 43(8): 842–847. |

| [17] | SHAO Zhenfeng, TIAN Yingjie, SHEN Xiaole. BASI:A New Index to Extract Built-up Areas from High-resolution Remote Sensing Images by Visual Attention Model[J]. Remote Sensing Letters, 2014, 5(4): 305–314. DOI:10.1080/2150704X.2014.889861 |

| [18] | ZHANG Libao, LI Aoxue, ZHANG Zhongjun, et al. Global and Local Saliency Analysis for the Extraction of Residential Areas in High-spatial-resolution Remote Sensing Image[J]. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(7): 3750–3763. DOI:10.1109/TGRS.2016.2527044 |

| [19] |

罗四维.

视觉信息认知计算理论[M]. 北京: 科学出版社, 2010.

LUO Siwei. Perception Computing of Visual Information[M]. Beijing: Science Press, 2010. |

| [20] | SARKAR S, BOYER K L. Perceptual Organization in Computer Vision:A Review and a Proposal for a Classificatory Structure[J]. IEEE Transactions on Systems, Man, and Cybernetics, 1993, 23(2): 382–399. DOI:10.1109/21.229452 |

| [21] | LI Deyi, DU Yi. Artificial Intelligence with Uncertainty[M]. Boca Raton: Chapman and Hall/CRC, 2007. |

| [22] | MARTINEZ-FONTE L, GAUTAMA S, PHILIPS W, et al.Evaluating Corner Detectors for the Extraction of Man-made Structures in Urban Areas[C]//Proceedings of 2005 IEEE International Geoscience and Remote Sensing Symposium.Seoul, South Korea:IEEE, 2005:237-240. |

| [23] | WU Tao, QIN Kun. Data Field-based Transition Region Extraction and Thresholding[J]. Optics and Lasers in Engineering, 2012, 50(2): 131–139. DOI:10.1016/j.optlaseng.2011.09.017 |

| [24] |

王永明, 王贵锦.

图像局部不变性特征与描述[M]. 北京: 国防工业出版社, 2010.

WANG Yongming, WANG Guijin. Image Local Invariant Features and Descriptors[M]. Beijing: National Defense Industry Press, 2010. |

| [25] | HARRIS C, STEPHENS M.A Combined Corner and Edge Detector[C]//Proceedings of Fourth Alvey Vision Conference.Manchester:University of Manchester, 1988:147-152. |

| [26] | ROSIN P L. Unimodal Thresholding[J]. Pattern Recognition, 2001, 34(11): 2083–2096. DOI:10.1016/S0031-3203(00)00136-9 |

| [27] | OTSU N. A Threshold Selection Method from Gray-level Histograms[J]. IEEE Transactions on Systems, Man, and Cybernetics, 1979, 9(1): 62–66. DOI:10.1109/TSMC.1979.4310076 |

| [28] | HU Xiangyun, TAO V. Automatic Extraction of Main Road Centerlines from High Resolution Satellite Imagery Using Hierarchical Grouping[J]. Photogrammetric Engineering and Remote Sensing, 2007, 73(9): 1049–1056. |

| [29] | WANG Jun, YANG Xiucheng, QIN Xuebin, et al. An Efficient Approach for Automatic Rectangular Building Extraction from Very High Resolution Optical Satellite Imagery[J]. IEEE Geoscience and Remote Sensing Letters, 2015, 12(3): 487–491. DOI:10.1109/LGRS.2014.2347332 |

| [30] | MYINT S W, LAM N S N, TYLER J M. Wavelets for Urban Spatial Feature Discrimination:Comparisons with Fractal, Spatial Autocorrelation, and Spatial Co-occurrence Approaches[J]. Photogrammetric Engineering and Remote Sensing, 2004, 70(7): 803–812. DOI:10.14358/PERS.70.7.803 |