2. 武汉大学时空数据智能获取技术与应用教育部工程研究中心,湖北 武汉 430079;

3. 广东电力科学研究院,广东 广州 510080

2. Engineering Research Center for Spatio-temporal Data Smart Acquisition and Application, Ministry of Education of China, Wuhan University, Wuhan 430079, China;

3. Guangdong Electric Power Research Institute, Guangzhou 510080, China

随着电子、传感器与计算机技术的快速发展,可量测相机、激光扫描仪、POS系统等对地观测的传感器逐步小型化与轻量化。尤其是低空无人机(UAV)平台的快速发展,使轻小型、集成化的无人机低空遥感系统成为现实。武汉大学以小型无人直升机为搭载平台,集成激光扫描仪、光学相机、IMU等传感器,研制了低空无人机多功能三维测量系统Heli_Mapping,实现了飞行区域内激光点云、同时相可见光影像数据的同步获取。激光点云数据可提供精确物方三维信息,但缺乏纹理、光谱信息,给点云数据的滤波、分类和解译带来较大困难[1],可见光影像则具有较好的纹理信息,激光点云数据与影像联合处理是当前摄影测量与遥感领域一个研究热点[2, 3, 4, 5, 6, 7]。激光点云数据与可见光影像数据的配准是二者联合处理的先决条件,对目标的提取、三维重建、真正射影像生成、高精度DEM生产等都具有十分重要的作用。

与成熟的商用有人机机载激光扫描系统不同,低空无人机飞行平台的有限载荷(一般都小于20 kg)极大地限制了传感器的选型(扫描仪、相机等),同时低空无人机平台的稳定性亦较差,难以利用商用有人机系统的硬件检校方式实现激光点云与同步获取影像的高精度配准。目前,可见光影像与激光扫描点云的配准方法主要分为4类:①基于特征匹配的2D-3D配准算法[8, 9, 10, 11, 12, 13, 14];②基于统计的2D-3D配准算法[15, 16];③基于影像多视匹配生成密集点云与激光点云配准的3D-3D配准算法[17];④基于硬件标定的方法[18, 19]。基于线对的自动配准方法[12, 13]需要较为准确的影像外方位元素初值与正确的匹配对保证平差的正确收敛。由于低空无人机系统的飞行高度低、飞行速度较慢、飞行姿态不稳定等因素,与商用机载系统相比其获取的激光点云密度高,获取的影像的像幅小、分辨率高、基线短、畸变大。上述因素给低空无人机平台的激光点云和影像的配准带来了较大的困难和挑战,导致传统的线对配准方法难以应用于低空无人机系统点云和影像的配准。

目前,低空无人机激光扫描系统点云与影像自动配准的研究处于起步阶段。纵观国内外的研究成果与相关应用可以看出:现有的航空可见光影像与激光扫描数据配准方法将POS系统的输出值作为可见光影像的外方位元素的近似值,无法满足POS系统输出值精度较差或影像和激光点云异步获取情况下的激光点云和影像的配准。同时基于特征的配准方法多为半自动方法,需要交互选择配准基元,缺乏对基元提取完整度与配准精确的评价。

针对以上问题,本文研究基于建筑物顶部轮廓特征的低空无人机可见光影像与激光点云的两步法高精度自动配准方法。首先基于提取的建筑物顶面特征进行2D(影像)-3D(点云)粗配准,同时,为避免特征错误提取、匹配基元对配准精度与稳健性的影响,进而利用影像多视立体生成密集点云与激光点云进行3D-3D的精配准,从而优化粗配准的结果,保证配准的精度与稳健性。

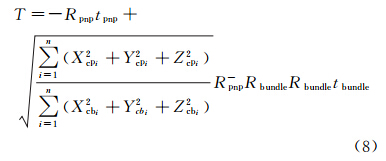

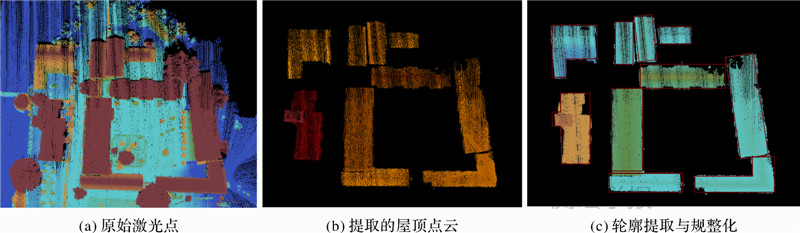

2 低空UAV激光点云与序列影像的自动配准本文提出的UAV影像与激光点云配准的流程如图 1所示。该方法的第1步通过建立两者间的融合点、线配准基元的建筑物顶面特征匹配基元,削弱现有配准方法对POS系统输出值的依赖,实现两者间的粗配准;第2步基于多视立体匹配方法生成序列影像的密集点云,以第1步的粗匹配的结果为初始值与激光点云进行带相对运动阈值约束的迭代最临近点计算,优化粗配准参数,消除建筑物顶面点,线基元提取不完整或错误匹配对配准精度的影响,最终实现序列可见光影像与激光点云的高精度稳健配准。

|

| 图 1 UAV 影像与激光点云的自动配准Fig. 1 Flow chart of automatic registration of UAV images sequence and laser points cloud |

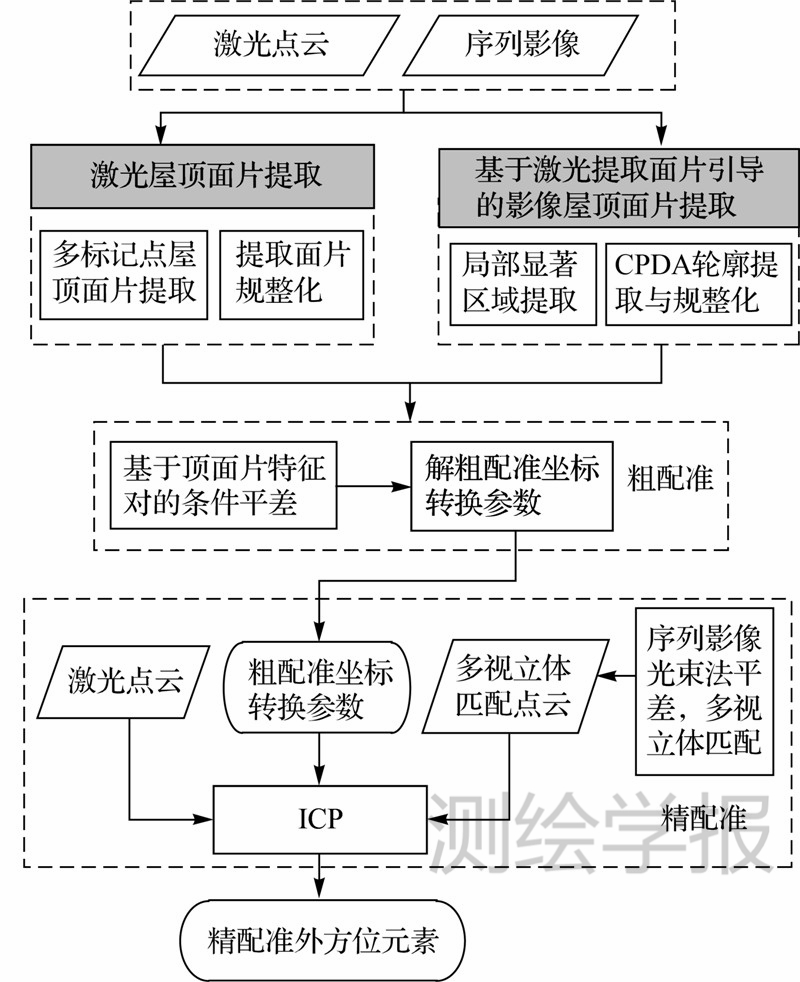

建筑物顶部具有明显的线结构特征,在激光点云和可见光影像中均具有较好的可分性。本文的方法首先基于多标记点过程方法[20]对低空无人机激光点云数据进行建筑物目标的提取,并使用迭代最小外包矩形方法(recursive minimum bounding rectangle,RMBR)[21]对提取轮廓进行规则化,获取建筑物目标的轮廓数据。图 2是基于多标记点过程方法从无人机激光点云提取的建筑物轮廓规则化结果。

|

| 图 2 建筑物顶面提取与规则化Fig. 2 Extraction and regularization of building roofs from LiDAR data |

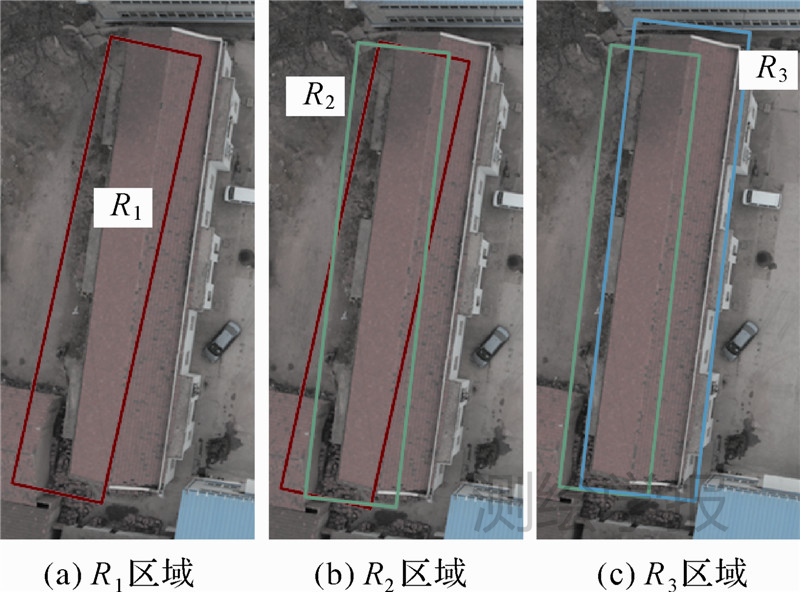

利用可见光影像的POS数据将点云中提取的建筑物轮廓反投影到影像,记为R1区域。由于飞行姿态的不稳定性以及POS的误差,导致点云中提取的建筑物轮廓和可见光影像中的建筑物轮廓存在较大的偏差(如图 3(a)所示),直接使用R1区域进行显著性区域检测将导致可见光影像中建筑物轮廓提取不完整等问题。因此,建立基于多通道图像张量梯度方向统计与极值响应解算的反投影区域查找方法从可见光影像中提取建筑物的完整轮廓区域(R3)。

|

| 图 3 建筑物轮廓线查找区域Fig. 3 Extraction regions of the building contour |

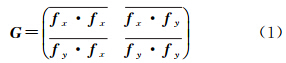

在R1区域内进行多通道图像结构张量梯度计算。对于可见光影像ƒ=(ƒ1,ƒ2,…,ƒn)T,其结构张量G表示为式(1)

计算G对应的本征值,并进行非极大值抑制,保留强边缘响应,其对应最大梯度方向θ按式(2)进行计算

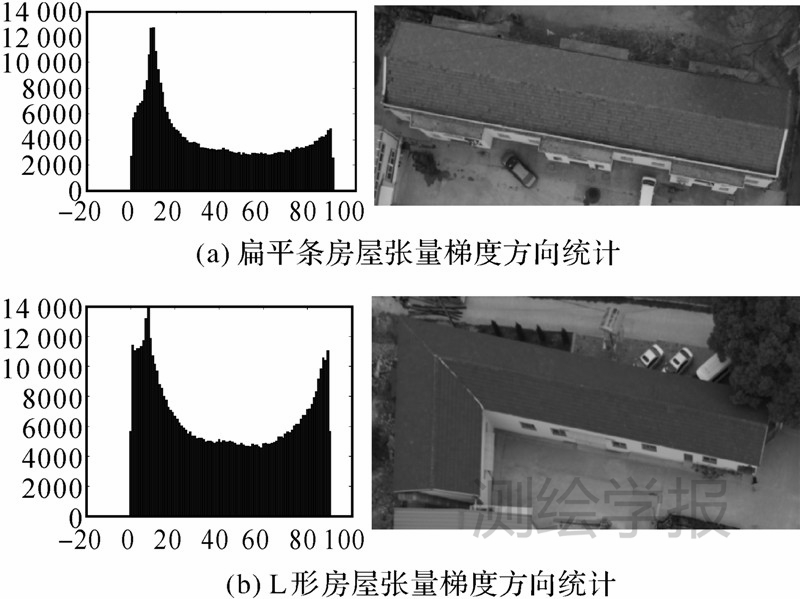

对于规则建筑物,建筑物边缘方向与最大梯度方向垂直。因此,最大梯度方向反映建筑物基本走向。经统计发现:建筑物区域的张量梯度方向分布具有单峰(长条形房屋)和双峰特性(正方形房屋或L形房屋),如图 4所示。对于异形房屋,其张量梯度方向分布统计图不具备以上两种特性,依据此特征对其进行剔除,不参与后续配准运算。

|

| 图 4 建筑物张量梯度统计直方图Fig. 4 Histogram statistic of buildings tensor gradient orientation |

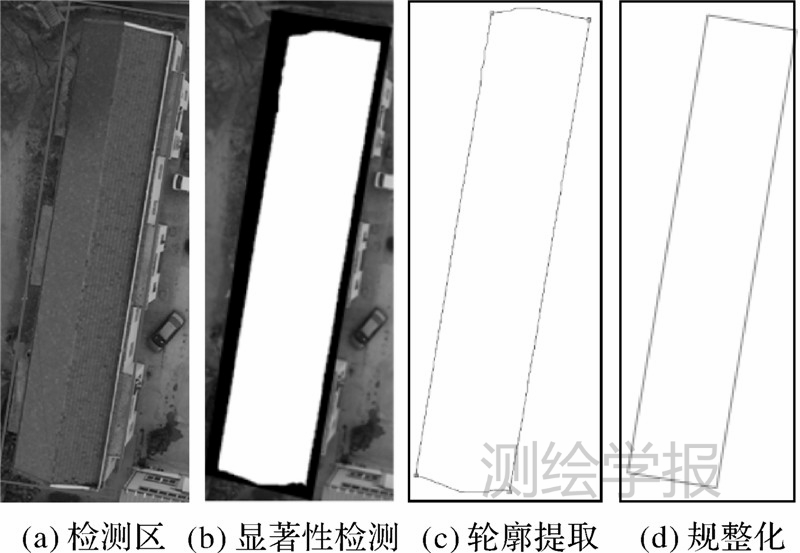

以张量梯度方向统计峰值点为建筑物区域的主方向,以R1区域重心为转轴将R1区域旋转到梯度方向统计峰值点方向得到R2区域(图 3(b))。在区域R2主方向与次主方向上逐像素移动区域R2,查找获得区域内最强梯度张量梯度和响应位置作为最优查找区域R3。对区域R3进行缓冲区扩展,最后基于对比度显著性区域检测[22]和轮廓角点算子CPDA[23]检测建筑物轮廓,并进行矢量化和规整化,从而提取出影像中的建筑物外轮廓特征,如图 5所示。

|

| 图 5 基于激光先验知识的影像建筑物屋顶提取Fig. 5 Building contour extraction from image using prior form laser points cloud |

根据影像中提取的建筑物轮廓和激光点云中对应的建筑物轮廓构建建筑物影像角点m= (u,v,f)与激光轮廓角点M=(X,Y,Z)的匹配集合{IL|sm=A[R|t]M}和匹配线对集合。

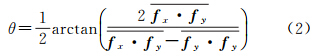

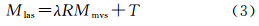

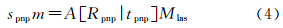

首先自建筑物轮廓角点匹配集合{IL|sm=A[R|t]M} 点对,使用快速透视N点方法 (efficient perspective N point,EPNP)[24]解算相机模型。对满足共面平差的条件:存在两对不平行匹配线对的匹配集,使用线对共面平差方法[12]对结果进行迭代优化。对于分别位于自由网光束法坐标系CMVS 与世界坐标系Cworld中的同名点Mmvs,Mlas有转换关系如式(3)

式中,R、T、λ分别为坐标转换过程中的旋转、平移以及尺度变换参数。基于EPNP并附带线对共面平差条件平差解算式(4)可获得激光世界坐标系下相机外方位元素

式中,m为Mlas在影像上成像的像素坐标;A为相机标定矩阵;(spnp,Rpnp,tpnp) 为点Mlas成像的旋转,平移以及尺度变换参数。经序列影像自由网光束法平差[25]解算式(5)可求解相机在CMVS 下的外方位元素

式中,m为点Mmvs在影像上成像的像素坐标;A为相机标定矩阵; (sbundle,Rbundle,tbundle)为Mmvs成像的旋转,平移以及尺度变换参数。对于N张影像EPNP线性解,联立式(3)、式(4)、式(5)计算自由网下的多视立体匹配密集点云到激光点云世界坐标的旋转参数R如式(6)

令CMVS坐标系中相机外方位元素线元素重心坐标为PCpnp(Xcp,Ycp,Zcp),Cworld 标系中的相机外方位元素线元素重心坐标为PCbundle (Xcb ,Ycb ,Zcb ),则尺度参数λ最小二乘估计如式(7)

将式(6)、式(7)代入式(3)中相机位置值即可解算线元素T,如式(8)

2.3 基于迭代最邻近点方法的3D-3D精确配准

基于多视密集匹配方法[26]对经序列影像光束法平差[25]后的序列影像生成影像密集点云,将2D-3D的影像与激光点云配准问题转换为3D-3D的密集匹配点云与激光点云ICP配准问题。利用粗配准的结果作为ICP的初始值,采用两点间距离最小化作为ICP最优配准的收敛条件,则最优配准可表达为求解函数E(λ3D-3D,R3D-3D,T3D-3D)最小值对应的 λ3D-3D,R3D-3D,T3D-3D。以欧氏距离作为测度,E(λ3D-3D,R3D-3D,T3D-3D)表达如式(9)

以2.2节中求解的粗匹配计算获得的R、T、λ作为ICP初值,对式(9)进行迭代解算,避免由于POS初值不准确导致ICP迭代错误收敛。其次,为消除密集匹配点云中存在误匹配对整体ICP错误收敛的影响,采用相对运动阈值[27]限制点对搜索,提高了ICP算法稳健性。同时采用分步迭代计算的平差方法[28]对R、T、λ迭代解算。经迭代优化后,对于每帧影像有精配准参数Rcam=RRfAT 、Tcam=λRTfAT+T,其中RfAT 、TfAT 为光束法平差相机外方位元素。

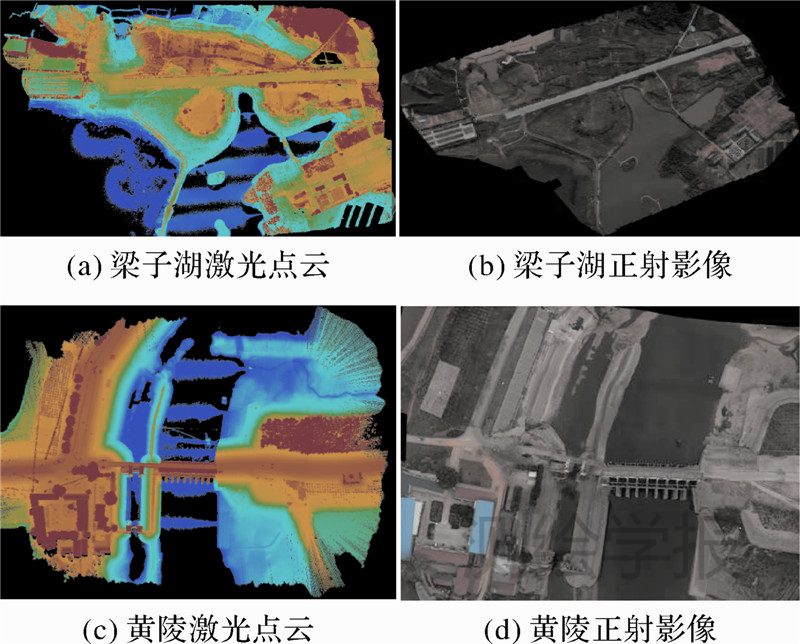

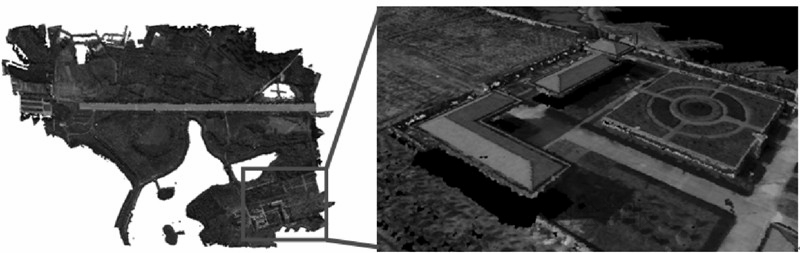

3 配准试验与分析为验证本文方法的有效性,利用武汉大学的低空无人直升机Heli_Mapping系统获取的武汉黄陵地区和梁子湖地区的激光点云与影像数据(如图 6)进行了配准试验。其中两个区域的航飞高度、影像地面分辨率(GSD)、点云密度等参数见表 1。

|

| 图 6 试验数据集Fig. 6 Experiment datasets |

| 黄陵数据集 | 梁子湖数据集 | |

| 相对航高/m | 80 | 130 |

| 激光点云平均密度/(个/m2) | 25.4 | 10.2 |

| 影像分辨率GSD/cm | 2.1 | 3.5 |

| 影像数量 | 78 | 343 |

| 激光点数 | 6 506 721 | 8 893 549 |

| 航带数 | 4 | 9 |

| 面积/km2 | 0.26 | 0.87 |

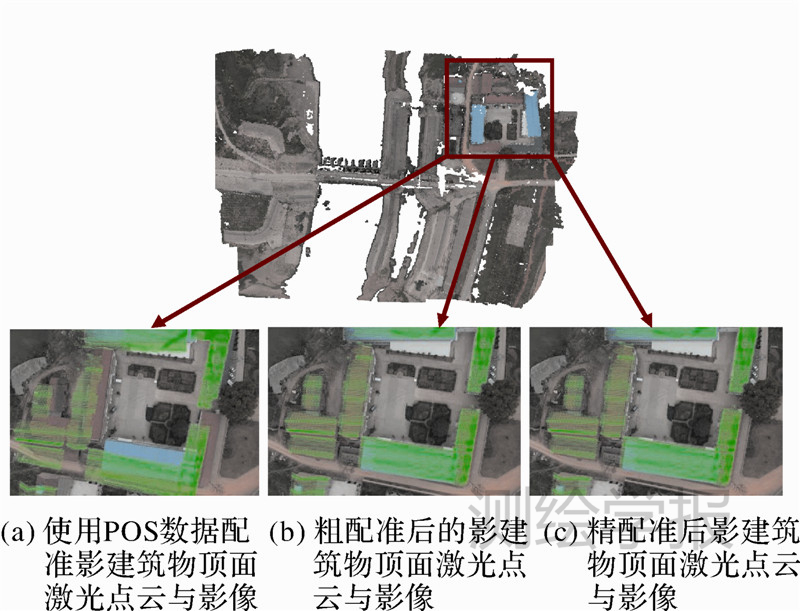

图 7(a)为直接使用POS提供姿态与位置信息将提取的建筑物顶面激光点云反投影到影像上的配准结果,可见存在较大的配准误差。图 7(b)为经粗配准计算相机模型后建筑物顶面激光点云与影像配准结果。由图 7(b)可见,配准差依然存在,主要原因是特征匹配粗差以及点云密度过低引起的线框特征估计不准确原因导致。图 7(c)为经本文提出配准方法的配准结果,结果显示粗配准误差得到了进一步的消除。

|

| 图 7 由粗到精的点云和影像两步自动配准Fig. 7 Coarse to fine registration of images and laser points cloud |

为定量检验本文方法的配准精度,使用预先布设在两个数据集测区内的高反射靶标作为检查点进行检查,其中黄陵数据集、梁子湖数据集分别布设检查点15个与9个。在激光点云中使用强度信息提取高反射靶标点,拟合靶标矩形获得其中心坐标作为靶标检查点坐标。分别使用POS数据,粗配准参数,精配准参数,反投影检查点到影像,量测检查点反投影成像与检查点影像成像坐标的距离差(以像素为单位)作为配准精度评定指标量。从两份数据配准精度检查表(表 2、表 3)可看出:经本文方法配准后配准像素误差由原始POS数据的85像素降低到精配准后的1像素(残差分布见图 8),较好地解决了较大配准粗差条件下的点云与序列影像的自动配准,克服了传统线基元配准方法的不足。

| 像素 | ||||

| 最大像素差 | 最小像素差 | 平均像素差 | 中误差 | |

| 检校 | 149.634 | 46.637 | 91.353 | 32.770 |

| 粗配准 | 32.518 | 2.637 | 13.886 | 8.531 |

| 精配准 | 1.637 | 0.008 | 0.619 | 0.493 |

| 像素 | ||||

| 最大像素差 | 最小像素差 | 平均像素差 | 中误差 | |

| 检校 | 137.424 | 37.847 | 86.972 | 35.320 |

| 粗配准 | 31.283 | 3.784 | 15.390 | 7.398 |

| 精配准 | 1.283 | 0.462 | 0.834 | 0.219 |

|

| 图 8 检查点反投影像素差残差Fig. 8 Residual projection error distribution |

联合配准后的激光点云和影像制作了梁子湖区域的DEM 和DOM,并基于RTK实测30个检查点对平面和高程误差进行了计算,具体结果见表 4。

| m | ||||||||

| 检查点 | 最大误差 | 最小误差 | 平均误差 | 中误差 | ||||

| XY | Z | XY | Z | XY | Z | XY | Z | |

| 0.146 2 | 0.149 9 | 0.019 4 | 0.001 0 | 0.075 4 | 0.072 3 | 0.036 4 | 0.061 7 | |

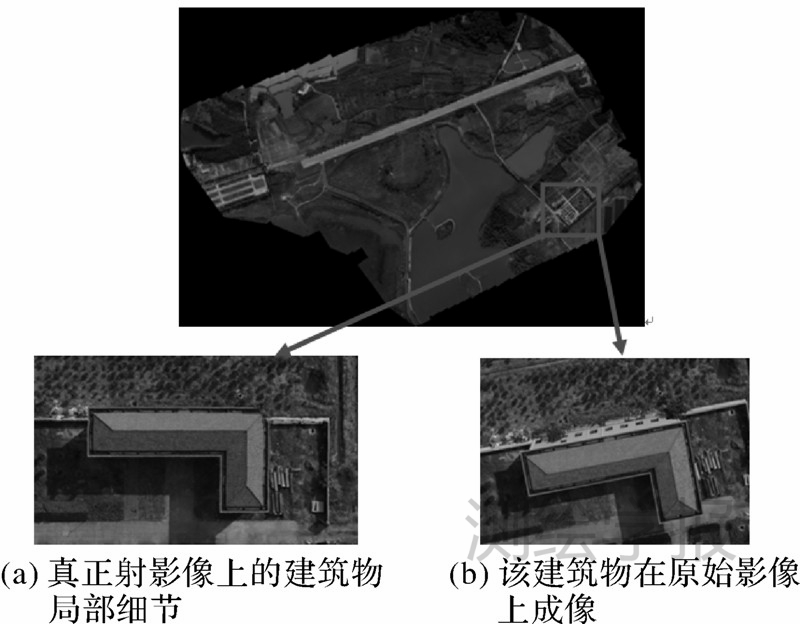

按照现行《低空数字航空摄影测量内业规范CH/Z 3003—2010》中的规定,采用航空摄影测量方法测绘的1∶500比例尺平原地区地形图,应满足平面中误差<0.6 m、 高程误差< 0.5 m的精度要求,配准结果精度基本满足1∶500 比例尺地形图精度要求。图 9为使用配准后影像数据给激光点云赋色结果。图 10为完成数据配准后使用激光点云与序列影像制作的真正射影像与原始影像的局部细节对比。由图 10可见,使用配准后数据集进行真正射纠正后,房屋屋顶得到纠正,且由其造成的遮挡区域也得到填补。

|

| 图 9 使用配准序列影像数据赋色的激光点云Fig. 9 Laser point cloud rendered by color from registered images |

|

| 图 10 基于自动配准数据制作真正射影像Fig. 10 True ortho images generated from co-registered dataset |

经定量配准精度分析,使用经本文方法配准后的相机外方位元素和激光点云滤波生成DEM 制作的DOM满足大比例尺(1∶500)正射影像制作要求。由于本文方法使用建筑物轮廓作为粗配准基元,对于无建筑物区域的UAV影像和激光点云的配准问题难以解决,下一步将研究通用于各种地形条件下的UAV影像与激光的高精度自动配准。

| [1] | BALTSAVIAS E A. Comparison between Photogrammetry and Laser Scanning[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 1999, 54(2): 83-94. |

| [2] | HABIB A F, GHANMA M S, TAIT M. Integration of LiDAR and Photogrammetry for Close Range Applications[R]. International Archives of Photogrammetry and Remote Sensing. Istanbul:[s.n.], 2004. |

| [3] | HABIB A F, RUIFANG Z, KIM C. Generation of Complex Polyhedral Building Models by Integrating Stereo-aerial Imagery and LiDAR Data[J]. Photogrammetric Engineering and Remote Sensing, 2010, 76(5): 609-623. |

| [4] | HUDAK A T, LEFSKY M A, COHEN W B, et al. Integration of LiDAR and Landsat ETM+Data for Estimating and Mapping Forest Canopy Height[J]. Remote Sensing of Environment, 2002, 82(2): 397-416. |

| [5] | NAIDOO L, CHO M A, MATHIEU R, et al. Classification of Savanna Tree Species, in the Greater Kruger National Park Region, by Integrating Hyper-spectral and LiDAR Data in a Random Forest Data Mining Environment[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2012, 69(4):167-179. |

| [6] | LI Yijing, HU Xiangyun, ZHANG Jianqing, et al. Automatic Road Extraction in Complex Scenes Based on Information Fusion from LiDAR Data and Remote Sensing Imagery[J]. Acta Geodaetica et Cartographica Sinica, 2012, 41(6): 870-876. (李怡静, 胡翔云, 张剑清, 等. 影像与LiDAR数据信息融合复杂场景下的道路自动提取[J]. 测绘学报, 2012, 41(6): 870-876.) |

| [7] | WU Hangbin. Classification and Feature Extraction of Airborne LiDAR Data Fused with Aerial Image[J]. Acta Geodaetica et Cartographica Sinica, 2011, 40(1): 134-134. (吴杭彬. 融合航空影像的机载激光扫描数据分类与特征提取[J]. 测绘学报, 2011, 40(1): 134-134.) |

| [8] | STAMOS I, LIU L, CHEN C, et al. Integrating Automated Range Registration with Multiviews Geometry for the Photo-realistic Modeling of Large-scale Scenes[J]. International Journal of Computer Vision, 2008, 78(2-3): 237-260. |

| [9] | DING M, LYNGBAEK K, ZAKHOR A. Automatic Registration of Aerial Imagery with Untextured 3D LiDAR Models[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Anchorage: IEEE, 2008: 1-8. |

| [10] | ZHONG Cheng, LI Hui, HUANG Xianfeng, et al. Automatic Registration of LiDAR Data and Aerial Image Based on a 6 Tuples Relaxation[J]. Geomatics and Information Science of Wuhan University, 2009, 34(12): 1426-1430. (钟成, 李卉, 黄先锋, 等. 利用 6 元组松弛法自动配准 LiDAR 数据与航空影像[J]. 武汉大学学报: 信息科学版, 2009, 34(12): 1426-1430.) |

| [11] | DENG Fei, ZHANG Zuxun, ZHANG Jianqing. Three-dimensional Reconstruction of Ancient Architecture Using Laser Scanner and Digital Camera[J]. Science of Surveying and Mapping, 2007, 32(2): 29-30. (邓非, 张祖勋, 张剑清. 利用激光扫描和数码相机进行古建筑三维重建研究[J]. 测绘科学, 2007, 32(2): 29-30.) |

| [12] | HABIB A, GHANMA M, MORGAN M, et al. Photogrammetric and LiDAR Data Registration Using Linear Features[J]. Photogrammetric Engineering and Remote Sensing, 2005, 71(6): 699-707. |

| [13] | MA Hongchao, YAO Chunjing, WU Jianwei. Registration of LiDAR Point Clouds and High Resolution Images Based on Linear Feature[J]. Geomatics and Information Science of Wuhan University, 2012, 37(2): 136-140. (马洪超, 姚春静, 邬建伟. 利用线特征进行高分辨率影像与 LiDAR 点云的配准[J]. 武汉大学学报: 信息科学版, 2012, 37(2): 136-140.) |

| [14] | WANG Yanmin, HU Chunmei. A Robust Registration Method for Terrestrial LiDAR Point Clouds and Texture Image[J]. Acta Geodaetica et Cartographica Sinica, 2012, 41(2): 266-272. (王晏民, 胡春梅. 一种地面激光雷达点云与纹理影像稳健配准方法[J]. 测绘学报, 2012, 41(2): 266-272.) |

| [15] | FRUEH C, SAMMON R, ZAKHOR A. Automated Texture Mapping of 3D City Models with Oblique Aerial Imagery[C]//Proceedings of the 2nd International Symposium on 3D Data Processing, Visualization and Transmission.[S.l.]: IEEE, 2004: 396-403. |

| [16] | MASTIN A, KEPNER J, FISHER J. Automatic Registration of LiDAR and Optical Images of Urban Scenes[C]//Proceedings of 2009 IEEE Conference on Computer Vision and Pattern Recognition. Miami: IEEE, 2009: 2639-2646. |

| [17] | ZHAO W, NISTER D, HSU S. Alignment of Continuous Video onto 3D Point Clouds[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2005, 27(8): 1305-1318. |

| [18] | ZHONG Liang, MA Hongchao, GUAN Haiyan, et al. Boresight Calibration Based Fast Registration between Airborne LiDAR Points Clouds and Synchronous Images[J]. Geomatics and Information Science of Wuhan University, 2011, 36(9): 1035-1038. (钟良, 马洪超, 管海燕, 等. 利用安置角检校进行机载 LiDAR点云数据与同步影像快速配准[J]. 武汉大学学报: 信息科学版, 2011, 36(9): 1035-1038.) |

| [19] | WU Shenghao, ZHONG Ruofei. The 3D Visualization's Approach Based on Vehicle-borne Laser Scanning[J]. Journal of Capital Normal University: Natural Science Edition, 2011, 32(4): 57- 61. (吴胜浩, 钟若飞. 基于移动平台的激光点云与数字影像融合方法[J]. 首都师范大学学报: 自然科学版, 2011, 32(4): 57-61.) |

| [20] | YANG B S, XU W X, DONG Z. Automated Extraction of Building Outlines from Airborne Laser Scanning Point Clouds[J]. IEEE Geoscience and Remote Sensing Letters, 2013, 10(6): 1399-1403. |

| [21] | KWAK E. Automatic 3D Building Model Generation by Integrating LiDAR and Aerial Images Using a Hybrid Approach[D]. Calgary: University of Calgary, 2013. |

| [22] | CHENG M M, ZHANG G X, MITRA N J, et al. Global Contrast Based Salient Region Detection[C]//Proceedings of 2011 IEEE Conference on Computer Vision and Pattern Recognition. Providence: IEEE, 2011: 409-416. |

| [23] | AWRANGJEB M, LU G, FRASER C S. Performance Comparisons of Contour-based Corner Detectors[J]. IEEE Transactions on Image Processing, 2012, 21(9): 4167-4179. |

| [24] | LEPETIT V, MORENO-NOGUER F, FUA P. EPnP: An Accurate O(n) Solution to the PnP Problem[J]. International Journal of Computer Vision, 2009, 81(2): 155-166. |

| [25] | LI Deren, YUAN Xiuxiao. Error Processing and Reliability Theory[M]. Wuhan University Press, 2002. (李德仁, 袁修孝. 误差处理与可靠性理论[M]. 武汉: 武汉大学出版社, 2002) |

| [26] | LAFARGE F, KERIVEN R, BRéDIF M, et al. A Hybrid Multi-view Stereo Algorithm for Modeling Urban Scenes[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2013, 35(1):5-17. |

| [27] | POMERLEAU F, COLAS F, FERLAND F, et al. Relative Motion Threshold for Rejection in ICP Registration[C]//Field and Service Robotics.Berlin: Springer, 2010: 229-238. |

| [28] | ZHANG Yongjun, HU Binghua, ZHANG Jianqing. Absolute Orientation of Large Rotation Angle Images[J]. Geomatics and Information Science of Wuhan University,2010, 35(4): 427-431. (张永军, 胡丙华, 张剑清. 大旋角影像的绝对定向方法研究[J]. 武汉大学学报: 信息科学版, 2010, 35(4): 427-431.) |