2. 北京建筑大学北京未来城市设计高精尖创新中心, 北京 100044;

3. 东北大学信息科学与工程学院, 辽宁 沈阳 110819;

4. 欧思徕(北京)智能科技有限公司, 北京 102300

2. Beijing Advanced Innovation Center for Future Urban Design, Beijing University of Civil Engineering and Architecture, Beijing 100044, China;

3. College of Information Science and Engineering, Northeastern University, Shenyang 110819, China;

4. OmniSlam(Beijing) Technology, Inc., Beijing 102300, China

电子学、信息学、电子计算机科学与空间科学等学科自身的不断发展,极大地推动了包括测绘仪器设备在内的测绘领域各项技术的变革和进步,测绘仪器从早期的测绳、罗盘仪、游标经纬仪等经典测量工具,逐步发展成为电子经纬仪、数字水准仪、全站仪、GPS及各种电子专用仪器。20世纪60年代,电磁波测距仪的出现使长期以来只依靠观测角度的测量方式发生了根本性变化,并且结合电子经纬仪形成了目前测绘领域中应用极为广泛的全站仪。此外,微波测距仪、激光束准仗、激光扫平仪、数字水准仪、陀螺经纬仪等仪器的进步也推动了测绘技术的发展。20世纪70年代,除了用飞机进行航空摄影测量测绘地(形)图外,还通过人造地球卫星拍摄地球照片,监测自然现象的变化,并且测绘地图的精度也逐步提高。20世纪80年代,GPS问世,采用卫星直接进行空间点的三维定位引起了测绘行业的重大变革,为工程测量提供了崭新的技术手段和方法。由于卫星定位具有全球、全天候、快速、高精度和无需建立高标等优点,被广泛应用于大地测量、工程测量、地形测量及军事的导航、定位上[1-3]。

常见的测角、测距、测高、定向、定位和绘图通常是通过多余观测或重复测量来保证精度和稳定性,劳动强度大、作业时间长。而长期以来用测角、测距、测水准为主体的常规地面定位技术,正逐步被以一次性确定三维坐标的、高速度、高效率、高精度的GPS技术所代替,同时定位范围已从陆地和近海扩展到海洋和宇宙空间,定位方法已从静态扩展到动态,定位服务领域已从导航和测绘领域扩展到国民经济建设的广阔领域。随着计算机技术和数字地图技术的发展,三维场景的信息采集与重构精度越来越高,其应用也越来越广泛。倾斜摄影技术的发展,使得低空遥感平台实现了低空数码影像获取,可以满足大比例尺测图、精度较高的城市三维建模等工程应用的需要。机载激光雷达(Airborne LiDAR)集激光扫描仪、GPS和惯性导航系统(INS)3种技术于一体,能够直接得到高精度的三维坐标信息,与传统的航空摄影测量方法相比,使用机载激光雷达技术可部分地穿透树林遮挡,直接获取地面点的高精度三维坐标数据,而且具有外业成本低、内业处理简单等优点。然而,航空测量对于地面的信息缺失较多,尤其是在三维重建中,建筑物最底端的重建效果较差,因此,还需要以地面测绘系统重建的信息进行补充。地面移动测绘系统是指在移动载体平台上集成多种传感器,通过定位、定姿和成像等传感器在移动状态下自动采集各种定位定姿数据(GPS、INS)、影像数据和激光扫描数据,并通过统一的地理参考和摄影测量解析处理,实现无控制的空间地理信息采集与建库。该系统将激光扫描得到的点云数据与数码影像进行融合,能够快速完成三维模型的纹理映射,由于省去了近景摄影测量中复杂的影像匹配步骤,可以显著地提高工作效率。而地面场景的三维点云数据获取一般分为两种,移动式激光扫描和固定式激光扫描。目前,现有的地面移动测量系统通常是基于车载的移动测量系统的,但目前地面移动测量系统均需要依赖于全球卫星导航系统(global navigation satellite system,GNSS)和惯性导航系统,只能用于室外环境。然而,由于室内和地下空间等环境中没有GNSS信号,因此,传统的移动测量系统无法正常工作。固定式激光扫描可以用于室内室外的环境,但是复杂场景需要大量换站,然后进行点云拼接,数据获取的效率十分低下。然而,即时定位与地图构建(simultaneous localization and mapping,SLAM)技术在移动测绘方面具有较好的应用,如欧洲专利号为EP2913796A1的基于SLAM技术的推车,能够对室内和室外的地面水平环境进行地图构建和环境建模。因此,SLAM技术在测绘领域中的应用降低了测量复杂性,不需要大量标记地物点,不需要GPS信号,适用于在室内室外场景,对于解决传统测绘中的定位及场景重建问题具有广阔的前景。

SLAM技术是机器人领域的关键技术之一,是现代智能移动机器人系统的核心技术。SLAM解决的问题是移动机器人在未知的环境中利用自身装载的传感器获取数据进行探索,通过观测的数据,增量式地建立与环境相同的地图,同时利用已经建立的环境模型计算出机器人的位姿。SLAM是机器人进入未知环境遇到的第一个问题,是路径规划及许多其他任务的前提,是实现机器人自主性的关键,是一个智能移动机器人进行其他一切后续动作和行为的技术依据。目前,SLAM技术在扫地机器人、家用机器人、无人机、智能手机、可穿戴设备等方面具有广泛的应用。

SLAM技术在测绘领域的应用是一个新问题,目前有一些SLAM的综述和教程,但基本都是对各类SLAM方法、原理和常规模块的介绍,没有SLAM技术在测绘领域中的应用论述。本文主要根据SLAM技术的发展现状及其在测绘领域中的应用问题进行综述,并且给出SLAM技术在测绘领域中应用的示例。

1 SLAM技术简介 1.1 SLAM技术发展历程1986年以前,还未形成SLAM的概念,只在地图已知的情况下研究定位问题。1986—1990年期间,Smith等对该问题进行了大量研究,并清楚地定义了SLAM, 也称为CML(concurrent mapping and localization),即时定位与地图构建或并发建图与定位[4]。

EKF(extended Kalman filter)模型主导时期,如Castellanos等[5]提出的基于图像和激光在EKF框架的算法是以激光为主的定位;SeS等[6]利用双目相机,提出在EKF框架下通过特征点运动估计的算法;Davison[7]利用单目相机,提出在EKF框架下最早的实时SLAM系统,成为之后许多单目系统的起源。但是EKF的方法具有一定的局限性,因此,又提出了粒子滤波(particle filter,PF)、RBPF(Rao-Blackwellised粒子滤波器)、UKF(unscented Kalman filter)等改进的方法[8-10]。

BA(bundle adjustment)转型期:源于摄影几何的BA算法, 用于优化所有帧位姿约束的误差。2000年引入SFM(structure from motion)到SLAM算法中,在计算机视觉领域,SFM技术与SLAM技术类似,早期的SFM技术一般是离线处理,后来研究出实时SFM技术应用到V-SLAM等,代表性工作主要有PTAM[11]和FrameSLAM[12]。

2010年之后,SLAM技术进入到前沿阶段,涌现出大量成熟的系统和软件,同时随着各种传感器的发展,出现了大量研究成果,如:HectorSLAM[13]、ORB-SLAM[14]、LSD-SLAM[15]、SVO[16]、RGB-DSLAM V2[17]和DTAM[18]等。

1.2 SLAM算法概述SLAM算法主要分为3大部分:前端(又叫跟踪或前端建图,跟踪又可以分成odometry loop closure)、后端、地图创建。而SLAM算法按照传感器的不同主要分为3大类:基于相机的SLAM算法、基于深度相机的SLAM算法、基于激光的SLAM算法。常用的传感器有:单目相机、双目/多目相机、全景相机、深度相机(RGB-D数据)、2D转轴雷达、可装戴设备等。其中,激光SLAM研究较早,理论和工程均比较成熟。视觉方案目前尚处于实验室研究阶段,极少看到实际产品应用。

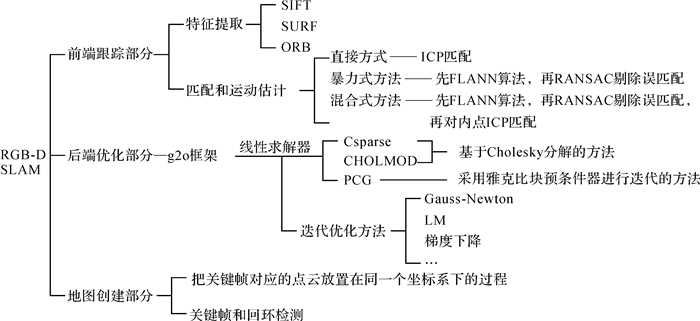

如图 1所示,本文以RGB-DSLAM算法为例,介绍SLAM算法的关键步骤[19]。前端部分主要包含特征点提取、特征点匹配和运动估计;后端主要是优化部分,研究人员提出了g2o(general graph optimization),是一个用于求解图优化问题的C++框架,专门用于求解图优化问题。g2o框架中包含了3个线性求解器CSparse、CHOLMOD和PCG。CSparse和CHOLMOD求解器是基于Cholesky分解的方法,PCG是采用雅克比块预条件器进行迭代的方法。这些求解器都包含了传统的迭代优化方法Gauss-Newton或Levenberg-Marquardt(LM)思想。使用g2o框架包含的求解器求解该问题时,会给每个时刻的位姿一个初始估计值,保持求出的关键帧之间的运动关系不变,然后用梯度下降的方法来迭代,求解出使目标函数最小的优化变量。优化结束后将会得到机器人全局优化后的位姿、运动轨迹。在地图创建部分,RGB-D方法获得的地图是彩色点云图,创建过程是把关键帧对应的点云放置在同一个坐标系下的过程。创建完成后可以对点云地图进行滤波、降采样处理,分别用于保持精确度和节省存储空间。

|

| 图 1 RGB-D SLAM关键步骤 |

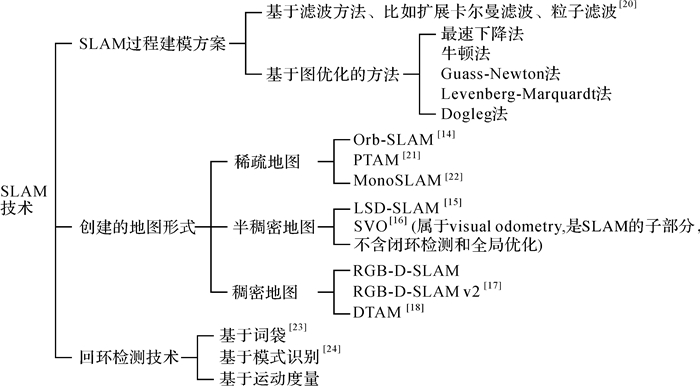

按照算法处理的各个关键步骤的不同对SLAM技术进行划分[25-27],可以得到如图 2所示的框图。

|

| 图 2 SLAM技术分类 |

对于SLAM算法构建出的地图主要有以下几种形式[28]:

(1) 路标地图(landmark map):由环境中的3D特征点组成,如单目SLAM中基于特征的方法构建的地图。其构建方法为:根据摄像机模型,把图像2D特征点投影到世界坐标系下变为3D点。该地图的优点为占存储空间小、易扩展、易满足实时创建要求。缺点为稀疏,可能导致无法识别地图中的内容。

(2) 度量地图(metricmap):尽可能精确地表达环境,包含了环境中许多细节,如距离、大小、颜色等,通常度量地图都是基于一个全局坐标系创建的。通常指2D或3D的网格地图,常见的有黑白或点云地图,如RGB-D SLAM构建的点云图、基于直接法的单目SLAM构建出的地图。该地图的优点为精度高,更适用于测绘,也适合于定位、导航和避障(点云地图转成OctoMap才能用于避障)。缺点为计算量大,构建困难,不易扩展,占用存储空间大。

(3) 拓扑地图(topological map):使用抽象的方式表达环境,图中节点表示环境中具有显著特征的地点,弧表示节点之间的关系。该地图的优点为构建简单、易扩展,比测量地图占用的存储空间小很多,适合路径规划。缺点为不能用于需要高精度地图的场合,如避障。

(4) 混合地图:这种地图尽力结合度量地图和拓扑地图的优点。

2 SLAM技术的发展及应用SLAM技术的一种简单分类方法是按照移动机器人的空间移动方式划分,即分为2D SLAM和3D SLAM。2D SLAM指的是机器人在二维平面上移动时进行的自定位和地图绘制;而3D SLAM指的是机器人在三维空间里移动时进行的自定位和地图绘制。

早期的机器人一般为轮式机器人,这类机器人都有类似的轮式结构作为行走机构,采用视觉传感器或激光传感器来进行环境感知。在比较光洁平整的室内地面环境下,它们的SLAM靠二维线阵激光传感器完成,即采用2D SLAM技术。2D SLAM是一种在机器人领域十多年前就已经成熟的技术,目前已经很少有学者在这方面进行学术研究。因为它对工作环境有非常严重的依赖,并且精度不高。原则上,它要求二维激光传感器绝对水平安装,并且在机器人运动过程中保持激光传感器的姿态水平,进而保证二维线阵激光传感器的激光扫描面水平,否则会导致二维构图失准并产生严重误差。为了提高算法的适应性,往往给二维激光传感器配一个IMU或AHRS等角度姿态传感器,帮助矫正水平扫描激光由地面不平引起的扫描面不水平带来的二维地图构建错误问题。由于2D SLAM的先天技术架构局限性问题,它主要应用在低成本低精度的室内定位和构图需求方案中,如现在流行的千元级产品清洁扫地机器人里面的基于激光传感器的SLAM模块。

为了解决2D SLAM技术的不足,研究人员开始提出3D SLAM技术,该技术是目前国际学术的研究热点。机器人本体平台的快速发展对SLAM技术的三维化提出了要求和挑战。如目前在机器人领域非常著名的美国谷歌的机器人公司波士顿动力(Boston Dynamics)的双足人形机器人Atlas上采用的就是3D SLAM技术,还有美国宇航局喷气推进实验室(NASA JPL)的猿形机器人RoboSimian的3D SLAM技术。

3D SLAM的实现手段是多样的,在室内等小范围环境识别和构图方面,可以采用视觉传感器,如单目或双目摄像机、微软的kinect或Intel的realsense类的RGB-D深度传感器等。在室外大场景环境中的工业级应用往往采用激光和视觉传感器结合的里程计方法等。3D SLAM技术是目前SLAM技术发展的方向,不仅在机器人领域,在VR(虚拟现实)、AR(增强现实)、室内高精地图、室内定位与导航、人工智能和深度学习等相交叉的领域也是研究热点,是不断更新的技术。

最近由欧思徕(北京)智能科技有限公司研发的采用3D SLAM技术的激光影像背包式测绘机器人,可以爬山涉水、翻山越岭,全空间、全地形地在运动中高精度建模,该技术解决了现有地面移动测量系统对GNSS信号的依赖问题,可以用于无GNSS信号的环境中进行移动测绘;相较于传统的固定式激光雷达换站式扫描的测绘方法,该测绘机器人可以连续移动测量扫描,极大地提高了数据采集的效率,而且具有良好的机动性。相较于基于二维SLAM推车式的移动测绘系统只适用于地面水平的环境中,该测绘机器人能够在各种复杂的环境下进行数据采集,操作简单,可用于不同移动载体。

3D SLAM激光背包测绘机器人是一个背负式系统,当工作人员背负作业时,激光扫描仪的运动轨迹是一条与工作人员行走的步态有关的非线性和高动态的曲线。按照一般的理解,激光扫描仪如果安装在移动测量系统中,一定要有一个高精度的定位系统(POS系统)与之匹配,这样,激光扫描仪得到的激光点才能得到对应的位置和姿态数据,进而合成三维的激光点云。同时,常规的移动测量系统的载具在室外一般是汽车,而汽车由于采用四轮结构的底盘,因而其转弯半径受限,因此它的行驶轨迹往往是局部连续可微的平滑曲线。而同样是基于激光的移动测量系统,3D SLAM激光背包测绘机器人既没有GPS,也没有IMU惯导,在如此高动态非线性的运动采集方式下,却能获得非常高精度的三维空间点云成果。为了能解算出激光点云数据的高动态非线性位姿,通过研究激光点云的处理算法,可从这些杂乱无章的点云中找到线索,求取其中隐含的更稳定的高阶特征点和特征向量,并连续跟踪这些特征点和特征向量,进而高精度地动态反向解算机器人的位置和姿态。然而,这种高精度的动态反向解算位置和姿态的方法颠覆的传统的测绘方法,为测绘技术开拓了一种新的思路方法。

3 SLAM技术在测绘领域中应用的可能性 3.1 SLAM技术在测绘领域中的优势由于SLAM技术无需GNSS信号,对工作环境又有极强的适应性,基于SLAM技术的移动测量系统在多个测绘领域发挥作用,具体表现为:

(1) 外业数据采集速度极快,可快速获得所需点云数据,数据精度高。

(2) 内业点云预处理时间短,自动化程度高,基本不需要人工干预,短时间便能获得配准好的点云数据。

(3) 操作简单方便,无需换站,连续采集,具有连贯性,可实现室内外一体化扫描作业。

(4) 基于SLAM技术的测绘移动测量机器人在任意环境中长时间工作故障率低,对于精度要求较高的重点区域,可与固定测站式三维激光系统配合使用,既能保证精度,又能保证效率。

3.2 应用案例 3.2.1 室内外大比例尺一体化测图及三维建模通过空中航拍倾斜摄影手段,可以快速重建出大面积地面建筑模型。但是,由于地面植被覆盖、城区高楼互相干涉遮挡等原因,采用倾斜摄影进行城市建模的方法对城市建筑模型的30 m以下底商部分,无法进行精模的制作。而采用3D SLAM自定位技术的激光影像背包测绘机器人,由于它的工作原理不依赖GPS+INS的组合惯导系统定位,可以以步行的方式穿过高楼林立和树木遮挡等无GPS参考信号的城区进行数据采集,尤其是那些远离主干道的建筑物、居民小区、企事业单位等传统移动激光测量车不能到达的地方,进而得到非常精确的数据成果,包括室外建筑群的高精度结构数据、全景影像数据、三维模型和大比例尺地图等。倾斜摄影三维建模的特点是宏观大区域建模;3D SLAM激光影像背包测绘机器人的特点是微观小范围精细建模。两者各有特点,互为补充。

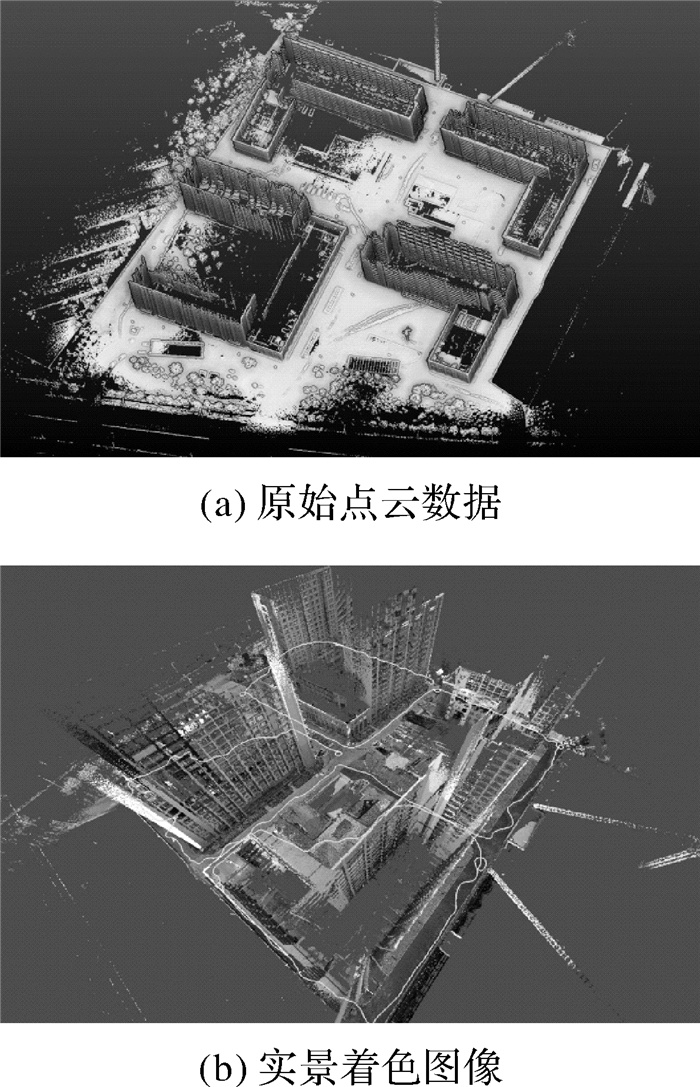

如北京某施工完成待验收建筑项目,主体建筑4栋高层,数据外业采集时间10 min,精度1 cm。原始点云数据(白模)如图 3(a)所示,实景着色图像如图 3(b)所示。

|

| 图 3 建筑物应用实例 |

通过与倾斜摄影测量技术相比,结合图 3所示效果,可以看到只有基于采用3D SLAM激光背包测绘机器人的步行方式所具有的高通过性才能保证在施工工地采集数据,其他方式如机动车车载、手推车车载等都无法胜任此类外业工作。

3.2.2 室内外导航定位3D SLAM激光影像背包测绘机器人具有采集方便、精度高、无需GPS信号等特点,可以为任何建筑物,包括住房、办公室、商场、工业厂房、公共场所等进行高精度室内地图构建,并且依据高精室内地图在室内地下等无GPS信号覆盖的环境中进行高精定位与导航。如图 4所示,为室内绘制结果。

|

| 图 4 高精度室内地图构建与定位导航结果 |

3D SLAM激光影像背包测绘机器人的特点包括高速的现场数据采集、高精度的数据处理和点云建模、POS自定位核心算法不依赖GPS信号和惯导的约束、室内/室外/地下/地上三维空间全地形作业等。这些特性非常适合建筑工程施工行业数据每日动态数据采集、项目施工全过程电子档案生成、工程现场物资堆放空间规划与管理、工程质量实时管控等BIM应用。图 5为3D SLAM技术在建筑工程项目中的BIM应用示例。

|

| 图 5 3D SLAM技术在建筑工程项目中的BIM应用 |

电力铁塔和通信铁塔是非常通用的长距离传输线缆的中继支撑平台。这些铁塔的选址复杂性较高,在市区、山区、农田、戈壁等不同地形地貌情况下,施工和使用单位都需要对它们进行巡查和监管。除了常见的人工巡检外,近来采用无人机结合激光和影像等自动化的巡查方法也逐渐成熟。与此同时,作为多地貌多地形的应用,地面激光和影像相结合的巡检方式也被广泛使用。这种地面数据采集方式可以更近距离、更精确地得到现场结构数据,对需要精确数据模型的管理和巡查类应用更为适用。当然,传统的基于固定式三维激光扫描仪的作业模式效率非常低,参与的作业人员较多;在保证精度的情况下,采用3D SLAM激光影像背包测绘机器人移动作业可以提高工作效率10倍以上,并只需一名作业人员,因此可以极大地缩短外业施工周期,提升整体项目收益。

图 6为北京某高压传输线路中继支撑铁塔站址,占地面积约44亩(30 000 m2),共有铁塔4座,高度约55 m,为内业处理建模后的数据成果。

|

| 图 6 电力和通信铁塔巡检与管理中的应用实例 |

通过近些年的发展,移动机器人SLAM导航技术取得了很大的发展,多传感器融合能进一步提高机器人的定位精度,尤其在一些复杂的场景中表现得更加突出,使得提高SLAM测绘移动机器人的测量精度、获取高精度的点云数据成为可能。虽然目前的SLAM技术在测绘领域中的应用尚处于适应性试验阶段,但其特有的高精度、高效率及革新性在不远的将来会带来测绘领域的变革。

| [1] | 王之卓. 当代测绘科学的发展[J]. 测绘学报, 1998, 27(4): 283–286. |

| [2] | 赵吉先, 聂运菊. 测绘仪器发展的回顾与展望[J]. 测绘通报, 2008(2): 70–71. |

| [3] | 宁津生, 陈俊勇, 李德仁, 等. 测绘学概论[M]. 武汉: 武汉大学出版社, 2004. |

| [4] | 陈卫东, 张飞. 移动机器人的同步自定位与地图创建研究进展[J]. 控制理论与应用, 2005, 22(3): 455–460. |

| [5] | CASTELLANOS J A, TARDÓS J D. Mobile Robot Localization and Map Building:A Multisensor Fusion Approach[J]. Automatica, 2003, 39(6): 1120–1121. DOI:10.1016/S0005-1098(03)00066-9 |

| [6] | SE S, LOWE D G, LITTLE J J. Mobile Robot Localization and Mapping with Uncertainty Using Scale-Invariant Visual Landmarks[J]. International Journal of Robotics Research, 2002, 21(8): 735–760. DOI:10.1177/027836402761412467 |

| [7] | DAVISON A J. Real-time Simultaneous Localisation and Mapping with a Single Camera[C]//IEEE International Conference on Computer Vision. [S. l. ]: IEEE, 2003. |

| [8] | GRISETTI G, TIPALDI G D, STACHNISS C, et al. Fast and Accurate SLAM with Rao-Blackwellized Particle Filters[J]. Robotics & Autonomous Systems, 2007, 55(1): 30–38. |

| [9] | SIM R, ELINAS P, LITTLE J J. A Study of the Rao-Blackwellised Particle Filter for Efficient and Accurate Vision-Based SLAM[J]. International Journal of Computer Vision, 2007, 74(3): 303–318. DOI:10.1007/s11263-006-0021-0 |

| [10] | MONTEMERLO M, THRUN S, KOLLER D, et al. FastSLAM: a Factored Solution to the Simultaneous Localization and Mapping Problem in Robotics[C]//Eighteenth National Conference on Artificial Intelligence. Edmonton: [s. n. ], 2002. |

| [11] | WATER S T. American Association for Artificial Intelligence[J]. Library Hi Tech News, 1988(54): 1–3. |

| [12] | KAMEDA Y. Parallel Tracking and Mapping for Small AR Workspaces (PTAM) Augmented Reality[J]. Journal of the Institute of Image Information & Television Engineers, 2012, 66(1): 45–51. |

| [13] | KONOLIGE K, AGRAWAL M. Frame SLAM:From Bundle Adjustment to Real-Time Visual Mapping[J]. IEEE Transactions on Robotics, 2008, 24(5): 1066–1077. DOI:10.1109/TRO.2008.2004832 |

| [14] | KOHLBRECHER S, MEYER J, GRABER T, et al. Hector SLAM for Robust Mapping in USAR Environments[J]. Robot Soccer World Cup, 2013, 8371: 624–631. |

| [15] | MUR-ARTAL R, MONTIEL J M M, TARDÍS J D. Orb-slam:A Versatile and Accurate Monocular Slam System[J]. IEEE Transactions on Robotics, 2015, 31(5): 1147–1163. DOI:10.1109/TRO.2015.2463671 |

| [16] | ENGEL J, SCHÖPS T, CREMERS D. LSD-SLAM: Large-Scale Direct Monocular SLAM[C]//European Conference on Computer Vision. [S. l. ]: Springer, 2014: 834-849. https://vision.in.tum.de/research/vslam/lsdslam |

| [17] | FORSTER C, PIZZOLI M, SCARAMUZZA D. SVO: Fast Semi-direct Monocular Visual Odometry[C]//IEEE International Conference on Robotics and Automation. [S. l. ]: IEEE, 2014: 15-22. http://blog.csdn.net/u010566411/article/details/47183125 |

| [18] | ENDRES F, HESS J, STURM J, et al. 3-D Mapping with an RGB-D Camera[J]. IEEE Transactions on Robotics, 2014, 30(1): 177–187. DOI:10.1109/TRO.2013.2279412 |

| [19] | NEWCOMBE R A, LOVEGROVE S J, DAVISON A J. DTAM: Dense Tracking and Mapping in Real-time[C]//2011 International Conference on Computer Vision. [S. l. ]: IEEE, 2011: 2320-2327. http://ieeexplore.ieee.org/document/6126513/ |

| [20] | ENDRES F, HESS J, STURM J, et al. 3-D Mapping with an RGB-D Camera[J]. IEEE Transactions on Robotics, 2014, 30(1): 177–187. DOI:10.1109/TRO.2013.2279412 |

| [21] | BAILEY T, DURRANT-WHYTE H. Simultaneous Localization and Mapping (SLAM):Part Ⅱ[J]. IEEE Robotics & Automation Magazine, 2006, 13(3): 108–117. |

| [22] | KLEIN G, MURRAY D. Parallel Tracking and Mapping for Small AR Workspaces[C]//Mixed and Augmented Reality, 2007. ISMAR 2007. 6th IEEE and ACM International Symposium on. [S. l. ]: IEEE, 2007: 225-234. http://www.robots.ox.ac.uk/~gk/PTAM/ |

| [23] | DAVISON A J, REID I D, MOLTON N D, et al. MonoSLAM:Real-time Single Camera SLAM[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2007, 29(6): 1052–1067. DOI:10.1109/TPAMI.2007.1049 |

| [24] | ANGELI A, FILLIAT D, DONCIEUX S, et al. Fast and Incremental Method for Loop-closure Detection using Bags of Visual Words[J]. IEEE Transactions on Robotics, 2008, 24(5): 1027–1037. DOI:10.1109/TRO.2008.2004514 |

| [25] | HO K L, NEWMAN P. Loop Closure Detection in SLAM by Combining Visual and Spatial Appearance[J]. Robotics & Autonomous Systems, 2006, 54(9): 740–749. |

| [26] | DURRANT-WHYTE H, BAILEY T. Simultaneous Localization and Mapping:Part Ⅰ[J]. IEEE Robotics & Automation Magazine, 2006, 13(2): 99–110. |

| [27] | KÜMMERLE R, GRISETTI G, STRASDAT H, et al. g2o: A General Framework for Graph Optimization[C]//Robotics and Automation (ICRA), 2011 IEEE International Conference on. [S. l. ]: IEEE, 2011: 3607-3613. http://www.openslam.org/g2o.html |

| [28] | 徐冬云. 基于Kinect的视觉同步定位与建图研究[D]. 哈尔滨: 哈尔滨工业大学, 2016. |

| [29] | GARCIA-FIDALGO E, ORTIZ A. Vision-based Topological Mapping and Localization Methods:A Survey[J]. Robotics and Autonomous Systems, 2015, 64: 1–2. DOI:10.1016/j.robot.2014.11.009 |

| [30] | 黄鹤, 王柳, 姜斌, 等. 3D SLAM激光影像背包测绘机器人精度验证[J]. 测绘通报, 2016(12): 68–73. |